Оновлено: 15 травня 2026

14 травня 2026 вийшла Ollama 0.24 — і це не черговий патч з виправленням багів.

Цей реліз додає офіційну підтримку Codex App від OpenAI: тепер десктопний AI coding agent

можна запустити на будь-якій локальній або хмарній моделі через Ollama.

Одна команда — і Codex працює з твоїми моделями, без обов'язкової підписки на OpenAI.

→ Читати офіційну документацію Ollama Codex App

Якщо ще не знайомий з Ollama — почни з

гайду зі встановлення на Mac, Windows і Linux.

Якщо цікавить порівняння моделей для coding-задач — читай

топ моделей Ollama у 2026.

📚 Зміст статті

🎯 Що змінилось: чому Ollama 0.24 — це не просто патч

Коротка відповідь: Ollama 0.24 — перший реліз, який перетворює Ollama

з інструменту для запуску моделей у платформу для AI coding агентів.

Codex App тепер працює поверх Ollama так само як над OpenAI API — тільки моделі локальні або хмарні за твоїм вибором.

До Ollama 0.24 Codex App працював виключно через OpenAI API і вимагав підписки Plus або Pro.

Тепер достатньо мати встановлену Ollama і одну команду — і Codex отримує доступ до будь-якої локальної моделі.

Що нового у Ollama 0.24 згідно з офіційним релізом на GitHub:

- ✔️ Codex App integration — офіційна підтримка десктопного Codex App через

ollama launch codex-app

- ✔️ MLX memory trace logging — логування використання пам'яті для моделей на Apple Silicon

- ✔️ Покращений MLX sampler — вища якість генерації на Mac M-серії

- ✔️ Надійніше оновлення — виправлено проблеми з автооновленням Ollama App

- ✔️ Кешування відповідей для команди

ollama show — швидший старт

Але головне — це не список фіч. Головне — зміна концепції.

Раніше Ollama була відповіддю на питання «як запустити модель локально».

Тепер вона стає відповіддю на питання «як запустити AI coding agent локально».

Codex App, Claude Code, OpenCode, Copilot CLI — всі вони тепер запускаються через ollama launch.

Це принципово інший рівень: не просто виконання промптів, а повноцінний агент

з доступом до репозиторію, терміналу, браузеру і циклом виконання задач.

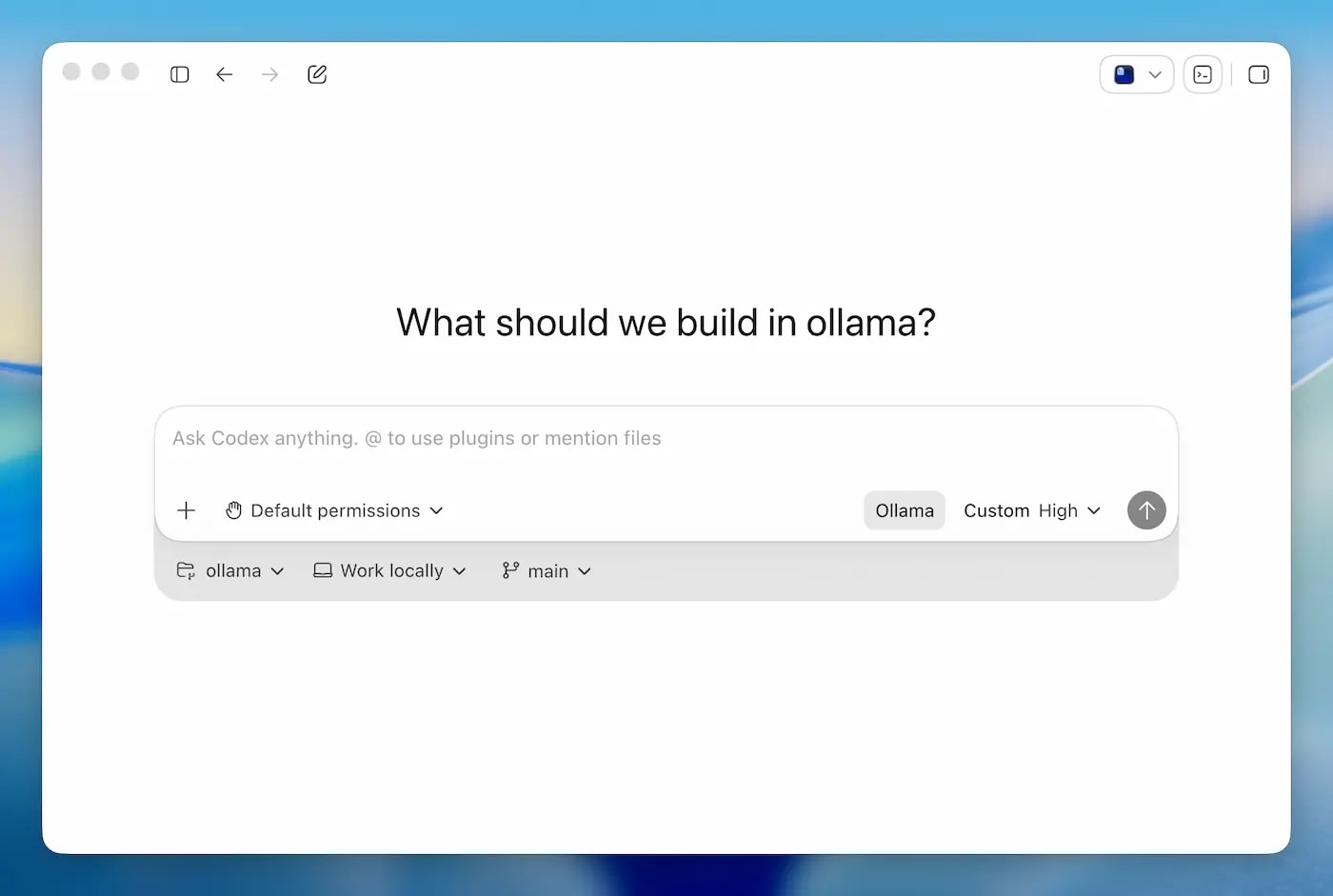

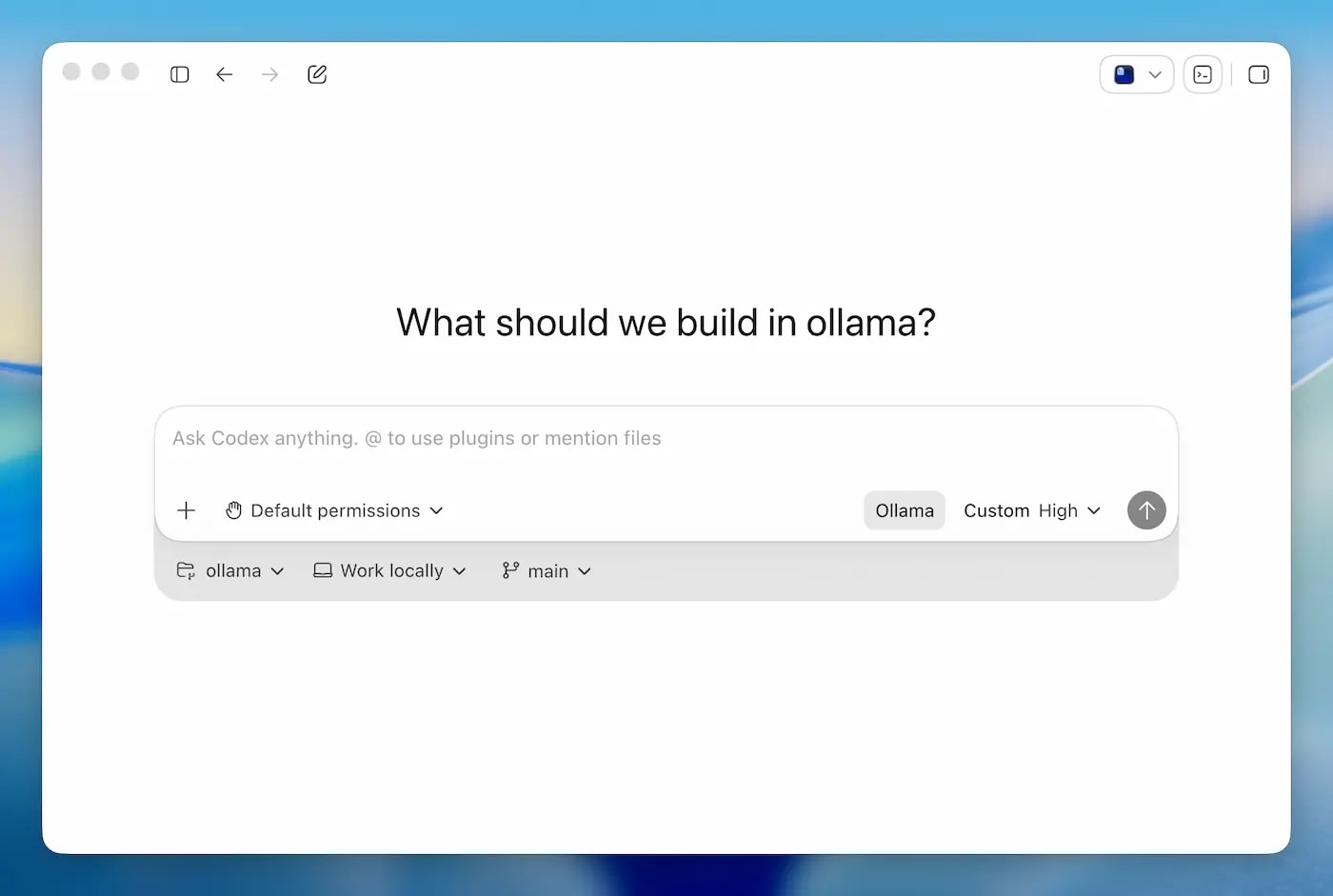

🎯 Як працює Codex App: не IDE, а AI agent з інтерфейсом

Коротка відповідь: Codex App — це десктопний застосунок від OpenAI для macOS і Windows.

Не плагін до IDE, не автодоповнення коду. Це автономний агент,

який отримує задачу, пише план, виконує кроки, запускає код і повертає результат.

Різниця між Copilot і Codex App: Copilot дописує рядок коду поки ти друкуєш.

Codex App отримує задачу «додай авторизацію через OAuth» і сам пише код,

запускає тести, виправляє помилки — без твоєї участі на кожному кроці.

⚠️ Важливо з особистого досвіду: те що агент «сам пише код» — не означає що він пише його правильно.

На практиці AI coding агенти часто ігнорують SOLID принципи, створюють God Objects,

змішують логіку в одному класі або генерують working but ugly code без розуміння твоєї архітектури.

Моє правило: сприймай результат Codex App як чорновий варіант, а не фінальний код.

Агент добре справляється з механічною роботою — написати boilerplate, покрити тестами,

зробити рефакторинг за чітким завданням. Але архітектурні рішення — Single Responsibility,

правильне розділення шарів, dependency injection — потребують твого контролю.

Практичний підхід: перед запуском задачі — опиши агенту архітектурні обмеження у промпті.

Наприклад: «використовуй Repository pattern, сервісний шар окремо від контролера, не клади бізнес-логіку в entity».

Без цього агент обере найпростіший шлях — і не факт що правильний.

Архітектура взаємодії після підключення Ollama виглядає так:

- Codex App надсилає запити до Ollama OpenAI-сумісного endpoint (

http://localhost:11434/v1)

- Ollama передає запит обраній моделі — локальній або хмарній

- Модель повертає відповідь у форматі tool calling / function calling

- Codex App інтерпретує відповідь, виконує дії (пише файли, запускає команди)

- Результат виконання повертається моделі як контекст для наступного кроку

Чим це відрізняється від Cursor або Copilot Chat:

- Cursor — вбудований у редактор, допомагає у процесі написання коду. Codex App — окремий застосунок, виконує задачі асинхронно.

- Copilot — пропонує автодоповнення і чат. Codex App — повний execution loop: план → код → запуск → перевірка → виправлення.

- Claude Code — CLI-агент у терміналі. Codex App — десктопний застосунок з візуальним інтерфейсом, браузером і review mode.

Для роботи Codex App потрібна модель з надійним tool calling.

Саме тому вибір моделі критично важливий — детально розберемо нижче.

Якщо хочеш зрозуміти механіку tool calling глибше —

читай які моделі Ollama підтримують Tool Calling: тести та бенчмарки 2026.

🎯 Покрокова установка: ollama launch codex-app

Коротка відповідь: Три кроки — оновити Ollama, встановити Codex App, запустити одну команду.

Ollama сама налаштовує Codex на використання локального endpoint.

Офіційна документація Ollama по інтеграції з Codex App —

підтримка доступна з версії v0.24.0 і новіше.

Крок 1. Оновити Ollama до версії 0.24.0+

Перевір поточну версію:

ollama --version

Якщо версія нижча за 0.24.0 — оновити:

# macOS і Linux

curl -fsSL https://ollama.com/install.sh | sh

# Windows — завантаж новий інсталятор з https://ollama.com/download

Крок 2. Встановити Codex App

Завантаж десктопний застосунок Codex App для macOS або Windows з офіційного сайту OpenAI:

developers.openai.com/codex/quickstart.

Після встановлення — відкрий Codex App хоча б один раз вручну.

Це потрібно щоб застосунок ініціалізував свої конфіг-файли.

Після першого відкриття — закрий.

Крок 3. Запустити через Ollama

ollama launch codex-app

Ollama автоматично налаштовує Codex App на використання свого OpenAI-сумісного endpoint

і відкриває застосунок. Конфіг зберігається — наступного разу Codex відкриється вже з твоєю моделлю.

Запустити з конкретною моделлю одразу:

# Хмарна модель з підтримкою vision

ollama launch codex-app --model kimi-k2.6:cloud

# Локальна модель

ollama launch codex-app --model qwen3:14b

# Локальна з меншим споживанням RAM

ollama launch codex-app --model gemma4:4b

Відновити оригінальні налаштування Codex

Якщо хочеш повернути Codex App до попереднього профілю (наприклад, назад до OpenAI API):

ollama launch codex-app --restore

Перед перезаписом конфігів Ollama автоматично зберігає бекап у

~/.ollama/backup/codex-app/ (на Windows ~ = папка профілю користувача).

⚠️ Типові проблеми і рішення

| Проблема |

Причина |

Рішення |

| Codex App не відкривається після команди |

Застосунок ще не ініціалізований |

Відкрий Codex вручну один раз, потім запусти ollama launch codex-app знову |

| Codex не перемикає модель |

Застосунок вже запущений і не перезавантажився |

Дозволь Ollama перезапустити Codex коли запитає, або закрий вручну і запусти команду знову |

| Модель не знайдена |

Модель не завантажена локально |

Спочатку ollama pull назва-моделі, потім ollama launch codex-app |

| Повільна відповідь або таймаут |

Модель занадто велика для заліза або cold start |

Обери меншу модель або дочекайся першого завантаження |

Важливо: профіль Codex App (ollama launch codex-app) і профіль Codex CLI

(ollama launch codex) — окремі. Зміна одного не впливає на інший.

🎯 Яку модель обрати для Codex: порівняння по задачах

Коротка відповідь: Codex App — це агент з tool calling і багатокроковим execution loop.

Для нього потрібна модель з надійним tool calling, а не просто «підтримує».

Слабкий tool calling = агент зупиняється посередині задачі або повертає текст замість JSON.

Повний список моделей Ollama з підтримкою tool calling і порівняння надійності —

у статті які моделі Ollama підтримують Tool Calling: тести та бенчмарки 2026.

Ollama рекомендує такі моделі для Codex у своєму листі (травень 2026):

Хмарні моделі (через Ollama Cloud)

| Модель |

Особливість |

Коли обирати |

kimi-k2.6:cloud |

Підтримка vision (бачить скриншоти) |

Коли потрібно анотувати UI або дебажити за скриншотом |

glm-5.1:cloud |

Сильний у коді, швидкий |

Для загальних coding задач з хмарною якістю |

Локальні моделі (без підписки на Ollama Cloud)

| Модель |

RAM |

Tool calling |

Коли обирати |

qwen3:14b |

~9 GB |

Відмінний |

Оптимальний баланс якість / RAM для більшості задач |

qwen3:8b |

~5 GB |

Добрий |

Якщо RAM обмежений, але потрібна прийнятна якість |

gemma4:31b |

~20 GB |

Відмінний |

Максимальна якість локально, потрібен потужний Mac |

gemma4:4b |

~3 GB |

Прийнятний |

Слабке залізо, прості задачі |

nemotron-3-super:cloud |

хмара |

Відмінний |

Альтернатива без платної підписки Ollama Cloud |

Завантажити модель перед запуском:

# Рекомендовано для більшості

ollama pull qwen3:14b

# Якщо RAM менше 10 GB

ollama pull qwen3:8b

# Максимальна якість локально

ollama pull gemma4:31b

Детальніше про вибір моделей під конкретне залізо —

читай Ollama на слабкому залізі: що запустити на 8GB RAM.

Ключовий критерій: надійність tool calling

Для агентських задач — не дивись лише на розмір або «загальну якість» моделі.

Головне: чи повертає модель коректний JSON при tool call, чи не «галюцинує» аргументи,

чи коректно обробляє multi-step tool loops.

Якщо модель не підтримує tool calling належно — вона починає або вигадувати аргументи,

або ігнорувати умови задачі, або просто відповідати текстом там де очікується структурований виклик.

Результат: агент іде не туди і ти витрачаєш час на виправлення замість роботи.

З особистого досвіду — практика двох моделей: я використовую дві моделі паралельно.

Швидка модель (llama3.2:3b) покриває ~70% задач і відповідає за 1–2 секунди —

звичайні питання, генерація boilerplate, короткі відповіді.

Коли потрібно точне дотримання промпту, складний tool calling або багатокроковий агент —

перемикаюсь на qwen3:8b або більшу.

Після складної задачі — повертаюсь назад на швидку. Чекати 8–12 секунд на кожну відповідь

у звичайному режимі роботи — занадто довго.

Такий підхід дає баланс між швидкістю і якістю — не треба щоразу чекати

поки велика модель «розігріється» для простих запитів.

🎯 Вбудований браузер і Review Mode: що це дає на практиці

Коротка відповідь: Дві фічі які відрізняють Codex App від CLI-агентів —

вбудований браузер з анотаціями і режим перегляду коду.

За офіційною документацією вони реально існують і працюють.

Наскільки добре — залежить від моделі і складності задачі.

Вбудований браузер

Згідно з офіційною документацією Ollama,

Codex App може відкривати локальні сервери і сайти у вбудованому браузері —

і дозволяє залишати анотації прямо на сторінці як контекст для агента.

На папері це виглядає зручно: відкрив локальний dev-сервер, виділив елемент,

написав коментар — і агент розуміє що треба виправити без додаткового опису.

⚠️ Чесно про обмеження: результат сильно залежить від того

наскільки точно агент інтерпретує твою анотацію і контекст сторінки.

Для простих UI правок — працює непогано. Для складніших сценаріїв

(баг у логіці, не у верстці) — анотація в браузері не замінює чіткого промпту.

Vision-можливості (коли модель буквально «бачить» скриншот) доступні

тільки з моделями що підтримують vision — наприклад kimi-k2.6:cloud.

З текстовими локальними моделями агент читає HTML, а не зображення.

Review Mode

За документацією,

Review Mode дозволяє переглядати зміни коду в самому Codex App,

залишати коментарі до конкретних рядків і просити агента доопрацювати.

Принципово це той самий workflow що і в GitHub PR review —

але без виходу з застосунку. Агент бачить свій же diff і твій коментар

у одному контексті, що зменшує кількість пояснень.

⚠️ Чесно про обмеження: Review Mode корисний коли агент зробив

щось близьке до правильного і треба підправити деталі.

Якщо агент пішов принципово не туди з архітектурою —

коментарі в review не замінять переформулювання задачі з нуля.

Це інструмент для уточнень, не для виправлення фундаментальних помилок.

🎯 Обмеження локального підходу: де хмарний Codex виграє

Коротка відповідь: Локальний Codex через Ollama — це приватність, офлайн і відсутність підписки.

Але є задачі де хмарний OpenAI Codex (на GPT-4o або GPT-5.5) буде помітно кращим.

Знати ці межі важливо — щоб не витрачати час на задачі де локальна модель не впорається.

Детальніше про сценарії де Ollama виграє перед хмарними API, а де програє —

читай Ollama vs ChatGPT vs Claude: яка задача вимагає хмари.

| Критерій |

Локальний Codex (Ollama) |

Хмарний Codex (OpenAI) |

| Приватність коду |

✅ Код не покидає машину |

⚠️ Код надсилається на сервери OpenAI |

| Офлайн робота |

✅ Повністю офлайн (локальні моделі) |

❌ Потрібен інтернет |

| Вартість |

✅ Безкоштовно після купівлі заліза |

⚠️ Підписка або оплата за токени |

| Якість на складних задачах |

⚠️ Залежить від моделі і заліза |

✅ GPT-5.5 — сильніший на архітектурних задачах |

| Контекстне вікно |

⚠️ Обмежено RAM (зазвичай 8k–32k) |

✅ До 128k+ токенів |

| Швидкість на великих репо |

⚠️ Повільніше на CPU або слабкому GPU |

✅ Стабільна швидкість незалежно від заліза |

| Vision (скриншоти) |

⚠️ Тільки з kimi-k2.6:cloud або gemma4 |

✅ Нативна підтримка у GPT-4o / GPT-5.5 |

| Паралельні задачі (task tree) |

✅ Підтримується |

✅ Підтримується |

Де локальний Codex чітко виграє

- Приватний або комерційний код — коли не можна надсилати код на зовнішні сервери

- Повторювані задачі — рефакторинг, написання тестів, генерація boilerplate де якість GPT-4 не критична

- Офлайн середовища — корпоративні мережі без виходу в інтернет

- Вартість при великих обсягах — якщо щодня генеруєш тисячі токенів, локаль дешевша

Детальніше про переваги self-hosted AI →

читати статтю

Де хмарний Codex краще

- Великі репозиторії — коли контекст не вміщується в 8–16k токенів

- Складна архітектура — де потрібен рівень GPT-5.5 для правильного рішення

- Vision-задачі — аналіз скриншотів UI без cloud-моделі

- Слабке залізо — якщо Mac або PC не тягне 14B модель

🎯 Який сетап оптимальний: залізо, модель, налаштування

Коротка відповідь: Для комфортної роботи з локальним Codex потрібно мінімум 16 GB RAM.

8 GB — можливо, але обмежено. Нижче — конкретні рекомендації залежно від заліза.

Mac Apple Silicon (рекомендований варіант)

| RAM |

Рекомендована модель |

Очікувана швидкість |

| 8 GB |

qwen3:8b або gemma4:4b |

~15–20 tok/s, прості задачі |

| 16 GB |

qwen3:14b — оптимально |

~20–30 tok/s, більшість задач |

| 32 GB |

gemma4:31b або qwen3:32b |

~15–25 tok/s, складні задачі |

| 64 GB+ |

qwen3:72b або більші |

~10–20 tok/s, максимальна якість локально |

Windows / Linux з NVIDIA GPU

| VRAM |

Рекомендована модель |

Примітка |

| 8 GB |

qwen3:8b |

Повністю у VRAM, швидко |

| 12 GB |

qwen3:14b (Q4) |

Поміщається при кванти Q4_K_M |

| 16 GB+ |

qwen3:14b або gemma4:27b |

Комфортна робота без swap |

| 24 GB+ |

gemma4:31b |

Максимальна якість на GPU |

Оптимальний набір команд для старту

# 1. Оновити Ollama

curl -fsSL https://ollama.com/install.sh | sh

# 2. Завантажити модель (для 16 GB RAM)

ollama pull qwen3:14b

# 3. Запустити Codex App з обраною моделлю

ollama launch codex-app --model qwen3:14b

# Наступного разу достатньо просто:

ollama launch codex-app

# Ollama пам'ятає обрану модель

Налаштування контексту для великих репозиторіїв

За замовчуванням контекстне вікно залежить від VRAM/RAM.

Для роботи з великими файлами або кількома файлами одночасно —

можна збільшити контекст через Modelfile:

# Створюємо Modelfile з більшим контекстом

FROM qwen3:14b

PARAMETER num_ctx 16384

# Збираємо нову модель

ollama create qwen3-codex -f Modelfile

# Запускаємо Codex з цією моделлю

ollama launch codex-app --model qwen3-codex

Детально про управління контекстом і налаштування параметрів —

у статті Ollama REST API: інтеграція у свій застосунок.

⚙️ Просунуті налаштування: конфіг, змінні середовища, бенчмарки

Для більшості достатньо ollama launch codex-app.

Але якщо хочеш більше контролю над поведінкою агента або вичавити

максимум з конкретної моделі — ось що можна налаштувати вручну.

1. Ручне редагування ~/.codex/config.toml

Основний конфіг Codex знаходиться за шляхом:

~/.codex/config.toml — Mac / Linux

%USERPROFILE%\.codex\config.toml — Windows

⚠️ Важливо: коли ти запускаєш ollama launch codex-app,

Ollama сама записує потрібні значення в цей файл і зберігає бекап попередніх налаштувань

у ~/.ollama/backup/codex-app/.

Ручне редагування має сенс тільки якщо хочеш змінити параметри яких немає у стандартному запуску —

наприклад temperature або системний промпт.

Приклад налаштування для локального провайдера Ollama:

[model_providers.ollama]

name = "Ollama"

base_url = "http://localhost:11434/v1"

[profiles.local-coder]

model_provider = "ollama"

model = "qwen3:14b"

temperature = 0.3

⚠️ Зверни увагу: точна структура конфіг-файлу може відрізнятись

залежно від версії Codex App. Перед редагуванням — подивись що вже є у твоєму файлі,

не переписуй наосліп. Параметр num_ctx через config.toml може не підтримуватись —

для зміни контексту надійніше використовувати Modelfile як описано вище.

2. Змінні середовища Ollama

Ollama підтримує ряд офіційних змінних середовища для тонкого тюнінгу.

Повний список — у офіційній документації Ollama FAQ.

Найбільш корисні для роботи з Codex:

| Змінна |

Що робить |

Приклад |

OLLAMA_HOST |

Адреса і порт сервера Ollama |

0.0.0.0:11434 |

OLLAMA_KEEP_ALIVE |

Як довго тримати модель в пам'яті |

30m або -1 |

OLLAMA_NUM_PARALLEL |

Кількість паралельних запитів |

2 |

OLLAMA_FLASH_ATTENTION |

Flash Attention для Apple Silicon |

1 |

OLLAMA_NUM_GPU |

Кількість GPU шарів для offload |

99 (всі шари) |

Встановити перед запуском:

# macOS / Linux

OLLAMA_KEEP_ALIVE=30m OLLAMA_FLASH_ATTENTION=1 ollama launch codex-app

# або постійно через ~/.zshrc / ~/.bashrc

export OLLAMA_KEEP_ALIVE=30m

export OLLAMA_FLASH_ATTENTION=1

3. Бенчмарки: скільки реально тягнуть локальні моделі

⚠️ Дисклеймер: точні цифри SWE-bench постійно оновлюються

і сильно залежать від конфігурації тесту. Наведені нижче дані — орієнтовні,

актуальні значення перевіряй на swebench.com

і в офіційних релізах моделей.

| Модель |

SWE-bench Verified (орієнтовно) |

Де запускати |

| GPT-5.5 / Claude Sonnet 4.6 (хмара) |

~68–73% |

OpenAI / Anthropic API |

gpt-oss:120b через Ollama |

~62% |

Локально, потрібно 64+ GB RAM |

glm-5.1:cloud / великі Qwen3 |

~58–68% |

Ollama Cloud або локально 32B+ |

qwen3:14b локально |

не тестувався офіційно |

16 GB RAM, добре для рутини |

Що з цього випливає практично: локальні моделі розміром 14B–32B

добре справляються з рутинними coding задачами — рефакторинг, написання тестів,

генерація boilerplate. На складних agentic задачах де потрібен глибокий reasoning

через кілька файлів — хмарні моделі помітно виграють.

Для більшості реальних задач розрив не настільки критичний як виглядає у відсотках.

❓ Часті питання (FAQ)

Чи потрібна підписка OpenAI щоб використовувати Codex App з Ollama?

Ні. Ollama налаштовує Codex App на свій локальний endpoint.

Підписка OpenAI потрібна тільки якщо хочеш використовувати хмарні моделі OpenAI.

Для локальних моделей — підписка не потрібна.

Codex App доступний тільки на macOS?

Ні. Codex App від OpenAI доступний для macOS і Windows.

Ollama 0.24 підтримує інтеграцію на обох платформах.

Linux поки не підтримується самим Codex App.

Яка різниця між ollama launch codex-app і ollama launch codex?

ollama launch codex-app — запускає десктопний застосунок Codex App з графічним інтерфейсом.

ollama launch codex — запускає Codex CLI у терміналі.

Це окремі профілі, зміна одного не впливає на інший.

Чи зберігаються мої конфіги якщо я запущу ollama launch codex-app?

Так. Ollama зберігає бекап оригінальних конфігів Codex App у ~/.ollama/backup/codex-app/

перед будь-якими змінами. Відновити можна командою ollama launch codex-app --restore.

Яку модель обрати якщо хочу спробувати з мінімальними вимогами?

Для початку — qwen3:8b (потрібно ~5 GB RAM) або gemma4:4b (~3 GB RAM).

Вони підтримують tool calling і дають прийнятну якість для простих задач.

Для серйозної роботи рекомендуємо qwen3:14b на 16 GB RAM.

Чи може Codex App через Ollama виконувати задачі паралельно (task tree)?

Так, task tree — функціональність самого Codex App, не залежить від того яка модель під капотом.

Але паралельне виконання задач навантажує модель і потребує більшого RAM.

На 8 GB — паралельні задачі можуть спричинити помітне сповільнення.

Codex App бачить весь мій репозиторій?

Codex App отримує доступ до репозиторію який ти відкриваєш у застосунку.

При локальних моделях — жоден код не надсилається назовні.

При хмарних моделях Ollama Cloud (kimi-k2.6:cloud, glm-5.1:cloud) — запити проходять через Ollama Cloud.

✅ Висновки

Я спробував Ollama 0.24 + Codex App одразу після релізу — і моє враження неоднозначне,

але загалом позитивне. Це справді працює: одна команда і Codex App починає використовувати

локальну модель замість OpenAI API. Для приватного коду або офлайн-середовища — вже цього достатньо щоб спробувати.

Але важливо розуміти що це не «замінник» хмарного Codex, а інший інструмент з іншими компромісами. Ось що я виніс з практики:

- ✔️ Установка проста: оновити Ollama до 0.24, встановити Codex App, запустити

ollama launch codex-app — все.

- ✔️ Модель вирішує все: для більшості задач на 16 GB RAM беру

qwen3:14b — надійний tool calling і прийнятна швидкість.

- ⚠️ Дві моделі краще ніж одна: швидка (

llama3.2:3b) для 70% задач, більша — коли потрібна точність tool calling. Чекати 8–12 секунд на кожну просту відповідь — занадто довго для нормальної роботи.

- ⚠️ Код агента — це чорновик: Codex пише працюючий код, але часто без розуміння SOLID і твоєї архітектури. Завжди переглядай результат, особливо якщо задача торкається кількох шарів застосунку.

- ✔️ Вбудований браузер і Review Mode — зручні для простих UI правок і уточнень після виконаної задачі. Для складних архітектурних проблем не замінять нормального промпту.

- ✔️ Локальний підхід виграє на приватному коді, офлайн-середовищах і великих обсягах генерації де хмара коштує дорого.

- ⚠️ Хмарний Codex кращий на великих репозиторіях де контекст не вміщується локально, і на задачах де потрібна якість GPT-5.5.

Мій підсумок: Ollama 0.24 + Codex App — корисний інструмент якщо сприймати його правильно.

Не як автономного розробника який все зробить сам, а як швидкий спосіб написати чорновий варіант

або покрити рутинні задачі — рефакторинг, тести, boilerplate.

Архітектуру і code review все одно залишається за тобою.

Якщо хочеш розібратись як влаштований tool calling під капотом Codex —

читай які моделі Ollama підтримують Tool Calling: тести та бенчмарки 2026.

Якщо цікавить повноцінний RAG-пайплайн поверх Ollama —

RAG з Ollama: від пайплайну до продакшну.

📖 Джерела