Маєш ноутбук з 8 ГБ оперативної пам'яті і хочеш запустити AI локально?

Ця стаття — розбір: що працює, що ледь тягне,

а що навіть не варто завантажувати. Без ілюзій, з конкретними моделями

та командами для кожної задачі. Якщо ще не знайомий з Ollama —

почни з вступної статті про те, що таке Ollama і навіщо вона потрібна.

📚 Зміст статті

🎯 Чесна арифметика: скільки RAM насправді лишається для моделі

Коротка відповідь:

З 8 ГБ оперативної пам'яті для AI-моделі реально доступно 4–5 ГБ.

Решту забирає операційна система, браузер і базові процеси.

Це визначає головне правило: на 8 ГБ комфортно працюють моделі до 3–7B

параметрів у 4-бітній квантизації.

8 ГБ RAM — це не 8 ГБ для моделі.

Це 8 ГБ мінус ОС, мінус Chrome, мінус все, що ти забув закрити.

Перш ніж обирати модель, потрібно зрозуміти реальний бюджет пам'яті.

Ось типовий розподіл на системі з 8 ГБ RAM:

- ✔️ Операційна система: 1.5–2.5 ГБ (macOS ближче до 2.5, Windows — 2, Linux — 1.5)

- ✔️ Браузер (5–10 вкладок): 1–2 ГБ

- ✔️ IDE (VS Code / IntelliJ): 0.5–1.5 ГБ

- ✔️ Фонові процеси: 0.3–0.5 ГБ

Залишок для моделі: 3–5 ГБ.

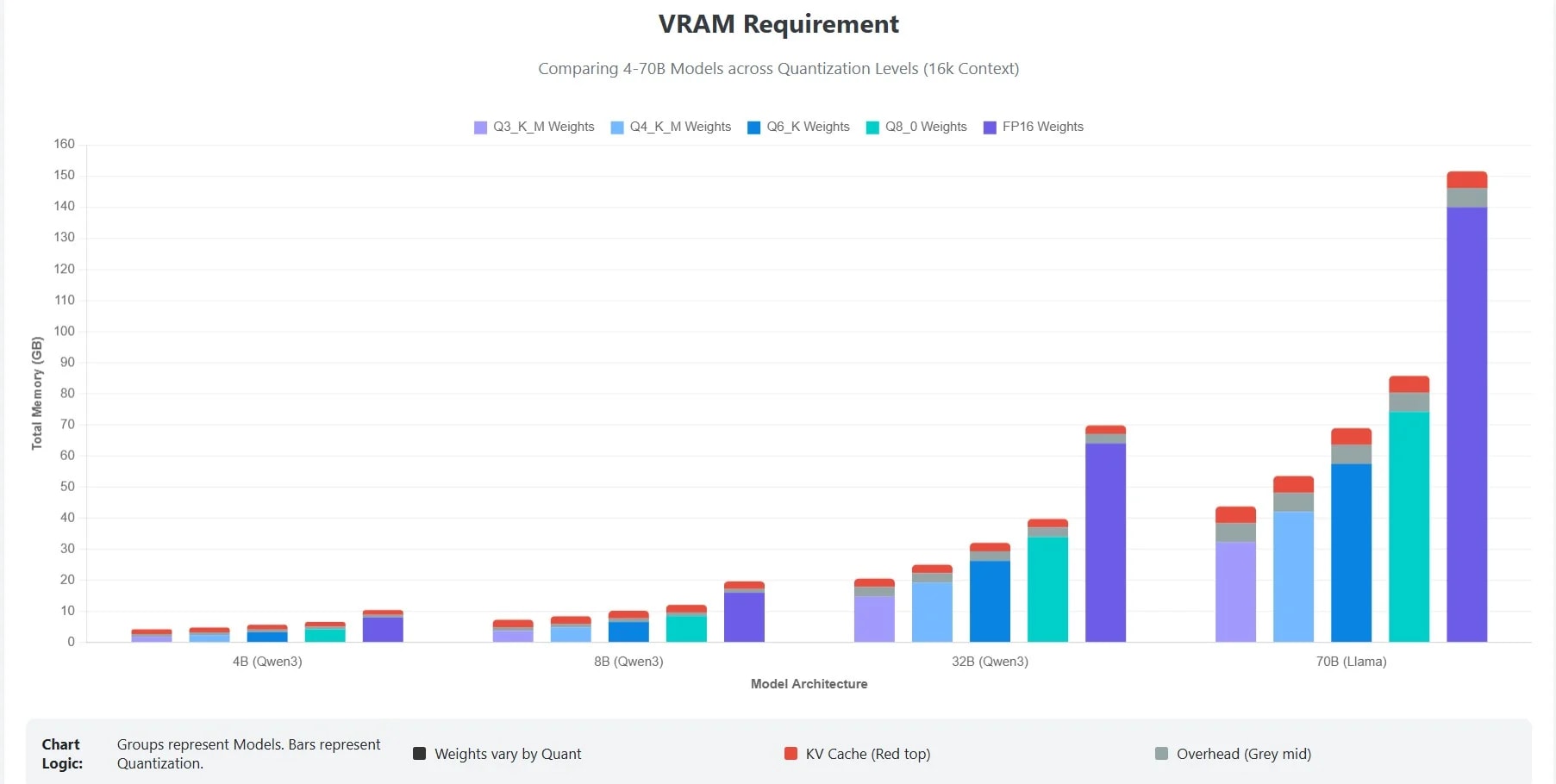

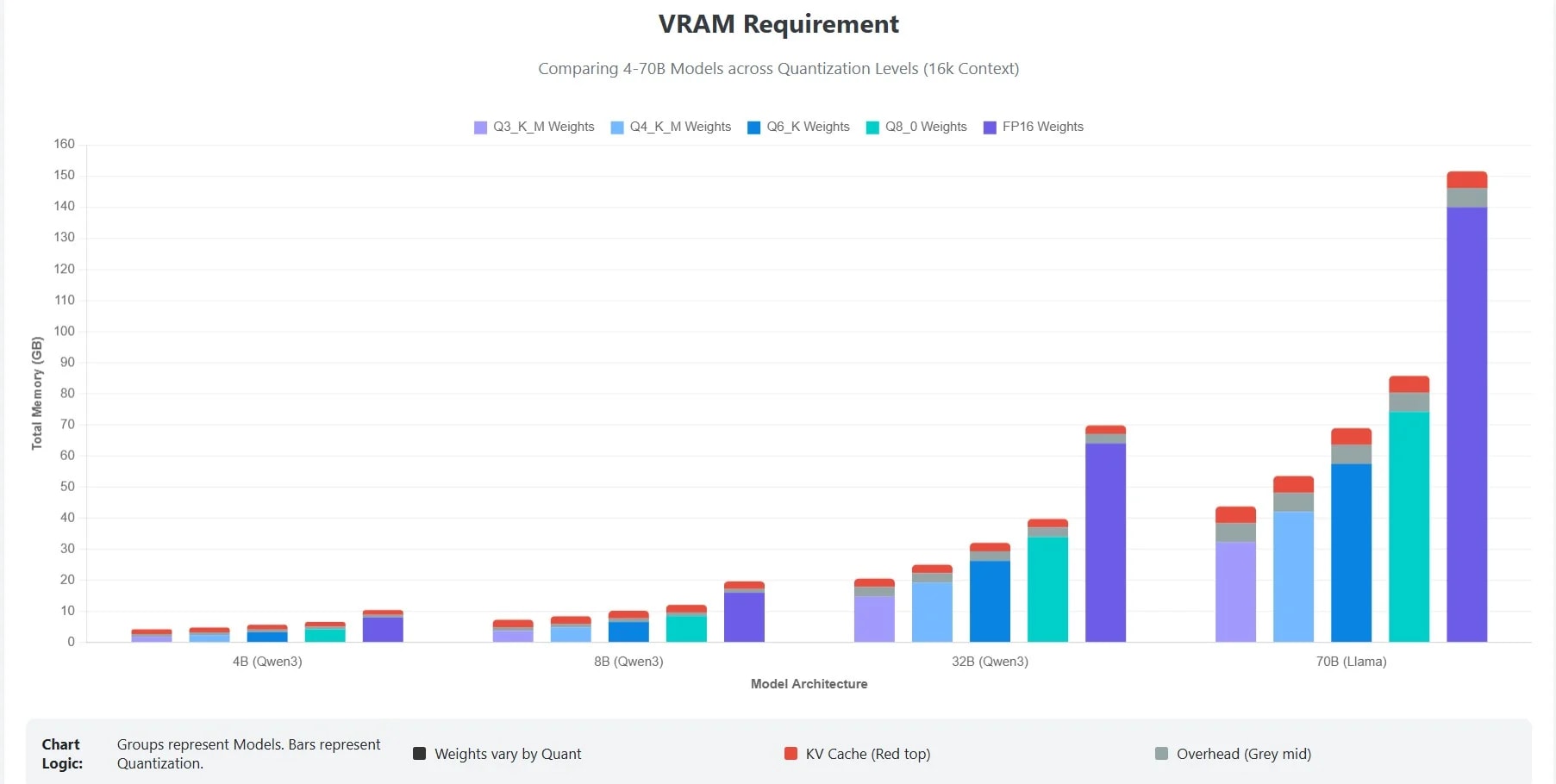

За даними

LocalLLM.in,

модель 7B параметрів у квантизації Q4_K_M займає приблизно 4–5 ГБ,

плюс 1–2 ГБ на KV-кеш і системний overhead.

Це означає: 7B-модель на 8 ГБ — можливо, але на межі, і краще закрити

все зайве.

Практичне правило для 8 ГБ:

- ✔️ Комфортна зона: моделі 1–3B параметрів (Q4_K_M) — залишається простір для IDE та браузера

- ✔️ Робоча зона: моделі 7–8B параметрів (Q4_K_M) — потрібно закрити все зайве

- ❌ Червона зона: моделі 13B+ — гарантовані зависання або swap на диск

Висновок: Перед вибором моделі закрий браузер, перевір

ollama ps і подивись реальний залишок пам'яті.

На 8 ГБ кожен гігабайт на вагу золота.

🎯 Для коду: яка модель замінить Copilot на 8 ГБ

Автодоповнення коду

Для автодоповнення коду на 8 ГБ найкращий вибір — Qwen 2.5 Coder 3B або

Phi-4 Mini (3.8B) у квантизації Q4_K_M. Обидві моделі залишають достатньо

пам'яті для VS Code і дають прийнятну якість генерації.

GitHub Copilot коштує $10/місяць. Локальна модель для коду —

$0/місяць і працює офлайн. Питання лише в тому, яка модель

потягне на твоєму залізі.

Кодинг — задача, де навіть маленькі моделі можуть бути корисними.

Автодоповнення, генерація функцій, пояснення коду, написання тестів —

для цього не потрібна GPT-4, потрібна швидка і точна модель,

яка розуміє синтаксис.

Топ моделей для коду на 8 ГБ

1. Qwen 2.5 Coder 3B (Q4_K_M) — ~2.2 ГБ RAM

За даними

SitePoint,

Qwen лідирує на бенчмарку HumanEval серед моделей 7–8B класу.

Версія 3B — полегшена, але зберігає сильну спеціалізацію на коді.

Навчена на великому обсязі програмного коду і технічної документації.

ollama pull qwen2.5-coder:3b

ollama run qwen2.5-coder:3b "Напиши функцію сортування масиву на Python"

2. Phi-4 Mini (3.8B) — ~2.3 ГБ RAM

За даними

SitePoint,

Phi-4 Mini — єдина модель, яка комфортно працює на системах з 8 ГБ,

видаючи 15–20 токенів/сек на M1 MacBook Air або бюджетному Linux-ноутбуці.

Добре справляється з автодоповненням, простими поясненнями та легкими чат-задачами.

ollama pull phi4-mini

ollama run phi4-mini "Поясни різницю між HashMap і TreeMap у Java"

3. DeepSeek Coder 1.3B (Q4_K_M) — ~1 ГБ RAM

Найлегша модель для коду. Ідеальна для автодоповнення в IDE —

швидка, не навантажує систему, можна тримати запущеною у фоні разом

з VS Code, браузером і терміналом.

ollama pull deepseek-coder:1.3b

ollama run deepseek-coder:1.3b

Що обрати?

- ✔️ Потрібне автодоповнення у фоні + відкритий браузер → DeepSeek Coder 1.3B

- ✔️ Потрібна генерація функцій і пояснення коду → Qwen 2.5 Coder 3B

- ✔️ Потрібна універсальна модель для коду і тексту → Phi-4 Mini

Детальніше про налаштування автодоповнення —

у статті Ollama + VS Code: безкоштовна альтернатива GitHub Copilot.

Висновок: На 8 ГБ можна кодити з локальним AI.

Не чекай якості GPT-4 — але для щоденного автодоповнення, генерації

бойлерплейту і пояснень коду цього достатньо.

🎯 Для тексту і спілкування: чат, резюме, переклад

Для текстових задач

Для текстових задач на 8 ГБ оптимальний вибір — Llama 3.2 3B для загального

чату, Gemma 2B для максимальної швидкості, або Phi-3 Mini для балансу

якості і розміру. Всі три залишають місце для іншого софту.

Не кожна задача вимагає GPT-4. Резюмувати текст,

відповісти на питання, переказати статтю — з цим справляється

модель, яка важить менше ніж один фільм у 4K.

Текстові задачі — найширша категорія: від простого чату до аналізу

документів і перекладу. На 8 ГБ тут є з чого обирати.

Топ моделей для тексту на 8 ГБ

1. Llama 3.2 3B (Q4_K_M) — ~2 ГБ RAM

За даними

StudyHUB,

Llama 3.1/3.2 — найпопулярніша модель на Ollama з понад 111 мільйонами

завантажень. Версія 3B — полегшена, але зберігає якість у загальних

розмовах, резюмуванні і відповідях на питання. Підтримує 8 мов.

ollama pull llama3.2:3b

ollama run llama3.2:3b "Перекажи основну думку цього тексту: ..."

2. Gemma 2B (Q4_K_M) — ~1.6 ГБ RAM

Модель від Google DeepMind. Найшвидша у цій категорії — ідеальна,

коли потрібна миттєва відповідь і мінімальне навантаження на систему.

Якість нижча за Llama 3B, але для простих питань і класифікації

тексту — більш ніж достатньо.

ollama pull gemma:2b

ollama run gemma:2b "Склади короткий опис для цього товару: ..."

3. Phi-3 Mini (3.8B) — ~2.3 ГБ RAM

За даними

StudyHUB,

Phi-3 Mini при вазі 2.3 ГБ покриває 90% щоденних задач.

Працює швидко навіть на CPU і підходить для Raspberry Pi 4/5.

ollama pull phi3:mini

ollama run phi3:mini "Переклади українською: The quick brown fox jumps over the lazy dog"

Що обрати?

- ✔️ Загальний чат і питання-відповіді → Llama 3.2 3B

- ✔️ Максимальна швидкість, мінімум RAM → Gemma 2B

- ✔️ Баланс якості і розміру, щоденне використання → Phi-3 Mini

Якщо хочеш красивий графічний інтерфейс замість терміналу —

дивись статтю Ollama + Open WebUI: локальний ChatGPT у браузері.

Висновок: Для текстових задач 8 ГБ — комфортна

територія. Моделі 2–3B працюють швидко, залишають простір для інших

програм і дають якість, достатню для більшості щоденних потреб.

🎯 Для reasoning: математика, логіка, дебаг коду

Для задач, що вимагають покрокового мислення — математика, логічні задачі,

дебаг складного коду — на 8 ГБ працює DeepSeek R1 8B у квантизації Q4.

Це «думаюча» модель: вона повільніша, але точніша на складних питаннях.

Звичайна модель відповідає одразу. Reasoning-модель

спочатку думає — крок за кроком — а потім відповідає.

Як різниця між «відповісти навмання» і «порахувати на папері».

Reasoning-моделі — відносно нова категорія. Вони працюють за принципом

chain-of-thought: розбивають задачу на кроки, перевіряють проміжні

результати, і лише потім формують фінальну відповідь.

Що працює на 8 ГБ

1. DeepSeek R1 8B (Q4_K_M) — ~5 ГБ RAM

За даними

StudyHUB,

DeepSeek R1 — «думаюча» модель, аналог OpenAI o1. На задачах з математикою,

логічними пазлами і технічним reasoning дає результати кращі за Llama 3.1

того ж розміру. Компроміс: відповідає повільніше, бо «думає» перед відповіддю.

ollama pull deepseek-r1:8b

ollama run deepseek-r1:8b "Знайди помилку у цьому SQL-запиті: SELECT * FROM users WHERE id = '5' AND active = true GROUP HAVING count > 1"

⚠️ Важливо: DeepSeek R1 8B займає ~5 ГБ RAM.

На системі з 8 ГБ це на межі — потрібно закрити браузер, IDE і все

зайве. На macOS з unified memory працює стабільніше, ніж на Windows

з інтегрованою графікою.

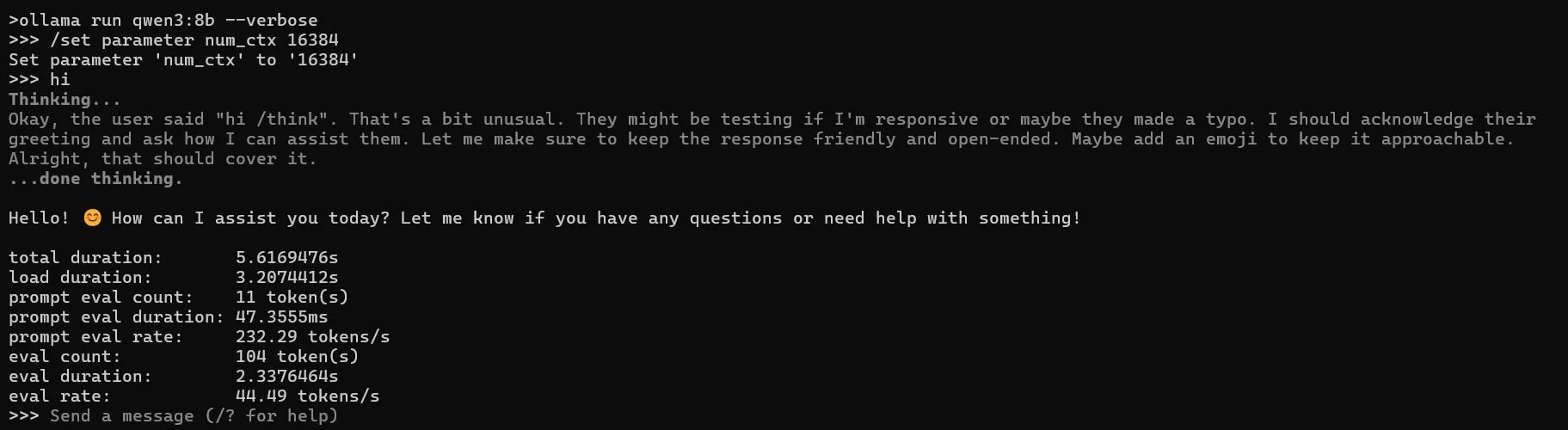

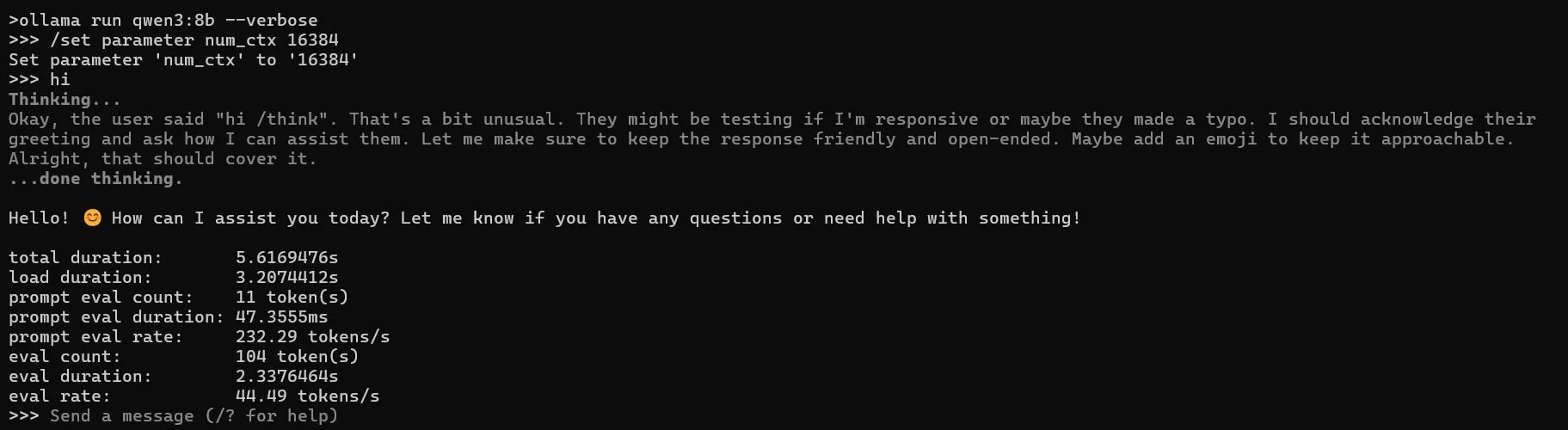

2. Qwen 3 8B (Q4_K_M) — ~5 ГБ RAM

За даними

LocalLLM.in,

Qwen 3 8B — сильна альтернатива для reasoning-задач, особливо у математиці

і мультимовних сценаріях. Підтримує режим thinking в Ollama за замовчуванням.

ollama pull qwen3:8b

ollama run qwen3:8b "Розв'яжи: якщо 3x + 7 = 22, чому дорівнює x?"

Що обрати?

- ✔️ Дебаг коду і логічні задачі → DeepSeek R1 8B

- ✔️ Математика і мультимовний reasoning → Qwen 3 8B

- ✔️ Якщо 8B не влазить — Phi-4 Mini як компроміс (менша, але без chain-of-thought)

Висновок: Reasoning на 8 ГБ — можливо, але це межа

комфорту. 8B-моделі потребують майже всю доступну пам'ять. Для регулярної

роботи з такими задачами варто розглянути апгрейд до 16 ГБ —

різниця у можливостях буде суттєвою.

🎯 CPU vs GPU vs Apple Silicon — де 8 ГБ це різні 8 ГБ

8 ГБ на Mac M1 і 8 ГБ на Windows-ноутбуці з Intel — це два різних досвіди.

Apple Silicon використовує unified memory, де вся пам'ять доступна і CPU,

і GPU одночасно. На звичайному ПК RAM і VRAM — окремі пули,

і для AI-моделей це критично.

Mac M1 з 8 ГБ — це повноцінна робоча станція для локального AI.

Windows-ноутбук з 8 ГБ і Intel HD Graphics — це боротьба за кожен мегабайт.

Apple Silicon (M1/M2/M3) — найкращий сценарій для 8 ГБ

На Apple Silicon вся оперативна пам'ять — unified memory.

Це означає, що GPU-частина чіпа має доступ до тих самих 8 ГБ,

що і CPU. Ollama автоматично використовує Metal для прискорення —

без додаткових налаштувань.

Результат: 7B-модель у Q4_K_M на M1 з 8 ГБ видає 15–20 токенів/сек —

достатньо для комфортного інтерактивного використання.

За даними

SitePoint,

Phi-4 Mini на M1 MacBook Air — це приблизно 15–20 tok/s, що достатньо

для щоденної роботи.

Windows / Linux з дискретним GPU (RTX 3060, RTX 4060) — хороший сценарій

Якщо є дискретна відеокарта з 6–8 ГБ VRAM — модель повністю

завантажується в GPU-пам'ять, і системна RAM залишається для ОС і софту.

За даними

LocalLLM.in,

на RTX 4060 (8 ГБ VRAM) 7B-модель видає 40+ токенів/сек —

найшвидший варіант із усіх.

Windows / Linux без GPU (Intel HD / AMD Radeon iGPU) — складний сценарій

Без дискретного GPU модель працює повністю на CPU. Олама все одно

запуститься — але швидкість падає до 3–6 токенів/сек.

За даними

LocalLLM.in,

CPU-only inference прийнятний для пакетних задач, але фруструє

при інтерактивному використанні.

Плюс системна RAM ділиться між ОС, софтом і моделлю — на 8 ГБ

це дуже тісно.

Зведена таблиця

| Платформа |

7B модель (Q4) |

3B модель (Q4) |

Швидкість |

Комфорт |

| Mac M1/M2 8 ГБ |

✔️ Працює |

✔️ Комфортно |

15–20 tok/s |

⭐⭐⭐⭐ |

| Windows + RTX 4060 8 ГБ VRAM |

✔️ Працює швидко |

✔️ Комфортно |

40+ tok/s |

⭐⭐⭐⭐⭐ |

| Windows/Linux CPU only 8 ГБ |

⚠️ На межі |

✔️ Працює |

3–6 tok/s |

⭐⭐ |

Висновок: Якщо у тебе Mac M1+ з 8 ГБ — ти у

найкращій позиції для локального AI на бюджетному залізі. Якщо Windows

без GPU — фокусуйся на 3B-моделях і закривай все зайве.

Детальніше про встановлення на різних ОС —

у статті Як встановити Ollama на Mac, Windows і Linux.

🎯 Квантизація простими словами: Q4 vs Q8 і що обрати на слабкому залізі

Коротка відповідь:

Квантизація — це стиснення моделі, яке зменшує її розмір у 2–4 рази

з мінімальною втратою якості. На 8 ГБ оптимальний вибір — Q4_K_M:

найкращий баланс між розміром, швидкістю і якістю відповідей.

Квантизація — це як JPEG для фото. Файл менший,

різниця майже непомітна. Але якщо стиснути занадто сильно —

якість помітно впаде.

Коли ти бачиш у назві моделі на Ollama теги типу :7b-q4_0,

:8b-instruct-q8_0 або :3b-q4_k_m — це позначення

рівня квантизації. Число після «q» — кількість біт на один параметр.

Рівні квантизації: що означають теги

- ✔️ Q8 (8-біт): максимальна якість, найбільший розмір. Для 7B-моделі — ~8 ГБ. На 8 ГБ RAM не влізе.

- ✔️ Q4_K_M (4-біт, K-quant medium): оптимальний баланс. Для 7B — ~4–5 ГБ. Рекомендований для 8 ГБ систем.

- ✔️ Q4_K_S (4-біт, K-quant small): трохи менший за Q4_K_M, трохи нижча якість.

- ⚠️ Q2_K (2-біт): мінімальний розмір (~2.5 ГБ для 7B), але помітна деградація якості. Крайній варіант.

Суфікс «K» означає новіші методи квантизації (K-quant), які розумніше

розподіляють точність між шарами моделі. K-quant-теги завжди кращі за

legacy-варіанти (q4_0, q4_1) при тому самому розмірі.

Скільки важать моделі різних квантизацій

| Модель |

Q8 |

Q4_K_M |

Q2_K |

| Phi-3 Mini (3.8B) |

4.0 ГБ |

2.3 ГБ |

1.2 ГБ |

| Llama 3.2 (7B) |

~8 ГБ |

~4.5 ГБ |

~2.6 ГБ |

| Mistral 7B |

~8 ГБ |

~4.1 ГБ |

~2.8 ГБ |

Дані за

LocalAIMaster.

Правило для 8 ГБ: завжди обирай Q4_K_M. Якщо не влазить — знижуй

розмір моделі (3B замість 7B), а не рівень квантизації (Q2 замість Q4).

Менша модель з Q4 дасть кращу якість, ніж більша з Q2.

Детальніше про техніки стиснення і їхній вплив на якість —

у статті Квантизація моделей: INT4, INT8 — що це і як впливає на якість.

Висновок: Q4_K_M — золотий стандарт для 8 ГБ. Не піддавайся

спокусі завантажити Q8 «для якості» — модель не влізе в пам'ять,

і ти отримаєш swap на диск замість швидких відповідей.

🎯 Налаштування Ollama для максимуму на слабкому залізі

Три змінні середовища і одна звичка (закривати зайве) — це все,

що потрібно, щоб вичавити максимум із 8 ГБ. Налаштування займає

хвилину, а різниця у стабільності — відчутна.

На потужному залізі Ollama «просто працює».

На слабкому — потрібно допомогти їй не витрачати пам'ять на те,

що тобі не потрібно.

За замовчуванням Ollama може тримати в пам'яті кілька моделей

одночасно і обробляти паралельні запити. На 8 ГБ це зайва розкіш.

Ось мінімальний набір оптимізацій:

Змінні середовища

# Тримати в пам'яті лише одну модель (за замовчуванням може бути більше)

export OLLAMA_MAX_LOADED_MODELS=1

# Один паралельний запит (без конкуренції за пам'ять)

export OLLAMA_NUM_PARALLEL=1

# Зменшити вікно контексту — економить 200–800 МБ RAM

export OLLAMA_CTX_SIZE=2048

На macOS / Linux додай ці рядки у ~/.zshrc або

~/.bashrc. На Windows — задай через системні змінні

середовища або PowerShell-профіль.

Перед запуском моделі

Звучить банально, але на 8 ГБ це критично:

- ✔️ Закрий браузер або залиш максимум 2–3 вкладки

- ✔️ Закрий Slack, Discord, Spotify — кожна програма з'їдає 200–500 МБ

- ✔️ Перевір поточне використання:

ollama ps покаже завантажені моделі

- ✔️ Якщо стара модель ще в пам'яті —

ollama stop назва_моделі

Modelfile для тонкого налаштування

Якщо хочеш більше контролю — створи Modelfile з оптимізованими параметрами:

FROM phi3:mini

PARAMETER num_ctx 2048

PARAMETER num_thread 4

PARAMETER temperature 0.7

num_ctx 2048 — зменшує вікно контексту (менше RAM на KV-кеш).

num_thread 4 — обмежує кількість потоків CPU, щоб система

залишалася відзивчивою.

Покроковий гайд по встановленню і першому запуску —

у статті Як встановити Ollama на Mac, Windows і Linux: повний гайд 2026.

А про створення кастомних моделей через Modelfile —

у статті Modelfile в Ollama: створи свого кастомного AI.

Висновок: Три змінні середовища + закриті зайві програми =

стабільна робота на 8 ГБ. Без цих налаштувань навіть легка модель

може спричинити swap на диск.

🎯 Що НЕ варто пробувати на 8 ГБ — мій досвід

Коротка відповідь:

Моделі 13B+, будь-які моделі у Q8-квантизації, і спроби запустити

дві моделі одночасно — гарантоване розчарування на 8 ГБ.

Я перевірив це на своєму Mac M1 — щоб вам не довелося.

Кожен, хто працював з Ollama на 8 ГБ, проходив через один

і той самий етап: «А може 13B всe-таки влізе?» Ні, не влізе.

Я перевірив.

Працюючи з Ollama на Mac M1 з 8 ГБ unified memory, я тестував

десятки моделей різних розмірів. Ось чесний список того,

що не працює — або працює настільки погано, що краще б не працювало.

❌ Моделі 13B і більше

Llama 2 13B, Qwen 14B, CodeLlama 13B — навіть у Q4-квантизації

вони потребують 8–9 ГБ лише на ваги моделі. Додай KV-кеш, ОС,

і ти отримаєш систему, яка безперервно свопить на диск.

Я спробував запустити Llama 2 13B Q4 — перші 5 хвилин вона завантажувалася,

потім видавала 1–2 токени на секунду з постійними паузами.

Це непрацездатно для інтерактивного використання.

❌ Будь-яка 7B-модель у Q8-квантизації

Q8-версія 7B-моделі важить близько 8 ГБ — це вся твоя оперативна

пам'ять. ОС не зникає магічно. Я пробував Mistral 7B Q8 —

система зависла через хвилину після старту. Завжди використовуй Q4_K_M

для 7B-моделей на 8 ГБ.

❌ Дві моделі одночасно

Ollama може тримати кілька моделей у пам'яті. На 16 ГБ це зручно —

переключаєшся між моделями миттєво. На 8 ГБ це рецепт для swap-шторму.

Тримай OLLAMA_MAX_LOADED_MODELS=1 і не забувай

ollama stop перед завантаженням іншої моделі.

❌ Великі контекстні вікна (8K+ токенів)

Кожне подвоєння контекстного вікна — це додаткові сотні мегабайт

на KV-кеш. На 8 ГБ тримай контекст на 2048–4096 токенів максимум.

Передати модель 10-сторінковий документ цілком — не вийде,

потрібно розбивати на частини.

❌ Mixtral 8x7B (MoE-архітектура)

Mixtral активує лише 2 з 8 «експертів» на кожен токен,

тому теоретично використовує менше обчислень. Але всі 8 експертів

мають бути в пам'яті — і це 26+ ГБ навіть у Q4.

Назва «8x7B» вводить в оману: це не модель розміром 7B.

Загальне правило: якщо ollama run

завантажується довше 30 секунд і перша відповідь приходить через

хвилину — модель занадто велика для твоєї системи. Не чекай, що

«розігріється» — закрий і візьми модель меншого розміру.

Порівняння моделей за розміром, якістю і задачами —

у статті Топ-10 моделей Ollama у 2026: яку вибрати.

Висновок: Я сам пройшов через це — думав, що більша

модель дасть кращий результат, скачав 13B, почекав хвилину на першу

відповідь і видалив. Встановив 3B — і продуктивність одразу зросла.

На 8 ГБ краща стратегія — обрати модель, яка працює швидко і стабільно,

ніж мучитися з тією, що «майже влазить».

🎯 Тести: що очікувати на практиці

Коротка відповідь:

На Mac M1 8 ГБ модель 3B видає 20–30 токенів/сек, модель 7B — 10–15 tok/s.

На CPU-only Windows — вдвічі-втричі повільніше.

Нижче — зведена таблиця для орієнтації.

Бенчмарки в інтернеті часто зроблені на чистій системі без

іншого софту. У реальності — з відкритим VS Code і 5 вкладками Chrome —

цифри будуть нижчі. Тому ці тести ближчі до реальності.

Зведена таблиця продуктивності

| Модель |

RAM |

Mac M1 8 ГБ |

CPU-only 8 ГБ |

RTX 4060 8 ГБ VRAM |

| Gemma 2B (Q4) |

~1.6 ГБ |

~30 tok/s |

~10 tok/s |

~50+ tok/s |

| Phi-3 Mini 3.8B (Q4) |

~2.3 ГБ |

~25 tok/s |

~8 tok/s |

~45 tok/s |

| Llama 3.2 3B (Q4) |

~2 ГБ |

~28 tok/s |

~9 tok/s |

~48 tok/s |

| Qwen 2.5 Coder 3B (Q4) |

~2.2 ГБ |

~25 tok/s |

~8 tok/s |

~45 tok/s |

| Llama 3.1 8B (Q4) |

~4.5 ГБ |

~12 tok/s |

~4 tok/s |

~40 tok/s |

| DeepSeek R1 8B (Q4) |

~5 ГБ |

~10 tok/s |

~3 tok/s |

~35 tok/s |

Дані орієнтовні, базовані на результатах

LocalLLM.in,

SitePoint

та LocalAIMaster.

Реальна швидкість залежить від навантаження системи, розміру контекстного вікна

та фонових процесів.

Що означають ці цифри на практиці?

- ✔️ 15+ tok/s: комфортний інтерактивний чат — відповідь з'являється швидше, ніж ти встигаєш прочитати

- ✔️ 8–15 tok/s: працювати можна, але відчувається затримка на довгих відповідях

- ⚠️ 3–6 tok/s: прийнятно для одноразових задач (дебаг, аналіз), фрустрація при активному чаті

- ❌ <3 tok/s: модель занадто велика для цієї системи

Висновок: Для щоденної роботи на 8 ГБ орієнтуйся

на 3B-моделі — вони дають 20+ tok/s на Apple Silicon і залишають

систему відзивчивою. 7–8B-моделі — для конкретних задач, коли

готовий закрити все зайве і почекати.

❓ Часті питання (FAQ)

Чи можна запустити Ollama на ноутбуці з 8 ГБ RAM?

Так. Моделі 1–3B параметрів (Phi-3 Mini, Llama 3.2 3B, Gemma 2B)

працюють комфортно на будь-якій системі з 8 ГБ. Моделі 7–8B

працюють на межі — потрібно закрити зайві програми.

Детальніше — у

гайді зі встановлення Ollama.

Яка найкраща модель для 8 ГБ RAM?

Залежить від задачі. Для коду — Qwen 2.5 Coder 3B.

Для тексту і чату — Llama 3.2 3B або Phi-3 Mini.

Для reasoning і дебагу — DeepSeek R1 8B (на межі 8 ГБ).

Повне порівняння моделей —

у статті Топ-10 моделей Ollama у 2026.

Чи потрібен GPU для Ollama?

Ні, Ollama працює і на CPU. Але з GPU (дискретним або Apple Silicon)

швидкість вища у 3–10 разів. На CPU-only системі з 8 ГБ

тримайся моделей 3B і менше для комфортної роботи.

Що краще: модель 7B у Q2 чи 3B у Q4?

Майже завжди — 3B у Q4. Агресивна квантизація (Q2) суттєво

знижує якість відповідей, особливо на складних задачах.

Менша модель з нормальною квантизацією дасть кращий результат.

Чи може Ollama на 8 ГБ замінити ChatGPT?

Для щоденних задач — резюмування, прості питання, генерація коду —

так. Для складного аналізу, мультимодальних задач і роботи з великим

контекстом — хмарні моделі поки сильніші.

Оптимальний підхід — гібридний:

Ollama для регулярних задач, ChatGPT/Claude для складних.

Детальніше —

у статті Ollama vs ChatGPT vs Claude: коли локальна AI краща.

Скільки місця на диску потрібно?

Одна 3B-модель у Q4 — приблизно 2 ГБ на диску. Три моделі для різних

задач — 6–8 ГБ. Ollama зберігає моделі у ~/.ollama,

завантажені моделі можна видалити командою ollama rm назва_моделі.

Чи варто апгрейдити до 16 ГБ?

Якщо плануєш регулярно працювати з локальним AI — однозначно так.

16 ГБ відкривають доступ до 13–14B моделей, повноцінних 7B у Q8-якості

і комфортної роботи з великими контекстними вікнами.

Різниця у можливостях між 8 і 16 ГБ — найбільша у всьому спектрі.

✅ Висновки

8 ГБ оперативної пам'яті — це не вирок для локального AI,

але це межа, яка вимагає усвідомлених рішень. Ось головне:

- ✔️ 3B-моделі — зона комфорту: Phi-3 Mini, Llama 3.2 3B, Gemma 2B працюють швидко і стабільно, залишаючи місце для IDE та браузера

- ✔️ 7–8B-моделі — робоча зона: DeepSeek R1 8B, Qwen 3 8B працюють на межі, але дають відчутно кращу якість для конкретних задач

- ✔️ Q4_K_M — єдиний розумний вибір квантизації на 8 ГБ: менша модель з Q4 завжди краща за більшу з Q2

- ✔️ Apple Silicon з 8 ГБ — найкращий бюджетний варіант: unified memory дає перевагу над CPU-only системами

- ✔️ 13B+ моделі, Q8, дві моделі одночасно — не варто: перевірено, не працює

Я сам використовую саме такий підхід: тримаю кілька моделей

під різні задачі — одну для коду, іншу для тексту, окрему для дебагу.

Кожна модель має свою сильну сторону, і замість однієї великої,

яка може не влізти в пам'ять, краще мати 2–3 спеціалізовані легкі.

Перемикатися між ними через ollama run — справа секунд.

Якщо тільки починаєш —

встанови Ollama за

нашим гайдом,

завантаж phi3:mini і спробуй.

Через п'ять хвилин у тебе буде працюючий локальний AI —

без підписок, без інтернету, без передачі даних назовні.

А якщо тобі потрібен сайт, блог або веб-застосунок з інтеграцією

AI-функціональності —

напиши нам у WebsCraft,

допоможемо реалізувати.

📖 Джерела