¿Tienes un portátil con 8 GB de RAM y quieres ejecutar IA localmente?

Este artículo es un análisis: qué funciona, qué apenas funciona,

y qué ni siquiera vale la pena descargar. Sin ilusiones, con modelos

y comandos concretos para cada tarea. Si aún no estás familiarizado con Ollama,

empieza por el artículo introductorio sobre qué es Ollama y por qué es necesaria.

📚 Contenido del artículo

🎯 Aritmética honesta: cuánta RAM queda realmente para el modelo

Respuesta corta:

Con 8 GB de RAM, realmente hay 4-5 GB disponibles para el modelo de IA.

El resto lo consume el sistema operativo, el navegador y los procesos básicos.

Esto determina la regla principal: con 8 GB, los modelos de hasta 3-7B

parámetros en cuantización de 4 bits funcionan cómodamente.

8 GB de RAM no son 8 GB para el modelo.

Son 8 GB menos el SO, menos Chrome, menos todo lo que olvidaste cerrar.

Antes de elegir un modelo, necesitas entender el presupuesto real de memoria.

Aquí tienes una distribución típica en un sistema con 8 GB de RAM:

- ✔️ Sistema operativo: 1.5–2.5 GB (macOS más cerca de 2.5, Windows — 2, Linux — 1.5)

- ✔️ Navegador (5–10 pestañas): 1–2 GB

- ✔️ IDE (VS Code / IntelliJ): 0.5–1.5 GB

- ✔️ Procesos en segundo plano: 0.3–0.5 GB

Resto para el modelo: 3–5 GB.

Según

LocalLLM.in,

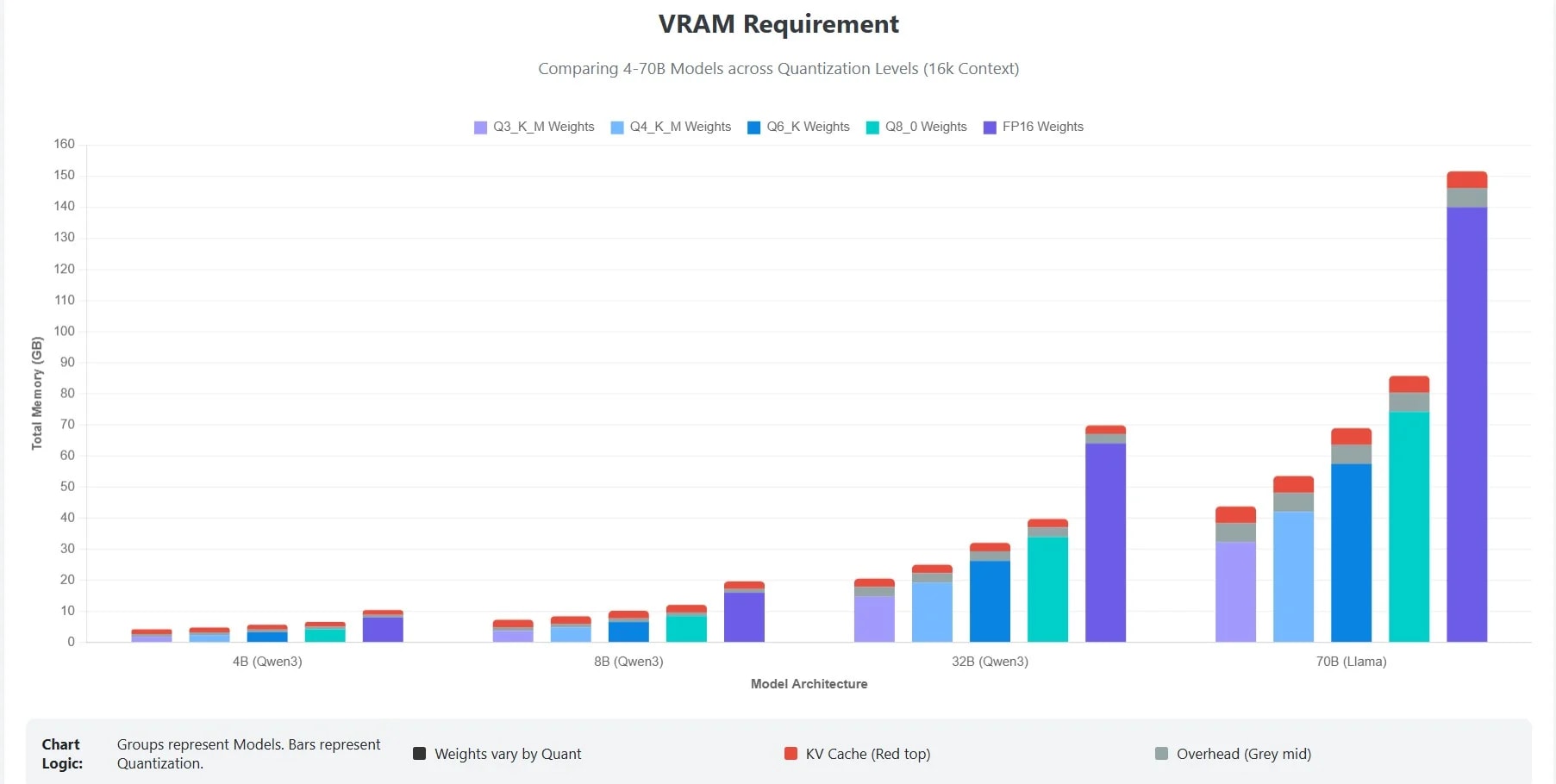

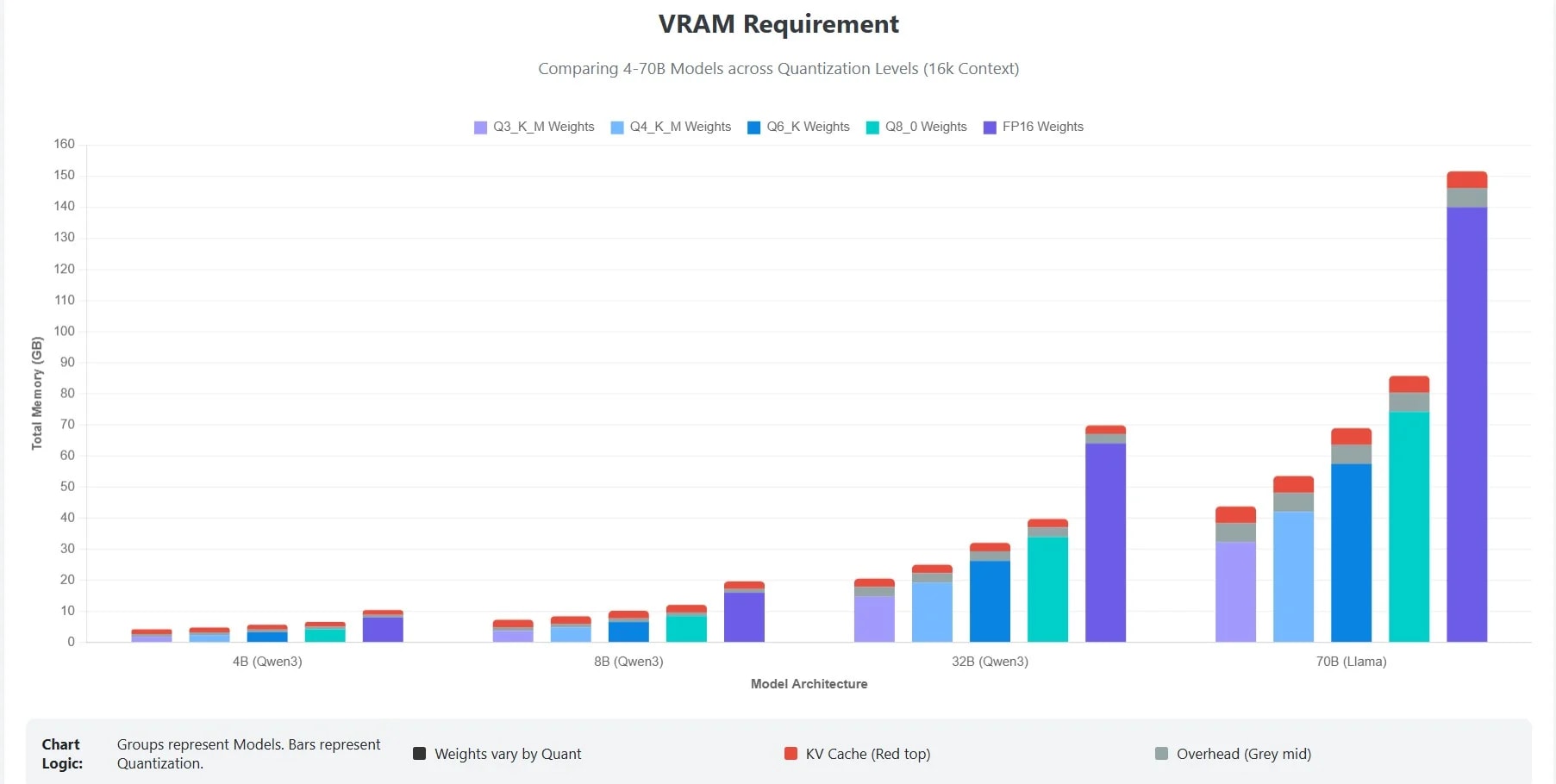

un modelo de 7B parámetros en cuantización Q4_K_M ocupa aproximadamente 4–5 GB,

más 1–2 GB para el caché KV y la sobrecarga del sistema.

Esto significa: un modelo de 7B con 8 GB es posible, pero al límite, y es mejor cerrar

todo lo innecesario.

Regla práctica para 8 GB:

- ✔️ Zona de confort: modelos de 1–3B parámetros (Q4_K_M) — queda espacio para IDE y navegador

- ✔️ Zona de trabajo: modelos de 7–8B parámetros (Q4_K_M) — es necesario cerrar todo lo innecesario

- ❌ Zona roja: modelos de 13B+ — bloqueos garantizados o intercambio en disco

Conclusión: Antes de elegir un modelo, cierra el navegador, verifica

ollama ps y mira la memoria restante real.

Con 8 GB, cada gigabyte vale oro.

🎯 Para código: qué modelo reemplazará a Copilot con 8 GB

Autocompletado de código

Para autocompletar código con 8 GB, la mejor opción es Qwen 2.5 Coder 3B o

Phi-4 Mini (3.8B) en cuantización Q4_K_M. Ambos modelos dejan suficiente

memoria para VS Code y ofrecen una calidad de generación aceptable.

GitHub Copilot cuesta $10/mes. Un modelo local para código cuesta

$0/mes y funciona sin conexión. La única pregunta es qué modelo

funcionará en tu hardware.

Codificar es una tarea donde incluso los modelos pequeños pueden ser útiles.

Autocompletado, generación de funciones, explicación de código, escritura de pruebas —

para esto no necesitas GPT-4, necesitas un modelo rápido y preciso

que entienda la sintaxis.

Mejores modelos para código con 8 GB

1. Qwen 2.5 Coder 3B (Q4_K_M) — ~2.2 GB RAM

Según

SitePoint,

Qwen lidera el benchmark HumanEval entre los modelos de la clase 7–8B.

La versión 3B es más ligera, pero mantiene una fuerte especialización en código.

Entrenada con una gran cantidad de código de programación y documentación técnica.

ollama pull qwen2.5-coder:3b

ollama run qwen2.5-coder:3b "Escribe una función de ordenación de arrays en Python"

2. Phi-4 Mini (3.8B) — ~2.3 GB RAM

Según

SitePoint,

Phi-4 Mini es el único modelo que funciona cómodamente en sistemas con 8 GB,

produciendo 15-20 tokens/seg en un MacBook Air M1 o un portátil Linux económico.

Funciona bien con autocompletado, explicaciones sencillas y tareas de chat ligeras.

ollama pull phi4-mini

ollama run phi4-mini "Explica la diferencia entre HashMap y TreeMap en Java"

3. DeepSeek Coder 1.3B (Q4_K_M) — ~1 GB RAM

El modelo más ligero para código. Ideal para autocompletado en IDE —

rápido, no sobrecarga el sistema, se puede mantener ejecutándose en segundo plano junto con

VS Code, el navegador y la terminal.

ollama pull deepseek-coder:1.3b

ollama run deepseek-coder:1.3b

¿Qué elegir?

- ✔️ Necesitas autocompletado en segundo plano + navegador abierto → DeepSeek Coder 1.3B

- ✔️ Necesitas generación de funciones y explicación de código → Qwen 2.5 Coder 3B

- ✔️ Necesitas un modelo universal para código y texto → Phi-4 Mini

Más detalles sobre la configuración del autocompletado —

en el artículo Ollama + VS Code: una alternativa gratuita a GitHub Copilot.

Conclusión: Con 8 GB puedes codificar con IA local.

No esperes la calidad de GPT-4, pero para el autocompletado diario, la generación

de código repetitivo y las explicaciones de código, esto es suficiente.

🎯 Para texto y comunicación: chat, resumen, traducción

Para tareas de texto

Para tareas de texto con 8 GB, la opción óptima es Llama 3.2 3B para chat general,

Gemma 2B para máxima velocidad, o Phi-3 Mini para un equilibrio entre calidad y tamaño.

Los tres dejan espacio para otro software.

No todas las tareas requieren GPT-4. Resumir texto,

responder preguntas, parafrasear un artículo — con esto se las arregla

un modelo que pesa menos que una película en 4K.

Las tareas de texto son la categoría más amplia: desde chat simple hasta análisis

de documentos y traducción. Con 8 GB, hay opciones para elegir.

Mejores modelos para texto con 8 GB

1. Llama 3.2 3B (Q4_K_M) — ~2 GB RAM

Según

StudyHUB,

Llama 3.1/3.2 es el modelo más popular en Ollama con más de 111 millones

de descargas. La versión 3B es más ligera, pero mantiene la calidad en conversaciones generales,

resúmenes y respuestas a preguntas. Soporta 8 idiomas.

ollama pull llama3.2:3b

ollama run llama3.2:3b "Resume la idea principal de este texto: ..."

2. Gemma 2B (Q4_K_M) — ~1.6 GB RAM

Un modelo de Google DeepMind. El más rápido en esta categoría — ideal

cuando se necesita una respuesta instantánea y una carga mínima en el sistema.

La calidad es inferior a Llama 3B, pero para preguntas simples y clasificación

de texto es más que suficiente.

ollama pull gemma:2b

ollama run gemma:2b "Crea una breve descripción para este producto: ..."

3. Phi-3 Mini (3.8B) — ~2.3 GB RAM

Según

StudyHUB,

Phi-3 Mini, con un peso de 2.3 GB, cubre el 90% de las tareas diarias.

Funciona rápido incluso en CPU y es adecuado para Raspberry Pi 4/5.

ollama pull phi3:mini

ollama run phi3:mini "Traduce al español: The quick brown fox jumps over the lazy dog"

¿Qué elegir?

- ✔️ Chat general y preguntas-respuestas → Llama 3.2 3B

- ✔️ Máxima velocidad, mínima RAM → Gemma 2B

- ✔️ Equilibrio entre calidad y tamaño, uso diario → Phi-3 Mini

Si quieres una interfaz gráfica bonita en lugar de la terminal —

mira el artículo Ollama + Open WebUI: ChatGPT local en el navegador.

Conclusión: Para tareas de texto, 8 GB es un territorio

cómodo. Los modelos 2-3B funcionan rápido, dejan espacio para otros

programas y ofrecen una calidad suficiente para la mayoría de las necesidades diarias.

🎯 Para razonamiento: matemáticas, lógica, depuración de código

Para tareas que requieren pensamiento paso a paso — matemáticas, problemas lógicos,

depuración de código complejo — con 8 GB funciona DeepSeek R1 8B en cuantización Q4.

Es un modelo "pensante": es más lento, pero más preciso en preguntas complejas.

Un modelo normal responde de inmediato. Un modelo de razonamiento

primero piensa — paso a paso — y luego responde.

Es como la diferencia entre "responder al azar" y "calcular en papel".

Los modelos de razonamiento son una categoría relativamente nueva. Funcionan según el principio

de cadena de pensamiento: dividen la tarea en pasos, verifican los resultados intermedios,

y solo entonces forman la respuesta final.

Qué funciona con 8 GB

1. DeepSeek R1 8B (Q4_K_M) — ~5 GB RAM

Según

StudyHUB,

DeepSeek R1 es un modelo "pensante", análogo a OpenAI o1. En tareas de matemáticas,

rompecabezas lógicos y razonamiento técnico, ofrece mejores resultados que Llama 3.1

del mismo tamaño. Compromiso: responde más lentamente porque "piensa" antes de responder.

ollama pull deepseek-r1:8b

ollama run deepseek-r1:8b "Encuentra el error en esta consulta SQL: SELECT * FROM users WHERE id = '5' AND active = true GROUP HAVING count > 1"

⚠️ Importante: DeepSeek R1 8B ocupa ~5 GB de RAM.

En un sistema con 8 GB, esto está al límite — es necesario cerrar el navegador, el IDE y todo

lo innecesario. En macOS con memoria unificada funciona de manera más estable que en Windows

con gráficos integrados.

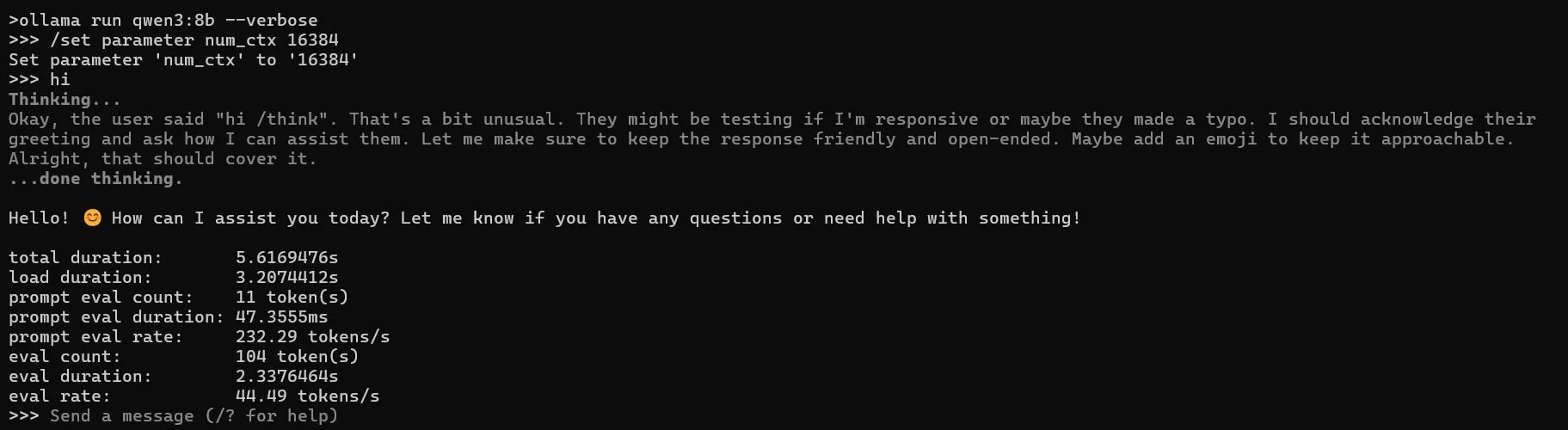

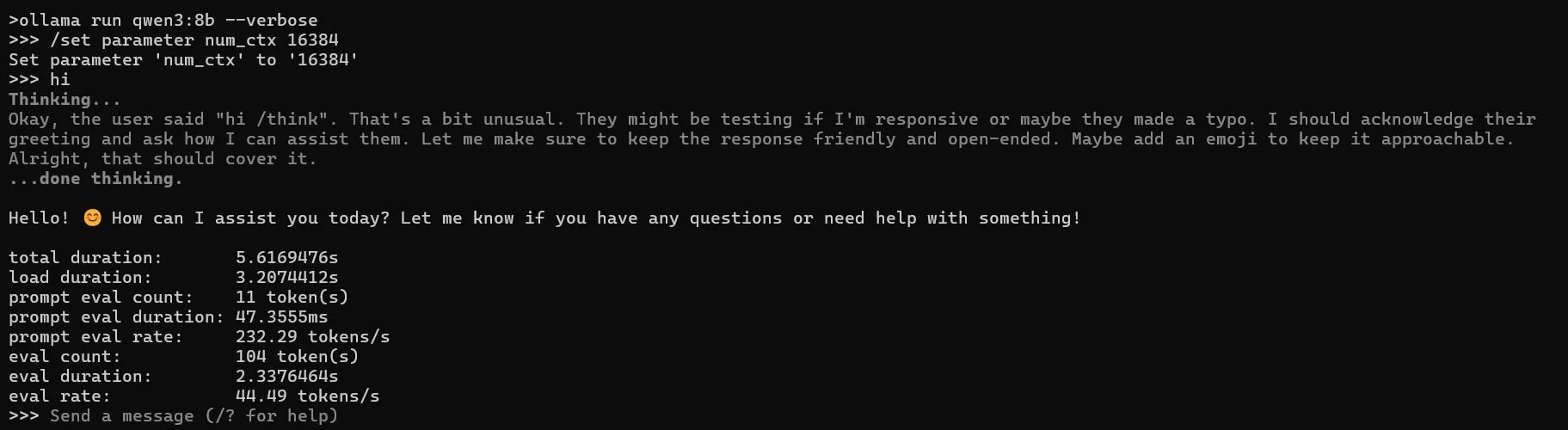

2. Qwen 3 8B (Q4_K_M) — ~5 GB RAM

Según

LocalLLM.in,

Qwen 3 8B es una alternativa sólida para tareas de razonamiento, especialmente en matemáticas

y escenarios multilingües. Soporta el modo de pensamiento en Ollama por defecto.

ollama pull qwen3:8b

ollama run qwen3:8b "Resuelve: si 3x + 7 = 22, ¿cuánto vale x?"

¿Qué elegir?

- ✔️ Depuración de código y problemas lógicos → DeepSeek R1 8B

- ✔️ Matemáticas y razonamiento multilingüe → Qwen 3 8B

- ✔️ Si 8B no cabe — Phi-4 Mini como compromiso (más pequeño, pero sin cadena de pensamiento)

Conclusión: El razonamiento con 8 GB es posible, pero está en el límite

de la comodidad. Los modelos de 8B requieren casi toda la memoria disponible. Para un trabajo regular

con estas tareas, vale la pena considerar una actualización a 16 GB —

la diferencia en capacidades será sustancial.

🎯 CPU vs GPU vs Apple Silicon — де 8 ГБ це різні 8 ГБ

8 ГБ на Mac M1 і 8 ГБ на Windows-ноутбуці з Intel — це два різних досвіди.

Apple Silicon використовує unified memory, де вся пам'ять доступна і CPU,

і GPU одночасно. На звичайному ПК RAM і VRAM — окремі пули,

і для AI-моделей це критично.

Mac M1 з 8 ГБ — це повноцінна робоча станція для локального AI.

Windows-ноутбук з 8 ГБ і Intel HD Graphics — це боротьба за кожен мегабайт.

Apple Silicon (M1/M2/M3) — найкращий сценарій для 8 ГБ

На Apple Silicon вся оперативна пам'ять — unified memory.

Це означає, що GPU-частина чіпа має доступ до тих самих 8 ГБ,

що і CPU. Ollama автоматично використовує Metal для прискорення —

без додаткових налаштувань.

Результат: 7B-модель у Q4_K_M на M1 з 8 ГБ видає 15–20 токенів/сек —

достатньо для комфортного інтерактивного використання.

За даними

SitePoint,

Phi-4 Mini на M1 MacBook Air — це приблизно 15–20 tok/s, що достатньо

для щоденної роботи.

Windows / Linux з дискретним GPU (RTX 3060, RTX 4060) — хороший сценарій

Якщо є дискретна відеокарта з 6–8 ГБ VRAM — модель повністю

завантажується в GPU-пам'ять, і системна RAM залишається для ОС і софту.

За даними

LocalLLM.in,

на RTX 4060 (8 ГБ VRAM) 7B-модель видає 40+ токенів/сек —

найшвидший варіант із усіх.

Windows / Linux без GPU (Intel HD / AMD Radeon iGPU) — складний сценарій

Без дискретного GPU модель працює повністю на CPU. Олама все одно

запуститься — але швидкість падає до 3–6 токенів/сек.

За даними

LocalLLM.in,

CPU-only inference прийнятний для пакетних задач, але фруструє

при інтерактивному використанні.

Плюс системна RAM ділиться між ОС, софтом і моделлю — на 8 ГБ

це дуже тісно.

Зведена таблиця

| Платформа |

7B модель (Q4) |

3B модель (Q4) |

Швидкість |

Комфорт |

| Mac M1/M2 8 ГБ |

✔️ Працює |

✔️ Комфортно |

15–20 tok/s |

⭐⭐⭐⭐ |

| Windows + RTX 4060 8 ГБ VRAM |

✔️ Працює швидко |

✔️ Комфортно |

40+ tok/s |

⭐⭐⭐⭐⭐ |

| Windows/Linux CPU only 8 ГБ |

⚠️ На межі |

✔️ Працює |

3–6 tok/s |

⭐⭐ |

Висновок: Якщо у тебе Mac M1+ з 8 ГБ — ти у

найкращій позиції для локального AI на бюджетному залізі. Якщо Windows

без GPU — фокусуйся на 3B-моделях і закривай все зайве.

Детальніше про встановлення на різних ОС —

у статті Як встановити Ollama на Mac, Windows і Linux.

🎯 Квантизація простими словами: Q4 vs Q8 і що обрати на слабкому залізі

Коротка відповідь:

Квантизація — це стиснення моделі, яке зменшує її розмір у 2–4 рази

з мінімальною втратою якості. На 8 ГБ оптимальний вибір — Q4_K_M:

найкращий баланс між розміром, швидкістю і якістю відповідей.

Квантизація — це як JPEG для фото. Файл менший,

різниця майже непомітна. Але якщо стиснути занадто сильно —

якість помітно впаде.

Коли ти бачиш у назві моделі на Ollama теги типу :7b-q4_0,

:8b-instruct-q8_0 або :3b-q4_k_m — це позначення

рівня квантизації. Число після «q» — кількість біт на один параметр.

Рівні квантизації: що означають теги

- ✔️ Q8 (8-біт): максимальна якість, найбільший розмір. Для 7B-моделі — ~8 ГБ. На 8 ГБ RAM не влізе.

- ✔️ Q4_K_M (4-біт, K-quant medium): оптимальний баланс. Для 7B — ~4–5 ГБ. Рекомендований для 8 ГБ систем.

- ✔️ Q4_K_S (4-біт, K-quant small): трохи менший за Q4_K_M, трохи нижча якість.

- ⚠️ Q2_K (2-біт): мінімальний розмір (~2.5 ГБ для 7B), але помітна деградація якості. Крайній варіант.

Суфікс «K» означає новіші методи квантизації (K-quant), які розумніше

розподіляють точність між шарами моделі. K-quant-теги завжди кращі за

legacy-варіанти (q4_0, q4_1) при тому самому розмірі.

Скільки важать моделі різних квантизацій

| Модель |

Q8 |

Q4_K_M |

Q2_K |

| Phi-3 Mini (3.8B) |

4.0 ГБ |

2.3 ГБ |

1.2 ГБ |

| Llama 3.2 (7B) |

~8 ГБ |

~4.5 ГБ |

~2.6 ГБ |

| Mistral 7B |

~8 ГБ |

~4.1 ГБ |

~2.8 ГБ |

Дані за

LocalAIMaster.

Правило для 8 ГБ: завжди обирай Q4_K_M. Якщо не влазить — знижуй

розмір моделі (3B замість 7B), а не рівень квантизації (Q2 замість Q4).

Менша модель з Q4 дасть кращу якість, ніж більша з Q2.

Детальніше про техніки стиснення і їхній вплив на якість —

у статті Квантизація моделей: INT4, INT8 — що це і як впливає на якість.

Висновок: Q4_K_M — золотий стандарт для 8 ГБ. Не піддавайся

спокусі завантажити Q8 «для якості» — модель не влізе в пам'ять,

і ти отримаєш swap на диск замість швидких відповідей.

🎯 Налаштування Ollama для максимуму на слабкому залізі

Три змінні середовища і одна звичка (закривати зайве) — це все,

що потрібно, щоб вичавити максимум із 8 ГБ. Налаштування займає

хвилину, а різниця у стабільності — відчутна.

На потужному залізі Ollama «просто працює».

На слабкому — потрібно допомогти їй не витрачати пам'ять на те,

що тобі не потрібно.

За замовчуванням Ollama може тримати в пам'яті кілька моделей

одночасно і обробляти паралельні запити. На 8 ГБ це зайва розкіш.

Ось мінімальний набір оптимізацій:

Змінні середовища

# Тримати в пам'яті лише одну модель (за замовчуванням може бути більше)

export OLLAMA_MAX_LOADED_MODELS=1

# Один паралельний запит (без конкуренції за пам'ять)

export OLLAMA_NUM_PARALLEL=1

# Зменшити вікно контексту — економить 200–800 МБ RAM

export OLLAMA_CTX_SIZE=2048

На macOS / Linux додай ці рядки у ~/.zshrc або

~/.bashrc. На Windows — задай через системні змінні

середовища або PowerShell-профіль.

Перед запуском моделі

Звучить банально, але на 8 ГБ це критично:

- ✔️ Закрий браузер або залиш максимум 2–3 вкладки

- ✔️ Закрий Slack, Discord, Spotify — кожна програма з'їдає 200–500 МБ

- ✔️ Перевір поточне використання:

ollama ps покаже завантажені моделі

- ✔️ Якщо стара модель ще в пам'яті —

ollama stop назва_моделі

Modelfile для тонкого налаштування

Якщо хочеш більше контролю — створи Modelfile з оптимізованими параметрами:

FROM phi3:mini

PARAMETER num_ctx 2048

PARAMETER num_thread 4

PARAMETER temperature 0.7

num_ctx 2048 — зменшує вікно контексту (менше RAM на KV-кеш).

num_thread 4 — обмежує кількість потоків CPU, щоб система

залишалася відзивчивою.

Покроковий гайд по встановленню і першому запуску —

у статті Як встановити Ollama на Mac, Windows і Linux: повний гайд 2026.

А про створення кастомних моделей через Modelfile —

у статті Modelfile в Ollama: створи свого кастомного AI.

Висновок: Три змінні середовища + закриті зайві програми =

стабільна робота на 8 ГБ. Без цих налаштувань навіть легка модель

може спричинити swap на диск.

🎯 Що НЕ варто пробувати на 8 ГБ — мій досвід

Коротка відповідь:

Моделі 13B+, будь-які моделі у Q8-квантизації, і спроби запустити

дві моделі одночасно — гарантоване розчарування на 8 ГБ.

Я перевірив це на своєму Mac M1 — щоб вам не довелося.

Кожен, хто працював з Ollama на 8 ГБ, проходив через один

і той самий етап: «А може 13B всe-таки влізе?» Ні, не влізе.

Я перевірив.

Працюючи з Ollama на Mac M1 з 8 ГБ unified memory, я тестував

десятки моделей різних розмірів. Ось чесний список того,

що не працює — або працює настільки погано, що краще б не працювало.

❌ Моделі 13B і більше

Llama 2 13B, Qwen 14B, CodeLlama 13B — навіть у Q4-квантизації

вони потребують 8–9 ГБ лише на ваги моделі. Додай KV-кеш, ОС,

і ти отримаєш систему, яка безперервно свопить на диск.

Я спробував запустити Llama 2 13B Q4 — перші 5 хвилин вона завантажувалася,

потім видавала 1–2 токени на секунду з постійними паузами.

Це непрацездатно для інтерактивного використання.

❌ Будь-яка 7B-модель у Q8-квантизації

Q8-версія 7B-моделі важить близько 8 ГБ — це вся твоя оперативна

пам'ять. ОС не зникає магічно. Я пробував Mistral 7B Q8 —

система зависла через хвилину після старту. Завжди використовуй Q4_K_M

для 7B-моделей на 8 ГБ.

❌ Дві моделі одночасно

Ollama може тримати кілька моделей у пам'яті. На 16 ГБ це зручно —

переключаєшся між моделями миттєво. На 8 ГБ це рецепт для swap-шторму.

Тримай OLLAMA_MAX_LOADED_MODELS=1 і не забувай

ollama stop перед завантаженням іншої моделі.

❌ Великі контекстні вікна (8K+ токенів)

Кожне подвоєння контекстного вікна — це додаткові сотні мегабайт

на KV-кеш. На 8 ГБ тримай контекст на 2048–4096 токенів максимум.

Передати модель 10-сторінковий документ цілком — не вийде,

потрібно розбивати на частини.

❌ Mixtral 8x7B (MoE-архітектура)

Mixtral активує лише 2 з 8 «експертів» на кожен токен,

тому теоретично використовує менше обчислень. Але всі 8 експертів

мають бути в пам'яті — і це 26+ ГБ навіть у Q4.

Назва «8x7B» вводить в оману: це не модель розміром 7B.

Загальне правило: якщо ollama run

завантажується довше 30 секунд і перша відповідь приходить через

хвилину — модель занадто велика для твоєї системи. Не чекай, що

«розігріється» — закрий і візьми модель меншого розміру.

Порівняння моделей за розміром, якістю і задачами —

у статті Топ-10 моделей Ollama у 2026: яку вибрати.

Висновок: Я сам пройшов через це — думав, що більша

модель дасть кращий результат, скачав 13B, почекав хвилину на першу

відповідь і видалив. Встановив 3B — і продуктивність одразу зросла.

На 8 ГБ краща стратегія — обрати модель, яка працює швидко і стабільно,

ніж мучитися з тією, що «майже влазить».

🎯 Pruebas: qué esperar en la práctica

Respuesta corta:

En Mac M1 con 8 GB, el modelo 3B produce 20-30 tokens/seg, el modelo 7B produce 10-15 tokens/seg.

En Windows solo con CPU, es dos o tres veces más lento.

A continuación, una tabla resumen para orientación.

Las comparativas en internet a menudo se realizan en un sistema limpio sin

otro software. En la realidad, con VS Code abierto y 5 pestañas de Chrome,

las cifras serán más bajas. Por eso, estas pruebas se acercan más a la realidad.

Tabla resumen de rendimiento

| Modelo |

RAM |

Mac M1 8 GB |

Solo CPU 8 GB |

RTX 4060 8 GB VRAM |

| Gemma 2B (Q4) |

~1.6 GB |

~30 tok/s |

~10 tok/s |

~50+ tok/s |

| Phi-3 Mini 3.8B (Q4) |

~2.3 GB |

~25 tok/s |

~8 tok/s |

~45 tok/s |

| Llama 3.2 3B (Q4) |

~2 GB |

~28 tok/s |

~9 tok/s |

~48 tok/s |

| Qwen 2.5 Coder 3B (Q4) |

~2.2 GB |

~25 tok/s |

~8 tok/s |

~45 tok/s |

| Llama 3.1 8B (Q4) |

~4.5 GB |

~12 tok/s |

~4 tok/s |

~40 tok/s |

| DeepSeek R1 8B (Q4) |

~5 GB |

~10 tok/s |

~3 tok/s |

~35 tok/s |

Datos aproximados, basados en los resultados de

LocalLLM.in,

SitePoint

y LocalAIMaster.

La velocidad real depende de la carga del sistema, el tamaño de la ventana de contexto

y los procesos en segundo plano.

¿Qué significan estas cifras en la práctica?

- ✔️ 15+ tok/s: chat interactivo cómodo: la respuesta aparece más rápido de lo que puedes leer

- ✔️ 8–15 tok/s: se puede trabajar, pero se nota un retraso en respuestas largas

- ⚠️ 3–6 tok/s: aceptable para tareas puntuales (depuración, análisis), frustrante en chat activo

- ❌ <3 tok/s: el modelo es demasiado grande para este sistema

Conclusión: Para el trabajo diario en 8 GB, enfócate en

modelos de 3B: ofrecen 20+ tok/s en Apple Silicon y dejan

el sistema receptivo. Los modelos de 7-8B son para tareas específicas, cuando

estás dispuesto a cerrar todo lo innecesario y esperar.

❓ Preguntas frecuentes (FAQ)

¿Se puede ejecutar Ollama en un portátil con 8 GB de RAM?

Sí. Los modelos de 1-3B parámetros (Phi-3 Mini, Llama 3.2 3B, Gemma 2B)

funcionan cómodamente en cualquier sistema con 8 GB. Los modelos de 7-8B

funcionan al límite: es necesario cerrar programas innecesarios.

Más detalles en la

guía de instalación de Ollama.

¿Cuál es el mejor modelo para 8 GB de RAM?

Depende de la tarea. Para código: Qwen 2.5 Coder 3B.

Para texto y chat: Llama 3.2 3B o Phi-3 Mini.

Para razonamiento y depuración: DeepSeek R1 8B (al límite de 8 GB).

Comparación completa de modelos en

el artículo Top 10 modelos de Ollama en 2026.

¿Se necesita GPU para Ollama?

No, Ollama también funciona en CPU. Pero con GPU (dedicada o Apple Silicon)

la velocidad es 3-10 veces mayor. En un sistema solo con CPU y 8 GB,

limítate a modelos de 3B o menos para un trabajo cómodo.

¿Qué es mejor: un modelo 7B en Q2 o un 3B en Q4?

Casi siempre, el 3B en Q4. La cuantización agresiva (Q2) reduce significativamente

la calidad de las respuestas, especialmente en tareas complejas.

Un modelo más pequeño con cuantización normal dará un mejor resultado.

¿Puede Ollama en 8 GB reemplazar a ChatGPT?

Para tareas diarias: resumir, preguntas sencillas, generar código,

sí. Para análisis complejos, tareas multimodales y trabajo con grandes

contextos, los modelos en la nube siguen siendo más potentes.

El enfoque óptimo es híbrido:

Ollama para tareas regulares, ChatGPT/Claude para las complejas.

Más detalles en

el artículo Ollama vs ChatGPT vs Claude: cuándo la IA local es mejor.

¿Cuánto espacio en disco se necesita?

Un modelo 3B en Q4 ocupa aproximadamente 2 GB en disco. Tres modelos para diferentes

tareas: 6-8 GB. Ollama almacena los modelos en ~/.ollama.

Los modelos descargados se pueden eliminar con el comando ollama rm nombre_del_modelo.

¿Vale la pena actualizar a 16 GB?

Si planeas trabajar regularmente con IA local, definitivamente sí.

16 GB abren el acceso a modelos de 13-14B, modelos de 7B completos en calidad Q8

y trabajo cómodo con ventanas de contexto grandes.

La diferencia en capacidades entre 8 y 16 GB es la mayor en todo el espectro.

✅ Conclusiones

8 GB de memoria RAM no son una sentencia para la IA local,

pero son un límite que requiere decisiones conscientes. Lo principal:

- ✔️ Modelos 3B - zona de confort: Phi-3 Mini, Llama 3.2 3B, Gemma 2B funcionan rápido y estable, dejando espacio para IDE y navegador

- ✔️ Modelos 7-8B - zona de trabajo: DeepSeek R1 8B, Qwen 3 8B funcionan al límite, pero ofrecen una calidad notablemente mejor para tareas específicas

- ✔️ Q4_K_M - la única opción de cuantización sensata en 8 GB: un modelo más pequeño con Q4 siempre es mejor que uno más grande con Q2

- ✔️ Apple Silicon con 8 GB - la mejor opción económica: la memoria unificada da una ventaja sobre los sistemas solo con CPU

- ✔️ Modelos 13B+, Q8, dos modelos simultáneamente - no vale la pena: probado, no funciona

Yo mismo utilizo este enfoque: mantengo varios modelos

para diferentes tareas: uno para código, otro para texto, uno separado para depuración.

Cada modelo tiene su punto fuerte, y en lugar de uno grande,

que podría no caber en memoria, es mejor tener 2-3 especializados y ligeros.

Cambiar entre ellos a través de ollama run es cuestión de segundos.

Si recién empiezas, instala Ollama según

nuestra guía,

descarga phi3:mini y pruébalo.

En cinco minutos tendrás una IA local funcionando,

sin suscripciones, sin internet, sin enviar datos al exterior.

Y si necesitas un sitio web, blog o aplicación web con integración

de funcionalidades de IA,

escríbenos a WebsCraft,

te ayudaremos a implementarlo.

📖 Fuentes