Hast du einen Laptop mit 8 GB RAM und möchtest KI lokal ausführen?

Dieser Artikel ist eine Analyse: Was funktioniert, was kaum läuft,

und was sich nicht einmal lohnt herunterzuladen. Ohne Illusionen, mit konkreten Modellen

und Befehlen für jede Aufgabe. Wenn du mit Ollama noch nicht vertraut bist –

beginne mit dem Einführungsartikel darüber, was Ollama ist und wozu es benötigt wird.

📚 Inhalt des Artikels

🎯 Ehrliche Arithmetik: Wie viel RAM bleibt tatsächlich für das Modell übrig

Kurze Antwort:

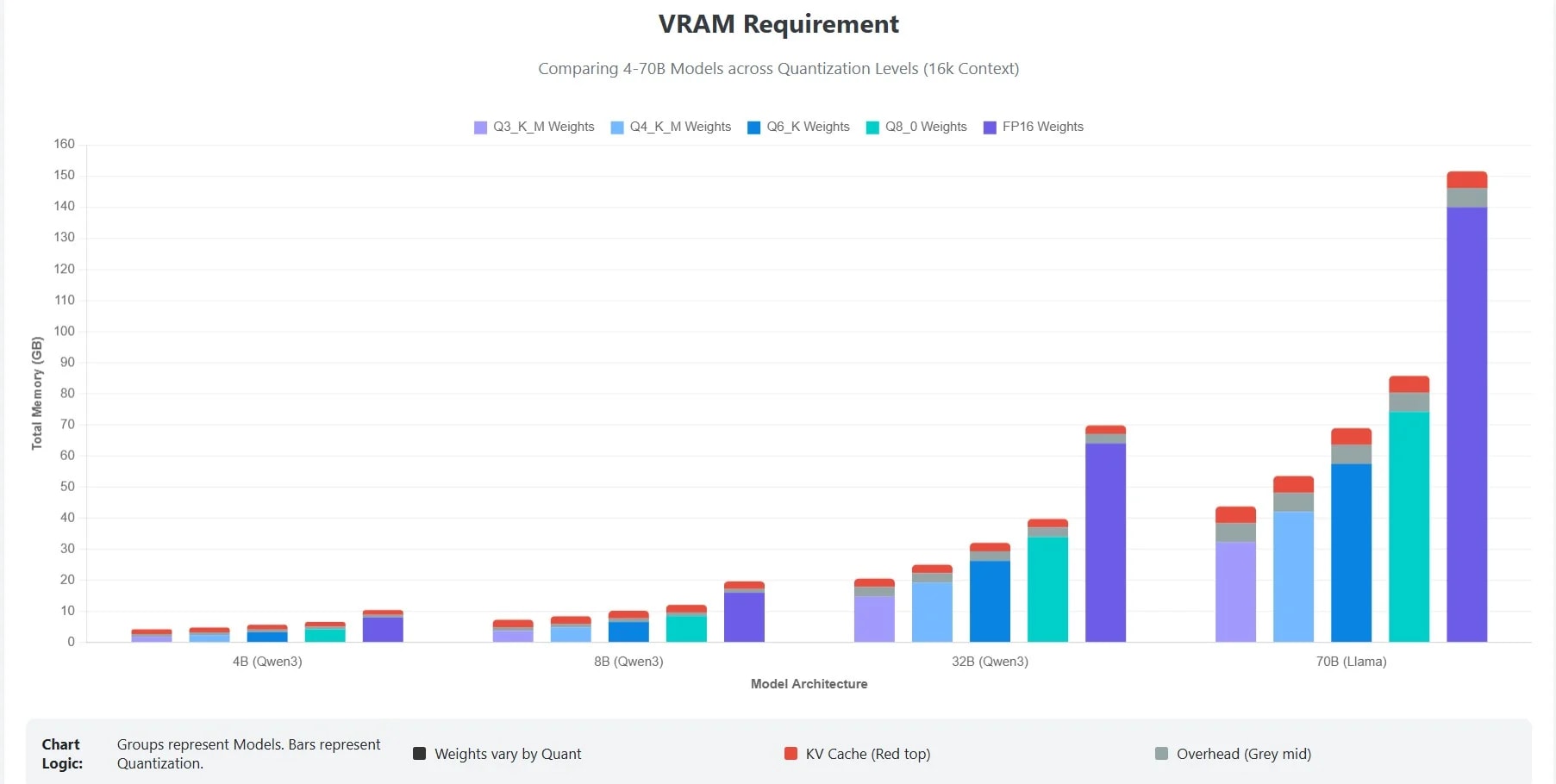

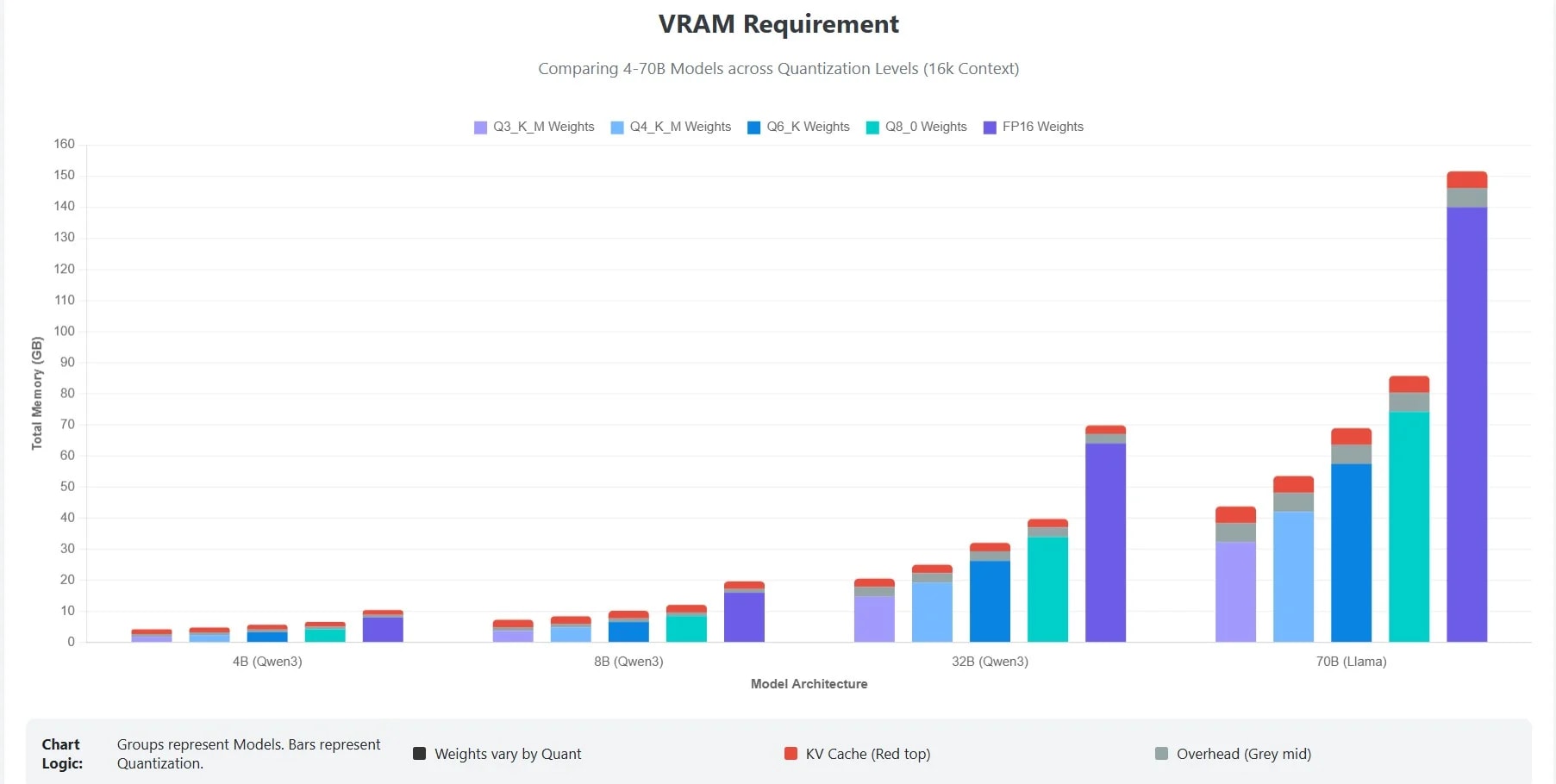

Von 8 GB Arbeitsspeicher stehen für ein KI-Modell real 4–5 GB zur Verfügung.

Den Rest nehmen das Betriebssystem, der Browser und grundlegende Prozesse ein.

Dies bestimmt die Hauptregel: Auf 8 GB laufen Modelle bis zu 3–7B

Parametern in 4-Bit-Quantisierung komfortabel.

8 GB RAM sind nicht 8 GB für das Modell.

Es sind 8 GB minus OS, minus Chrome, minus alles, was du vergessen hast zu schließen.

Bevor du ein Modell auswählst, musst du das reale Speicherbudget verstehen.

Hier ist eine typische Aufteilung auf einem System mit 8 GB RAM:

- ✔️ Betriebssystem: 1.5–2.5 GB (macOS näher an 2.5, Windows – 2, Linux – 1.5)

- ✔️ Browser (5–10 Tabs): 1–2 GB

- ✔️ IDE (VS Code / IntelliJ): 0.5–1.5 GB

- ✔️ Hintergrundprozesse: 0.3–0.5 GB

Rest für das Modell: 3–5 GB.

Laut

LocalLLM.in

benötigt ein Modell mit 7B Parametern in Q4_K_M-Quantisierung etwa 4–5 GB,

plus 1–2 GB für KV-Cache und System-Overhead.

Das bedeutet: Ein 7B-Modell auf 8 GB ist möglich, aber grenzwertig, und es ist besser,

alles Überflüssige zu schließen.

Praktische Regel für 8 GB:

- ✔️ Komfortzone: Modelle mit 1–3B Parametern (Q4_K_M) – es bleibt Platz für IDE und Browser

- ✔️ Arbeitszone: Modelle mit 7–8B Parametern (Q4_K_M) – alles Überflüssige muss geschlossen werden

- ❌ Rote Zone: Modelle mit 13B+ – garantierte Abstürze oder Swap auf die Festplatte

Fazit: Schließe den Browser, bevor du ein Modell auswählst, überprüfe

ollama ps und sieh dir den realen verbleibenden Speicher an.

Auf 8 GB ist jedes Gigabyte Gold wert.

🎯 Für Code: Welches Modell ersetzt Copilot auf 8 GB

Code-Autovervollständigung

Für die Code-Autovervollständigung auf 8 GB ist die beste Wahl Qwen 2.5 Coder 3B oder

Phi-4 Mini (3.8B) in Q4_K_M-Quantisierung. Beide Modelle lassen genügend

Speicher für VS Code übrig und liefern eine akzeptable Generierungsqualität.

GitHub Copilot kostet 10 $/Monat. Ein lokales Modell für Code –

0 $/Monat und funktioniert offline. Die einzige Frage ist, welches Modell

auf deiner Hardware läuft.

Codierung ist eine Aufgabe, bei der selbst kleine Modelle nützlich sein können.

Autovervollständigung, Generierung von Funktionen, Erklärung von Code, Schreiben von Tests –

dafür braucht man kein GPT-4, sondern ein schnelles und präzises Modell,

das die Syntax versteht.

Top-Modelle für Code auf 8 GB

1. Qwen 2.5 Coder 3B (Q4_K_M) – ~2.2 GB RAM

Laut

SitePoint

führt Qwen den HumanEval-Benchmark unter den Modellen der 7–8B-Klasse an.

Die 3B-Version ist eine leichtere Variante, behält aber ihre starke Spezialisierung auf Code.

Trainiert auf einer großen Menge an Programmcode und technischer Dokumentation.

ollama pull qwen2.5-coder:3b

ollama run qwen2.5-coder:3b "Schreibe eine Funktion zum Sortieren eines Arrays in Python"

2. Phi-4 Mini (3.8B) – ~2.3 GB RAM

Laut

SitePoint

ist Phi-4 Mini das einzige Modell, das auf Systemen mit 8 GB komfortabel läuft und

15–20 Tokens/Sekunde auf einem M1 MacBook Air oder einem günstigen Linux-Laptop liefert.

Es eignet sich gut für Autovervollständigung, einfache Erklärungen und leichte Chat-Aufgaben.

ollama pull phi4-mini

ollama run phi4-mini "Erkläre den Unterschied zwischen HashMap und TreeMap in Java"

3. DeepSeek Coder 1.3B (Q4_K_M) – ~1 GB RAM

Das leichteste Modell für Code. Ideal für Autovervollständigung in der IDE –

schnell, belastet das System nicht, kann im Hintergrund zusammen mit

VS Code, Browser und Terminal laufen.

ollama pull deepseek-coder:1.3b

ollama run deepseek-coder:1.3b

Was wählen?

- ✔️ Benötigst Autovervollständigung im Hintergrund + offener Browser → DeepSeek Coder 1.3B

- ✔️ Benötigst Generierung von Funktionen und Code-Erklärungen → Qwen 2.5 Coder 3B

- ✔️ Benötigst ein universelles Modell für Code und Text → Phi-4 Mini

Mehr über die Einrichtung der Autovervollständigung –

im Artikel Ollama + VS Code: Kostenlose Alternative zu GitHub Copilot.

Fazit: Auf 8 GB kann man mit lokaler KI coden.

Erwarte keine GPT-4-Qualität – aber für die tägliche Autovervollständigung,

die Generierung von Boilerplate-Code und Code-Erklärungen reicht es aus.

🎯 Für Text und Kommunikation: Chat, Zusammenfassung, Übersetzung

Für Textaufgaben

Für Textaufgaben auf 8 GB ist die optimale Wahl Llama 3.2 3B für allgemeine

Chats, Gemma 2B für maximale Geschwindigkeit oder Phi-3 Mini für ein Gleichgewicht

zwischen Qualität und Größe. Alle drei lassen Platz für andere Software.

Nicht jede Aufgabe erfordert GPT-4. Texte zusammenfassen,

Fragen beantworten, einen Artikel wiedergeben – das bewältigt

ein Modell, das weniger wiegt als ein 4K-Film.

Textaufgaben sind die breiteste Kategorie: vom einfachen Chat bis zur Analyse

von Dokumenten und Übersetzung. Auf 8 GB gibt es hier eine Auswahl.

Top-Modelle für Text auf 8 GB

1. Llama 3.2 3B (Q4_K_M) – ~2 GB RAM

Laut

StudyHUB

ist Llama 3.1/3.2 das beliebteste Modell auf Ollama mit über 111 Millionen

Downloads. Die 3B-Version ist eine leichtere Variante, behält aber die Qualität in allgemeinen

Gesprächen, Zusammenfassungen und Beantwortung von Fragen. Unterstützt 8 Sprachen.

ollama pull llama3.2:3b

ollama run llama3.2:3b "Fasse die Hauptidee dieses Textes zusammen: ..."

2. Gemma 2B (Q4_K_M) – ~1.6 GB RAM

Ein Modell von Google DeepMind. Das schnellste in dieser Kategorie – ideal,

wenn eine sofortige Antwort und minimale Systembelastung benötigt werden.

Die Qualität ist niedriger als bei Llama 3B, aber für einfache Fragen und Textklassifizierung

mehr als ausreichend.

ollama pull gemma:2b

ollama run gemma:2b "Erstelle eine kurze Beschreibung für dieses Produkt: ..."

3. Phi-3 Mini (3.8B) – ~2.3 GB RAM

Laut

StudyHUB

deckt Phi-3 Mini bei einer Größe von 2.3 GB 90% der täglichen Aufgaben ab.

Es läuft schnell auch auf der CPU und eignet sich für Raspberry Pi 4/5.

ollama pull phi3:mini

ollama run phi3:mini "Übersetze ins Ukrainische: The quick brown fox jumps over the lazy dog"

Was wählen?

- ✔️ Allgemeiner Chat und Fragen-Antworten → Llama 3.2 3B

- ✔️ Maximale Geschwindigkeit, minimaler RAM → Gemma 2B

- ✔️ Gleichgewicht zwischen Qualität und Größe, tägliche Nutzung → Phi-3 Mini

Wenn du eine schöne grafische Oberfläche anstelle des Terminals möchtest –

sieh dir den Artikel Ollama + Open WebUI: Lokales ChatGPT im Browser an.

Fazit: Für Textaufgaben sind 8 GB ein komfortabler

Bereich. Modelle mit 2–3B laufen schnell, lassen Platz für andere

Programme und liefern eine Qualität, die für die meisten täglichen Bedürfnisse ausreicht.

🎯 Für Reasoning: Mathematik, Logik, Code-Debugging

Für Aufgaben, die schrittweises Denken erfordern – Mathematik, logische Aufgaben,

Debugging von komplexem Code – läuft auf 8 GB DeepSeek R1 8B in Q4-Quantisierung.

Dies ist ein "denkendes" Modell: Es ist langsamer, aber präziser bei komplexen Fragen.

Ein normales Modell antwortet sofort. Ein Reasoning-Modell

denkt zuerst – Schritt für Schritt – und antwortet dann.

Wie der Unterschied zwischen "zufällig antworten" und "auf Papier rechnen".

Reasoning-Modelle sind eine relativ neue Kategorie. Sie arbeiten nach dem Prinzip

Chain-of-Thought: Sie zerlegen die Aufgabe in Schritte, überprüfen Zwischenergebnisse

und formulieren erst dann die endgültige Antwort.

Was funktioniert auf 8 GB

1. DeepSeek R1 8B (Q4_K_M) – ~5 GB RAM

Laut

StudyHUB

ist DeepSeek R1 ein "denkendes" Modell, ein Analogon zu OpenAI o1. Bei Aufgaben mit Mathematik,

logischen Rätseln und technischem Reasoning liefert es bessere Ergebnisse als Llama 3.1

derselben Größe. Kompromiss: Es antwortet langsamer, weil es vor der Antwort "denkt".

ollama pull deepseek-r1:8b

ollama run deepseek-r1:8b "Finde den Fehler in dieser SQL-Abfrage: SELECT * FROM users WHERE id = '5' AND active = true GROUP HAVING count > 1"

⚠️ Wichtig: DeepSeek R1 8B belegt ~5 GB RAM.

Auf einem System mit 8 GB ist das grenzwertig – der Browser, die IDE und alles

Überflüssige müssen geschlossen werden. Auf macOS mit Unified Memory läuft es stabiler als unter Windows

mit integrierter Grafik.

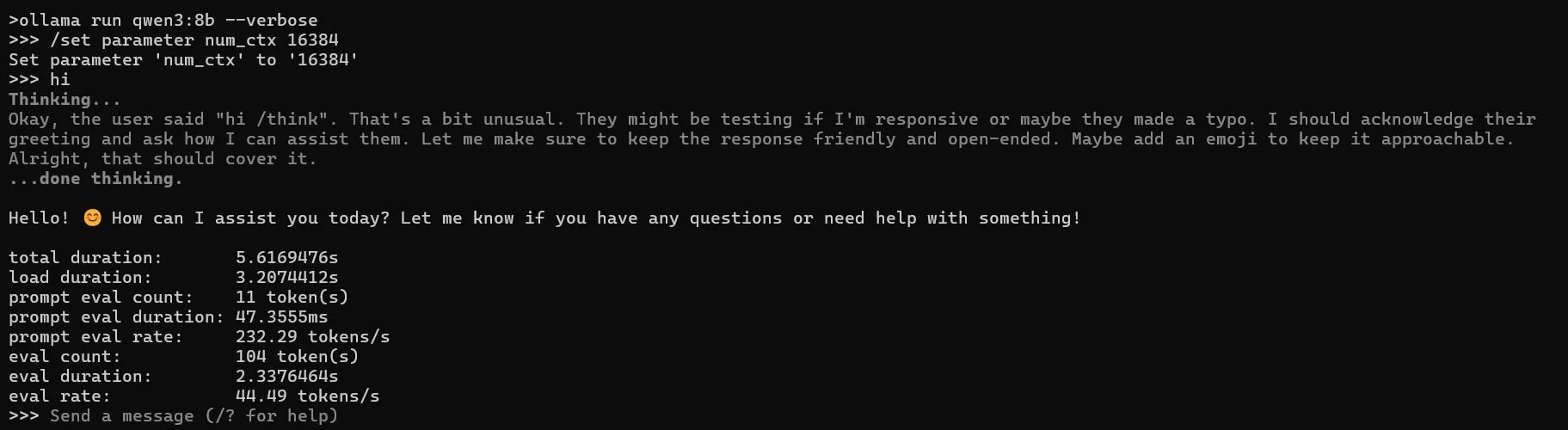

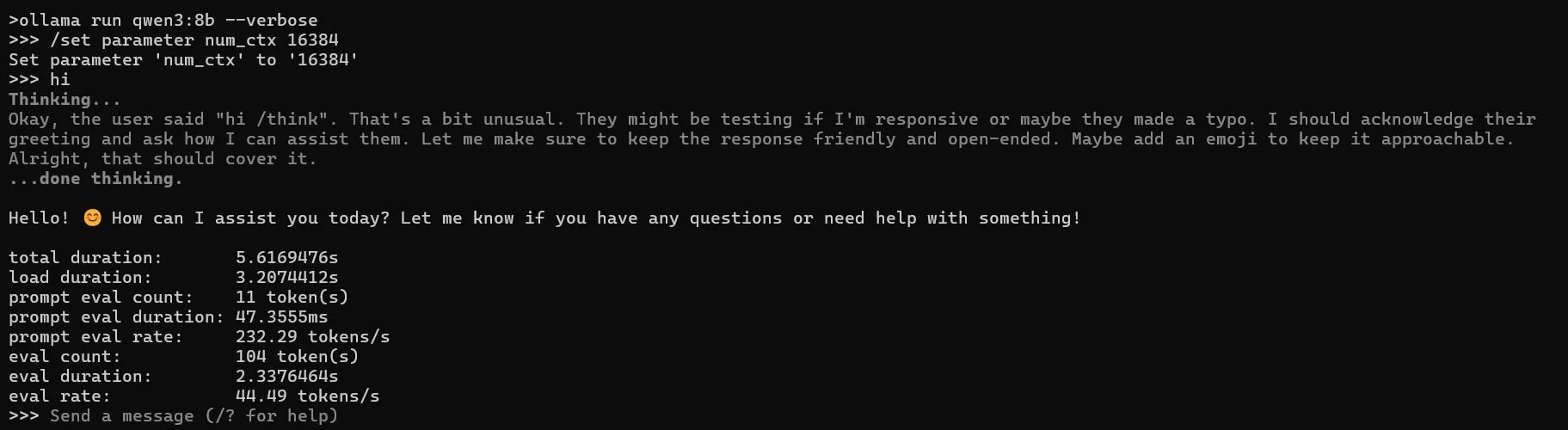

2. Qwen 3 8B (Q4_K_M) – ~5 GB RAM

Laut

LocalLLM.in

ist Qwen 3 8B eine starke Alternative für Reasoning-Aufgaben, insbesondere in Mathematik

und mehrsprachigen Szenarien. Unterstützt den Thinking-Modus in Ollama standardmäßig.

ollama pull qwen3:8b

ollama run qwen3:8b "Löse: Wenn 3x + 7 = 22, was ist x?"

Was wählen?

- ✔️ Code-Debugging und logische Aufgaben → DeepSeek R1 8B

- ✔️ Mathematik und mehrsprachiges Reasoning → Qwen 3 8B

- ✔️ Wenn 8B nicht passt – Phi-4 Mini als Kompromiss (kleiner, aber ohne Chain-of-Thought)

Fazit: Reasoning auf 8 GB ist möglich, aber es ist die Grenze

des Komforts. 8B-Modelle benötigen fast den gesamten verfügbaren Speicher. Für regelmäßige

Arbeit mit solchen Aufgaben sollte ein Upgrade auf 16 GB in Betracht gezogen werden –

der Unterschied in den Möglichkeiten wird erheblich sein.

🎯 CPU vs GPU vs Apple Silicon — wo 8 GB unterschiedliche 8 GB sind

8 GB auf einem Mac M1 und 8 GB auf einem Windows-Laptop mit Intel sind zwei unterschiedliche Erfahrungen.

Apple Silicon verwendet Unified Memory, bei dem der gesamte Speicher gleichzeitig für CPU und

GPU zugänglich ist. Auf einem herkömmlichen PC sind RAM und VRAM separate Pools,

und das ist entscheidend für KI-Modelle.

Ein Mac M1 mit 8 GB ist eine vollwertige Workstation für lokales KI.

Ein Windows-Laptop mit 8 GB und Intel HD Graphics ist ein Kampf um jedes Megabyte.

Apple Silicon (M1/M2/M3) — das beste Szenario für 8 GB

Auf Apple Silicon ist der gesamte Arbeitsspeicher Unified Memory.

Das bedeutet, dass der GPU-Teil des Chips auf dieselben 8 GB zugreifen kann

wie die CPU. Ollama verwendet automatisch Metal zur Beschleunigung —

ohne zusätzliche Konfiguration.

Ergebnis: Ein 7B-Modell in Q4_K_M auf einem M1 mit 8 GB liefert 15–20 Token/Sek —

genug für eine komfortable interaktive Nutzung.

Laut

SitePoint

ist Phi-4 Mini auf einem M1 MacBook Air etwa 15–20 tok/s, was für die tägliche Arbeit ausreicht.

Windows / Linux mit dedizierter GPU (RTX 3060, RTX 4060) — ein gutes Szenario

Wenn eine dedizierte Grafikkarte mit 6–8 GB VRAM vorhanden ist, wird das Modell vollständig

in den GPU-Speicher geladen, und der System-RAM bleibt für das Betriebssystem und die Software übrig.

Laut

LocalLLM.in

liefert eine RTX 4060 (8 GB VRAM) ein 7B-Modell mit 40+ Token/Sek —

die schnellste Option von allen.

Windows / Linux ohne GPU (Intel HD / AMD Radeon iGPU) — ein schwieriges Szenario

Ohne dedizierte GPU läuft das Modell vollständig auf der CPU. Ollama wird

trotzdem starten — aber die Geschwindigkeit sinkt auf 3–6 Token/Sek.

Laut

LocalLLM.in

ist CPU-only-Inferenz für Batch-Aufgaben akzeptabel, aber frustrierend

bei interaktiver Nutzung.

Zusätzlich wird der System-RAM zwischen Betriebssystem, Software und Modell geteilt — bei 8 GB

ist das sehr eng.

Zusammenfassungstabelle

| Plattform |

7B Modell (Q4) |

3B Modell (Q4) |

Geschwindigkeit |

Komfort |

| Mac M1/M2 8 GB |

✔️ Funktioniert |

✔️ Komfortabel |

15–20 tok/s |

⭐⭐⭐⭐ |

| Windows + RTX 4060 8 GB VRAM |

✔️ Funktioniert schnell |

✔️ Komfortabel |

40+ tok/s |

⭐⭐⭐⭐⭐ |

| Windows/Linux CPU only 8 GB |

⚠️ Am Limit |

✔️ Funktioniert |

3–6 tok/s |

⭐⭐ |

Fazit: Wenn du einen Mac M1+ mit 8 GB hast — bist du in

der besten Position für lokales KI auf preiswerter Hardware. Wenn du Windows

ohne GPU hast — konzentriere dich auf 3B-Modelle und schließe alles Überflüssige.

Mehr über die Installation auf verschiedenen Betriebssystemen —

im Artikel Wie man Ollama auf Mac, Windows und Linux installiert.

🎯 Quantisierung einfach erklärt: Q4 vs Q8 und was man auf schwacher Hardware wählen sollte

Kurze Antwort:

Quantisierung ist die Komprimierung eines Modells, die seine Größe um das 2- bis 4-fache reduziert

mit minimalem Qualitätsverlust. Bei 8 GB ist die optimale Wahl Q4_K_M:

der beste Kompromiss zwischen Größe, Geschwindigkeit und Antwortqualität.

Quantisierung ist wie JPEG für Fotos. Die Datei ist kleiner,

der Unterschied kaum merklich. Aber wenn man zu stark komprimiert —

fällt die Qualität merklich ab.

Wenn du in der Modellbezeichnung auf Ollama Tags wie :7b-q4_0,

:8b-instruct-q8_0 oder :3b-q4_k_m siehst — das ist die Angabe des Quantisierungsgrades. Die Zahl nach „q“ ist die Anzahl der Bits pro Parameter.

Quantisierungsgrade: was die Tags bedeuten

- ✔️ Q8 (8-Bit): maximale Qualität, größte Größe. Für ein 7B-Modell — ~8 GB. Passt nicht in 8 GB RAM.

- ✔️ Q4_K_M (4-Bit, K-Quant Medium): optimaler Kompromiss. Für 7B — ~4–5 GB. Empfohlen für 8 GB Systeme.

- ✔️ Q4_K_S (4-Bit, K-Quant Small): etwas kleiner als Q4_K_M, etwas geringere Qualität.

- ⚠️ Q2_K (2-Bit): minimale Größe (~2,5 GB für 7B), aber spürbare Qualitätsverschlechterung. Extremste Option.

Das Suffix „K“ steht für neuere Quantisierungsmethoden (K-Quant), die die Genauigkeit intelligenter zwischen den Schichten des Modells verteilen. K-Quant-Tags sind immer besser als Legacy-Varianten (q4_0, q4_1) bei gleicher Größe.

Wie viel wiegen Modelle mit verschiedenen Quantisierungen

| Modell |

Q8 |

Q4_K_M |

Q2_K |

| Phi-3 Mini (3.8B) |

4.0 GB |

2.3 GB |

1.2 GB |

| Llama 3.2 (7B) |

~8 GB |

~4.5 GB |

~2.6 GB |

| Mistral 7B |

~8 GB |

~4.1 GB |

~2.8 GB |

Daten von

LocalAIMaster.

Regel für 8 GB: wähle immer Q4_K_M. Wenn es nicht passt — reduziere

die Modellgröße (3B statt 7B), nicht den Quantisierungsgrad (Q2 statt Q4).

Ein kleineres Modell mit Q4 liefert bessere Qualität als ein größeres mit Q2.

Mehr über Komprimierungstechniken und deren Einfluss auf die Qualität —

im Artikel Modellquantisierung: INT4, INT8 — was ist das und wie beeinflusst es die Qualität.

Fazit: Q4_K_M ist der Goldstandard für 8 GB. Lass dich

nicht verführen, Q8 „für die Qualität“ herunterzuladen — das Modell passt nicht in den Speicher,

und du erhältst Swap auf die Festplatte statt schneller Antworten.

🎯 Ollama-Einstellungen für das Maximum auf schwacher Hardware

Drei Umgebungsvariablen und eine Gewohnheit (das Schließen von Überflüssigem) — das ist alles,

was nötig ist, um das Maximum aus 8 GB herauszuholen. Die Einrichtung dauert

eine Minute, und der Unterschied in der Stabilität ist spürbar.

Auf leistungsstarker Hardware funktioniert Ollama „einfach“.

Auf schwacher — muss man ihm helfen, keinen Speicher für Dinge zu verschwenden,

die man nicht braucht.

Standardmäßig kann Ollama mehrere Modelle gleichzeitig im Speicher halten

und parallele Anfragen verarbeiten. Bei 8 GB ist das ein überflüssiger Luxus.

Hier ist die minimale Optimierungssammlung:

Umgebungsvariablen

# Nur ein Modell im Speicher halten (standardmäßig können es mehr sein)

export OLLAMA_MAX_LOADED_MODELS=1

# Eine parallele Anfrage (kein Speicherwettbewerb)

export OLLAMA_NUM_PARALLEL=1

# Kontextfenster verkleinern — spart 200–800 MB RAM

export OLLAMA_CTX_SIZE=2048

Unter macOS / Linux füge diese Zeilen zu ~/.zshrc oder

~/.bashrc hinzu. Unter Windows — setze sie über die systemweiten Umgebungsvariablen

oder das PowerShell-Profil.

Vor dem Starten eines Modells

Klingt banal, ist aber bei 8 GB entscheidend:

- ✔️ Browser schließen oder maximal 2–3 Tabs offen lassen

- ✔️ Slack, Discord, Spotify schließen — jedes Programm frisst 200–500 MB

- ✔️ Aktuelle Auslastung prüfen:

ollama ps zeigt geladene Modelle

- ✔️ Wenn ein altes Modell noch im Speicher ist —

ollama stop modellname

Modelfile für Feinabstimmung

Wenn du mehr Kontrolle möchtest — erstelle eine Modelfile mit optimierten Parametern:

FROM phi3:mini

PARAMETER num_ctx 2048

PARAMETER num_thread 4

PARAMETER temperature 0.7

num_ctx 2048 — verkleinert das Kontextfenster (weniger RAM für KV-Cache).

num_thread 4 — begrenzt die Anzahl der CPU-Threads, damit das System

reaktionsfähig bleibt.

Schritt-für-Schritt-Anleitung zur Installation und zum ersten Start —

im Artikel Wie man Ollama auf Mac, Windows und Linux installiert: Vollständiger Leitfaden 2026.

Und über die Erstellung benutzerdefinierter Modelle über Modelfile —

im Artikel Modelfile in Ollama: Erstelle deine eigene benutzerdefinierte KI.

Fazit: Drei Umgebungsvariablen + geschlossene überflüssige Programme =

stabiler Betrieb auf 8 GB. Ohne diese Einstellungen kann selbst ein leichtes Modell

Swap auf die Festplatte verursachen.

🎯 Was man auf 8 GB NICHT ausprobieren sollte — meine Erfahrung

Kurze Antwort:

Modelle ab 13B, alle Modelle in Q8-Quantisierung und Versuche,

zwei Modelle gleichzeitig zu starten — garantierte Enttäuschung auf 8 GB.

Ich habe das auf meinem Mac M1 getestet — damit du es nicht tun musst.

Jeder, der mit Ollama auf 8 GB gearbeitet hat, hat eine Phase durchgemacht:

„Vielleicht passt 13B doch noch rein?“ Nein, tut es nicht.

Ich habe es getestet.

Beim Arbeiten mit Ollama auf einem Mac M1 mit 8 GB Unified Memory habe ich

Dutzende von Modellen unterschiedlicher Größe getestet. Hier ist eine ehrliche Liste dessen,

was nicht funktioniert — oder so schlecht funktioniert, dass es besser wäre, es würde nicht funktionieren.

❌ Modelle ab 13B

Llama 2 13B, Qwen 14B, CodeLlama 13B — selbst in Q4-Quantisierung

benötigen sie 8–9 GB allein für die Modellgewichte. Füge den KV-Cache, das Betriebssystem hinzu,

und du erhältst ein System, das ständig auf die Festplatte swappt.

Ich habe versucht, Llama 2 13B Q4 zu starten — die ersten 5 Minuten lud es,

dann lieferte es 1–2 Token pro Sekunde mit ständigen Pausen.

Das ist für die interaktive Nutzung nicht praktikabel.

❌ Jedes 7B-Modell in Q8-Quantisierung

Die Q8-Version eines 7B-Modells wiegt etwa 8 GB — das ist dein gesamter Arbeitsspeicher.

Das Betriebssystem verschwindet nicht magisch. Ich habe Mistral 7B Q8 ausprobiert —

das System hing eine Minute nach dem Start. Verwende immer Q4_K_M

für 7B-Modelle auf 8 GB.

❌ Zwei Modelle gleichzeitig

Ollama kann mehrere Modelle im Speicher halten. Auf 16 GB ist das praktisch —

man wechselt sofort zwischen den Modellen. Auf 8 GB ist das ein Rezept für einen Swap-Sturm.

Halte OLLAMA_MAX_LOADED_MODELS=1 und vergiss nicht

ollama stop, bevor du ein anderes Modell lädst.

❌ Große Kontextfenster (8K+ Token)

Jede Verdoppelung des Kontextfensters bedeutet zusätzliche Hunderte von Megabyte

für den KV-Cache. Bei 8 GB halte den Kontext auf maximal 2048–4096 Token.

Ein 10-seitiges Dokument vollständig an das Modell zu übergeben — geht nicht,

es muss in Teile zerlegt werden.

❌ Mixtral 8x7B (MoE-Architektur)

Mixtral aktiviert nur 2 von 8 „Experten“ pro Token,

daher verwendet es theoretisch weniger Berechnungen. Aber alle 8 Experten

müssen im Speicher sein — und das sind 26+ GB selbst in Q4.

Der Name „8x7B“ ist irreführend: das ist kein Modell der Größe 7B.

Allgemeine Regel: Wenn ollama run

länger als 30 Sekunden lädt und die erste Antwort nach einer Minute kommt —

ist das Modell zu groß für dein System. Erwarte nicht, dass es sich „aufwärmt“ —

schließe es und wähle ein kleineres Modell.

Vergleich von Modellen nach Größe, Qualität und Aufgaben —

im Artikel Top 10 Ollama-Modelle 2026: Welches soll man wählen.

Fazit: Ich habe das selbst durchgemacht — ich dachte, ein größeres

Modell würde bessere Ergebnisse liefern, habe 13B heruntergeladen, eine Minute auf die erste Antwort gewartet und es gelöscht. Habe 3B installiert — und die Leistung stieg sofort.

Auf 8 GB ist die bessere Strategie, ein Modell zu wählen, das schnell und stabil läuft,

als sich mit einem zu quälen, das „fast passt“.

🎯 Tests: Was ist in der Praxis zu erwarten

Kurze Antwort:

Auf einem Mac M1 mit 8 GB liefert das 3B-Modell 20–30 Token/Sek., das 7B-Modell 10–15 tok/s.

Auf einem reinen CPU-Windows-System ist es zwei- bis dreimal langsamer.

Unten finden Sie eine zusammenfassende Tabelle zur Orientierung.

Benchmarks im Internet werden oft auf einem sauberen System ohne

andere Software durchgeführt. In der Realität – mit geöffnetem VS Code und 5 Chrome-Tabs –

werden die Zahlen niedriger sein. Daher sind diese Tests näher an der Realität.

Zusammenfassende Leistungstabelle

| Modell |

RAM |

Mac M1 8 GB |

Nur CPU 8 GB |

RTX 4060 8 GB VRAM |

| Gemma 2B (Q4) |

~1.6 GB |

~30 tok/s |

~10 tok/s |

~50+ tok/s |

| Phi-3 Mini 3.8B (Q4) |

~2.3 GB |

~25 tok/s |

~8 tok/s |

~45 tok/s |

| Llama 3.2 3B (Q4) |

~2 GB |

~28 tok/s |

~9 tok/s |

~48 tok/s |

| Qwen 2.5 Coder 3B (Q4) |

~2.2 GB |

~25 tok/s |

~8 tok/s |

~45 tok/s |

| Llama 3.1 8B (Q4) |

~4.5 GB |

~12 tok/s |

~4 tok/s |

~40 tok/s |

| DeepSeek R1 8B (Q4) |

~5 GB |

~10 tok/s |

~3 tok/s |

~35 tok/s |

Daten sind Richtwerte, basierend auf den Ergebnissen von

LocalLLM.in,

SitePoint

und LocalAIMaster.

Die tatsächliche Geschwindigkeit hängt von der Systemauslastung, der Größe des Kontextfensters

und Hintergrundprozessen ab.

Was bedeuten diese Zahlen in der Praxis?

- ✔️ 15+ tok/s: komfortabler interaktiver Chat – die Antwort erscheint schneller, als Sie sie lesen können

- ✔️ 8–15 tok/s: man kann damit arbeiten, aber bei langen Antworten spürt man eine Verzögerung

- ⚠️ 3–6 tok/s: akzeptabel für einmalige Aufgaben (Debugging, Analyse), frustrierend bei aktivem Chatten

- ❌ <3 tok/s: das Modell ist zu groß für dieses System

Fazit: Für die tägliche Arbeit auf einem 8-GB-System orientieren Sie sich

an 3B-Modellen – sie liefern 20+ tok/s auf Apple Silicon und lassen das

System reaktionsfähig. 7–8B-Modelle sind für spezifische Aufgaben, wenn

Sie bereit sind, alles Überflüssige zu schließen und zu warten.

❓ Häufig gestellte Fragen (FAQ)

Kann ich Ollama auf einem Laptop mit 8 GB RAM ausführen?

Ja. Modelle mit 1–3 Milliarden Parametern (Phi-3 Mini, Llama 3.2 3B, Gemma 2B)

laufen komfortabel auf jedem System mit 8 GB. Modelle mit 7–8 Milliarden

Parametern laufen am Limit – Sie müssen unnötige Programme schließen.

Mehr Details finden Sie im

Leitfaden zur Installation von Ollama.

Welches ist das beste Modell für 8 GB RAM?

Das hängt von der Aufgabe ab. Für Code – Qwen 2.5 Coder 3B.

Für Text und Chat – Llama 3.2 3B oder Phi-3 Mini.

Für Reasoning und Debugging – DeepSeek R1 8B (am Limit von 8 GB).

Ein vollständiger Vergleich der Modelle finden Sie im Artikel Top-10 Ollama-Modelle im Jahr 2026.

Benötige ich eine GPU für Ollama?

Nein, Ollama läuft auch auf der CPU. Aber mit einer GPU (dediziert oder Apple Silicon)

ist die Geschwindigkeit 3- bis 10-mal höher. Auf einem reinen CPU-System mit 8 GB

halten Sie sich an Modelle mit 3B und kleiner für komfortables Arbeiten.

Was ist besser: ein 7B-Modell in Q2 oder ein 3B-Modell in Q4?

Fast immer – 3B in Q4. Aggressive Quantisierung (Q2) reduziert die

Qualität der Antworten erheblich, insbesondere bei komplexen Aufgaben.

Ein kleineres Modell mit normaler Quantisierung liefert ein besseres Ergebnis.

Kann Ollama auf 8 GB ChatGPT ersetzen?

Für alltägliche Aufgaben – Zusammenfassungen, einfache Fragen, Code-Generierung –

ja. Für komplexe Analysen, multimodale Aufgaben und die Arbeit mit großem

Kontext – Cloud-Modelle sind bisher stärker.

Der optimale Ansatz ist ein hybrider:

Ollama für regelmäßige Aufgaben, ChatGPT/Claude für komplexe.

Mehr Details finden Sie im Artikel Ollama vs ChatGPT vs Claude: Wann lokales KI besser ist.

Wie viel Speicherplatz wird benötigt?

Ein 3B-Modell in Q4 benötigt etwa 2 GB Speicherplatz. Drei Modelle für verschiedene

Aufgaben – 6–8 GB. Ollama speichert Modelle in ~/.ollama.

Heruntergeladene Modelle können mit dem Befehl ollama rm modellname gelöscht werden.

Lohnt sich ein Upgrade auf 16 GB?

Wenn Sie planen, regelmäßig mit lokaler KI zu arbeiten – definitiv ja.

16 GB ermöglichen den Zugriff auf 13–14B-Modelle, vollwertige 7B in Q8-Qualität

und komfortables Arbeiten mit großen Kontextfenstern.

Der Unterschied in den Möglichkeiten zwischen 8 und 16 GB ist der größte im gesamten Spektrum.

✅ Schlussfolgerungen

8 GB Arbeitsspeicher sind kein Urteil für lokales KI,

aber es ist eine Grenze, die bewusste Entscheidungen erfordert. Hier sind die wichtigsten Punkte:

- ✔️ 3B-Modelle – Komfortzone: Phi-3 Mini, Llama 3.2 3B, Gemma 2B laufen schnell und stabil und lassen Platz für IDE und Browser

- ✔️ 7–8B-Modelle – Arbeitszone: DeepSeek R1 8B, Qwen 3 8B laufen am Limit, liefern aber spürbar bessere Qualität für spezifische Aufgaben

- ✔️ Q4_K_M – die einzig sinnvolle Quantisierungswahl auf 8 GB: ein kleineres Modell mit Q4 ist immer besser als ein größeres mit Q2

- ✔️ Apple Silicon mit 8 GB – die beste Budget-Option: Unified Memory bietet einen Vorteil gegenüber reinen CPU-Systemen

- ✔️ 13B+ Modelle, Q8, zwei Modelle gleichzeitig – nicht empfehlenswert: getestet, funktioniert nicht

Ich selbst nutze genau diesen Ansatz: Ich halte mehrere Modelle

für verschiedene Aufgaben – eines für Code, ein anderes für Text, ein separates für Debugging.

Jedes Modell hat seine Stärke, und anstelle eines großen, das nicht in den Speicher passt,

ist es besser, 2–3 spezialisierte leichte Modelle zu haben.

Das Umschalten zwischen ihnen über ollama run ist eine Sache von Sekunden.

Wenn Sie gerade erst anfangen –

installieren Sie Ollama mit

unserem Leitfaden,

laden Sie phi3:mini herunter und probieren Sie es aus.

In fünf Minuten haben Sie ein funktionierendes lokales KI –

ohne Abonnements, ohne Internet, ohne Datenübertragung nach außen.

Und wenn Sie eine Website, einen Blog oder eine Webanwendung mit integrierter

KI-Funktionalität benötigen –

kontaktieren Sie uns bei WebsCraft,

wir helfen Ihnen bei der Umsetzung.

📖 Quellen