Aktualisiert: 15. Mai 2026

Am 14. Mai 2026 wurde Ollama 0.24 veröffentlicht – und das ist kein weiterer Bugfix-Patch.

Diese Version fügt die offizielle Unterstützung für Codex App von OpenAI hinzu: Jetzt kann der KI-Coding-Agent für Desktops auf jedem lokalen oder Cloud-Modell über Ollama ausgeführt werden.

Ein Befehl – und Codex funktioniert mit Ihren Modellen, ohne dass ein OpenAI-Abonnement erforderlich ist.

→ Offizielle Dokumentation zu Ollama Codex App lesen

Wenn Sie Ollama noch nicht kennen – beginnen Sie mit dem

Installationsleitfaden für Mac, Windows und Linux.

Wenn Sie an einem Vergleich von Modellen für Coding-Aufgaben interessiert sind – lesen Sie

die Top Ollama-Modelle im Jahr 2026.

📚 Artikelinhalt

🎯 Was hat sich geändert: Warum Ollama 0.24 – mehr als nur ein Patch

Kurze Antwort: Ollama 0.24 ist die erste Version, die Ollama

von einem Werkzeug zum Ausführen von Modellen zu einer Plattform für KI-Coding-Agenten macht.

Codex App läuft jetzt über Ollama genauso wie über die OpenAI API – nur die Modelle sind lokal oder in der Cloud Ihrer Wahl.

Vor Ollama 0.24 funktionierte Codex App ausschließlich über die OpenAI API und erforderte ein Plus- oder Pro-Abonnement.

Jetzt reicht es aus, Ollama installiert zu haben und einen Befehl – und Codex erhält Zugriff auf jedes lokale Modell.

Was ist neu in Ollama 0.24 laut offizieller GitHub-Veröffentlichung:

- ✔️ Codex App Integration – Offizielle Unterstützung für die Desktop-App Codex über

ollama launch codex-app

- ✔️ MLX Memory Trace Logging – Protokollierung der Speichernutzung für Modelle auf Apple Silicon

- ✔️ Verbesserter MLX Sampler – Höhere Generierungsqualität auf Mac M-Serie

- ✔️ Zuverlässigere Updates – Probleme mit automatischen Updates der Ollama App behoben

- ✔️ Caching von Antworten für den Befehl

ollama show – Schnellerer Start

Aber das Wichtigste ist nicht die Liste der Funktionen. Das Wichtigste ist die Änderung des Konzepts.

Früher war Ollama die Antwort auf die Frage „Wie starte ich ein Modell lokal?“.

Jetzt wird es zur Antwort auf die Frage „Wie starte ich einen KI-Coding-Agenten lokal?“.

Codex App, Claude Code, OpenCode, Copilot CLI – all diese können jetzt über ollama launch gestartet werden.

Dies ist eine grundlegend andere Ebene: nicht nur die Ausführung von Prompts, sondern ein vollwertiger Agent

mit Zugriff auf das Repository, das Terminal, den Browser und einen Aufgabenzyklus.

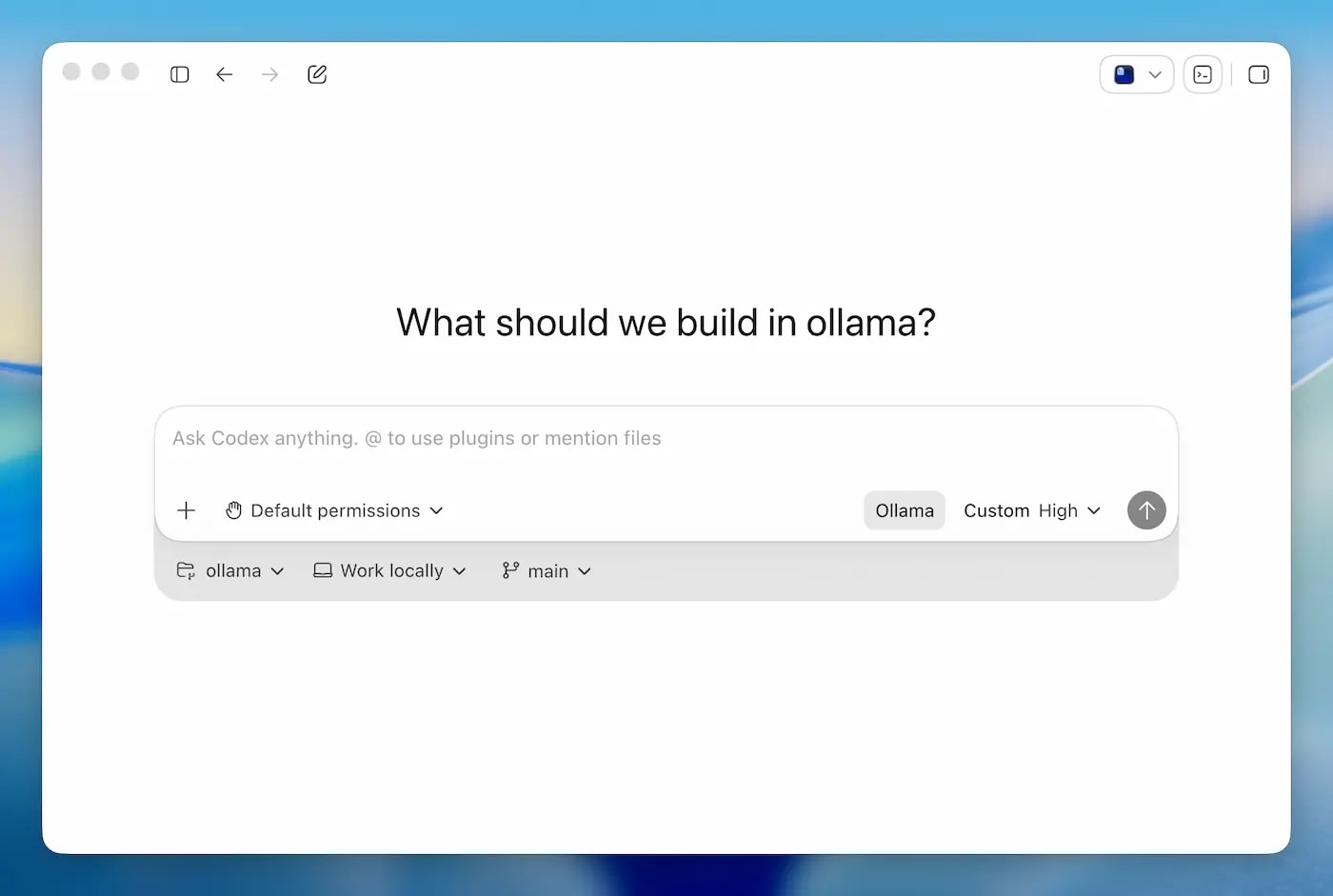

🎯 Wie Codex App funktioniert: Kein IDE, sondern ein KI-Agent mit Benutzeroberfläche

Kurze Antwort: Codex App ist eine Desktop-Anwendung von OpenAI für macOS und Windows.

Kein IDE-Plugin, keine Code-Vervollständigung. Es ist ein autonomer Agent,

der eine Aufgabe erhält, einen Plan erstellt, Schritte ausführt, Code ausführt und das Ergebnis zurückgibt.

Der Unterschied zwischen Copilot und Codex App: Copilot vervollständigt eine Codezeile, während Sie tippen.

Codex App erhält die Aufgabe „OAuth-Authentifizierung hinzufügen“ und schreibt selbst den Code,

führt Tests aus, behebt Fehler – ohne Ihre Beteiligung bei jedem Schritt.

⚠️ Wichtig aus persönlicher Erfahrung: Nur weil der Agent „selbst Code schreibt“, heißt das nicht, dass er ihn richtig schreibt.

In der Praxis ignorieren KI-Coding-Agenten oft SOLID-Prinzipien, erstellen God Objects,

vermischen Logik in einer Klasse oder generieren funktionierenden, aber hässlichen Code, ohne Ihre Architektur zu verstehen.

Meine Regel: Betrachten Sie das Ergebnis von Codex App als Entwurf, nicht als fertigen Code.

Der Agent ist gut darin, mechanische Arbeit zu erledigen – Boilerplate-Code schreiben, Tests abdecken,

Refactoring nach einer klaren Aufgabe durchführen. Aber architektonische Entscheidungen – Single Responsibility,

korrekte Schichtentrennung, Dependency Injection – erfordern Ihre Kontrolle.

Praktischer Ansatz: Beschreiben Sie dem Agenten vor der Ausführung einer Aufgabe die architektonischen Einschränkungen im Prompt.

Zum Beispiel: „Verwenden Sie das Repository-Pattern, eine separate Service-Schicht vom Controller, legen Sie keine Geschäftslogik in Entities.“

Ohne dies wählt der Agent den einfachsten Weg – und das ist nicht unbedingt der richtige.

Die Interaktionsarchitektur nach der Verbindung mit Ollama sieht so aus:

- Codex App sendet Anfragen an den Ollama OpenAI-kompatiblen Endpunkt (

http://localhost:11434/v1)

- Ollama leitet die Anfrage an das ausgewählte Modell weiter – lokal oder in der Cloud

- Das Modell gibt eine Antwort im Format Tool Calling / Function Calling zurück

- Codex App interpretiert die Antwort, führt Aktionen aus (schreibt Dateien, führt Befehle aus)

- Das Ergebnis der Ausführung wird als Kontext für den nächsten Schritt an das Modell zurückgegeben

Worin unterscheidet sich dies von Cursor oder Copilot Chat:

- Cursor – ist in den Editor integriert und hilft beim Schreiben von Code. Codex App ist eine separate Anwendung, die Aufgaben asynchron ausführt.

- Copilot – bietet Code-Vervollständigung und Chat. Codex App – vollständiger Ausführungskreislauf: Plan → Code → Ausführung → Überprüfung → Korrektur.

- Claude Code – CLI-Agent im Terminal. Codex App – Desktop-Anwendung mit grafischer Benutzeroberfläche, Browser und Review-Modus.

Für die Arbeit von Codex App wird ein Modell mit zuverlässigem Tool Calling benötigt.

Deshalb ist die Wahl des Modells entscheidend – wir werden dies unten ausführlich behandeln.

Wenn Sie die Mechanik des Tool Calling tiefer verstehen möchten –

lesen Sie welche Ollama-Modelle Tool Calling unterstützen: Tests und Benchmarks 2026.

🎯 Schritt-für-Schritt-Installation: ollama launch codex-app

Kurze Antwort: Drei Schritte – Ollama aktualisieren, Codex App installieren, einen Befehl ausführen.

Ollama konfiguriert Codex automatisch für die Verwendung des lokalen Endpunkts.

Offizielle Ollama-Dokumentation zur Integration mit Codex App –

Unterstützung verfügbar ab Version v0.24.0 und neuer.

Schritt 1. Ollama auf Version 0.24.0+ aktualisieren

Überprüfe die aktuelle Version:

ollama --version

Wenn die Version niedriger als 0.24.0 ist – aktualisieren:

# macOS und Linux

curl -fsSL https://ollama.com/install.sh | sh

# Windows – Lade den neuen Installer von https://ollama.com/download herunter

Schritt 2. Codex App installieren

Lade die Desktop-Anwendung Codex App für macOS oder Windows von der offiziellen OpenAI-Website herunter:

developers.openai.com/codex/quickstart.

Öffne die Codex App nach der Installation mindestens einmal manuell.

Dies ist notwendig, damit die Anwendung ihre Konfigurationsdateien initialisiert.

Schließe sie nach dem ersten Öffnen.

Schritt 3. Über Ollama starten

ollama launch codex-app

Ollama konfiguriert die Codex App automatisch für die Verwendung seines OpenAI-kompatiblen Endpunkts

und öffnet die Anwendung. Die Konfiguration wird gespeichert – beim nächsten Mal wird Codex mit deinem Modell geöffnet.

Sofort mit einem bestimmten Modell starten:

# Cloud-Modell mit Vision-Unterstützung

ollama launch codex-app --model kimi-k2.6:cloud

# Lokales Modell

ollama launch codex-app --model qwen3:14b

# Lokal mit geringerem RAM-Verbrauch

ollama launch codex-app --model gemma4:4b

Codex-Originaleinstellungen wiederherstellen

Wenn du Codex App zu einem früheren Profil zurückkehren möchtest (z. B. zurück zum OpenAI API):

ollama launch codex-app --restore

Bevor die Konfiguration überschrieben wird, speichert Ollama automatisch ein Backup in

~/.ollama/backup/codex-app/ (unter Windows ist ~ = das Profilordner des Benutzers).

⚠️ Typische Probleme und Lösungen

| Problem |

Ursache |

Lösung |

| Codex App öffnet sich nach dem Befehl nicht |

Die Anwendung wurde noch nicht initialisiert |

Öffne Codex einmal manuell, dann führe ollama launch codex-app erneut aus |

| Codex wechselt das Modell nicht |

Die Anwendung läuft bereits und wurde nicht neu geladen |

Erlaube Ollama, Codex neu zu starten, wenn es fragt, oder schließe es manuell und führe den Befehl erneut aus |

| Modell nicht gefunden |

Das Modell ist nicht lokal heruntergeladen |

Zuerst ollama pull modellname, dann ollama launch codex-app |

| Langsame Antwort oder Timeout |

Das Modell ist zu groß für die Hardware oder ein Kaltstart |

Wähle ein kleineres Modell oder warte auf das erste Laden |

Wichtig: Das Profil von Codex App (ollama launch codex-app) und das Profil von Codex CLI

(ollama launch codex) sind getrennt. Änderungen an einem beeinflussen das andere nicht.

🎯 Welches Modell für Codex wählen: Vergleich nach Aufgaben

Kurze Antwort: Codex App ist ein Agent mit Tool Calling und einem mehrstufigen Ausführungsschleifen.

Dafür wird ein Modell mit *zuverlässigem* Tool Calling benötigt, nicht nur eines, das es "unterstützt".

Schwaches Tool Calling = der Agent stoppt mitten in der Aufgabe oder gibt Text anstelle von JSON zurück.

Eine vollständige Liste der Ollama-Modelle mit Tool Calling-Unterstützung und ein Vergleich der Zuverlässigkeit –

im Artikel Welche Ollama-Modelle unterstützen Tool Calling: Tests und Benchmarks 2026.

Ollama empfiehlt die folgenden Modelle für Codex in seinem Newsletter (Mai 2026):

Cloud-Modelle (über Ollama Cloud)

| Modell |

Besonderheit |

Wann wählen |

kimi-k2.6:cloud |

Vision-Unterstützung (sieht Screenshots) |

Wenn UI annotiert oder per Screenshot debuggt werden muss |

glm-5.1:cloud |

Gut im Code, schnell |

Für allgemeine Coding-Aufgaben mit Cloud-Qualität |

Lokale Modelle (ohne Ollama Cloud-Abonnement)

| Modell |

RAM |

Tool Calling |

Wann wählen |

qwen3:14b |

~9 GB |

Ausgezeichnet |

Optimaler Kompromiss zwischen Qualität und RAM für die meisten Aufgaben |

qwen3:8b |

~5 GB |

Gut |

Wenn RAM begrenzt ist, aber akzeptable Qualität benötigt wird |

gemma4:31b |

~20 GB |

Ausgezeichnet |

Maximale lokale Qualität, leistungsstarker Mac erforderlich |

gemma4:4b |

~3 GB |

Akzeptabel |

Schwache Hardware, einfache Aufgaben |

nemotron-3-super:cloud |

Cloud |

Ausgezeichnet |

Alternative ohne kostenpflichtiges Ollama Cloud-Abonnement |

Modell vor dem Start herunterladen:

# Empfohlen für die meisten

ollama pull qwen3:14b

# Wenn RAM weniger als 10 GB beträgt

ollama pull qwen3:8b

# Maximale lokale Qualität

ollama pull gemma4:31b

Mehr über die Auswahl von Modellen für spezifische Hardware –

lies Ollama auf schwacher Hardware: Was läuft auf 8 GB RAM.

Schlüsselkriterium: Zuverlässigkeit des Tool Callings

Für Agentenaufgaben – schaue nicht nur auf die Größe oder die "allgemeine Qualität" des Modells.

Das Wichtigste: Gibt das Modell bei einem Tool Call korrektes JSON zurück, "halluziniert" es keine Argumente,

verarbeitet es Multi-Step-Tool-Loops korrekt.

Wenn ein Modell Tool Calling nicht ordnungsgemäß unterstützt – beginnt es, Argumente zu erfinden,

ignoriert es die Aufgabenbedingungen oder antwortet einfach mit Text, wo ein strukturierter Aufruf erwartet wird.

Ergebnis: Der Agent geht in die falsche Richtung und du verschwendest Zeit mit Korrekturen anstatt mit Arbeit.

Aus persönlicher Erfahrung – Praxis mit zwei Modellen: Ich verwende zwei Modelle parallel.

Ein schnelles Modell (llama3.2:3b) deckt ~70% der Aufgaben ab und antwortet in 1-2 Sekunden –

übliche Fragen, Generierung von Boilerplate, kurze Antworten.

Wenn präzise Prompt-Einhaltung, komplexes Tool Calling oder ein mehrstufiger Agent erforderlich sind –

wechsle ich zu qwen3:8b oder einem größeren Modell.

Nach einer komplexen Aufgabe – wechsle ich zurück zum schnellen Modell. 8-12 Sekunden auf jede Antwort

im normalen Betriebsmodus zu warten – ist zu lang.

Dieser Ansatz bietet ein Gleichgewicht zwischen Geschwindigkeit und Qualität – du musst nicht jedes Mal warten,

bis ein großes Modell für einfache Anfragen "aufgewärmt" ist.

🎯 Integrierter Browser und Review Mode: Was das praktisch bringt

Kurze Antwort: Zwei Funktionen, die Codex App von CLI-Agenten unterscheiden –

ein integrierter Browser mit Anmerkungen und ein Code-Review-Modus.

Laut offizieller Dokumentation existieren und funktionieren sie tatsächlich.

Wie gut – hängt vom Modell und der Komplexität der Aufgabe ab.

Integrierter Browser

Laut der offiziellen Ollama-Dokumentation

kann Codex App lokale Server und Websites in einem integrierten Browser öffnen –

und erlaubt, Anmerkungen direkt auf der Seite als Kontext für den Agenten zu hinterlassen.

Auf dem Papier sieht das praktisch aus: Öffne einen lokalen Dev-Server, markiere ein Element,

schreibe einen Kommentar – und der Agent versteht, was ohne zusätzliche Beschreibung korrigiert werden muss.

⚠️ Ehrlich über Einschränkungen: Das Ergebnis hängt stark davon ab,

wie genau der Agent deine Anmerkung und den Seitenkontext interpretiert.

Für einfache UI-Änderungen – funktioniert es nicht schlecht. Für komplexere Szenarien

(Bug in der Logik, nicht im Layout) – ersetzt die Browser-Anmerkung keinen klaren Prompt.

Vision-Fähigkeiten (wenn das Modell einen Screenshot buchstäblich "sieht") sind

nur mit Modellen verfügbar, die Vision unterstützen – zum Beispiel kimi-k2.6:cloud.

Mit lokalen Textmodellen liest der Agent HTML, nicht Bilder.

Review Mode

Laut Dokumentation

ermöglicht der Review Mode, Code-Änderungen direkt in der Codex App anzuzeigen,

Kommentare zu bestimmten Zeilen zu hinterlassen und den Agenten zu bitten, diese zu verfeinern.

Prinzipiell ist dies derselbe Workflow wie bei einem GitHub PR Review –

aber ohne die Anwendung zu verlassen. Der Agent sieht seinen eigenen Diff und deinen Kommentar

im selben Kontext, was die Menge der Erklärungen reduziert.

⚠️ Ehrlich über Einschränkungen: Der Review Mode ist nützlich, wenn der Agent

etwas nahe am Richtigen gemacht hat und Details korrigiert werden müssen.

Wenn der Agent architektonisch grundsätzlich falsch lag –

ersetzen Kommentare im Review keine Neuformulierung der Aufgabe von Grund auf.

Dies ist ein Werkzeug für Verfeinerungen, nicht für die Korrektur grundlegender Fehler.

🎯 Einschränkungen des lokalen Ansatzes: Wo Cloud-Codex punktet

Kurze Antwort: Lokaler Codex über Ollama – das ist Privatsphäre, Offline-Betrieb und keine Abonnements.

Aber es gibt Aufgaben, bei denen der Cloud-basierte OpenAI Codex (auf GPT-4o oder GPT-5.5) merklich besser sein wird.

Es ist wichtig, diese Grenzen zu kennen – um keine Zeit mit Aufgaben zu verschwenden, bei denen ein lokales Modell nicht zurechtkommt.

Mehr über Szenarien, in denen Ollama Cloud-APIs übertrifft und wo es verliert –

lies Ollama vs ChatGPT vs Claude: Welche Aufgabe erfordert die Cloud.

| Kriterium |

Lokaler Codex (Ollama) |

Cloud-Codex (OpenAI) |

| Code-Privatsphäre |

✅ Code verlässt die Maschine nicht |

⚠️ Code wird an OpenAI-Server gesendet |

| Offline-Betrieb |

✅ Vollständig offline (lokale Modelle) |

❌ Internet erforderlich |

| Kosten |

✅ Kostenlos nach Anschaffung der Hardware |

⚠️ Abonnement oder Bezahlung pro Token |

| Qualität bei komplexen Aufgaben |

⚠️ Abhängig von Modell und Hardware |

✅ GPT-5.5 – stärker bei Architekturaufgaben |

| Kontextfenster |

⚠️ Begrenzt durch RAM (typischerweise 8k–32k) |

✅ Bis zu 128k+ Token |

| Geschwindigkeit bei großen Repos |

⚠️ Langsamer auf CPU oder schwacher GPU |

✅ Stabile Geschwindigkeit unabhängig von der Hardware |

| Vision (Screenshots) |

⚠️ Nur mit kimi-k2.6:cloud oder gemma4 |

✅ Native Unterstützung in GPT-4o / GPT-5.5 |

| Parallele Aufgaben (Aufgabenbaum) |

✅ Unterstützt |

✅ Unterstützt |

Wo lokaler Codex klar punktet

- Privater oder kommerzieller Code – wenn Code nicht an externe Server gesendet werden darf

- Wiederkehrende Aufgaben – Refactoring, Schreiben von Tests, Generierung von Boilerplate, wo die Qualität von GPT-4 nicht kritisch ist

- Offline-Umgebungen – Unternehmensnetzwerke ohne Internetzugang

- Kosten bei großen Volumina – wenn täglich Tausende von Token generiert werden, ist lokal günstiger

Mehr über die Vorteile von Self-Hosted AI →

Artikel lesen

Wo Cloud-Codex besser ist

- Große Repositories – wenn der Kontext nicht in 8–16k Token passt

- Komplexe Architektur – wo das Niveau von GPT-5.5 für die richtige Lösung benötigt wird

- Vision-Aufgaben – Analyse von UI-Screenshots ohne Cloud-Modell

- Schwache Hardware – wenn der Mac oder PC kein 14B-Modell bewältigt

🎯 Welches Setup ist optimal: Hardware, Modell, Einstellungen

Kurze Antwort: Für komfortables Arbeiten mit lokalem Codex werden mindestens 16 GB RAM benötigt.

8 GB sind möglich, aber eingeschränkt. Unten finden Sie konkrete Empfehlungen je nach Hardware.

Mac Apple Silicon (empfohlene Option)

| RAM |

Empfohlenes Modell |

Erwartete Geschwindigkeit |

| 8 GB |

qwen3:8b oder gemma4:4b |

~15–20 tok/s, einfache Aufgaben |

| 16 GB |

qwen3:14b — optimal |

~20–30 tok/s, die meisten Aufgaben |

| 32 GB |

gemma4:31b oder qwen3:32b |

~15–25 tok/s, komplexe Aufgaben |

| 64 GB+ |

qwen3:72b oder größer |

~10–20 tok/s, maximale Qualität lokal |

Windows / Linux mit NVIDIA GPU

| VRAM |

Empfohlenes Modell |

Hinweis |

| 8 GB |

qwen3:8b |

Vollständig im VRAM, schnell |

| 12 GB |

qwen3:14b (Q4) |

Passt bei Quantisierung Q4_K_M |

| 16 GB+ |

qwen3:14b oder gemma4:27b |

Komfortables Arbeiten ohne Swap |

| 24 GB+ |

gemma4:31b |

Maximale Qualität auf der GPU |

Optimales Befehlsset für den Start

# 1. Ollama aktualisieren

curl -fsSL https://ollama.com/install.sh | sh

# 2. Modell herunterladen (für 16 GB RAM)

ollama pull qwen3:14b

# 3. Codex App mit dem ausgewählten Modell starten

ollama launch codex-app --model qwen3:14b

# Beim nächsten Mal reicht einfach:

ollama launch codex-app

# Ollama merkt sich das ausgewählte Modell

Kontext-Einstellungen für große Repositories

Standardmäßig hängt das Kontextfenster von VRAM/RAM ab.

Für die Arbeit mit großen Dateien oder mehreren Dateien gleichzeitig —

kann der Kontext über Modelfile erhöht werden:

# Modelfile mit größerem Kontext erstellen

FROM qwen3:14b

PARAMETER num_ctx 16384

# Neues Modell erstellen

ollama create qwen3-codex -f Modelfile

# Codex mit diesem Modell starten

ollama launch codex-app --model qwen3-codex

Details zur Kontextverwaltung und Parameter-Einstellungen finden Sie im Artikel Ollama REST API: Integration in Ihre Anwendung.

⚙️ Erweiterte Einstellungen: Konfiguration, Umgebungsvariablen, Benchmarks

Für die meisten reicht ollama launch codex-app.

Aber wenn Sie mehr Kontrolle über das Verhalten des Agenten wünschen oder das

Maximum aus einem bestimmten Modell herausholen möchten — hier sind die manuellen Einstellungen.

1. Manuelles Bearbeiten von ~/.codex/config.toml

Die Hauptkonfiguration von Codex befindet sich unter dem Pfad:

~/.codex/config.toml — Mac / Linux

%USERPROFILE%\.codex\config.toml — Windows

⚠️ Wichtig: Wenn Sie ollama launch codex-app starten,

schreibt Ollama die erforderlichen Werte selbst in diese Datei und speichert ein Backup der vorherigen Einstellungen

in ~/.ollama/backup/codex-app/.

Manuelles Bearbeiten ist nur sinnvoll, wenn Sie Parameter ändern möchten, die im Standardstart nicht vorhanden sind —

zum Beispiel Temperatur oder System-Prompt.

Beispielkonfiguration für einen lokalen Ollama-Provider:

[model_providers.ollama]

name = "Ollama"

base_url = "http://localhost:11434/v1"

[profiles.local-coder]

model_provider = "ollama"

model = "qwen3:14b"

temperature = 0.3

⚠️ Beachten Sie: Die genaue Struktur der Konfigurationsdatei kann variieren

je nach Version von Codex App. Sehen Sie vor dem Bearbeiten nach, was bereits in Ihrer Datei vorhanden ist,

schreiben Sie nicht blindlings um. Der Parameter num_ctx wird möglicherweise nicht über config.toml unterstützt —

für die Änderung des Kontexts ist die Verwendung von Modelfile wie oben beschrieben zuverlässiger.

2. Ollama-Umgebungsvariablen

Ollama unterstützt eine Reihe offizieller Umgebungsvariablen für das Fine-Tuning.

Die vollständige Liste finden Sie in der offiziellen Ollama FAQ-Dokumentation.

Die nützlichsten für die Arbeit mit Codex:

| Variable |

Was sie tut |

Beispiel |

OLLAMA_HOST |

Adresse und Port des Ollama-Servers |

0.0.0.0:11434 |

OLLAMA_KEEP_ALIVE |

Wie lange das Modell im Speicher gehalten werden soll |

30m oder -1 |

OLLAMA_NUM_PARALLEL |

Anzahl paralleler Anfragen |

2 |

OLLAMA_FLASH_ATTENTION |

Flash Attention für Apple Silicon |

1 |

OLLAMA_NUM_GPU |

Anzahl der GPU-Schichten für Offload |

99 (alle Schichten) |

Vor dem Start festlegen:

# macOS / Linux

OLLAMA_KEEP_ALIVE=30m OLLAMA_FLASH_ATTENTION=1 ollama launch codex-app

# oder dauerhaft über ~/.zshrc / ~/.bashrc

export OLLAMA_KEEP_ALIVE=30m

export OLLAMA_FLASH_ATTENTION=1

3. Benchmarks: Wie viel lokale Modelle wirklich leisten

⚠️ Haftungsausschluss: Die genauen SWE-bench-Zahlen werden ständig aktualisiert

und hängen stark von der Testkonfiguration ab. Die folgenden Daten sind Richtwerte,

prüfen Sie die aktuellen Werte auf swebench.com

und in den offiziellen Modell-Releases.

| Modell |

SWE-bench Verified (ungefähr) |

Wo ausführen |

| GPT-5.5 / Claude Sonnet 4.6 (Cloud) |

~68–73% |

OpenAI / Anthropic API |

gpt-oss:120b über Ollama |

~62% |

Lokal, benötigt 64+ GB RAM |

glm-5.1:cloud / große Qwen3 |

~58–68% |

Ollama Cloud oder lokal 32B+ |

qwen3:14b lokal |

nicht offiziell getestet |

16 GB RAM, gut für Routineaufgaben |

Was bedeutet das praktisch: Lokale Modelle der Größe 14B–32B

bewältigen Routine-Coding-Aufgaben gut — Refactoring, Schreiben von Tests,

Generierung von Boilerplate. Bei komplexen agentischen Aufgaben, die tiefes Reasoning über mehrere Dateien hinweg erfordern,

sind Cloud-Modelle merklich überlegen.

Für die meisten realen Aufgaben ist der Unterschied nicht so kritisch, wie die Prozentzahlen vermuten lassen.

❓ Häufig gestellte Fragen (FAQ)

Benötige ich ein OpenAI-Abonnement, um Codex App mit Ollama zu verwenden?

Nein. Ollama konfiguriert Codex App für seinen lokalen Endpunkt.

Ein OpenAI-Abonnement ist nur erforderlich, wenn Sie OpenAI-Cloud-Modelle verwenden möchten.

Für lokale Modelle ist kein Abonnement erforderlich.

Ist Codex App nur für macOS verfügbar?

Nein. Codex App von OpenAI ist für macOS und Windows verfügbar.

Ollama 0.24 unterstützt die Integration auf beiden Plattformen.

Linux wird derzeit nicht von Codex App selbst unterstützt.

Was ist der Unterschied zwischen ollama launch codex-app und ollama launch codex?

ollama launch codex-app — startet die Desktop-Anwendung Codex App mit grafischer Benutzeroberfläche.

ollama launch codex — startet die Codex CLI im Terminal.

Dies sind separate Profile, die Änderung des einen beeinflusst den anderen nicht.

Werden meine Konfigurationen gespeichert, wenn ich ollama launch codex-app starte?

Ja. Ollama speichert ein Backup der ursprünglichen Codex App-Konfigurationen in ~/.ollama/backup/codex-app/

vor allen Änderungen. Wiederherstellen können Sie mit dem Befehl ollama launch codex-app --restore.

Welches Modell soll ich wählen, wenn ich es mit minimalen Anforderungen ausprobieren möchte?

Für den Anfang — qwen3:8b (benötigt ~5 GB RAM) oder gemma4:4b (~3 GB RAM).

Sie unterstützen Tool Calling und liefern eine akzeptable Qualität für einfache Aufgaben.

Für ernsthafte Arbeit empfehlen wir qwen3:14b mit 16 GB RAM.

Kann Codex App über Ollama Aufgaben parallel ausführen (Task Tree)?

Ja, Task Tree ist eine Funktionalität von Codex App selbst und hängt nicht davon ab, welches Modell sich darunter befindet.

Die parallele Ausführung von Aufgaben belastet das Modell jedoch und erfordert mehr RAM.

Mit 8 GB können parallele Aufgaben zu einer spürbaren Verlangsamung führen.

Sieht Codex App mein gesamtes Repository?

Codex App greift auf das Repository zu, das Sie in der Anwendung öffnen.

Bei lokalen Modellen — wird kein Code nach außen gesendet.

Bei Cloud-Modellen von Ollama Cloud (kimi-k2.6:cloud, glm-5.1:cloud) — laufen Anfragen über Ollama Cloud.

✅ Schlussfolgerungen

Ich habe Ollama 0.24 + Codex App direkt nach der Veröffentlichung ausprobiert — und mein Eindruck ist gemischt,

aber insgesamt positiv. Es funktioniert wirklich: ein Befehl und Codex App beginnt,

ein lokales Modell anstelle der OpenAI API zu verwenden. Für privaten Code oder Offline-Umgebungen — das reicht bereits zum Ausprobieren.

Aber es ist wichtig zu verstehen, dass dies kein "Ersatz" für Cloud-Codex ist, sondern ein anderes Werkzeug mit anderen Kompromissen. Hier ist, was ich aus der Praxis mitgenommen habe:

- ✔️ Installation ist einfach: Ollama auf 0.24 aktualisieren, Codex App installieren,

ollama launch codex-app ausführen — das war's.

- ✔️ Das Modell entscheidet alles: Für die meisten Aufgaben mit 16 GB RAM nehme ich

qwen3:14b — zuverlässiges Tool Calling und akzeptable Geschwindigkeit.

- ⚠️ Zwei Modelle sind besser als eins: Ein schnelles (

llama3.2:3b) für 70% der Aufgaben, ein größeres — wenn die Genauigkeit des Tool Callings benötigt wird. 8–12 Sekunden auf jede einfache Antwort zu warten — zu lange für normale Arbeit.

- ⚠️ Der Agenten-Code ist ein Entwurf: Codex schreibt funktionierenden Code, aber oft ohne Verständnis von SOLID und Ihrer Architektur. Überprüfen Sie immer das Ergebnis, besonders wenn die Aufgabe mehrere Schichten der Anwendung betrifft.

- ✔️ Integrierter Browser und Review Mode — praktisch für einfache UI-Änderungen und Klärungen nach abgeschlossener Aufgabe. Für komplexe Architekturprobleme ersetzen sie keinen normalen Prompt.

- ✔️ Der lokale Ansatz gewinnt bei privatem Code, Offline-Umgebungen und großen Generierungsmengen, wo die Cloud teuer ist.

- ⚠️ Cloud-Codex ist besser bei großen Repositories, wo der Kontext lokal nicht hineinpasst, und bei Aufgaben, die die Qualität von GPT-5.5 erfordern.

Mein Fazit: Ollama 0.24 + Codex App — ein nützliches Werkzeug, wenn man es richtig versteht.

Nicht als autonomer Entwickler, der alles selbst macht, sondern als schneller Weg, einen Entwurf zu schreiben

oder Routineaufgaben abzudecken — Refactoring, Tests, Boilerplate.

Architektur und Code-Review bleiben Ihnen überlassen.

Wenn Sie verstehen möchten, wie Tool Calling unter der Haube von Codex funktioniert —

lesen Sie welche Ollama-Modelle Tool Calling unterstützen: Tests und Benchmarks 2026.

Wenn Sie an einer vollständigen RAG-Pipeline über Ollama interessiert sind —

RAG mit Ollama: von der Pipeline bis zur Produktion.

📖 Quellen