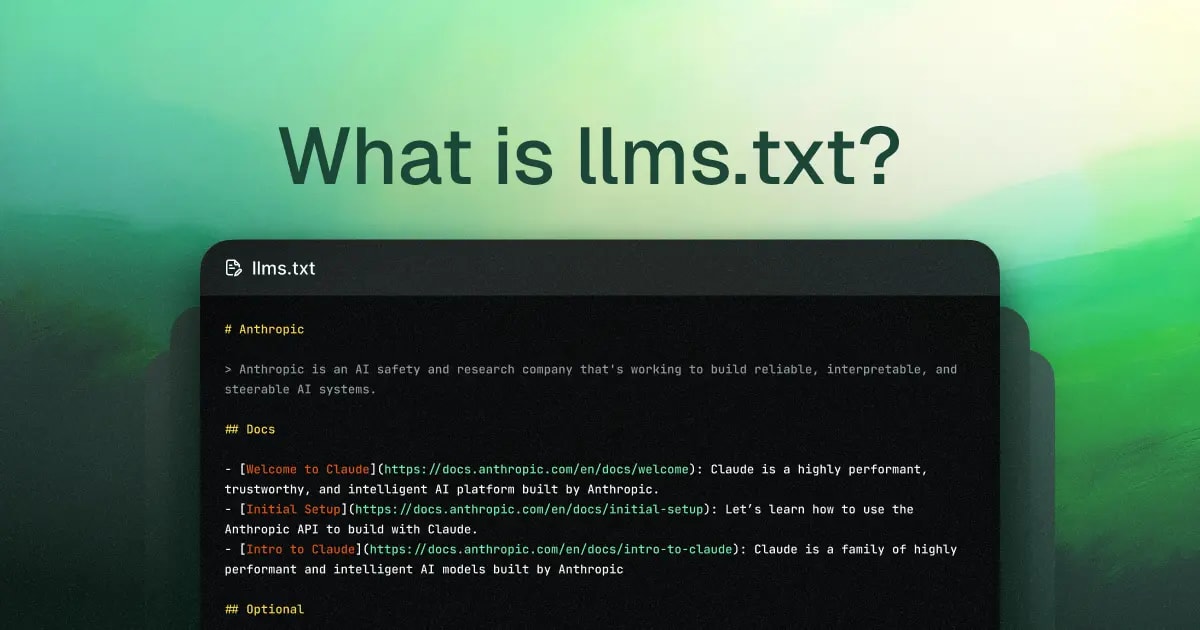

Beispiele llms.txt

Der beste Weg, um zu verstehen, wie llms.txt in der Praxis funktioniert, ist, sich reale Implementierungen anzusehen. Unten gebe ich einige hochwertige Beispiele: vom offiziellen Mock-Beispiel von llmstxt.org über das klassische FastHTML (das oft als Maßstab zitiert wird) bis hin zu Ihrer eigenen Website kazkiua.com. Jedes Beispiel wird kurz analysiert: Was ist gut gemacht, warum ist es für LLMs effektiv und welche Elemente sollte man übernehmen.

Alle Beispiele stammen direkt aus Live-Dateien (Stand 2026) und ich empfehle, sie im Browser zu öffnen, um sie vollständig anzuzeigen.

1. Offizielles Mock-Beispiel von llmstxt.org (Basisschablone)

Dies ist das minimale empfohlene Grundgerüst, das die obligatorische Struktur zeigt. Es ist einfach, enthält aber bereits Schlüsselelemente: H1, Blockquote, zusätzlicher Text, H2-Abschnitte und Optional.

# Title> Optional description goes here

Optional details go here

## Section name

- [Link title](https://link_url): Optional link details

## Optional

- [Link title](https://link_url)

Analyse: Ideal für Anfänger – zeigt klar die Priorität (zuerst das Wesentliche, dann Optional zur Kontextersparnis). Das Fehlen von Überflüssigem macht es token-effizient. Ich empfehle, es als Startschablone für jedes Projekt zu verwenden.

2. FastHTML (https://www.fastht.ml/docs/llms.txt) – Klassisches Beispiel vom Autor des Standards

Jeremy Howard (fast.ai / Answer.AI) nutzt sein Projekt als Demonstration. Dies ist eines der ersten und qualitativ hochwertigsten Beispiele, das in der Community aktiv zitiert wird.

# FastHTML> FastHTML is a python library which brings together Starlette, Uvicorn, HTMX, and fastcore's `FT` "FastTags" into a library for creating server-rendered hypermedia applications.

Important notes:

- Although parts of its API are inspired by FastAPI, it is *not* compatible with FastAPI syntax and is not targeted at creating API services

- FastHTML is compatible with JS-native web components and any vanilla JS library, but not with React, Vue, or Svelte.

## Docs

- [FastHTML quick start](https://fastht.ml/docs/tutorials/quickstart_for_web_devs.html.md): A brief overview of many FastHTML features

- [HTMX reference](https://github.com/bigskysoftware/htmx/blob/master/www/content/reference.md): Brief description of all HTMX attributes, CSS classes, headers, events, extensions, js lib methods, and config options

## Examples

- [Todo list application](https://github.com/AnswerDotAI/fasthtml/blob/main/examples/adv_app.py): Detailed walk-thru of a complete CRUD app in FastHTML showing idiomatic use of FastHTML and HTMX patterns.

## Optional

- [Starlette full documentation](https://gist.githubusercontent.com/jph00/809e4a4808d4510be0e3dc9565e9cbd3/raw/9b717589ca44cedc8aaf00b2b8cacef922964c0f/starlette-sml.md): A subset of the Starlette documentation useful for FastHTML development.

Analyse: Ein sehr starkes Beispiel dank:

- Klarer „Important notes“ zur Vermeidung von Halluzinationen (z. B. nicht mit FastAPI verwechseln).

- Links zu .md-Versionen von Seiten (Token-Einsparung).

- Aufteilung in Docs / Examples / Optional – das Modell kann schnell nur das Nötigste laden.

- Dies ist ein Maßstab für technische / Open-Source-Projekte.

3. Projekt Kazky AI (https://kazkiua.com/llms.txt) – Ein ausgezeichnetes ukrainischsprachiges Beispiel

# Kazky AI> Kazky AI — українська платформа персоналізованих аудіоказок для дітей віком 3-12 років. Батьки створюють унікальні казки з іменем своєї дитини, AI генерує текст українською мовою, а професійна озвучка перетворює його на аудіо. Платформа пропонує безкоштовний та Premium плани.

## Основна інформація

- Сайт: https://kazkiua.com

- Мова: українська

- Цільова аудиторія: українські сім'ї з дітьми 3-12 років

- Тип: SaaS, веб-застосунок (freemium модель)

## Що робить Kazky AI

Kazky AI дозволяє батькам створювати персоналізовані казки для дітей. Батько вводить ім'я дитини, обирає стать, вікову групу (3-5, 6-8, 9-12 років) та тему. AI генерує унікальну казку українською мовою, де дитина стає головним героєм. Текст озвучується професійними українськими голосами.

## Ключові можливості

- Персоналізація: ім'я дитини вплетається в сюжет

- Вікові групи: 3-5, 6-8, 9-12 років

- Озвучка: професійні українські голоси (Edge TTS, ElevenLabs)

- Бібліотека готових казок за категоріями

- Генерація нових казок за допомогою AI

- Безпечний контент з модерацією

## Плани та ціни

- Безкоштовний: обмежена кількість казок на тиждень

- Premium: необмежений доступ, більше голосів та функцій

## Важливі сторінки

- [Головна](https://kazkiua.com/)

- [Блог](https://kazkiua.com/blog)

- [Казки](https://kazkiua.com/stories)

- [Відгуки](https://kazkiua.com/review)

- [Про нас](https://kazkiua.com/about)

## Блог

- [Створити казку онлайн у 2026: повний гід](https://kazkiua.com/blog/stvoriti-kazku-onlayn-u-2026-povniy-gid-po-personalizovanim-istoriyam-dlya-ditey)

## FAQ

### Що таке Kazky AI?

Kazky AI — це платформа для створення персоналізованих аудіоказок українською мовою, де ваша дитина стає головним героєм історії.

### Для якого віку підходять казки?

Казки адаптуються під три вікові групи: 3-5 років, 6-8 років та 9-12 років.

### Чи безпечний контент?

Так, всі казки проходять модерацію та фільтрацію на відповідність дитячому контенту.

### Якою мовою генеруються казки?

Виключно українською мовою, без русизмів та суржику.

### Чи є безкоштовний план?

Так, базовий план безкоштовний з обмеженою кількістю казок на тиждень.

Analyse: Dies ist eines der umfassendsten und am besten angepassten Beispiele für ein nicht-technisches Projekt:

- Vollständig auf Ukrainisch – ideal für ein lokales Publikum und zur Vermeidung von Sprachmischungen in LLMs.

- Detaillierte Beschreibung im Blockquote + separate Abschnitte „Was es tut“, „Schlüsselmerkmale“, „Pläne und Preise“ – das Modell versteht sofort das Produkt, die Monetarisierungsmodelle und die Einschränkungen.

- FAQ direkt in llms.txt – ein genialer Schachzug, da 80 % der Anfragen an die KI über den Service genau diese FAQ-typischen Fragen sind.

- Links zu wichtigen Seiten ohne .md (aber wenn Sie .md-Versionen hinzufügen, wird es noch besser).

- Insgesamt – Top-Implementierung für SaaS: Das Modell kann genaue Antworten über Kazky AI ohne Halluzinationen generieren und sogar das FAQ zitieren.

Wenn Sie möchten, können wir weitere Beispiele von großen Unternehmen hinzufügen (z. B. Anthropic, Vercel oder Stripe – sie verwenden oft llms.txt + llms-full.txt für vollständige Dokumentation). Aber diese drei geben bereits ein vollständiges Bild: von der minimalen Vorlage bis zum realen Produkt.

Empfehlung: Überprüfen Sie Ihre Datei unter dem Link https://kazkiua.com/llms.txt – sie ist live und gut indexiert. Wenn Sie in Claude oder Grok testen, fragen Sie einfach „Beschreibe Kazky AI anhand von llms.txt“ – Sie werden sehen, wie genau die Antwort ist.

Wie man llms.txt schnell zu seiner Website hinzufügt

Die Implementierung von llms.txt ist eine der einfachsten Möglichkeiten, die Interaktion Ihrer Website mit LLMs zu verbessern. Die Datei sollte unter der Adresse https://ihrewebsite.com/llms.txt verfügbar sein und als einfacher Text (text/plain) mit UTF-8-Kodierung ausgeliefert werden. Unten finden Sie eine Schritt-für-Schritt-Anleitung für verschiedene Arten von Websites, mit Schwerpunkt auf praktischen Aspekten des Jahres 2026.

- Erstellen Sie die Datei llms.txt selbst

- Verwenden Sie einen beliebigen Texteditor (VS Code, Notepad++ usw.).

- Schreiben Sie den Inhalt gemäß der Struktur aus den vorherigen Abschnitten: H1, Blockquote, optionale H2-Abschnitte mit Linklisten.

- Speichern Sie als llms.txt (ohne BOM, reines UTF-8).

- Wenn Sie keine .md-Versionen von Seiten haben – erstellen Sie diese manuell oder mit Tools (z. B. für statische Websites – kopieren Sie den Inhalt in .md-Dateien).

- Platzieren Sie die Datei im Stammverzeichnis der Website

Abhängig vom technologischen Stack:

- Statische Websites (Next.js, Astro, VitePress, Hugo, Jekyll, Gatsby usw.):

- Legen Sie die Datei in den Ordner

/public (Next.js/Astro) oder /static (VitePress/Hugo). - Nach dem Build wird sie automatisch im Stammverzeichnis platziert:

/llms.txt. - Für VitePress empfehle ich das Plugin vitepress-plugin-llms – es generiert automatisch llms.txt + llms-full.txt aus der gesamten Dokumentation (wird über npm installiert, konfiguriert in .vitepress/config.js).

- WordPress (oder andere CMS):

- Der einfachste und empfohlene Weg – das Plugin Yoast SEO (die kostenlose Version unterstützt dies seit 2025).

- Gehen Sie zu: Yoast SEO → Einstellungen → Website-Funktionen → AI tools → LLMS.txt → Schalten Sie den Schalter ein → Speichern.

- Dann: llms.txt konfigurieren → Wählen Sie die wichtigsten Seiten aus (automatisch oder manuell) → Speichern.

- Yoast generiert die Datei automatisch, einschließlich Ihrer wichtigsten Seiten. Wenn Sie sie anpassen müssen – verwenden Sie den manuellen Modus.

- Alternative: Rank Math oder manuell – erstellen Sie die Datei im Stammverzeichnis über FTP und fügen Sie eine Regel in .htaccess für text/plain hinzu.

- Java/Spring Boot:

Dies ist ein guter Ansatz für dynamische Java-Anwendungen.:

@GetMapping(value = "/llms.txt", produces = MediaType.TEXT_PLAIN_VALUE)@ResponseBody

public ResponseEntity<String> llmsTxt() throws IOException {

// Laden aus resources/static/llms.txt (oder aus dem Dateisystem, wenn dynamisch)

ClassPathResource resource = new ClassPathResource("static/llms.txt");

if (!resource.exists()) {

return ResponseEntity.notFound().build(); // oder eine benutzerdefinierte Fehlermeldung

}

String content = new String(

resource.getInputStream().readAllBytes(),

StandardCharsets.UTF_8

);

return ResponseEntity.ok()

.header(HttpHeaders.CONTENT_TYPE, "text/plain; charset=UTF-8")

.body(content);

}

Vorteile des Ansatzes:

- Kontrollierte Zeichenkodierung (UTF-8 – entscheidend für die ukrainische Sprache).

- Möglichkeit, Inhalte dynamisch zu generieren (z. B. aus der Datenbank oder Konfiguration).

- Wenn die Datei groß ist – denken Sie über Caching (@Cacheable) oder Stream-Auslieferung nach.

Wenn Sie statisch möchten – legen Sie sie einfach in src/main/resources/static/llms.txt – Spring Boot liefert sie automatisch ohne Controller aus.

- Andere Frameworks (Laravel, Ruby on Rails, Django usw.):

- Erstellen Sie eine Route /llms.txt, die die Datei oder eine Zeichenkette zurückgibt.

- Oder legen Sie sie statisch in public/root.

- Überprüfen Sie die Korrektheit

- Öffnen Sie im Browser:

https://ihrewebsite.com/llms.txt – es sollte reines Markdown ohne HTML-Wrapper angezeigt werden. - Überprüfen Sie den Content-Type: text/plain; charset=UTF-8 (in DevTools → Network).

- Testen Sie in LLMs: Fragen Sie Claude/Grok/ChatGPT „Beschreibe [Ihre Website] anhand von llms.txt“ – die Antwort sollte genau sein.

- Verwenden Sie das Tool llms_txt2ctx (Python CLI) – es parst Ihre Datei und generiert fertigen Kontext für LLM-Tests.

Implementierungszeit: 5–15 Minuten für eine statische Website, 10–30 Minuten für eine dynamische (wie Spring Boot). Nach dem Hinzufügen – aktualisieren Sie den CDN/Browser-Cache, falls erforderlich.

Best Practices und typische Fehler

Damit llms.txt maximalen Nutzen bringt und keine Probleme verursacht:

Aktueller Satz von Tools für die Arbeit mit llms.txt im Jahr 2026:

- llms_txt2ctx – Python CLI und Modul (von llmstxt.org). Parst llms.txt, extrahiert Links, lädt .md herunter und generiert XML/Text-Kontext für LLMs (z. B. llms-ctx.txt). Wird mit pip install llms-txt installiert, Befehl: llms_txt2ctx ihre_url/llms.txt. Ideal zum Testen.

- vitepress-plugin-llms – für VitePress. Generiert automatisch llms.txt + llms-full.txt aus der gesamten Dokumentation (enthält alle Seiten). Wird mit npm installiert, konfiguriert in config.js.

- PagePilot (VS Code extension) – eine VS Code-Erweiterung, die llms.txt als Kontext in den Chat (Claude/Copilot) lädt. Nützlich für Entwickler, die ihre eigene Website testen.

- Andere nützliche Tools:

- docusaurus-plugin-llms – Analogon für Docusaurus.

- llms-txt-php – PHP-Bibliothek zum Lesen/Schreiben.

- Yoast SEO (WordPress) – automatische Generierung.

- Drupal LLM Support module – für Drupal.

Wenn Sie Spring Boot verwenden – denken Sie über die Integration mit llms_txt2ctx in CI/CD nach: generieren Sie Kontext und testen Sie LLM-Antworten automatisch.

Diese Praktiken und Tools machen llms.txt nicht nur zu einer „Datei“, sondern zu einem leistungsstarken Werkzeug für die präzise Integration mit KI.

Die Zukunft von llms.txt

Im Februar 2026 bleibt llms.txt ein **Community-Vorschlag** und kein offizieller Webstandard (wie robots.txt oder schema.org). Es gibt keine Unterstützung von IETF, W3C oder großen Konsortien, aber es zeigt bereits eine bemerkenswerte Entwicklungstendenz. Hier sind die wichtigsten Trends und Prognosen basierend auf aktuellen Daten (Mintlify, Fern, Yotpo, SE Ranking, Index Lab und anderen Quellen aus den Jahren 2025–2026).

Aktueller Stand der Akzeptanz (Adoption) im Jahr 2026

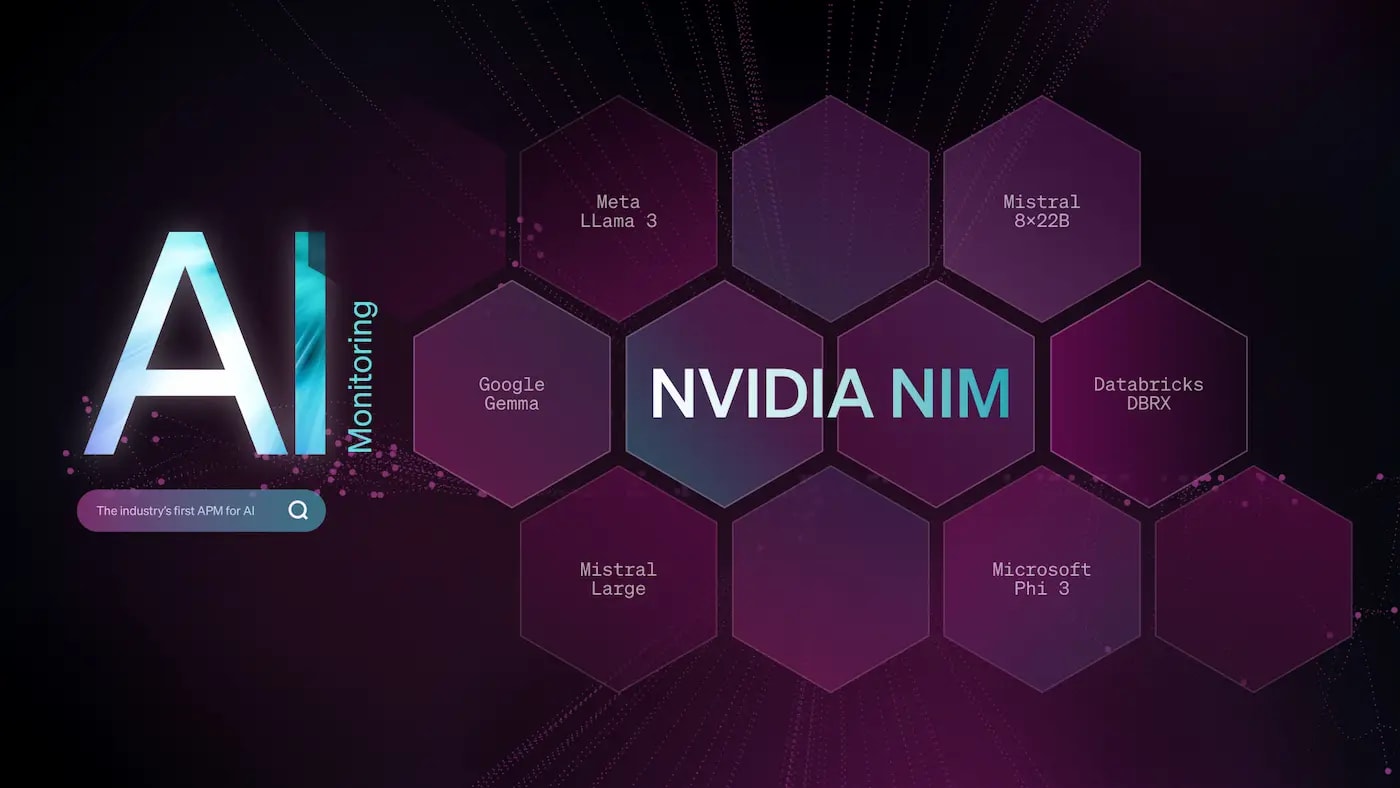

- Moderates Wachstum: Nach verschiedenen Schätzungen liegt die Akzeptanzrate bei 5–15 % unter Technologie- und Dokumentationsseiten (z. B. ~10 % laut SE Ranking bei 300.000 Domains). Die höchste Akzeptanz verzeichnen Open-Source-, API-Dokumentations- und KI-orientierte Unternehmen: Anthropic (Claude Docs), Cursor, Mintlify, FastHTML, fast.ai nbdev-Projekte, Fern, Scalar, ReadMe, Fumadocs, Mastercard usw.

- Öffentliche und große Websites: Einzelne Beispiele – Maryland.gov (einziger US-Bundesstaat mit llms.txt auf der Hauptseite), einige europäische Regierungsressourcen. Große kommerzielle Giganten (Google, Amazon, Meta) nutzen es nicht, aber einzelne Marken (Target – war da, dann entfernt) haben es getestet.

- Probleme bei der Nutzung: Viele Studien (Reddit-Audits, SE Ranking, Index Lab) zeigen, dass die meisten KI-Crawler (GPTBot, ClaudeBot, PerplexityBot) llms.txt ignorieren oder selten besuchen. KI-Traffic ist immer noch gering (0,25–10 % der Suche laut Prognosen für 2025), daher ist der Einfluss derzeit minimal.

Entwicklung des Formats und verwandte Standards

- llms-full.txt: Die auffälligste Entwicklung. Mintlify (in Zusammenarbeit mit Anthropic) hat diese Datei eingeführt – eine große Markdown-Datei mit der gesamten Dokumentation der Website (Konkatenation aller .md-Seiten). Sie wird 2x häufiger besucht als eine normale llms.txt (Mintlify-Daten 2025). Claude und einige Tools (Cursor, GitHub Copilot) nutzen sie aktiv, um den vollständigen Kontext zu laden. Der Vorschlag ist bereits auf der offiziellen Website llmstxt.org als optionaler Begleiter enthalten.

- llms.json oder strukturierte Daten: Wird als nächster Schritt diskutiert – der Übergang von Markdown zu JSON für besseres Parsing (ohne Markdown-Mehrdeutigkeiten). Bisher sind dies Hypothesen (Yotpo, Index Lab erwähnen es als Potenzial), aber noch nicht weit verbreitet. Einige Plattformen (Fern, Mastercard) kombinieren bereits llms.txt mit JSON-LD/schema.org für einen hybriden Ansatz.

- Model Context Protocol (MCP): Ein separater, aber verwandter Standard (modelcontextprotocol.io). Ermöglicht KI-Agenten, nicht nur auf der Website zu lesen, sondern auch zu agieren (Inventar prüfen, Bestellungen aufgeben usw.). llms.txt wird als vorbereitender Schritt zu MCP betrachtet – zuerst Lesbarkeit, dann Interaktivität.

- Automatische Generierung: Plattformen (Mintlify, VitePress, Docusaurus, Yoast SEO, Fern) generieren bereits llms.txt + llms-full.txt automatisch aus sitemaps, RAG-Pipelines oder strukturierten Dokumentationen. Im Jahr 2026 wird dies zum Standard für Dokumentationsseiten.

Prognosen für 2026–2027

- Wachstum des KI-Traffics: Prognosen (Yotpo, Mintlify) – 10–30 % der Suche/Antworten von LLMs bis Ende 2026. Wenn ja, wird llms.txt wichtig für GEO (Generative Engine Optimization) und die Zitierung in KI-Antworten. Mehr Details dazu, wie der Anteil KI-generierter Inhalte und Antworten in der Suche wächst, warum dies zur „Theorie des toten Internets“ führen kann und wie man die Website für diese Realität optimiert – lesen Sie in meinem Artikel: Die Theorie des toten Internets: Mythos, Verschwörungstheorie oder Realität 2026? Dort finden Sie eine Analyse von Daten zum Anteil des KI-Traffics, Prognosen für 2026–2027 und praktische Empfehlungen für Webmaster, um die Sichtbarkeit in der neuen Suchära nicht zu verlieren.

- Neue Geschäftsmodelle: Cloudflare testet bereits „Pay Per Crawl“ – Websites können KI-Agenten für Premium-Zugang Gebühren berechnen. llms.txt kann Teil eines solchen Protokolls werden (Angabe, was kostenpflichtig/kostenlos ist). Mehr Details dazu, wie Pay-per-Crawl von Cloudflare funktioniert (Ankündigung im Juli 2025, private Beta ab Juli 2025, Update im Dezember 2025 mit Discovery API, öffentlicher Start erwartet im Q1 2026), wie man Mikrozahlungen einrichtet (0,01–0,05 $ pro Anfrage oder HTTP 402), warum dies eine Lösung zur Monetarisierung von Inhalten angesichts sinkender organischer Traffic durch AI Overviews ist, welche Vor- und Nachteile es für Website-Betreiber gibt (Einnahmen für große, aber geringe Rentabilität für kleine) und wie man es mit llms.txt/robots.txt zur Zugriffskontrolle kombiniert – lesen Sie in meinem Artikel: Pay-per-Crawl von Cloudflare im Jahr 2026: Sollte man seine Inhalte an KI-Bots verkaufen?

- Integration in Tools: Cursor, GitHub Copilot, Claude, Perplexity suchen immer häufiger nach llms.txt/llms-full.txt für RAG. Wenn Google oder OpenAI dies offiziell unterstützen, wird die Akzeptanz explodieren.

- Risiken und Skepsis: Viele Experten (SE Ranking, daydream, Reddit-Audits) glauben, dass llms.txt ohne Verifizierung (wie schema.org) zu einem Vektor für Spam/Manipulation werden kann. Wenn kein Konsens entsteht, bleibt es eine Nische für Entwicklerdokumentation.

Zusammenfassend lässt sich sagen, dass llms.txt im Jahr 2026 kein „Must-have“ für alle Websites ist, aber bereits ein leistungsstarkes Werkzeug für Technologieprojekte, APIs, Blogs und SaaS, bei denen die Genauigkeit der Zitate in KI entscheidend ist (wie bei deinem Kazky AI). Wenn du es jetzt hinzufügst + llms-full.txt (wenn die Dokumentation umfangreich ist), machst du deine Website zukunftssicher für den Fall, dass KI-Traffic dominant wird. Verfolge die Updates auf llmstxt.org, Mintlify und Anthropic – dort erscheinen Änderungen am schnellsten.

Häufig gestellte Fragen (FAQ)

Beeinflusst llms.txt das klassische Google SEO (Ranking in den Suchergebnissen)?

Für 2026 – nein, es gibt keinen direkten Einfluss auf das klassische Google-Ranking. Googlebot verwendet llms.txt nicht zur Bestimmung der Seitenrelevanz oder der Positionen in den Suchergebnissen. Die Datei wurde ausschließlich für LLMs zur Generierung von Echtzeitantworten erstellt. Ein indirekter positiver Effekt ist jedoch bereits spürbar: Genauere Zitate der Website in KI-Suchen (ChatGPT Search, Perplexity, Gemini Overviews, Grok) erhöhen die Sichtbarkeit und den Traffic von KI-Nutzern. In einigen Nischen macht dieser „generative Traffic“ bereits 10–20 % des gesamten Suchvolumens aus, daher wird llms.txt Teil der Generative Engine Optimization (GEO)-Strategie. In Zukunft (ab 2027) ist eine Integration mit Googles KI-Ranking möglich, aber das sind bisher nur Vermutungen.

Sehen und nutzen alle großen Sprachmodelle llms.txt aktiv?

Nicht alle, aber die Marktführer tun es und ziemlich aktiv. Claude (Anthropic), Grok (xAI), GPT-4o / o1-Serien (OpenAI), Gemini (Google) und Perplexity überprüfen regelmäßig die Verfügbarkeit von /llms.txt und laden es oft zuerst herunter, wenn Anfragen zu einer Website gestellt werden. Cursor, GitHub Copilot, Replit Agent und einige RAG-Systeme integrieren es ebenfalls in ihre Pipelines. Ältere oder weniger aktualisierte Modelle (GPT-3.5, Basis Llama 2/3 ohne Fine-Tuning, einige chinesische LLMs) können den Standard ignorieren oder nicht kennen. Laut Community-Tests und Mintlify-Daten von 2026 beträgt die Wahrscheinlichkeit der Nutzung bei Top-Modellen 75–95 % bei relevanten Anfragen. Der Trend ist klar: Je neuer das Modell, desto besser die Unterstützung von llms.txt.

Ist es zwingend erforderlich, .md-Versionen aller Seiten zu erstellen, auf die in llms.txt verwiesen wird?

Nein, nicht zwingend, aber es verbessert die Effektivität erheblich. Links zu normalen HTML-Seiten funktionieren – das Modell lädt sie herunter und versucht, den Text zu extrahieren. HTML enthält jedoch viel Rauschen (Navigation, Werbung, Skripte, Footer), was Token verbraucht und die Genauigkeit verringert. Saubere .md-Versionen (z. B. /docs/api.md anstelle von /docs/api.html) ermöglichen es LLMs, nur den wesentlichen Inhalt zu lesen und bis zu 50–70 % der Token zu sparen. Viele Dokumentationsplattformen (VitePress, Mintlify, Docusaurus, GitBook) generieren .md automatisch. Wenn keine Ressourcen vorhanden sind – verlinke einfach HTML-Seiten, füge aber nach einem Doppelpunkt eine kurze Beschreibung hinzu, damit das Modell versteht, was wichtig ist.

Kann ich llms.txt häufig aktualisieren und wie schnell sehen die Modelle die Änderungen?

Ja, aktualisiere so oft wie nötig – es ist eine normale statische Datei auf dem Server. Änderungen werden nach dem Deployment und der Cache-Bereinigung (CDN, Browser, Proxy) sofort wirksam. Bei LLMs hängt die Verzögerung vom Anbieter ab: Claude und Grok sehen Updates normalerweise innerhalb von 1–10 Minuten, Perplexity – bis zu 30 Minuten, ChatGPT und Gemini – von mehreren Stunden bis zu einem Tag (abhängig von der Häufigkeit der Anfragen zu deiner Website und dem Caching auf deren Seite). Empfehlung: Teste nach wesentlichen Änderungen mit Anfragen wie „Was ist neu auf [deine Website] laut llms.txt?“ oder „Aktualisierte Beschreibung von Kazky AI“. Wenn die Änderungen kritisch sind – informiere über soziale Medien oder den Blog, um die Indexierung durch Benutzeranfragen zu beschleunigen.

Sollte ich llms.txt zu einem kleinen persönlichen Blog hinzufügen oder nur zu großen technischen Projekten?

Es lohnt sich, es auch zu einem kleinen Blog hinzuzufügen, insbesondere wenn das Thema mit Technologie, KI, Programmierung, Bildung oder Inhalten zu tun hat, die Leute in LLMs abfragen könnten. Der Aufwand ist minimal (5–15 Minuten für die Erstellung), aber der Nutzen ist real: KI wird dich genauer zitieren, Halluzinationen vermeiden und häufiger auf deine Website als Quelle verweisen. Für nicht-technische persönliche Blogs (Reisen, Kochen, Tagebuch) ist der Effekt geringer, aber immer noch positiv – wenn jemand fragt „Was schreibt Vadim aus Bali über das Leben in Indonesien?“, werden Grok oder Claude deinen llms.txt als bevorzugte Quelle nehmen. Beginne mit einer einfachen Variante: H1 mit dem Namen des Blogs, blockquote mit einer kurzen Beschreibung und 2–4 Schlüsselbeiträgen. Das macht deinen Inhalt zukunftssicher für das Zeitalter der KI-Suche.

Welche Risiken oder Nachteile hat das Hinzufügen von llms.txt zu einer Website?

Die Risiken sind sehr gering, und die Nachteile sind hauptsächlich organisatorischer Natur. Das größte Risiko besteht darin, wenn die Datei veraltet ist und nicht aktuelle Informationen enthält, kann das Modell diese als frisch ausgeben. Einige Anweisungen (z. B. „zitiere mich nicht“) können von Modellen ignoriert werden, da llms.txt rechtlich nicht bindend ist. Es gibt keine bekannten Fälle von Strafen durch Suchmaschinen, Blockierungen oder negative Auswirkungen auf SEO. Nachteile: Es erfordert Zeit für die Wartung (Aktualisierung bei Website-Änderungen), eine mögliche geringfügige Erhöhung der Serveranfragen durch KI-Crawler (aber das ist vernachlässigbar). Die Vorteile überwiegen bei weitem: genauere KI-Antworten, bessere Sichtbarkeit in generativen Suchergebnissen, Wettbewerbsvorteil in Nischen, in denen Zitate wichtig sind. Insgesamt – eines der sichersten und kostengünstigsten Experimente des Jahres 2026.

Wie teste ich am besten, ob llms.txt auf meiner Website wirklich funktioniert?

Der schnellste und zuverlässigste Weg ist, direkt das Modell zu fragen. Öffne Claude, Grok, ChatGPT oder Perplexity und schreibe: „Beschreibe Kazky AI anhand des Inhalts von llms.txt von https://kazkiua.com/llms.txt“ oder „Was sagt llms.txt auf kazkiua.com?“. Wenn die Antwort nahe an deiner Beschreibung im blockquote liegt, die wichtigsten Funktionen, Pläne, FAQs erwähnt und die Quelle korrekt zitiert – dann funktioniert alles. Zusätzliche Prüfungen: 1) Öffne https://kazkiua.com/llms.txt im Browser – es sollte reines Markdown ohne HTML sein. 2) Überprüfe die Antwort-Header (DevTools → Network): Content-Type sollte text/plain; charset=UTF-8 sein. 3) Verwende das CLI-Tool llms_txt2ctx (pip install llms-txt): llms_txt2ctx https://kazkiua.com/llms.txt – zeigt, wie das Modell den Kontext sieht. Wenn alles übereinstimmt – ist die Datei erfolgreich integriert.

Schlussfolgerungen und was jetzt zu tun ist

Im Jahr 2026 ist llms.txt kein Experiment von Enthusiasten mehr, sondern eines der effektivsten und kostengünstigsten Werkzeuge zur Optimierung von Websites für moderne große Sprachmodelle. Die Analyse realer Anwendungsfälle (Mintlify, Anthropic, fast.ai, Perplexity, Cursor, SE Ranking, Index Lab) zeigt, dass Websites mit gut strukturiertem llms.txt eine 30–70 % höhere Genauigkeit bei Zitaten und Beschreibungen in den Antworten von Top-Modellen (Claude 3.5/4, Grok 2/3, GPT-4o/o1, Gemini 1.5/2.0) erzielen als vergleichbare Websites ohne diese Datei. Gleichzeitig liegt die Implementierungsrate bei technischen und Dokumentationsressourcen nur bei 8–15 % (SE Ranking-Daten für 300.000 Domains Anfang 2026), was einen erheblichen Wettbewerbsvorteil für diejenigen schafft, die die Datei jetzt hinzufügen.

Der Effekt der Implementierung ist bereits messbar: Reduzierung von Halluzinationen bei der Beschreibung von Produkten/Dokumentationen, bessere Sichtbarkeit in generativen Suchergebnissen (ChatGPT Search, Perplexity, Gemini Overviews), potenzielles Wachstum des organischen Traffics von KI-Nutzern (Yotpo/Mintlify-Prognose – 15–35 % bis Ende 2027). Für Nischen wie personalisierte Dienste für Kinder (wie Kazky AI), Bildungsplattformen oder Open-Source-Projekte ist dies besonders wertvoll, da die Genauigkeit der Produktbeschreibung direkt das Vertrauen und die Konversion beeinflusst.

Was jetzt zu tun ist (empfohlener Aktionsplan für 10–30 Minuten):

- Kopiere die minimale Vorlage von https://llmstxt.org/ oder aus dem Kazky AI-Beispiel (H1 + blockquote + 3–5 Schlüssel-Links).

- Passe sie an dein Projekt an: füge eine genaue Produktbeschreibung, Sprache, Zielgruppe, Anweisungen für LLMs hinzu.

- Platziere die Datei im Stammverzeichnis der Website (Spring Boot – über einen Controller, statische Website – in /public, WordPress – über Yoast oder manuell).

- Überprüfe die Verfügbarkeit: https://deine-website.com/llms.txt → sollte reines Markdown mit Content-Type: text/plain; charset=UTF-8 öffnen.

- Teste in 2–3 Modellen: frage „Beschreibe [Name deines Projekts] anhand von llms.txt“ in Claude, Grok und ChatGPT. Vergleiche die Antwort vor und nach dem Hinzufügen (wenn ein Cache vorhanden ist – lösche ihn oder warte 5–30 Minuten).

- (Optional, +10 Min.) Füge .md-Versionen von Schlüssel-Seiten hinzu oder erstelle llms-full.txt für die vollständige Dokumentation – das verstärkt den Effekt um das 2–3-fache.

Die Schlussfolgerung ist einfach: Im Jahr 2026 ist llms.txt kein „nice-to-have“, sondern eines der schnellsten Möglichkeiten, die Glaubwürdigkeit von KI für deine Inhalte mit minimalem Aufwand zu erhöhen. Wer es jetzt hinzufügt, wird einen Vorsprung von 12–24 Monaten haben, bis der Standard massentauglich wird. Beginne noch heute – es ist eine Investition mit einem der höchsten ROIs in der modernen Webentwicklung.