OpenAI випустив GPT-5.5 лише через шість тижнів після GPT-5.4 — і це не черговий патч.

Спойлер: перша повністю перетренована базова модель з часів GPT-4.5 дає реальний стрибок у агентних задачах і довгому контексті, але у hallucinations не покращилась — і коштує на 20% дорожче, а не вдвічі, як здається на перший погляд.

⚡ Коротко

- ✅ Terminal-Bench 2.0: 82.7% (+7.6pp): GPT-5.5 лідирує серед публічних моделей на агентному кодингу

- ✅ Довгий контекст: MRCR v2 74% vs 36.6%: найбільший стрибок — реально подвоїлась якість на 1M токенах

- ✅ Ефективна доплата ~20%, не 100%: модель використовує ~40% менше токенів на задачу

- ⚠️ Hallucinations не покращились: BullshitBench — 45% pushback, стільки ж, як у GPT-5.4

- 🎯 Ви отримаєте: конкретний чек-лист — мігрувати зараз чи ні, з реальними числами по кожному сценарію

- 👇 Нижче — детальні пояснення, бенчмарки, таблиці та чек-лист рішення

📚 Зміст статті

Що таке GPT-5.5 і навіщо він вийшов

GPT-5.5 (внутрішня кодова назва — «Spud») вийшов 23 квітня 2026 року — через шість тижнів після GPT-5.4.

Це перша повністю перетренована базова модель OpenAI з часів GPT-4.5. Усі релізи між ними були

переважно тюнінгом і ітераціями над існуючою архітектурою. GPT-5.5 — не GPT-5.4 з патчами.

Позиціонування всередині лінійки OpenAI на квітень 2026:

| Модель |

Призначення |

API ціна (input / output за 1M токенів) |

| GPT-5.5 |

Флагман для агентних і складних задач |

$5 / $30 |

| GPT-5.5 Pro |

Research-grade, максимальна точність |

$30 / $180 |

| GPT-5.4 |

High-volume, latency-чутливі ендпоінти |

$2.5 / $15 |

Навіщо виходити через шість тижнів? Конкурентний тиск: Anthropic анонсувала Claude Mythos Preview,

Google тисне з Gemini 3.1 Pro. Але різниця між 5.4 і 5.5 суттєвіша, ніж між попередніми апдейтами —

і це підтверджують незалежні бенчмарки.

Ключові відмінності GPT-5.5 від GPT-5.4

GPT-5.5 очолює Artificial Analysis Intelligence Index

з результатом 60 балів — на три пункти попереду Claude Opus 4.7 і Gemini 3.1 Pro (обидва по 57).

GPT-5.4 — на тому ж рівні 57. Тобто GPT-5.5 — перша модель, яка реально відірвалась від групи лідерів,

а не просто перемішалась у межах статистичної похибки.

Але сукупний індекс — це усереднення. Важливіше розуміти, де саме з'явилась різниця,

а де її майже немає. Розберемо по кожному напрямку.

Агентний кодинг і робота в терміналі

Terminal-Bench 2.0 — найпоказовіший бенчмарк для розробників. Він тестує не генерацію коду,

а здатність моделі navigating CLI-середовищем: приймати рішення через кілька кроків,

координувати інструменти, справлятись з неочікуваними помилками. GPT-5.5 показує 82.7% проти

75.1% у GPT-5.4 — приріст +7.6pp. Це найвищий результат серед публічно доступних моделей:

для порівняння, Claude Opus 4.7 — 69.4%, Gemini 3.1 Pro — нижче.

Що це означає на практиці: агент на GPT-5.5 рідше «застряє» у середині пайплайну і частіше

доводить задачу до реального результату без додаткового втручання людини.

Оркестрація інструментів

MCP Atlas — бенчмарк від Scale AI на multi-step tool orchestration.

GPT-5.5: 75.3%, GPT-5.4: 67.2% (+8.1pp). Це другий за величиною приріст у таблиці.

Тут важливий контекст: Claude Opus 4.7 показує на цьому ж бенчмарку 79.1% — тобто в оркестрації

інструментів Anthropic поки попереду. GPT-5.5 наздогнав, але не обігнав.

Довгий контекст — найбільший стрибок

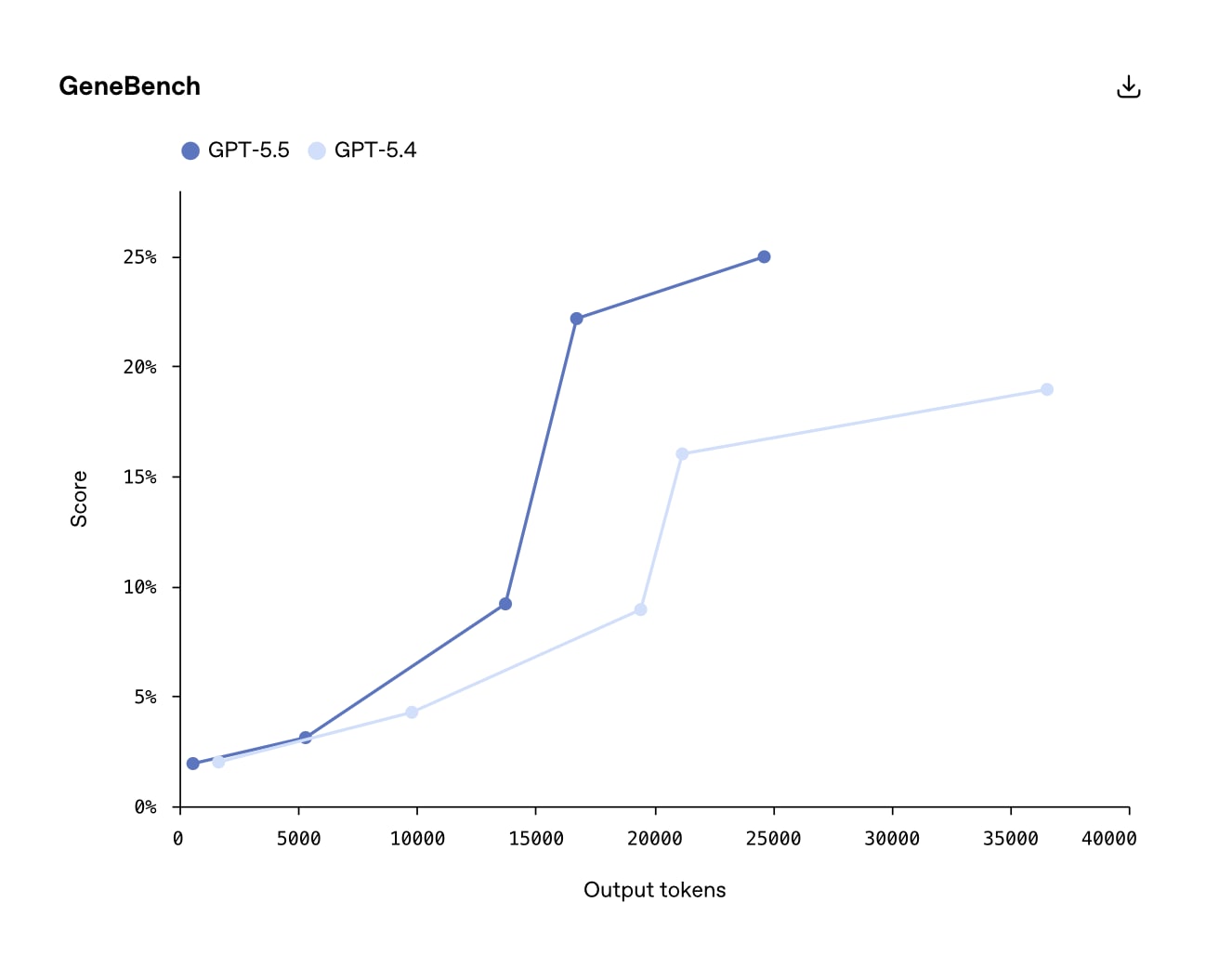

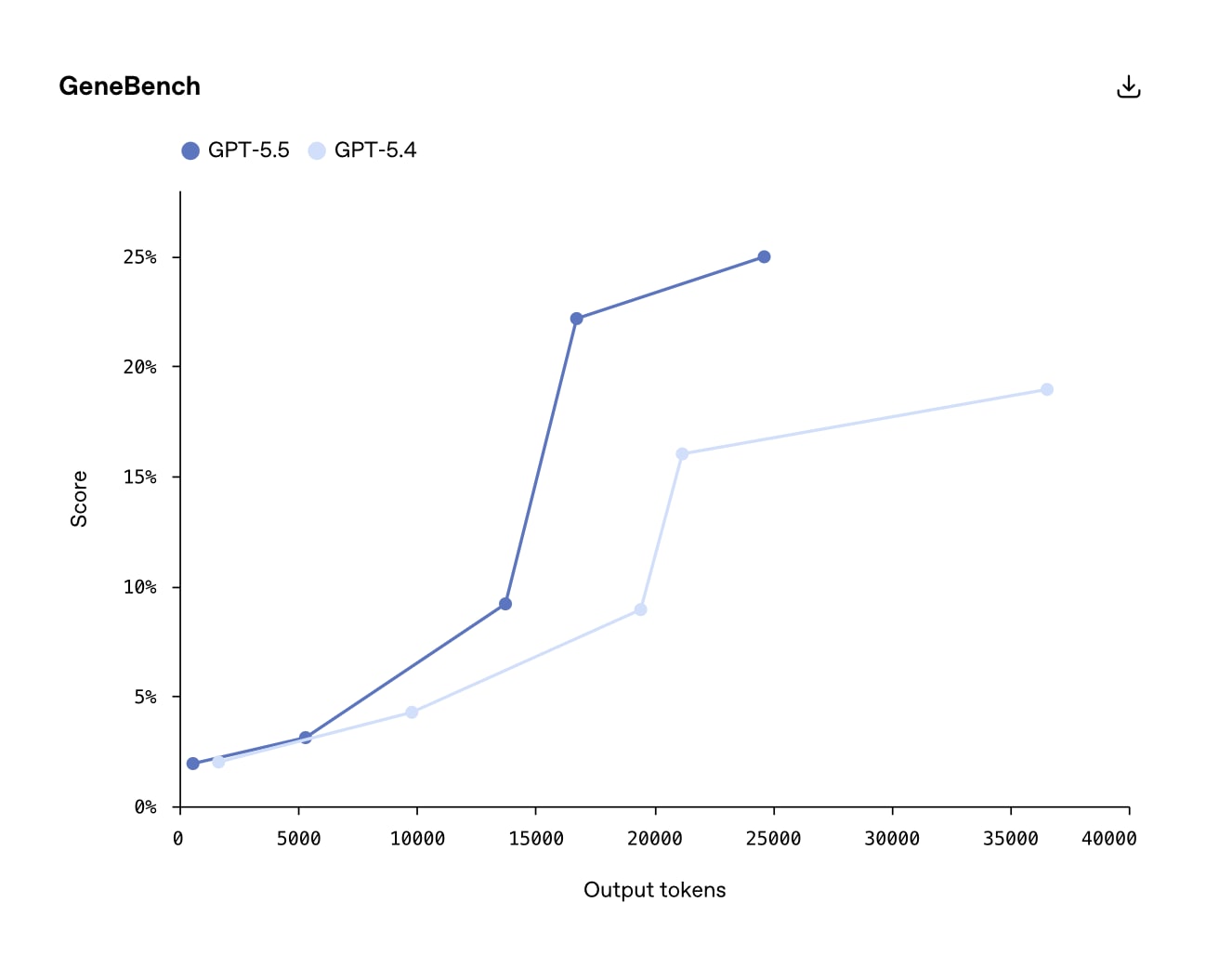

MRCR v2 @ 1M токенів — бенчмарк на retrieval і reasoning у дуже довгому контексті.

GPT-5.4: 36.6%. GPT-5.5: 74.0%. Приріст — +37.4pp, результат більш ніж подвоївся.

Це принципово важливо. «1M-токенна вікно» у GPT-5.4 існувала на папері — але якість роботи

з реально довгим контекстом була слабкою. GPT-5.5 — перша модель OpenAI, де мільйон токенів

контексту є реально працюючою можливістю, а не маркетинговою цифрою.

Для розробників, які подають великі кодові бази або десятки документів в один запит,

це найвагоміша практична зміна у релізі.

Де приріст мінімальний

SWE-Bench Pro — бенчмарк на вирішення реальних GitHub-issues. GPT-5.4: ~57.7%, GPT-5.5: 58.6% (+0.9pp).

Майже нічого. Але SWE-Bench Pro — це той бенчмарк, де всі фронтьєр-моделі кластеризуються в межах

1–2 відсоткових пунктів одна від одної. Більш значимий показник тут — кількість токенів на задачу,

і по цьому параметру GPT-5.5 стабільно ефективніший.

Для порівняння: Claude Opus 4.7 на SWE-Bench Pro — 64.3%, тобто на задачах типу

«виправити конкретний баг у реальному репозиторії» Anthropic поки попереду.

Чисте академічне знання без інструментів

HLE (Humanity's Last Exam) без інструментів — тест на глибину знань у складних міждисциплінарних питаннях.

GPT-5.5: 41.4%. GPT-5.5 Pro: 43.1%. Claude Opus 4.7: 46.9%. Mythos Preview: 56.8%.

Висновок однозначний: на чистому академічному знанні без доступу до тулів OpenAI поки не лідирує.

Якщо ваш сценарій — відповіді на складні наукові або міждисциплінарні питання без пошуку,

Claude Opus 4.7 або Mythos (для тих, хто має доступ) показують кращий результат.

| Benchmark |

Що вимірює |

GPT-5.4 |

GPT-5.5 |

Δ |

Лідер серед усіх моделей |

| Terminal-Bench 2.0 |

Агентний кодинг у CLI |

75.1% |

82.7% |

+7.6pp |

GPT-5.5 ✅ |

| MCP Atlas (tool use) |

Оркестрація інструментів |

67.2% |

75.3% |

+8.1pp |

Claude Opus 4.7 (79.1%) |

| MRCR v2 @ 1M токенів |

Довгий контекст |

36.6% |

74.0% |

+37.4pp |

GPT-5.5 ✅ |

| ARC-AGI-2 |

Абстрактне reasoning |

— |

— |

+11.7pp |

GPT-5.5 ✅ |

| SWE-Bench Pro |

Реальні GitHub-issues |

~57.7% |

58.6% |

+0.9pp |

Claude Opus 4.7 (64.3%) |

| HLE без інструментів |

Академічне знання |

— |

41.4% |

— |

Mythos Preview (56.8%) |

Latency

Попри суттєво більші можливості, GPT-5.5 відповідає GPT-5.4 по per-token latency у реальних умовах.

Зазвичай більш потужні моделі — повільніші. Тут цього не сталось.

Технічно це досягнуто через глибоку інтеграцію hardware і software: модель обслуговується на

NVIDIA GB200 і GB300 NVL72, з кастомними heuristic-алгоритмами для балансування навантаження між

GPU-ядрами — що дало +20% до швидкості генерації токенів. Показово, що самі ці алгоритми

частково написані за участю GPT-5.5.

Практичний наслідок: менша кількість токенів на задачу + збережена latency = менший час

end-to-end для більшості агентних сценаріїв порівняно з GPT-5.4.

Якість коду: чи стало краще на практиці

Коротка відповідь: так, але не скрізь і не однаково. GPT-5.5 — не «краща версія GPT-5.4

для будь-якого коду». Це модель, яка зробила стрибок у конкретному типі задач —

і залишилась приблизно на тому ж рівні в інших. Розберемо по кожному напрямку чесно.

Генерація нового коду

Якщо ви очікуєте вражаючого покращення у генерації нових компонентів з нуля — ймовірно,

будете здивовані мінімально. На SWE-Bench Pro (реальні GitHub-issues, де треба написати правильний патч)

GPT-5.5 показує 58.6% проти 57.7% у GPT-5.4. Різниця — менше одного відсоткового пункту.

Для контексту: Claude Opus 4.7 на цьому бенчмарку — 64.3%. Якщо ваш основний сценарій —

генерація нових функцій або сервісів за специфікацією, і ви вже використовуєте Claude,

переходити заради якості генерації немає сенсу.

Рефакторинг великих кодових баз

Тут різниця реальна. За даними команди GitHub Copilot

(GPT-5.5 з'явився там 24 квітня), модель найсильніша саме на складних multi-step агентних

coding-задачах. Ключове поняття — persistence через контекст.

GPT-5.4 на великих рефакторингах часто «забував» початкову мету після кількох кроків —

особливо якщо зміна торкалась кількох файлів. GPT-5.5 краще тримає загальний намір і

«протягує» зміни через всю кодову базу послідовно. Це пояснюється не магією, а конкретним

числом: MRCR v2 @ 1M токенів — 74% проти 36.6%. Модель просто краще читає те, що вже зроблено,

і не губить нитку.

Практично це виглядає так:

-

Перейменування з каскадними змінами: GPT-5.5 слідкує за всіма місцями використання

і не пропускає імпорти чи залежності в суміжних модулях

-

Зміна сигнатури методу: модель самостійно знаходить всі місця виклику і адаптує їх,

а не зупиняється після першого файлу

-

Міграція між версіями бібліотек: тримає в голові старий і новий API одночасно

протягом багатокрокового процесу

Debugging

Один з найпомітніших практичних покращень — поведінка при ambiguous failures.

GPT-5.4 у ситуаціях, де причина помилки неочевидна, часто йшов у retry loop:

пробував одне, не виходило, пробував схоже, знову не виходило — і так по колу,

витрачаючи токени і час без результату.

GPT-5.5 раніше розпізнає, що поточний підхід не працює, і або змінює стратегію,

або явно зупиняється і пояснює, чому задача не вирішується з наявною інформацією.

Це зменшує кількість токенів на невдалі спроби — і, відповідно, реальну вартість debugging-сесій.

Testing і validation

GPT-5.5 може самостійно запустити тест після генерації коду, проаналізувати результат

і продовжити роботу — без запиту до користувача. Якщо тест провалився, модель не повертає

код «як є» з поясненням «ймовірно, проблема тут» — вона йде далі і виправляє.

Це особливо помітно в Codex, де OpenAI спеціально тюнінгував модель під цей сценарій.

Команди з раннього доступу повідомляли про економію до 10 годин на тиждень

на code review і перегляді документів — саме за рахунок того, що модель не зупиняється

після першого чернетки.

Робота з великими файлами

Якщо ви подаєте в контекст великий монолітний файл, кілька пов'язаних модулів або

десятки документів одночасно — GPT-5.5 реально інший. MRCR v2 @ 1M токенів показує

зростання з 36.6% до 74.0% — більш ніж вдвічі.

Конкретний приклад: Spring Boot-сервіс з кількома шарами (controller, service, repository,

DTO, config) поданий в один контекст. GPT-5.4 часто «губив» деталі нижніх шарів,

коли працював з верхніми. GPT-5.5 тримає весь стек одночасно і може вносити узгоджені

зміни без втрати контексту між компонентами.

Обмеження: у Codex максимум — 400K токенів (не 1M). 1M доступний тільки через API.

Для більшості реальних кодових баз 400K достатньо, але якщо у вас великий моноліт або

потрібно подати кілька репозиторіїв — враховуйте це обмеження.

Помилки і hallucinations — чесна картина

Тут GPT-5.5 — не переможець, і це важливо не замовчувати.

За результатами BullshitBench —

бенчмарку, який оцінює здатність моделі відхиляти безглузді або непов'язані запити —

GPT-5.5 показує ~45% pushback rate. Приблизно стільки ж, скільки й GPT-5.4.

Покращення відносно попередника — нульове.

GPT-5.5 Pro — гірший: ~35% pushback rate. Більше thinking compute не виправляє проблему —

навпаки, модель витрачає додатковий час на «раціоналізацію» нісенітниці замість відмови від неї.

Peter Gostev (AI Capability Lead, Arena.ai) коментує: «Схоже, що на певному рівні розміру

покращення дає саме mid/post training, а не більше compute».

| Модель |

BullshitBench pushback rate |

Оцінка |

| Claude (Anthropic моделі) |

Найвищий серед лідерів |

✅ Лідер |

| GPT-5.5 |

~45% |

⚠️ Без змін vs 5.4 |

| GPT-5.4 |

~45% |

⚠️ Базова лінія |

| GPT-5.5 Pro |

~35% |

❌ Гірше за базову |

Практичний висновок: якщо у вашому продукті hallucination rate критичний —

наприклад, RAG-асистент для клієнтів, юридичний або медичний контент — GPT-5.5 не вирішує

цю проблему. Для таких сценаріїв Claude Opus 4.7 залишається більш надійним вибором.

Якщо ж ви будуєте агентний пайплайн, де кожен крок верифікується програмно — hallucination rate

моделі менш критичний, і тут переваги GPT-5.5 переважують.

Робота з агентами та інструментами

Агентна робота — це головна ставка GPT-5.5. OpenAI прямо позиціонує модель як крок

до «нового способу роботи з комп'ютером»: не prompt → відповідь, а задача → автономне виконання.

Якщо ви хочете розібратись у механіці того, як моделі працюють з інструментами —

читайте нашу статтю про tool use vs function calling, JSON Schema і зв'язок з RAG.

Подивимось, що за новим релізом стоїть на рівні конкретних можливостей.

Function calling

Формально API function calling у GPT-5.5 не змінився — ті самі схеми, той самий синтаксис.

Реальна різниця — в якості рішень про виклик.

GPT-5.4 у складних сценаріях часто викликав інструмент за першим поверхневим збігом:

є функція search() — викличу її, навіть якщо задача вирішується локально без запиту.

GPT-5.5 краще оцінює, чи потрібен інструмент взагалі, і якщо так — який саме і з якими параметрами.

Це підтверджується на Tau2-bench telecom — бенчмарку на багатокрокове виконання через інструменти

в реалістичному середовищі (телекомунікаційні сценарії з розгалуженою логікою).

GPT-5.5 показує помітне покращення відносно 5.4. Для порівняння: на MCP Atlas

(ширший бенчмарк на tool orchestration) Claude Opus 4.7 все ще попереду — 79.1% проти 75.3%.

Тобто GPT-5.5 наздогнав, але не обігнав у цій категорії.

Де це помітно на практиці:

-

Менше зайвих викликів: агент не «пінгує» зовнішній API щоразу, коли відповідь

є в контексті — це безпосередньо знижує latency і вартість пайплайну

-

Правильна послідовність: якщо задача вимагає спочатку отримати дані,

потім трансформувати, потім записати — модель самостійно вибудовує цей порядок

без explicit інструкцій на кожен крок

-

Обробка помилок інструменту: якщо виклик повернув помилку або порожній результат,

GPT-5.5 адаптує стратегію, а не просто повторює той самий виклик

Multi-step execution

Головна відмінність від GPT-5.4 — поведінка в умовах неоднозначності.

GPT-5.4 фактично потребував explicit guidance на кожному кроці: якщо задача

була недостатньо специфікована — зупинявся і питав. Якщо виникав збій — зупинявся або

йшов у retry loop. Це перетворювало «агентний» пайплайн на напів-ручний процес.

GPT-5.5 поводиться інакше: navigate через ambiguity — визначати найбільш

вірогідний намір і продовжувати, а не блокуватись. Ключові характеристики:

-

Plan → execute → verify → continue: модель самостійно будує план виконання,

запускає кроки, перевіряє проміжний результат і коригує курс — без запиту до користувача

після кожного кроку

-

Раннє виявлення тупиків: якщо поточний підхід не спрацьовує,

GPT-5.5 раніше розпізнає це і або змінює стратегію, або явно зупиняється

з поясненням — замість безкінечного retry loop, який витрачає токени і час

-

Утримання цілі через багато кроків: у пайплайнах з 10+ кроками

модель не «забуває» початкову задачу до кінця виконання

Команди з раннього доступу (Nvidia, партнери OpenAI) повідомляли про економію до 10 годин

на тиждень — переважно на задачах перегляду великих обсягів документів і

багатокрокового code review, де GPT-5.4 вимагав ручного «підштовхування» між кроками.

Важливий нюанс: persistence — це не те саме, що точність. Модель, яка «не зупиняється»,

може впевнено виконати 10 кроків у неправильному напрямку. Для production-агентів

програмна верифікація проміжних результатів залишається обов'язковою — GPT-5.5 не скасовує

цю необхідність, але зменшує кількість місць, де потрібне ручне втручання.

Orchestration

Тут важливо розрізняти два типи оркестрації: computer use (робота з UI, браузером, додатками)

і CLI/API orchestration (термінал, виклики API, автоматизація без UI).

GPT-5.5 показує різні результати в кожному з них.

Computer use (OSWorld-Verified): 78.7% проти 78.0% у GPT-5.4 — різниця в 0.7pp,

фактично статистична рівність. Якщо ви будуєте агента, який керує браузером або

десктопними додатками, GPT-5.5 не дає відчутного покращення відносно попередника.

CLI і API orchestration (Terminal-Bench 2.0): 82.7% проти 75.1% — +7.6pp.

Це принципово інша картина. Terminal-Bench тестує саме те, що важливо для бекенд-розробників:

навігацію в командному рядку, прийняття рішень через кілька кроків, координацію між

різними CLI-інструментами. Для тих, хто будує агентів, що автоматизують deployment,

тестування, міграції або роботу з Git — це найрелевантніший бенчмарк.

| Тип оркестрації |

Benchmark |

GPT-5.4 |

GPT-5.5 |

Δ |

Висновок |

| Computer use (UI) |

OSWorld-Verified |

78.0% |

78.7% |

+0.7pp |

⚠️ Без суттєвої різниці |

| CLI / API агенти |

Terminal-Bench 2.0 |

75.1% |

82.7% |

+7.6pp |

✅ Реальний приріст |

| Tool orchestration |

MCP Atlas |

67.2% |

75.3% |

+8.1pp |

✅ Приріст, але Claude Opus 4.7 попереду (79.1%) |

Загальний висновок по секції: якщо ви будуєте агента для бекенду — автоматизація CI/CD,

робота з API, кодинг-агент у терміналі — GPT-5.5 дає реальну перевагу.

Якщо агент працює з UI або браузером — різниця мінімальна.

Якщо оркестрація інструментів є центральною частиною продукту — варто протестувати

і Claude Opus 4.7, який на MCP Atlas поки попереду.

Продуктивність і вартість

Ціна GPT-5.5 — одне з головних питань, яке виникає одразу після анонсу.

На папері вона подвоїлась. На практиці — ні. Але й твердження OpenAI про «фактичне подорожчання

на 20%» потребує критичного погляду: цифра самозвітна і не підтверджена незалежно.

Розберемо детально.

Стікер-ціна vs реальна вартість задачі

Офіційне API-ціноутворення GPT-5.5: $5 / $30 за 1M input/output токенів.

Для порівняння, GPT-5.4 — $2.5 / $15. Тобто per-token ціна подвоїлась.

Але per-token ціна — це не те саме, що вартість задачі. OpenAI стверджує, що GPT-5.5

використовує приблизно на 40% менше output-токенів для виконання тих самих Codex-задач.

Це підтверджується незалежним аналізом Artificial Analysis, але без доступу до scaffold бенчмарку.

Математика для конкретного кейсу:

| Модель |

Output токени на задачу |

Ціна за 1K output |

Вартість задачі |

Різниця |

| GPT-5.4 |

100K |

$0.015 |

$1.50 |

— |

| GPT-5.5 |

60K (−40%) |

$0.030 |

$1.80 |

+$0.30 (+20%) |

Різниця +$0.30 за задачу, а не +$1.50. Але є важливий нюанс: у цьому розрахунку

не враховані failed tasks. GPT-5.5 раніше виходить з retry loop при невдалих спробах —

тобто менше токенів витрачається на задачі, які так і не завершились успішно.

Для команд з великим обсягом агентних задач це може бути суттєвою додатковою економією,

яку важко виміряти без реального A/B на своїх даних.

Масштаб: як виглядає рахунок при великих обсягах

| Output токени/місяць |

GPT-5.4 (стандарт) |

GPT-5.5 (–40% токенів) |

Реальна різниця |

| 10M токенів задач |

$150 |

$180 (6M × $0.030) |

+$30/міс |

| 100M токенів задач |

$1,500 |

$1,800 (60M × $0.030) |

+$300/міс |

| 1B токенів задач |

$15,000 |

$18,000 (600M × $0.030) |

+$3,000/міс |

При великих обсягах різниця стає відчутною в абсолютних числах, навіть якщо відсоток той самий.

Перед прийняттям рішення важливо виміряти реальну кількість токенів на типову задачу

у вашому конкретному пайплайні — вона може суттєво відрізнятись від середніх по Codex.

Batch і Flex: як повернутись до ціни GPT-5.4

OpenAI зберіг знижені тарифи для асинхронних workloads:

| Тариф |

Input (1M токенів) |

Output (1M токенів) |

Підходить для |

| GPT-5.5 Standard |

$5.00 |

$30.00 |

Real-time API, агенти |

| GPT-5.5 Batch / Flex |

$2.50 |

$15.00 |

Офлайн задачі, eval, backfill |

| GPT-5.5 Priority |

$12.50 |

$75.00 |

Критичні real-time задачі |

| GPT-5.4 Standard |

$2.50 |

$15.00 |

Базова лінія для порівняння |

Ключовий висновок по Batch: GPT-5.5 Batch коштує стільки ж, скільки GPT-5.4 Standard.

Якщо у вас є offline workloads — eval grading, batch summarization, content backfill,

масова класифікація — ви отримуєте можливості GPT-5.5 за ціною GPT-5.4.

Це найбільш очевидний випадок для переходу.

GPT-5.5 Pro: коли ціна $30/$180 виправдана

GPT-5.5 Pro використовує ту саму базову модель з більшим parallel test-time compute.

Ціна — $30 input / $180 output за 1M токенів, тобто в 6 разів дорожче за базовий GPT-5.5.

За даними Artificial Analysis, при medium compute GPT-5.5 базовий досягає результатів

Claude Opus 4.7 при maximum effort — і коштує при цьому ~$1,200 проти ~$4,800 за 1M токенів

у Claude на максимальних налаштуваннях. GPT-5.5 Pro цільовий для:

- Research-grade задач, де якість важливіша за ціну

- Одиничних складних запитів (юридичний аналіз, медична діагностика, наукові розрахунки)

- Сценаріїв, де вартість однієї помилки перевищує вартість моделі

Застереження: на BullshitBench GPT-5.5 Pro показує ~35% pushback rate — гірше за базовий GPT-5.5 (~45%).

Більше compute не означає менше hallucinations. Для задач, де критична надійність відповіді,

Pro-варіант не дає переваги над базовим.

Швидкість відповіді

Per-token latency GPT-5.5 у реальних умовах ідентична GPT-5.4 — попри суттєво вищу складність моделі.

OpenAI досягнув цього через hardware-software co-design на NVIDIA GB200/GB300 NVL72.

Але для агентних пайплайнів важливіший показник — time-to-completion задачі, а не per-token latency.

Тут GPT-5.5 виграє подвійно: менше токенів на задачу + менше retry-ітерацій при збоях =

коротший час від старту до результату навіть при рівній швидкості генерації токенів.

Головне застереження

Цифра «40% менше токенів» — самозвіт OpenAI, виміряний на внутрішніх Codex-задачах.

Scaffold бенчмарку не опублікований. Artificial Analysis підтвердила тренд незалежно,

але конкретне число залежить від типу задач.

Правило просте: зробіть A/B на своїх реальних промптах до будь-якого рішення про міграцію.

Порівняйте не per-token ціну, а кількість токенів і кількість успішних завершень

на однаковому наборі задач. Ваш billing dashboard скаже більше, ніж будь-який бенчмарк.

Де GPT-5.4 все ще достатньо

Чесно кажучи, перше, що я роблю після будь-якого гучного анонсу OpenAI — шукаю,

де нова модель не потрібна. Маркетинг завжди говорить про те, що стало краще.

Мовчить про те, де нічого не змінилось. А для більшості реальних продуктів

саме це питання — найважливіше.

Я використовую GPT-моделі для summarization і класифікації на WebsCraft —

і одразу після релізу GPT-5.5 у мене не виникло жодного бажання мігрувати цей пайплайн.

Ось чому.

Summarization і класифікація

Для задач типу «вкороти текст», «визнач тему», «витягни структуровані поля» —

GPT-5.4 справляється відмінно. GPT-5.5 у цьому сценарії не дає жодної помітної різниці

у якості, але коштує дорожче per-token. Так, з урахуванням token efficiency реальна доплата

~20% — але навіщо платити навіть 20% більше за результат, який ідентичний?

Весь апсайд GPT-5.5 — це persistence у складних multi-step задачах і довгий контекст.

Summarization не є ні тим, ні іншим. Це одна інструкція, короткий вхід, передбачуваний вихід.

Тут немає що «персистити».

Базовий RAG на фіксованому корпусі

Якщо у вас RAG із заздалегідь підготовленими чанками, фіксованим корпусом і простим

retrieve → generate без складного reasoning — GPT-5.4 і GPT-5.5 дадуть практично однаковий результат.

Якість відповіді в базовому RAG визначається переважно якістю retrieval і чанкінгу,

а не тим, яка модель стоїть у кінці пайплайну.

Інша справа — multi-hop RAG, де модель має самостійно вирішити, що і як шукати,

зробити кілька запитів, зіставити суперечливі джерела. Ось там GPT-5.5 може дати різницю.

Але це вже не «базовий RAG».

Контент-генерація

Я пишу статті для WebsCraft сам — і не збираюсь делегувати це моделі повністю,

незалежно від версії. Але навіть якщо говорити про assistive сценарії: генерація

чернетки, розгортання тез, перефразування — GPT-5.4 впорається так само.

SWE-Bench Pro показує +0.9pp між 5.4 і 5.5. Для текстового контенту різниця,

скоріш за все, ще менша і суб'єктивна.

Окремо: не вірю в цифри OpenAI про те, що GPT-5.5 «значно природніший і менш

сикофантський» порівняно з попередником. Це говорилось про кожну нову модель з GPT-4o.

Перевіряйте самі на своїх промптах.

High-volume батчі з фіксованою структурою

Якщо модель завжди виконує одну просту дію — наприклад, завжди повертає JSON

з трьома полями на основі вхідного тексту — то capability overhead GPT-5.5

просто не задіюється. Ви платите за потенціал autonomous multi-step reasoning,

якого ваш пайплайн не використовує.

Для таких задач формула проста: GPT-5.4 дешевше → якість ідентична → немає причини мігрувати.

А якщо дуже хочеться GPT-5.5 — використовуйте Batch тариф ($2.50/$15),

який ставить його на рівень стандартної ціни GPT-5.4.

Latency-чутливі real-time ендпоінти

Per-token latency у GPT-5.5 ідентична GPT-5.4 — OpenAI це підтверджує, і це підкріплено

технічно (NVIDIA GB200/GB300, кастомні алгоритми балансування). Але якщо у вас

ендпоінт, де критичний time-to-first-token і ви вже оптимізували промпт під мінімальний вихід —

реального виграшу від 5.5 не буде. А от ризик несподівано зміненої поведінки моделі

після міграції — є завжди.

Мій підхід: не міняй те, що працює, без вимірюваної причини.

«Нова модель вийшла» — не є вимірюваною причиною.

Коли перехід на GPT-5.5 виправданий

У попередній секції я говорив про те, де GPT-5.4 залишається достатнім.

Але є сценарії, де різниця між 5.4 і 5.5 — не маркетингова, а реальна і вимірювана.

Скептицизм до анонсів OpenAI не означає заперечення фактів. Якщо бенчмарки показують

+37pp на довгому контексті — це не можна ігнорувати. Розберемо, де саме перехід виправданий

і чому.

Складні агентні пайплайни (5+ кроків)

Це головний сценарій GPT-5.5 — і єдиний, де я б перейшов без довгих вагань.

Якщо ваш агент виконує більше п'яти кроків автономно, стикається зі збоями в середині

і має самостійно вирішувати, як продовжувати — GPT-5.4 тут системно програє.

Проблема GPT-5.4 в таких пайплайнах не в тому, що він «тупіший». Проблема — в поведінці

при невизначеності: зупинявся, питав, або йшов у retry loop. GPT-5.5 navigate через ambiguity —

робить припущення про намір, продовжує, перевіряє результат. Terminal-Bench 2.0:

82.7% проти 75.1%. Це +7.6pp на задачах, де саме ця поведінка і вимірюється.

Практично: якщо у вас CI/CD агент, який сам запускає тести, аналізує лог помилок,

вносить правки і повторює — GPT-5.5 доведе більше таких циклів до успіху без ручного втручання.

Якщо агент для code review, який проходить по кількох файлах, відстежує залежності і формує

зведений звіт — те саме.

Важливе застереження, яке я вже згадував: persistence ≠ точність.

Агент, що «не зупиняється», може впевнено виконати 10 кроків у хибному напрямку.

Програмна верифікація проміжних результатів — обов'язкова, незалежно від моделі.

GPT-5.5 зменшує кількість місць, де потрібне ручне втручання. Але не скасовує

необхідність перевіряти вихід.

Велика кодова база (>200K токенів контексту)

MRCR v2 @ 1M токенів — 74.0% проти 36.6%. Результат більш ніж подвоївся.

Це найбільший кількісний стрибок у всіх бенчмарках GPT-5.5, і він безпосередньо

стосується розробників, які працюють з великими кодовими базами.

Конкретна ситуація: ви подаєте в контекст кілька пов'язаних модулів одночасно —

controller, service, repository, config, тести. GPT-5.4 на обсягах понад 100–150K токенів

починає «губити» деталі нижніх шарів, коли працює з верхніми. GPT-5.5 тримає

весь стек і вносить узгоджені зміни без втрати контексту.

Де це не спрацює: у Codex ліміт — 400K токенів, не 1M. Через API — 1M.

Якщо ваш моноліт виходить за 400K і ви хочете подати його цілком — потрібен прямий API,

а не Codex. Для більшості реальних кодових баз 400K достатньо, але це варто перевірити

заздалегідь, а не після початку міграції.

CLI-агенти і автоматизація через термінал

Тут я свідомо розділяю два сценарії, які в маркетингу OpenAI змішані в один «computer use».

Автоматизація через термінал і API (CLI-агенти): Terminal-Bench 2.0 — +7.6pp.

Реальний приріст. Якщо ви будуєте агента для deployment, Git-операцій, роботи з bash-скриптами,

виклику CLI-інструментів — GPT-5.5 суттєво надійніший.

Computer use (робота з UI, браузером, десктопними додатками): OSWorld-Verified —

78.7% проти 78.0%. Різниця 0.7pp — фактично статистична рівність.

Якщо ваш агент керує браузером або десктопним застосунком — переходити заради

computer use немає сенсу. Тут GPT-5.5 не дає реального покращення відносно 5.4.

Enterprise: фінансові, юридичні, аналітичні задачі

GDPval — бенчмарк OpenAI на знання-інтенсивну роботу, яку виконував би junior-аналітик:

фінансове моделювання, юридичний аналіз документів, дослідницькі задачі.

GPT-5.5 показує 84.9% на цьому бенчмарку.

Але є нюанс, який я не можу ігнорувати: GDPval — внутрішній бенчмарк OpenAI.

Незалежної верифікації методології немає. Я б не будував бізнес-кейс на міграцію

виключно на цій цифрі. Натомість — протестуйте на реальному наборі задач вашої команди.

Де GPT-5.5 реально виграє в enterprise: задачі, де потрібно одночасно тримати

кілька великих документів (контракт + додатки + переписка), робити перехресний аналіз

і давати зважену відповідь. Це саме той сценарій, де +37pp на довгому контексті

перетворюється на конкретну різницю в якості.

Multi-document research

Аналітики, дослідники, редактори — всі, хто регулярно працює з десятками джерел

одночасно. GPT-5.4 на великому корпусі починав «забувати» ранні документи,

коли доходив до пізніх. GPT-5.5 — ні, що підтверджує MRCR v2.

Конкретний кейс: порівняльний аналіз 20+ технічних статей, де потрібно відстежити

суперечливі твердження і зробити зважений висновок. Або підготовка огляду ринку

на основі 15 звітів аналітичних компаній. GPT-5.5 тримає всі джерела в голові —

GPT-5.4 на цьому обсязі деградує.

Де я б перейшов сам — і де ні

Підсумовуючи особисто: якби на WebsCraft з'явився агентний пайплайн з 5+ кроками

або потреба аналізувати великі корпуси документів одночасно — я б тестував GPT-5.5.

Для поточного summarization і класифікації — ні, без вагань.

Загальне правило: перехід виправданий тоді, коли ваша задача структурно вимагає

того, що GPT-5.5 вміє краще — autonomous persistence або довгий контекст.

Якщо задача вирішується одним кроком або коротким промптом — переходити немає сенсу,

незалежно від того, наскільки гарно звучить анонс.

Підсумок: чи варто мігрувати зараз

Після кожного великого релізу в AI-спільноті з'являються два табори: ті, хто мігрує

в перший день, і ті, хто чекає «поки все стабілізується». Обидва підходи — помилкові.

Перший — це FOMO замість рішень. Другий — прокрастинація під виглядом обережності.

Правильний підхід один: визначити, чи ваші конкретні задачі структурно виграють

від того, що GPT-5.5 вміє краще. Не від того, що написано в анонсі. Від того,

що підтверджується незалежними бенчмарками і вашим власним A/B.

Нижче — мій чек-лист. Не OpenAI's, не TechCrunch's. Мій — з урахуванням того,

що я перевірив, що викликає скептицизм і де цифри реально переконують.

| Умова |

Рішення |

Чому |

| Агентний пайплайн з 5+ кроками autonomous execution |

✅ Мігруйте |

Terminal-Bench 2.0 +7.6pp — це не маркетинг, це вимірювана різниця у persistence при збоях |

| Регулярно подаєте >200K токенів контексту |

✅ Мігруйте |

MRCR v2: 74% проти 36.6% — результат подвоївся. Це найбільший стрибок у релізі |

| Batch-обробка великих обсягів офлайн |

✅ Мігруйте на Batch-тариф |

GPT-5.5 Batch = $2.50/$15 — та сама ціна, що й GPT-5.4 Standard. Безризиково |

| Multi-document research з 10+ джерелами одночасно |

✅ Тестуйте |

Довгий контекст — головна перевага 5.5. Але перевірте на своїх документах, не на бенчмарку |

| CLI-агент: deployment, Git, bash-автоматизація |

✅ Тестуйте |

Terminal-Bench підтверджує реальну різницю. Зробіть A/B на своїх скриптах |

| Summarization, класифікація, extraction у великих обсягах |

❌ Не мігруйте |

Якість ідентична GPT-5.4, ціна вища. Немає жодної причини |

| Базовий RAG на фіксованому корпусі |

❌ Не мігруйте |

Якість RAG визначається retrieval і чанкінгом, не моделлю в кінці пайплайну |

| Computer use: агент керує браузером або UI |

❌ Не мігруйте |

OSWorld-Verified: +0.7pp — статистична рівність з GPT-5.4 |

| Hallucination rate критичний для продукту |

⚠️ Обережно |

BullshitBench: GPT-5.5 ≈ GPT-5.4 (~45%). Pro — гірший (~35%). Claude лідирує тут |

| Latency-чутливий real-time ендпоінт |

⚠️ Тестуйте спочатку |

Per-token latency однакова, але поведінка моделі після міграції може змінитись несподівано |

| Потрібен API вже зараз |

✅ Доступний |

З 24 квітня 2026 — Responses і Chat Completions API відкриті |

Як правильно провести A/B перед міграцією

«Зробіть A/B» — порада, яку дають всі. Але рідко пояснюють, що саме вимірювати.

Ось мінімальний набір метрик, які мають сенс:

-

Кількість output-токенів на типову задачу: якщо GPT-5.5 справді використовує

на 40% менше — ваш реальний рахунок зросте не вдвічі. Якщо ні — ви це одразу побачите

у billing dashboard, а не в маркетингових матеріалах

-

Task completion rate: для агентних задач — скільки завершились успішно

без ручного втручання. Це головна метрика, де GPT-5.5 має давати реальну різницю

-

Кількість retry-ітерацій на задачу: якщо агент менше «застряє» —

це видно в логах. Порівняйте середню кількість кроків до успішного завершення

-

Якість виходу на вашому evaluation set: не на бенчмарку OpenAI,

а на реальних прикладах з вашого продукту. 20–30 репрезентативних задач достатньо

для першого висновку

Мій особистий вердикт

GPT-5.5 — перший реліз OpenAI за довгий час, де я бачу реальну технічну причину

для міграції у конкретних сценаріях. Не «стало трохи краще скрізь», а

«зробило стрибок у вузькій ніші». Це чесніша позиція, ніж попередні релізи.

Але «реальна причина для міграції у конкретних сценаріях» — це не те саме,

що «мігруйте всі прямо зараз». Якщо ваші задачі не потрапляють у верхні рядки

чек-листу вище — почекайте. Не тому що «треба почекати поки стабілізується»,

а тому що переплачувати за можливості, які ви не використовуєте — просто нераціонально.

І останнє: якою б не була модель — ваша відповідальність перевірити її на своїх даних.

Я перевіряю. Раджу і вам.

❓ Часті питання (FAQ)

Чи замінює GPT-5.5 GPT-5.4 повністю?

Ні — і це принципово важливо розуміти перед будь-яким рішенням про міграцію.

GPT-5.5 перевершує GPT-5.4 у конкретній ніші: агентні пайплайни з 5+ кроками,

довгий контекст понад 200K токенів, CLI-автоматизація. Для всього іншого —

summarization, класифікація, базовий RAG, контент-генерація — GPT-5.4 залишається

достатнім і дешевшим варіантом. Повна заміна відбудеться тоді, коли ціна GPT-5.5

впаде або коли GPT-5.4 буде виведений з обігу. Зараз — це два різних інструменти

для різних задач.

GPT-5.5 реально вдвічі дорожчий за GPT-5.4?

Per-token ціна подвоїлась: $2.5/$15 → $5/$30 за 1M input/output токенів. Але вартість

задачі — ні. OpenAI стверджує, що GPT-5.5 використовує ~40% менше output-токенів

на ті самі Codex-задачі. Якщо це так, реальна доплата — близько 20%, а не 100%.

Artificial Analysis підтвердила тренд незалежно, але точна цифра залежить від типу задач.

Перевіряйте на своєму billing dashboard, а не на маркетингових матеріалах.

Batch-тариф ($2.50/$15) ставить GPT-5.5 на рівень стандартної ціни GPT-5.4 —

для офлайн workloads це найпростіший спосіб тестувати без ризику перевитрат.

Чи доступний GPT-5.5 через API?

Так, з 24 квітня 2026 — через Responses і Chat Completions API.

На момент запуску 23 квітня API був закритий: OpenAI пояснив це необхідністю

додаткових safeguards для cybersecurity і bio-ризиків, які вимагають іншого підходу,

ніж у ChatGPT. Зараз модель доступна стандартно. Batch і Flex pricing також активні —

за половину від стандартного тарифу.

Що таке GPT-5.5 Pro і кому він потрібен?

GPT-5.5 Pro — та сама базова модель, але з більшим parallel test-time compute.

Коштує $30/$180 за 1M токенів — у шість разів дорожче за базовий GPT-5.5.

Позиціонується для research-grade і high-stakes задач: наукові розрахунки, медична діагностика,

складний юридичний аналіз. Але є важливий нюанс: на BullshitBench GPT-5.5 Pro

показує ~35% pushback rate — гірше, ніж базовий GPT-5.5 (~45%). Більше compute

не означає менше hallucinations. Якщо для вас критична надійність відповіді —

Pro не вирішує цю проблему.

Чи підтримує GPT-5.5 контекст 1M токенів?

Так — і це перший раз, коли «1M токенів» у OpenAI означає реально працюючу можливість,

а не маркетингову цифру. MRCR v2 @ 1M токенів: GPT-5.5 — 74%, GPT-5.4 — 36.6%.

Результат більш ніж подвоївся. Але є обмеження: у Codex максимум — 400K токенів,

а не 1M. Повний мільйон доступний тільки через прямий API. Для більшості реальних

кодових баз 400K достатньо — але якщо у вас великий моноліт або кілька репозиторіїв

одночасно, рахуйте заздалегідь.

Чи варто чекати на GPT-5.5 у безкоштовному тарифі ChatGPT?

На момент публікації GPT-5.5 доступний тільки для платних підписників: Plus, Pro,

Business і Enterprise у ChatGPT; Plus і вище у Codex. Безкоштовний тариф не отримав

доступу. OpenAI не анонсував терміни розширення доступу — якщо це критично для вас,

орієнтуйтесь на офіційну сторінку моделей OpenAI, а не на чутки.

GPT-5.5 краще за Claude Opus 4.7?

Залежить від задачі — і це не дипломатична відповідь, а факт.

GPT-5.5 лідирує на Terminal-Bench 2.0 (82.7% проти 69.4%) і довгому контексті (MRCR v2).

Claude Opus 4.7 лідирує на SWE-Bench Pro (64.3% проти 58.6%), MCP Atlas (79.1% проти 75.3%)

і BullshitBench (менше hallucinations). На HLE без інструментів — теж попереду (46.9% проти 41.4%).

Якщо будуєте CLI-агента або працюєте з великим контекстом — GPT-5.5.

Якщо критична надійність відповіді або оркестрація інструментів — Claude варто тестувати поруч.

✅ Висновки

GPT-5.5 — перший реліз OpenAI за довгий час, де я бачу реальну технічну причину

для міграції. Не «стало трохи краще скрізь», а конкретний стрибок у вузькій ніші.

Це чесніша позиція, ніж попередні релізи — і саме тому до неї варто ставитись серйозно,

а не відмахуватись як від чергового хайпу.

Але «реальна причина для міграції у вузькій ніші» — це не «мігруйте всі прямо зараз».

Нижче — те, що я виніс із цього аналізу як практичний підсумок.

-

🏆 Найбільша перемога — довгий контекст: MRCR v2 +37.4pp — результат подвоївся.

Якщо ви регулярно подаєте понад 200K токенів в один запит, це єдиний аргумент,

якого достатньо для тесту GPT-5.5.

-

🤖 Агентний кодинг — реальний, не маркетинговий: Terminal-Bench 2.0 +7.6pp

підтверджений незалежно. Persistence при збоях, менше retry loops, вища task completion rate

на складних пайплайнах. Якщо ваш агент виконує 5+ кроків автономно — тестуйте.

-

⚠️ Hallucinations не покращились — і це важливо не замовчувати:

BullshitBench: GPT-5.5 ≈ GPT-5.4 (~45% pushback). Pro — гірший (~35%).

Claude моделі досі лідирують тут. Якщо надійність відповіді критична — GPT-5.5

не вирішує цю проблему.

-

💰 Реальна доплата ~20%, не 100%: але тільки якщо ваші задачі

структурно виграють від token efficiency GPT-5.5. Для summarization і класифікації —

ніякої економії немає, є тільки доплата. Batch-тариф ($2.50/$15) повністю нівелює

різницю для офлайн workloads.

-

❌ Де точно не мігрувати: summarization, класифікація, базовий RAG,

контент-генерація, computer use через UI. Тут GPT-5.4 дешевший і дає ідентичний результат.

-

🔬 Правило №1 — незмінне: A/B на своїх реальних промптах і tool calls

перед будь-яким рішенням. Вимірюйте output-токени, task completion rate і кількість

retry-ітерацій — не per-token ціну і не бенчмарки з анонсу OpenAI.

AI-моделі виходять дедалі частіше. Шість тижнів між GPT-5.4 і GPT-5.5 —

це новий темп, і він не сповільниться. Реагувати на кожен реліз міграцією —

не стратегія, це операційний хаос. Реагувати ігноруванням — теж не стратегія,

це втрата реальних переваг там, де вони є.

Єдиний робочий підхід: знати свої задачі краще, ніж маркетологи знають свою модель.

Тоді кожен наступний реліз — це не тривога і не хайп, а просто чек-лист із двома

колонками: «виграю» і «не виграю». GPT-5.5 я перевірив. Ви — перевіряйте самі.