OpenAI hat GPT-5.5 nur sechs Wochen nach GPT-5.4 veröffentlicht – und das ist kein weiterer Patch.

Spoiler: Das erste komplett neu trainierte Basismodell seit GPT-4.5 bietet einen echten Sprung bei Agentenaufgaben und langem Kontext, hat sich aber bei Halluzinationen nicht verbessert – und kostet 20 % mehr, nicht doppelt so viel, wie es auf den ersten Blick scheint.

⚡ Kurz gesagt

- ✅ Terminal-Bench 2.0: 82,7 % (+7,6pp): GPT-5.5 führt bei öffentlichen Modellen im Agenten-Coding

- ✅ Langer Kontext: MRCR v2 74 % vs. 36,6 %: Der größte Sprung – die Qualität bei 1 Mio. Tokens hat sich real verdoppelt

- ✅ Effektive Zusatzkosten ~20 %, nicht 100 %: Das Modell verbraucht ~40 % weniger Tokens pro Aufgabe

- ⚠️ Halluzinationen haben sich nicht verbessert: BullshitBench – 45 % Pushback, genauso viel wie bei GPT-5.4

- 🎯 Sie erhalten: Eine konkrete Checkliste – jetzt migrieren oder nicht, mit realen Zahlen für jedes Szenario

- 👇 Unten – detaillierte Erklärungen, Benchmarks, Tabellen und die Entscheidungs-Checkliste

📚 Artikelinhalt

Was ist GPT-5.5 und warum wurde es veröffentlicht

GPT-5.5 (interner Codename – „Spud“) wurde am 23. April 2026 veröffentlicht – sechs Wochen nach GPT-5.4.

Es ist das erste komplett neu trainierte Basismodell von OpenAI seit GPT-4.5. Alle Veröffentlichungen dazwischen waren

hauptsächlich Tuning und Iterationen an der bestehenden Architektur. GPT-5.5 ist kein GPT-5.4 mit Patches.

Positionierung innerhalb der OpenAI-Produktlinie im April 2026:

| Modell |

Zweck |

API-Preis (Input / Output pro 1 Mio. Tokens) |

| GPT-5.5 |

Flaggschiff für Agenten- und komplexe Aufgaben |

5 $/30 $ |

| GPT-5.5 Pro |

Research-Grade, maximale Genauigkeit |

30 $/180 $ |

| GPT-5.4 |

High-Volume, latenzempfindliche Endpunkte |

2,5 $/15 $ |

Warum die Veröffentlichung nach sechs Wochen? Wettbewerbsdruck: Anthropic kündigte Claude Mythos Preview an,

Google drängt mit Gemini 3.1 Pro. Aber der Unterschied zwischen 5.4 und 5.5 ist signifikant größer als bei früheren Updates –

und das bestätigen unabhängige Benchmarks.

Schlüsselunterschiede zwischen GPT-5.5 und GPT-5.4

GPT-5.5 führt den Artificial Analysis Intelligence Index

mit einem Ergebnis von 60 Punkten an – drei Punkte vor Claude Opus 4.7 und Gemini 3.1 Pro (beide 57).

GPT-5.4 liegt auf dem gleichen Niveau von 57. Das bedeutet, GPT-5.5 ist das erste Modell, das sich wirklich von der Spitzengruppe absetzt

und nicht nur innerhalb der statistischen Fehlermarge herumgewirbelt wird.

Aber der Gesamtindex ist ein Durchschnitt. Wichtiger ist zu verstehen, wo genau der Unterschied liegt

und wo er fast fehlt. Betrachten wir jeden Bereich einzeln.

Agenten-Coding und Arbeit im Terminal

Terminal-Bench 2.0 ist der aussagekräftigste Benchmark für Entwickler. Er testet nicht die Code-Generierung,

sondern die Fähigkeit des Modells, sich in einer CLI-Umgebung zurechtzufinden: Entscheidungen über mehrere Schritte hinweg zu treffen,

Tools zu koordinieren, mit unerwarteten Fehlern umzugehen. GPT-5.5 zeigt 82,7 % gegenüber

75,1 % bei GPT-5.4 – ein Zuwachs von +7,6pp. Dies ist das höchste Ergebnis unter den öffentlich verfügbaren Modellen:

zum Vergleich, Claude Opus 4.7 – 69,4 %, Gemini 3.1 Pro – niedriger.

Was bedeutet das in der Praxis: Ein Agent auf GPT-5.5 bleibt seltener mitten im Workflow stecken und bringt die Aufgabe

häufiger zu einem tatsächlichen Ergebnis, ohne zusätzliche menschliche Eingriffe.

Orchestrierung von Tools

MCP Atlas – ein Benchmark von Scale AI für Multi-Step-Tool-Orchestrierung.

GPT-5.5: 75,3 %, GPT-5.4: 67,2 % (+8,1pp). Dies ist der zweitgrößte Zuwachs in der Tabelle.

Hier ist der Kontext wichtig: Claude Opus 4.7 zeigt bei diesem Benchmark 79,1 % – das heißt, bei der Orchestrierung

von Tools ist Anthropic noch führend. GPT-5.5 hat aufgeholt, aber nicht überholt.

Langer Kontext – der größte Sprung

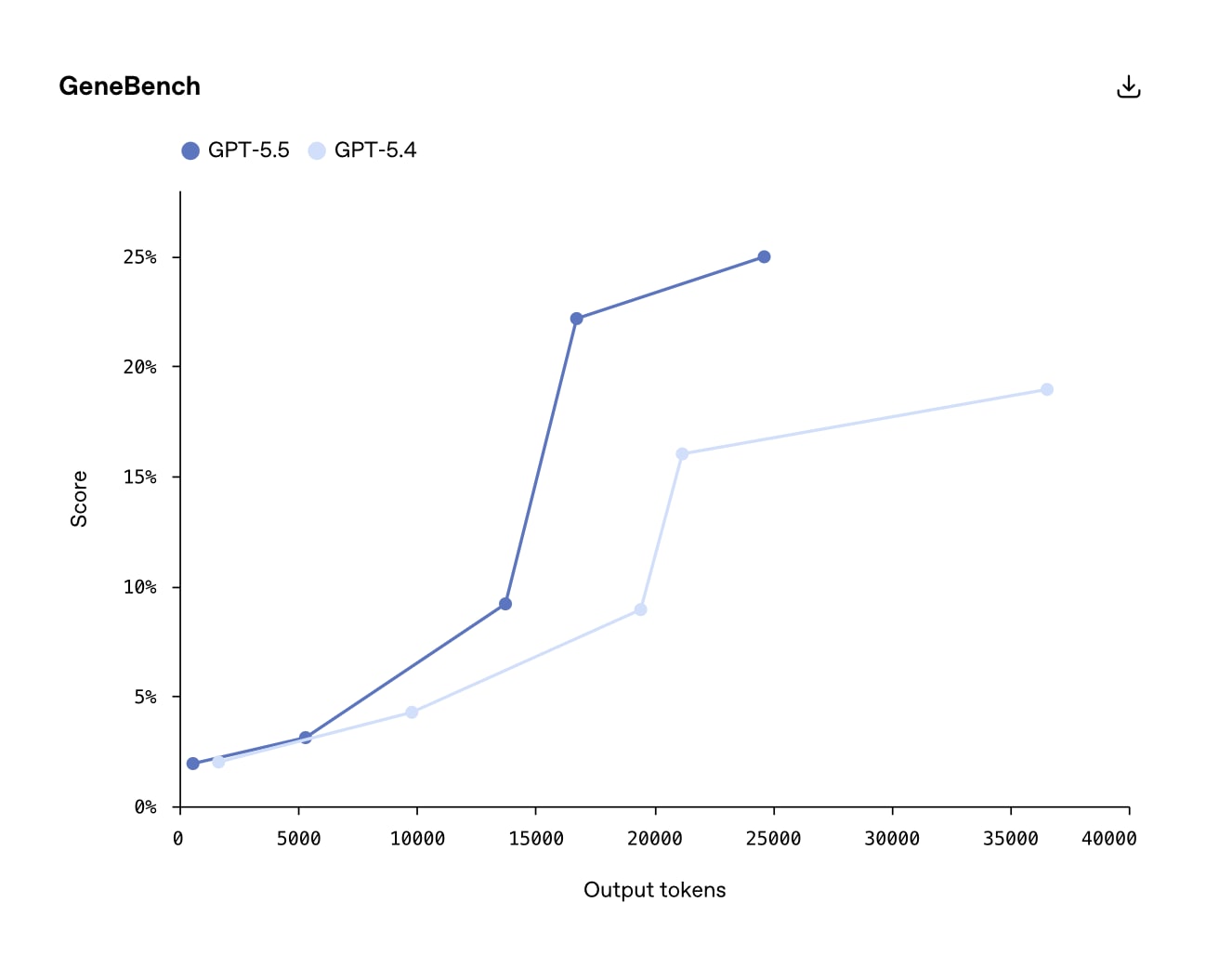

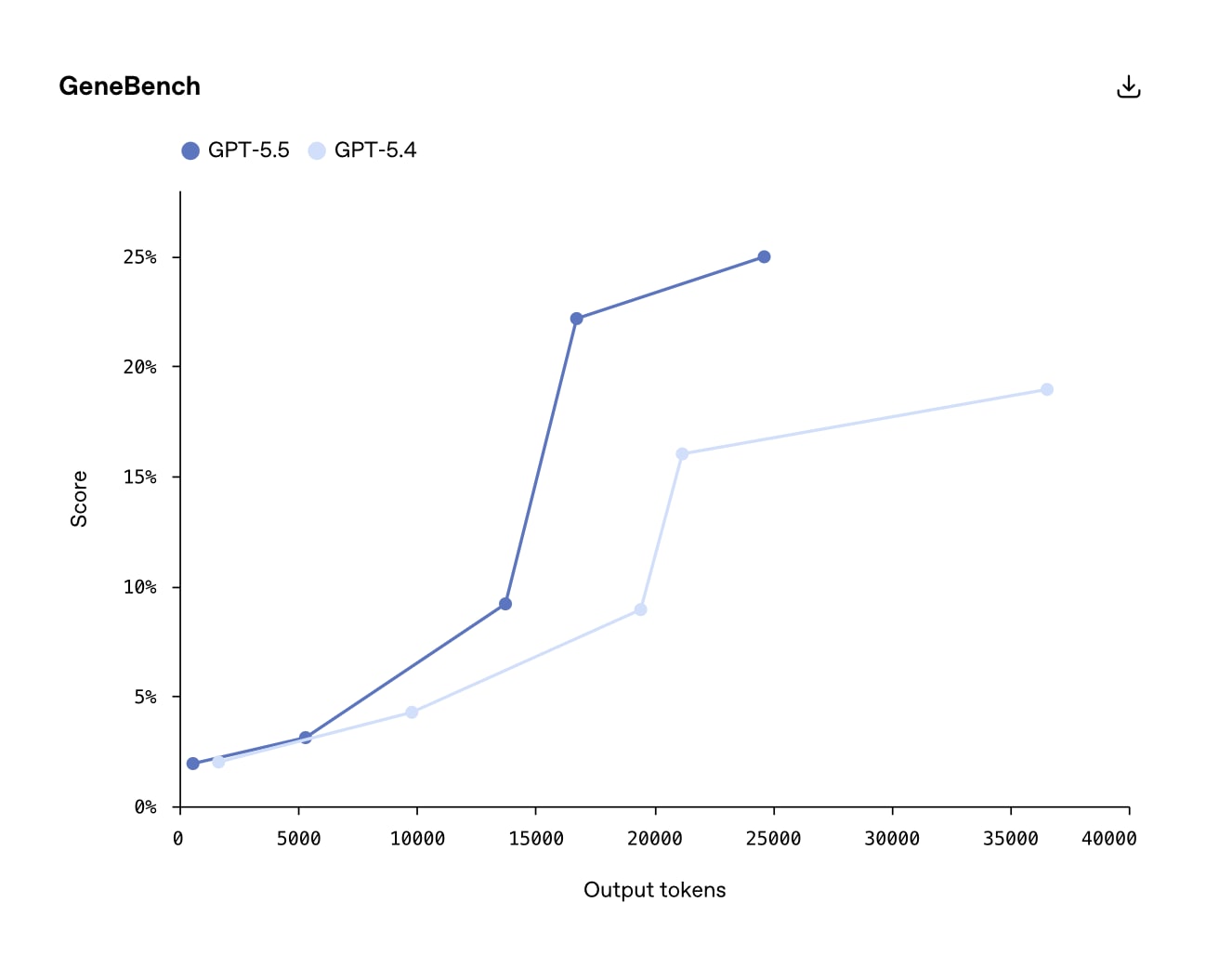

MRCR v2 @ 1 Mio. Tokens – ein Benchmark für Retrieval und Reasoning in sehr langem Kontext.

GPT-5.4: 36,6 %. GPT-5.5: 74,0 %. Zuwachs – +37,4pp, das Ergebnis hat sich mehr als verdoppelt.

Das ist prinzipiell wichtig. Das „1-Million-Token-Fenster“ bei GPT-5.4 existierte auf dem Papier – aber die Qualität der Arbeit

mit wirklich langem Kontext war schwach. GPT-5.5 ist das erste Modell von OpenAI, bei dem eine Million Token Kontext

eine tatsächlich funktionierende Möglichkeit ist, keine Marketingzahl.

Für Entwickler, die große Codebasen oder Dutzende von Dokumenten in eine Anfrage einspeisen,

ist dies die wichtigste praktische Änderung in dieser Veröffentlichung.

Wo der Zuwachs minimal ist

SWE-Bench Pro – ein Benchmark zur Lösung realer GitHub-Issues. GPT-5.4: ~57,7 %, GPT-5.5: 58,6 % (+0,9pp).

Fast nichts. Aber SWE-Bench Pro ist der Benchmark, bei dem sich alle Frontier-Modelle innerhalb

von 1-2 Prozentpunkten voneinander gruppieren. Ein wichtigerer Indikator hier ist die Anzahl der Tokens pro Aufgabe,

und bei diesem Parameter ist GPT-5.5 durchweg effizienter.

Zum Vergleich: Claude Opus 4.7 bei SWE-Bench Pro – 64,3 %, das heißt, bei Aufgaben wie

„einen bestimmten Bug in einem realen Repository beheben“ ist Anthropic noch führend.

Reines akademisches Wissen ohne Tools

HLE (Humanity's Last Exam) ohne Tools – ein Test für die Tiefe des Wissens in komplexen interdisziplinären Fragen.

GPT-5.5: 41,4 %. GPT-5.5 Pro: 43,1 %. Claude Opus 4.7: 46,9 %. Mythos Preview: 56,8 %.

Die Schlussfolgerung ist eindeutig: Bei reinem akademischem Wissen ohne Zugriff auf Tools führt OpenAI noch nicht.

Wenn Ihr Szenario die Beantwortung komplexer wissenschaftlicher oder interdisziplinärer Fragen ohne Suche ist,

zeigen Claude Opus 4.7 oder Mythos (für diejenigen mit Zugang) ein besseres Ergebnis.

| Benchmark |

Was wird gemessen |

GPT-5.4 |

GPT-5.5 |

Δ |

Führend unter allen Modellen |

| Terminal-Bench 2.0 |

Agenten-Coding in CLI |

75,1 % |

82,7 % |

+7,6pp |

GPT-5.5 ✅ |

| MCP Atlas (Tool-Nutzung) |

Tool-Orchestrierung |

67,2 % |

75,3 % |

+8,1pp |

Claude Opus 4.7 (79,1 %) |

| MRCR v2 @ 1 Mio. Tokens |

Langer Kontext |

36,6 % |

74,0 % |

+37,4pp |

GPT-5.5 ✅ |

| ARC-AGI-2 |

Abstraktes Reasoning |

— |

— |

+11,7pp |

GPT-5.5 ✅ |

| SWE-Bench Pro |

Reale GitHub-Issues |

~57,7 % |

58,6 % |

+0,9pp |

Claude Opus 4.7 (64,3 %) |

| HLE ohne Tools |

Akademisches Wissen |

— |

41,4 % |

— |

Mythos Preview (56,8 %) |

Latenz

Trotz deutlich größerer Fähigkeiten entspricht GPT-5.5 GPT-5.4 bei der Pro-Token-Latenz unter realen Bedingungen.

Normalerweise sind leistungsfähigere Modelle langsamer. Hier ist das nicht passiert.

Technisch wurde dies durch eine tiefe Integration von Hardware und Software erreicht: Das Modell wird auf

NVIDIA GB200 und GB300 NVL72 bedient, mit benutzerdefinierten heuristischen Algorithmen zur Lastverteilung zwischen

GPU-Kernen – was zu einer +20 % schnelleren Token-Generierung führte. Bemerkenswert ist, dass diese Algorithmen teilweise mit Hilfe von GPT-5.5 geschrieben wurden.

Praktische Konsequenz: Weniger Tokens pro Aufgabe + erhaltene Latenz = geringere End-to-End-Zeit

für die meisten Agentenszenarien im Vergleich zu GPT-5.4.

Codequalität: Ist es in der Praxis besser geworden

Kurze Antwort: Ja, aber nicht überall und nicht gleichmäßig. GPT-5.5 ist keine „bessere Version von GPT-5.4

für jeden Code“. Es ist ein Modell, das einen Sprung bei einem bestimmten Aufgabentyp gemacht hat –

und in anderen Bereichen auf dem gleichen Niveau geblieben ist. Betrachten wir jeden Bereich ehrlich.

Generierung von neuem Code

Wenn Sie eine beeindruckende Verbesserung bei der Generierung neuer Komponenten von Grund auf erwarten – wahrscheinlich

werden Sie von der Minimalität überrascht sein. Bei SWE-Bench Pro (reale GitHub-Issues, bei denen ein korrekter Patch geschrieben werden muss)

zeigt GPT-5.5 58,6 % gegenüber 57,7 % bei GPT-5.4. Der Unterschied – weniger als ein Prozentpunkt.

Zum Vergleich: Claude Opus 4.7 liegt bei diesem Benchmark bei 64,3 %. Wenn Ihr Hauptszenario

die Generierung neuer Funktionen oder Dienste nach Spezifikation ist und Sie bereits Claude verwenden,

lohnt sich ein Wechsel wegen der Generierungsqualität nicht.

Refactoring großer Codebasen

Hier ist der Unterschied real. Laut dem GitHub Copilot-Team

(GPT-5.5 erschien dort am 24. April) ist das Modell am stärksten bei komplexen Multi-Step-Agenten-Coding-Aufgaben.

Schlüsselbegriff – Persistenz durch Kontext.

GPT-5.4 vergaß bei großen Refactorings oft das ursprüngliche Ziel nach mehreren Schritten –

insbesondere wenn die Änderung mehrere Dateien betraf. GPT-5.5 behält die allgemeine Absicht besser bei und

„zieht“ Änderungen konsequent durch die gesamte Codebasis. Dies liegt nicht an Magie, sondern an einer konkreten

Zahl: MRCR v2 @ 1 Mio. Tokens – 74 % gegenüber 36,6 %. Das Modell liest einfach besser, was bereits getan wurde,

und verliert nicht den Faden.

Praktisch sieht das so aus:

-

Umbenennung mit kaskadierenden Änderungen: GPT-5.5 verfolgt alle Verwendungsstellen

und übersieht keine Importe oder Abhängigkeiten in benachbarten Modulen

-

Änderung der Methodensignatur: Das Modell findet selbstständig alle Aufrufstellen und passt sie an,

statt nach der ersten Datei aufzuhören

-

Migration zwischen Bibliotheksversionen: Behält gleichzeitig die alte und die neue API im Gedächtnis

während eines mehrstufigen Prozesses

Debugging

Eine der auffälligsten praktischen Verbesserungen ist das Verhalten bei mehrdeutigen Fehlern.

GPT-5.4 geriet in Situationen, in denen die Ursache des Fehlers nicht offensichtlich war, oft in eine Retry-Schleife:

Es versuchte etwas, es funktionierte nicht, es versuchte etwas Ähnliches, es funktionierte wieder nicht – und so weiter im Kreis,

verbrauchte Tokens und Zeit ohne Ergebnis.

GPT-5.5 erkennt früher, dass der aktuelle Ansatz nicht funktioniert, und ändert entweder die Strategie

oder stoppt explizit und erklärt, warum die Aufgabe mit den verfügbaren Informationen nicht gelöst werden kann.

Dies reduziert die Anzahl der Tokens für fehlgeschlagene Versuche – und damit die tatsächlichen Kosten von Debugging-Sitzungen.

Testen und Validierung

GPT-5.5 kann nach der Code-Generierung selbstständig einen Test ausführen, das Ergebnis analysieren

und die Arbeit fortsetzen – ohne Benutzeranfrage. Wenn der Test fehlschlägt, gibt das Modell den Code nicht

„wie er ist“ mit der Erklärung „wahrscheinlich liegt das Problem hier“ zurück – es geht weiter und korrigiert.

Dies ist besonders in Codex bemerkenswert, wo OpenAI das Modell speziell für dieses Szenario optimiert hat.

Teams im Early Access berichteten von Einsparungen von bis zu 10 Stunden pro Woche

bei Code-Reviews und Dokumentenprüfungen – gerade weil das Modell nach dem ersten Entwurf nicht stoppt.

Arbeit mit großen Dateien

Wenn Sie eine große monolithische Datei, mehrere zusammenhängende Module oder

Dutzende von Dokumenten gleichzeitig in den Kontext einspeisen – GPT-5.5 ist wirklich anders. MRCR v2 @ 1 Mio. Tokens zeigt

einen Anstieg von 36,6 % auf 74,0 % – mehr als das Doppelte.

Konkretes Beispiel: Ein Spring Boot-Service mit mehreren Ebenen (Controller, Service, Repository,

DTO, Config) wird in einem einzigen Kontext eingegeben. GPT-5.4 verlor oft Details der unteren Ebenen,

wenn es mit den oberen arbeitete. GPT-5.5 behält den gesamten Stack gleichzeitig im Auge und kann konsistente

Änderungen vornehmen, ohne den Kontext zwischen den Komponenten zu verlieren.

Einschränkungen: In Codex beträgt das Maximum 400.000 Tokens (nicht 1 Mio.). 1 Mio. ist nur über API verfügbar.

Für die meisten realen Codebasen reichen 400.000 aus, aber wenn Sie einen großen Monolithen haben oder

mehrere Repositories einspeisen müssen – berücksichtigen Sie diese Einschränkung.

Fehler und Halluzinationen – die ehrliche Bilanz

Hier ist GPT-5.5 – kein Gewinner, und das sollte nicht verschwiegen werden.

Laut den Ergebnissen von BullshitBench –

ein Benchmark, der die Fähigkeit des Modells bewertet, unsinnige oder irrelevante Anfragen abzulehnen –

zeigt GPT-5.5 eine Pushback-Rate von ~45 %. Ungefähr das Gleiche wie GPT-5.4.

Die Verbesserung gegenüber dem Vorgänger – null.

GPT-5.5 Pro – schlechter: ~35 % Pushback-Rate. Mehr Denk-Rechenleistung behebt das Problem nicht –

im Gegenteil, das Modell investiert zusätzliche Zeit in die „Rationalisierung“ von Unsinn, anstatt ihn abzulehnen.

Peter Gostev (AI Capability Lead, Arena.ai) kommentiert: „Es scheint, dass ab einer bestimmten Größe

das Training nach dem Kern-Training, nicht mehr Rechenleistung, die Verbesserung bringt.“

| Modell |

BullshitBench Pushback-Rate |

Bewertung |

| Claude (Anthropic-Modelle) |

Am höchsten unter den Spitzenreitern |

✅ Führend |

| GPT-5.5 |

~45 % |

⚠️ Keine Änderung vs. 5.4 |

| GPT-5.4 |

~45 % |

⚠️ Basislinie |

| GPT-5.5 Pro |

~35 % |

❌ Schlechter als Basis |

Praktische Schlussfolgerung: Wenn die Halluzinationsrate in Ihrem Produkt kritisch ist –

zum Beispiel ein RAG-Assistent für Kunden, juristische oder medizinische Inhalte – löst GPT-5.5

dieses Problem nicht. Für solche Szenarien bleibt Claude Opus 4.7 die zuverlässigere Wahl.

Wenn Sie jedoch eine Agenten-Pipeline aufbauen, bei der jeder Schritt programmatisch verifiziert wird – ist die Halluzinationsrate

des Modells weniger kritisch, und hier überwiegen die Vorteile von GPT-5.5.

Arbeiten mit Agenten und Werkzeugen

Agentenarbeit ist die Hauptstärke von GPT-5.5. OpenAI positioniert das Modell direkt als Schritt

zu einer „neuen Art der Computerinteraktion“: nicht Prompt → Antwort, sondern Aufgabe → autonome Ausführung.

Wenn Sie die Mechanik verstehen wollen, wie Modelle mit Werkzeugen arbeiten –

lesen Sie unseren Artikel über Tool Use vs. Function Calling, JSON Schema und die Verbindung zu RAG.

Schauen wir uns an, was hinter dem neuen Release auf der Ebene konkreter Fähigkeiten steckt.

Function Calling

Formal hat sich die API für Function Calling in GPT-5.5 nicht geändert – dieselben Schemata, derselbe Syntax.

Der wirkliche Unterschied liegt in der Qualität der Entscheidungen über den Aufruf.

GPT-5.4 rief in komplexen Szenarien oft ein Werkzeug aufgrund der ersten oberflächlichen Übereinstimmung auf:

es gibt eine Funktion search() – ich rufe sie auf, auch wenn die Aufgabe lokal ohne Anfrage gelöst wird.

GPT-5.5 bewertet besser, ob ein Werkzeug überhaupt benötigt wird, und wenn ja – welches genau und mit welchen Parametern.

Dies wird auf dem Tau2-bench telecom bestätigt – einem Benchmark für mehrstufige Ausführung über Werkzeuge

in einer realistischen Umgebung (Telekommunikationsszenarien mit verzweigter Logik).

GPT-5.5 zeigt eine deutliche Verbesserung gegenüber 5.4. Zum Vergleich: auf MCP Atlas

(ein breiterer Benchmark für Tool-Orchestrierung) liegt Claude Opus 4.7 immer noch vorn – 79,1 % gegenüber 75,3 %.

Das heißt, GPT-5.5 hat aufgeholt, aber in dieser Kategorie nicht überholt.

Wo dies in der Praxis sichtbar ist:

-

Weniger unnötige Aufrufe: Der Agent „pingt“ nicht jedes Mal eine externe API, wenn die Antwort

im Kontext vorhanden ist – dies reduziert direkt die Latenz und die Kosten der Pipeline.

-

Richtige Reihenfolge: Wenn eine Aufgabe zuerst Daten abrufen, dann transformieren und dann speichern erfordert –

baut das Modell diese Reihenfolge selbstständig auf, ohne explizite Anweisungen für jeden Schritt.

-

Verarbeitung von Werkzeugfehlern: Wenn ein Aufruf einen Fehler oder ein leeres Ergebnis zurückgibt,

passt GPT-5.5 die Strategie an, anstatt einfach denselben Aufruf zu wiederholen.

Multi-Step Execution

Der Hauptunterschied zu GPT-5.4 ist das Verhalten unter Mehrdeutigkeit.

GPT-5.4 benötigte tatsächlich explizite Anleitung bei jedem Schritt: wenn die Aufgabe

nicht ausreichend spezifiziert war – stoppte es und fragte nach. Wenn ein Fehler auftrat – stoppte es oder

ging in eine Wiederholungsschleife. Dies verwandelte die „Agenten“-Pipeline in einen halbmanuellen Prozess.

GPT-5.5 verhält sich anders: Navigieren durch Mehrdeutigkeit – den wahrscheinlichsten Absicht ermitteln und fortfahren, anstatt zu blockieren. Schlüsselmerkmale:

-

Plan → Ausführen → Überprüfen → Fortfahren: Das Modell erstellt selbstständig einen Ausführungsplan,

führt Schritte aus, überprüft das Zwischenergebnis und korrigiert den Kurs – ohne Anfrage an den Benutzer

nach jedem Schritt.

-

Frühes Erkennen von Sackgassen: Wenn der aktuelle Ansatz nicht funktioniert,

erkennt GPT-5.5 dies früher und ändert entweder die Strategie oder stoppt explizit

mit einer Erklärung – anstatt einer endlosen Wiederholungsschleife, die Tokens und Zeit verbraucht.

-

Zielbeibehaltung über viele Schritte hinweg: In Pipelines mit 10+ Schritten

„vergisst“ das Modell die ursprüngliche Aufgabe nicht bis zum Ende der Ausführung.

Frühe Zugangsteams (Nvidia, OpenAI-Partner) berichteten von Einsparungen von bis zu 10 Stunden

pro Woche – hauptsächlich bei Aufgaben zur Überprüfung großer Dokumentenmengen und

mehrstufiger Code-Reviews, bei denen GPT-5.4 manuelle „Anstöße“ zwischen den Schritten erforderte.

Wichtiger Hinweis: Persistenz ist nicht dasselbe wie Genauigkeit. Ein Modell, das „nicht stoppt“,

kann 10 Schritte in die falsche Richtung selbstbewusst ausführen. Für Produktionsagenten

bleibt die programmgesteuerte Überprüfung von Zwischenergebnissen obligatorisch – GPT-5.5 hebt diese Notwendigkeit nicht auf,

reduziert aber die Stellen, an denen manuelle Eingriffe erforderlich sind.

Orchestrierung

Hier ist es wichtig, zwei Arten der Orchestrierung zu unterscheiden: Computer Use (Arbeit mit UI, Browser, Anwendungen)

und CLI/API Orchestrierung (Terminal, API-Aufrufe, Automatisierung ohne UI).

GPT-5.5 zeigt in jedem dieser Bereiche unterschiedliche Ergebnisse.

Computer Use (OSWorld-Verified): 78,7 % gegenüber 78,0 % bei GPT-5.4 – ein Unterschied von 0,7 pp,

im Grunde statistische Gleichheit. Wenn Sie einen Agenten bauen, der einen Browser oder

Desktop-Anwendungen steuert, bietet GPT-5.5 keine spürbare Verbesserung gegenüber seinem Vorgänger.

CLI und API Orchestrierung (Terminal-Bench 2.0): 82,7 % gegenüber 75,1 % – +7,6 pp.

Dies ist ein prinzipiell anderes Bild. Terminal-Bench testet genau das, was für Backend-Entwickler wichtig ist:

Navigation in der Befehlszeile, Entscheidungsfindung über mehrere Schritte, Koordination zwischen

verschiedenen CLI-Tools. Für diejenigen, die Agenten bauen, die Deployment,

Tests, Migrationen oder die Arbeit mit Git automatisieren – ist dies der relevanteste Benchmark.

| Art der Orchestrierung |

Benchmark |

GPT-5.4 |

GPT-5.5 |

Δ |

Fazit |

| Computer Use (UI) |

OSWorld-Verified |

78,0 % |

78,7 % |

+0,7 pp |

⚠️ Kein wesentlicher Unterschied |

| CLI / API Agenten |

Terminal-Bench 2.0 |

75,1 % |

82,7 % |

+7,6 pp |

✅ Realer Zuwachs |

| Tool Orchestrierung |

MCP Atlas |

67,2 % |

75,3 % |

+8,1 pp |

✅ Zuwachs, aber Claude Opus 4.7 liegt vorn (79,1 %) |

Gesamtfazit für diesen Abschnitt: Wenn Sie einen Agenten für das Backend bauen – CI/CD-Automatisierung,

API-Arbeit, Coding-Agent im Terminal – bietet GPT-5.5 einen echten Vorteil.

Wenn der Agent mit UI oder Browser arbeitet – ist der Unterschied minimal.

Wenn die Orchestrierung von Werkzeugen ein zentraler Bestandteil des Produkts ist – lohnt es sich,

auch Claude Opus 4.7 zu testen, der auf MCP Atlas immer noch vorn liegt.

Leistung und Kosten

Der Preis von GPT-5.5 ist eine der Hauptfragen, die sofort nach der Ankündigung aufkommt.

Auf dem Papier hat er sich verdoppelt. In der Praxis – nicht. Aber auch die Aussage von OpenAI über eine „tatsächliche Preissteigerung

um 20 %“ erfordert einen kritischen Blick: die Zahl ist selbstberichtet und nicht unabhängig bestätigt.

Lassen Sie uns ins Detail gehen.

Sticker-Preis vs. tatsächliche Kosten einer Aufgabe

Offizielle API-Preisgestaltung von GPT-5.5: 5 $ / 30 $ pro 1 Mio. Input/Output-Tokens.

Zum Vergleich: GPT-5.4 – 2,5 $ / 15 $. Das heißt, der Preis pro Token hat sich verdoppelt.

Aber der Preis pro Token ist nicht dasselbe wie die Kosten einer Aufgabe. OpenAI behauptet, dass GPT-5.5

ungefähr 40 % weniger Output-Tokens für die Ausführung derselben Codex-Aufgaben verwendet.

Dies wird durch eine unabhängige Analyse von Artificial Analysis bestätigt, jedoch ohne Zugriff auf den Scaffold-Benchmark.

Mathematik für einen konkreten Fall:

| Modell |

Output-Tokens pro Aufgabe |

Preis pro 1K Output |

Kosten der Aufgabe |

Differenz |

| GPT-5.4 |

100K |

0,015 $ |

1,50 $ |

— |

| GPT-5.5 |

60K (−40 %) |

0,030 $ |

1,80 $ |

+0,30 $ (+20 %) |

Die Differenz beträgt 0,30 $ pro Aufgabe, nicht 1,50 $. Aber es gibt einen wichtigen Vorbehalt: In dieser Berechnung

sind fehlgeschlagene Aufgaben nicht berücksichtigt. GPT-5.5 bricht Wiederholungsschleifen bei fehlgeschlagenen Versuchen früher ab –

das heißt, es werden weniger Tokens für Aufgaben verbraucht, die nicht erfolgreich abgeschlossen wurden.

Für Teams mit einem großen Volumen an Agentenaufgaben kann dies eine erhebliche zusätzliche Einsparung sein,

die ohne ein echtes A/B-Testing mit eigenen Daten schwer zu messen ist.

Skalierung: Wie die Rechnung bei großen Volumina aussieht

| Output-Tokens/Monat |

GPT-5.4 (Standard) |

GPT-5.5 (–40 % Tokens) |

Reale Differenz |

| 10 Mio. Tokens Aufgaben |

150 $ |

180 $ (6 Mio. × 0,030 $) |

+30 $/Monat |

| 100 Mio. Tokens Aufgaben |

1.500 $ |

1.800 $ (60 Mio. × 0,030 $) |

+300 $/Monat |

| 1 Mrd. Tokens Aufgaben |

15.000 $ |

18.000 $ (600 Mio. × 0,030 $) |

+3.000 $/Monat |

Bei großen Volumina wird die Differenz in absoluten Zahlen spürbar, auch wenn der Prozentsatz derselbe ist.

Bevor Sie eine Entscheidung treffen, ist es wichtig, die tatsächliche Anzahl der Tokens für eine typische Aufgabe

in Ihrer spezifischen Pipeline zu messen – sie kann erheblich von den Durchschnittswerten für Codex abweichen.

Batch und Flex: Wie man zum Preis von GPT-5.4 zurückkehrt

OpenAI hat die reduzierten Tarife für asynchrone Workloads beibehalten:

| Tarif |

Input (1 Mio. Tokens) |

Output (1 Mio. Tokens) |

Geeignet für |

| GPT-5.5 Standard |

5,00 $ |

30,00 $ |

Echtzeit-API, Agenten |

| GPT-5.5 Batch / Flex |

2,50 $ |

15,00 $ |

Offline-Aufgaben, Eval, Backfill |

| GPT-5.5 Priority |

12,50 $ |

75,00 $ |

Kritische Echtzeit-Aufgaben |

| GPT-5.4 Standard |

2,50 $ |

15,00 $ |

Basislinie für Vergleiche |

Schlussfolgerung zu Batch: GPT-5.5 Batch kostet genauso viel wie GPT-5.4 Standard.

Wenn Sie Offline-Workloads haben – Eval-Bewertung, Batch-Zusammenfassung, Content-Backfill,

Massenklassifizierung – erhalten Sie die Möglichkeiten von GPT-5.5 zum Preis von GPT-5.4.

Dies ist der offensichtlichste Fall für einen Wechsel.

GPT-5.5 Pro: Wenn der Preis von 30 $/180 $ gerechtfertigt ist

GPT-5.5 Pro verwendet dasselbe Basismodell mit mehr paralleler Rechenzeit zur Testzeit.

Der Preis – 30 $ Input / 180 $ Output pro 1 Mio. Tokens, also 6-mal teurer als das Basis-GPT-5.5.

Laut Artificial Analysis erreicht GPT-5.5 Basis bei mittlerer Rechenleistung Ergebnisse

von Claude Opus 4.7 bei maximalem Aufwand – und kostet dabei ca. 1.200 $ gegenüber ca. 4.800 $ pro 1 Mio. Tokens

bei Claude mit maximalen Einstellungen. GPT-5.5 Pro ist zielgerichtet für:

- Research-Grade-Aufgaben, bei denen Qualität wichtiger ist als Preis

- Einzelne komplexe Anfragen (juristische Analyse, medizinische Diagnose, wissenschaftliche Berechnungen)

- Szenarien, in denen die Kosten eines einzigen Fehlers die Kosten des Modells übersteigen

Warnung: Auf BullshitBench zeigt GPT-5.5 Pro eine Rückweisungsrate von ~35 % – schlechter als das Basis-GPT-5.5 (~45 %).

Mehr Rechenleistung bedeutet nicht weniger Halluzinationen. Für Aufgaben, bei denen die Zuverlässigkeit der Antwort entscheidend ist,

bietet die Pro-Variante keinen Vorteil gegenüber der Basisversion.

Antwortgeschwindigkeit

Die Latenz pro Token von GPT-5.5 ist unter realen Bedingungen identisch mit GPT-5.4 – trotz der deutlich höheren Komplexität des Modells.

OpenAI hat dies durch Hardware-Software-Co-Design auf NVIDIA GB200/GB300 NVL72 erreicht.

Für Agenten-Pipelines ist jedoch die wichtigere Kennzahl die Zeit bis zur Fertigstellung einer Aufgabe, nicht die Latenz pro Token.

Hier gewinnt GPT-5.5 doppelt: weniger Tokens pro Aufgabe + weniger Wiederholungsiterationen bei Fehlern =

kürzere Zeit von Start bis Ergebnis, selbst bei gleicher Token-Generierungsgeschwindigkeit.

Hauptwarnung

Die Zahl „40 % weniger Tokens“ ist eine Selbstauskunft von OpenAI, gemessen an internen Codex-Aufgaben.

Der Scaffold-Benchmark wurde nicht veröffentlicht. Artificial Analysis hat den Trend unabhängig bestätigt,

aber die genaue Zahl hängt von der Art der Aufgaben ab.

Die Regel ist einfach: Führen Sie ein A/B-Testing mit Ihren realen Prompts durch, bevor Sie eine Migrationsentscheidung treffen.

Vergleichen Sie nicht den Preis pro Token, sondern die Anzahl der Tokens und die Anzahl der erfolgreichen Abschlüsse

für denselben Satz von Aufgaben. Ihr Abrechnungs-Dashboard wird mehr sagen als jeder Benchmark.

Wo GPT-5.4 immer noch ausreicht

Ehrlich gesagt, das Erste, was ich nach jeder lauten Ankündigung von OpenAI tue, ist, zu suchen,

wo das neue Modell nicht benötigt wird. Marketing spricht immer darüber, was besser geworden ist.

Es schweigt darüber, wo sich nichts geändert hat. Und für die meisten realen Produkte

ist genau diese Frage am wichtigsten.

Ich verwende GPT-Modelle für Zusammenfassungen und Klassifizierungen auf WebsCraft –

und sofort nach der Veröffentlichung von GPT-5.5 hatte ich kein einziges Verlangen, diese Pipeline zu migrieren.

Hier ist warum.

Zusammenfassung und Klassifizierung

Für Aufgaben wie „Text kürzen“, „Thema bestimmen“, „strukturierte Felder extrahieren“ –

GPT-5.4 leistet hervorragende Arbeit. GPT-5.5 bietet in diesem Szenario keinen spürbaren Unterschied

in der Qualität, kostet aber pro Token mehr. Ja, unter Berücksichtigung der Token-Effizienz beträgt die tatsächliche Zuzahlung

~20 % – aber warum 20 % mehr für ein identisches Ergebnis bezahlen?

Der gesamte Vorteil von GPT-5.5 liegt in der Persistenz bei komplexen Multi-Step-Aufgaben und dem langen Kontext.

Zusammenfassung ist weder das eine noch das andere. Es ist eine Anweisung, eine kurze Eingabe, eine vorhersehbare Ausgabe.

Hier gibt es nichts zu „persistieren“.

Basis-RAG auf einem festen Korpus

Wenn Sie RAG mit vordefinierten Chunks, einem festen Korpus und einfachem

Retrieve → Generate ohne komplexe Schlussfolgerungen haben – werden GPT-5.4 und GPT-5.5 praktisch identische Ergebnisse liefern.

Die Qualität der Antwort in Basis-RAG wird hauptsächlich durch die Qualität des Retrievals und Chunkings bestimmt,

nicht durch das Modell am Ende der Pipeline.

Eine andere Sache ist Multi-Hop-RAG, bei dem das Modell selbst entscheiden muss, was und wie gesucht werden soll,

mehrere Anfragen stellen, widersprüchliche Quellen abgleichen muss. Dort kann GPT-5.5 einen Unterschied machen.

Aber das ist kein „Basis-RAG“ mehr.

Content-Generierung

Ich schreibe Artikel für WebsCraft selbst – und ich habe nicht vor, dies vollständig an ein Modell zu delegieren,

unabhängig von der Version. Aber selbst wenn es um unterstützende Szenarien geht: Generierung

eines Entwurfs, Ausarbeitung von Thesen, Paraphrasierung – GPT-5.4 erledigt dies genauso.

SWE-Bench Pro zeigt +0,9 pp zwischen 5.4 und 5.5. Für Textinhalte ist der Unterschied wahrscheinlich

noch geringer und subjektiver.

Separat: Ich glaube nicht an die Zahlen von OpenAI, dass GPT-5.5 „deutlich natürlicher und weniger

sikophantisch“ im Vergleich zum Vorgänger ist. Das wurde für jedes neue Modell seit GPT-4o gesagt.

Überprüfen Sie es selbst mit Ihren Prompts.

Hochvolumige Batches mit fester Struktur

Wenn das Modell immer eine einfache Aktion ausführt – zum Beispiel immer JSON

mit drei Feldern basierend auf dem Eingabetext zurückgibt – dann wird der Capability-Overhead von GPT-5.5

einfach nicht genutzt. Sie zahlen für das Potenzial autonomer Multi-Step-Reasoning,

das Ihre Pipeline nicht nutzt.

Für solche Aufgaben ist die Formel einfach: GPT-5.4 ist günstiger → Qualität ist identisch → kein Grund zur Migration.

Und wenn Sie unbedingt GPT-5.5 wollen – verwenden Sie den Batch-Tarif (2,50 $/15 $),

der ihn auf das Niveau des Standardpreises von GPT-5.4 bringt.

Latenzempfindliche Echtzeit-Endpunkte

Die Latenz pro Token von GPT-5.5 ist identisch mit GPT-5.4 – OpenAI bestätigt dies, und es wird technisch unterstützt

(NVIDIA GB200/GB300, benutzerdefinierte Balancing-Algorithmen). Aber wenn Sie

einen Endpunkt haben, bei dem die Time-to-First-Token kritisch ist und Sie den Prompt bereits für eine minimale Ausgabe optimiert haben –

wird es keinen realen Gewinn durch 5.5 geben. Aber das Risiko einer unerwartet geänderten Modellverhaltens

nach der Migration – besteht immer.

Mein Ansatz: Ändere nichts, was funktioniert, ohne einen messbaren Grund.

„Ein neues Modell ist erschienen“ – ist kein messbarer Grund.

Wann der Umstieg auf GPT-5.5 gerechtfertigt ist

Im vorherigen Abschnitt habe ich darüber gesprochen, wo GPT-5.4 ausreichend ist.

Aber es gibt Szenarien, in denen der Unterschied zwischen 5.4 und 5.5 nicht nur Marketing, sondern real und messbar ist.

Skepsis gegenüber den Ankündigungen von OpenAI bedeutet nicht, Fakten zu leugnen. Wenn Benchmarks

+37pp bei langem Kontext zeigen – das kann man nicht ignorieren. Lassen Sie uns untersuchen, wo genau der Umstieg gerechtfertigt ist

und warum.

Komplexe Agenten-Pipelines (5+ Schritte)

Dies ist das Hauptszenario für GPT-5.5 – und das einzige, bei dem ich ohne langes Zögern umsteigen würde.

Wenn Ihr Agent autonom mehr als fünf Schritte ausführt, mitten im Prozess auf Fehler stößt

und selbst entscheiden muss, wie er fortfährt – GPT-5.4 verliert hier systematisch.

Das Problem von GPT-5.4 in solchen Pipelines ist nicht, dass er „dümmer“ ist. Das Problem liegt im Verhalten

bei Unsicherheit: Er blieb stehen, fragte nach oder ging in eine Wiederholungsschleife. GPT-5.5 navigiert durch Mehrdeutigkeit –

trifft Annahmen über die Absicht, fährt fort, überprüft das Ergebnis. Terminal-Bench 2.0:

82,7 % gegenüber 75,1 %. Das sind +7,6pp bei Aufgaben, bei denen genau dieses Verhalten gemessen wird.

Praktisch: Wenn Sie einen CI/CD-Agenten haben, der Tests selbst ausführt, Fehlerprotokolle analysiert,

Korrekturen vornimmt und wiederholt – GPT-5.5 wird mehr solcher Zyklen erfolgreich abschließen, ohne manuelles Eingreifen.

Wenn ein Agent für Code-Reviews, der mehrere Dateien durchläuft, Abhängigkeiten verfolgt und einen

konsolidierten Bericht erstellt – dasselbe.

Wichtiger Hinweis, den ich bereits erwähnt habe: Persistenz ≠ Genauigkeit.

Ein Agent, der „nicht aufhört“, kann 10 Schritte in die falsche Richtung mit Zuversicht ausführen.

Die programmatische Verifizierung von Zwischenergebnissen ist unerlässlich, unabhängig vom Modell.

GPT-5.5 reduziert die Anzahl der Stellen, an denen manuelles Eingreifen erforderlich ist. Aber es hebt

nicht die Notwendigkeit auf, die Ausgabe zu überprüfen.

Große Codebasis (>200K Token Kontext)

MRCR v2 @ 1M Token – 74,0 % gegenüber 36,6 %. Das Ergebnis hat sich mehr als verdoppelt.

Dies ist der größte quantitative Sprung in allen GPT-5.5-Benchmarks und betrifft direkt

Entwickler, die mit großen Codebasen arbeiten.

Konkrete Situation: Sie geben mehrere zusammenhängende Module gleichzeitig in den Kontext –

Controller, Service, Repository, Konfiguration, Tests. GPT-5.4 verliert bei Volumina über 100–150K Token

Details der unteren Ebenen, wenn er mit den oberen arbeitet. GPT-5.5 behält

den gesamten Stapel und nimmt konsistente Änderungen ohne Kontextverlust vor.

Wo das nicht funktioniert: Bei Codex beträgt das Limit 400K Token, nicht 1M. Über die API – 1M.

Wenn Ihr Monolith 400K überschreitet und Sie ihn vollständig übergeben möchten – benötigen Sie eine direkte API,

nicht Codex. Für die meisten realen Codebasen reichen 400K aus, aber das sollte im Voraus überprüft werden,

nicht nach Beginn der Migration.

CLI-Agenten und Automatisierung über das Terminal

Hier teile ich bewusst zwei Szenarien, die in den Marketingmaterialien von OpenAI zu einem einzigen „Computer Use“ vermischt werden.

Automatisierung über Terminal und API (CLI-Agenten): Terminal-Bench 2.0 – +7,6pp.

Ein reales Plus. Wenn Sie einen Agenten für Deployment, Git-Operationen, die Arbeit mit Bash-Skripten,

Aufrufe von CLI-Tools erstellen – GPT-5.5 ist deutlich zuverlässiger.

Computer Use (Arbeit mit UI, Browser, Desktop-Anwendungen): OSWorld-Verified –

78,7 % gegenüber 78,0 %. Ein Unterschied von 0,7pp – praktisch statistische Gleichheit.

Wenn Ihr Agent einen Browser oder eine Desktop-Anwendung steuert – es lohnt sich nicht, wegen

Computer Use zu wechseln. Hier bietet GPT-5.5 keine wirkliche Verbesserung gegenüber 5.4.

Enterprise: Finanzielle, juristische, analytische Aufgaben

GDPval – ein Benchmark von OpenAI für wissensintensive Arbeit, die ein Junior-Analyst ausführen würde:

Finanzmodellierung, juristische Dokumentenanalyse, Forschungsaufgaben.

GPT-5.5 erzielt in diesem Benchmark 84,9 %.

Aber es gibt einen Nuance, den ich nicht ignorieren kann: GDPval ist ein interner Benchmark von OpenAI.

Es gibt keine unabhängige Verifizierung der Methodik. Ich würde keinen Business Case für eine Migration

ausschließlich auf dieser Zahl aufbauen. Testen Sie stattdessen mit einem realen Aufgabensatz Ihres Teams.

Wo GPT-5.5 im Enterprise wirklich gewinnt: Aufgaben, bei denen mehrere große Dokumente (Vertrag + Anhänge + Korrespondenz) gleichzeitig gehalten werden müssen, eine Kreuzanalyse durchgeführt und eine ausgewogene Antwort gegeben werden muss. Dies ist genau das Szenario, in dem +37pp bei langem Kontext

in einen konkreten Qualitätsunterschied umgewandelt werden.

Multi-Dokumenten-Recherche

Analysten, Forscher, Redakteure – alle, die regelmäßig mit Dutzenden von Quellen

gleichzeitig arbeiten. GPT-5.4 begann bei großen Korpora, frühere Dokumente zu „vergessen“,

wenn er zu den späteren kam. GPT-5.5 nicht, was MRCR v2 bestätigt.

Konkreter Fall: Vergleichende Analyse von 20+ technischen Artikeln, bei der widersprüchliche Aussagen verfolgt und eine ausgewogene Schlussfolgerung gezogen werden muss. Oder die Vorbereitung eines Marktüberblicks

basierend auf 15 Berichten von Analyseunternehmen. GPT-5.5 behält alle Quellen im Kopf –

GPT-5.4 verschlechtert sich bei diesem Volumen.

Wo ich selbst wechseln würde – und wo nicht

Zusammenfassend persönlich: Wenn auf WebsCraft eine Agenten-Pipeline mit 5+ Schritten erscheinen würde

oder die Notwendigkeit, große Dokumentenkorpora gleichzeitig zu analysieren – würde ich GPT-5.5 testen.

Für die aktuelle Zusammenfassung und Klassifizierung – nein, ohne zu zögern.

Allgemeine Regel: Ein Umstieg ist gerechtfertigt, wenn Ihre Aufgabe strukturell das erfordert,

was GPT-5.5 besser kann – autonome Persistenz oder langer Kontext.

Wenn die Aufgabe mit einem Schritt oder einem kurzen Prompt gelöst wird – es ist sinnlos zu wechseln,

unabhängig davon, wie gut die Ankündigung klingt.

Fazit: Lohnt sich die Migration jetzt

Nach jedem großen Release entstehen in der KI-Community zwei Lager: diejenigen, die am ersten Tag migrieren,

und diejenigen, die warten, „bis alles stabil ist“. Beide Ansätze sind falsch.

Der erste ist FOMO statt Entscheidungen. Der zweite ist Prokrastination unter dem Deckmantel der Vorsicht.

Der richtige Ansatz ist einer: Bestimmen Sie, ob Ihre spezifischen Aufgaben strukturell davon profitieren,

was GPT-5.5 besser kann. Nicht davon, was in der Ankündigung steht. Davon,

was durch unabhängige Benchmarks und Ihr eigenes A/B bestätigt wird.

Unten finden Sie meine Checkliste. Nicht die von OpenAI, nicht die von TechCrunch. Meine – unter Berücksichtigung dessen,

was ich überprüft habe, was Skepsis hervorruft und wo die Zahlen wirklich überzeugen.

| Bedingung |

Entscheidung |

Warum |

| Agenten-Pipeline mit 5+ Schritten autonomer Ausführung |

✅ Migrieren Sie |

Terminal-Bench 2.0 +7,6pp – das ist kein Marketing, das ist ein messbarer Unterschied bei der Persistenz bei Ausfällen |

| Regelmäßig >200K Token Kontext eingeben |

✅ Migrieren Sie |

MRCR v2: 74 % gegenüber 36,6 % – das Ergebnis hat sich verdoppelt. Dies ist der größte Sprung in der Veröffentlichung |

| Batch-Verarbeitung großer Mengen offline |

✅ Migrieren Sie zum Batch-Tarif |

GPT-5.5 Batch = 2,50 $/15 $ – derselbe Preis wie GPT-5.4 Standard. Risikofrei |

| Multi-Dokumenten-Recherche mit 10+ Quellen gleichzeitig |

✅ Testen Sie |

Langer Kontext – der Hauptvorteil von 5.5. Aber testen Sie mit Ihren eigenen Dokumenten, nicht mit dem Benchmark |

| CLI-Agent: Deployment, Git, Bash-Automatisierung |

✅ Testen Sie |

Terminal-Bench bestätigt einen realen Unterschied. Machen Sie ein A/B mit Ihren eigenen Skripten |

| Zusammenfassung, Klassifizierung, Extraktion in großen Mengen |

❌ Nicht migrieren |

Qualität identisch mit GPT-5.4, Preis höher. Kein Grund |

| Basis-RAG mit einem festen Korpus |

❌ Nicht migrieren |

Die Qualität von RAG wird durch Retrieval und Chunking bestimmt, nicht durch das Modell am Ende der Pipeline |

| Computer Use: Agent steuert Browser oder UI |

❌ Nicht migrieren |

OSWorld-Verified: +0,7pp – statistische Gleichheit mit GPT-5.4 |

| Halluzinationsrate ist für das Produkt kritisch |

⚠️ Vorsichtig |

BullshitBench: GPT-5.5 ≈ GPT-5.4 (~45 %). Pro – schlechter (~35 %). Claude führt hier |

| Latenzempfindlicher Echtzeit-Endpunkt |

⚠️ Zuerst testen |

Die Latenz pro Token ist gleich, aber das Verhalten des Modells nach der Migration kann sich unerwartet ändern |

| API wird jetzt benötigt |

✅ Verfügbar |

Ab dem 24. April 2026 – Responses und Chat Completions API sind offen |

Wie man ein A/B vor der Migration richtig durchführt

„Machen Sie ein A/B“ – ein Rat, den alle geben. Aber selten wird erklärt, was genau gemessen werden soll.

Hier ist eine minimale Liste von Metriken, die sinnvoll sind:

-

Anzahl der Output-Token pro typischer Aufgabe: Wenn GPT-5.5 tatsächlich 40 % weniger verbraucht – Ihre tatsächlichen Kosten steigen nicht um das Doppelte. Wenn nicht – sehen Sie das sofort in Ihrem Billing Dashboard, nicht in Marketingmaterialien.

-

Aufgabenerfolgsrate: Bei Agentenaufgaben – wie viele wurden erfolgreich ohne manuelles Eingreifen abgeschlossen. Dies ist die Hauptmetrik, bei der GPT-5.5 einen realen Unterschied machen sollte.

-

Anzahl der Wiederholungsiterationen pro Aufgabe: Wenn der Agent weniger „stecken bleibt“ – das ist in den Logs sichtbar. Vergleichen Sie die durchschnittliche Anzahl der Schritte bis zum erfolgreichen Abschluss.

-

Qualität der Ausgabe auf Ihrem Evaluationsset: Nicht auf dem OpenAI-Benchmark,

sondern auf realen Beispielen aus Ihrem Produkt. 20–30 repräsentative Aufgaben reichen für eine erste Schlussfolgerung aus.

Mein persönliches Urteil

GPT-5.5 ist die erste Veröffentlichung von OpenAI seit langem, bei der ich einen realen technischen Grund für eine Migration in bestimmten Szenarien sehe. Nicht „es ist überall ein bisschen besser geworden“, sondern

„ein Sprung in einer engen Nische gemacht“. Das ist eine ehrlichere Position als frühere Veröffentlichungen.

Aber „ein realer Grund für eine Migration in bestimmten Szenarien“ ist nicht dasselbe wie „alle sofort migrieren“. Wenn Ihre Aufgaben nicht in den oberen Zeilen

der obigen Checkliste stehen – warten Sie. Nicht, weil „man warten muss, bis es sich stabilisiert“,

sondern weil es einfach irrational ist, für Funktionen zu viel zu bezahlen, die Sie nicht nutzen.

Und zu guter Letzt: Was auch immer das Modell ist – es liegt in Ihrer Verantwortung, es mit Ihren eigenen Daten zu überprüfen.

Ich überprüfe es. Ich rate Ihnen auch dazu.

❓ Häufig gestellte Fragen (FAQ)

Ersetzt GPT-5.5 GPT-5.4 vollständig?

Nein – und das ist prinzipiell wichtig zu verstehen, bevor Sie eine Migrationsentscheidung treffen.

GPT-5.5 übertrifft GPT-5.4 in einer bestimmten Nische: Agenten-Pipelines mit 5+ Schritten,

langer Kontext von über 200K Token, CLI-Automatisierung. Für alles andere –

Zusammenfassung, Klassifizierung, Basis-RAG, Content-Generierung – bleibt GPT-5.4

eine ausreichende und günstigere Option. Ein vollständiger Ersatz wird stattfinden, wenn der Preis von GPT-5.5

sinkt oder wenn GPT-5.4 aus dem Verkehr gezogen wird. Derzeit sind es zwei verschiedene Werkzeuge

für verschiedene Aufgaben.

Ist GPT-5.5 wirklich doppelt so teuer wie GPT-5.4?

Der Preis pro Token hat sich verdoppelt: 2,5 $/15 $ → 5 $/30 $ pro 1 Mio. Input/Output-Token. Aber die Kosten

pro Aufgabe nicht. OpenAI gibt an, dass GPT-5.5 ~40 % weniger Output-Token für dieselben Codex-Aufgaben verwendet.

Wenn das stimmt, beträgt die tatsächliche Zuzahlung etwa 20 %, nicht 100 %.

Artificial Analysis hat den Trend unabhängig bestätigt, aber die genaue Zahl hängt von der Art der Aufgaben ab.

Überprüfen Sie Ihr Billing Dashboard, nicht die Marketingmaterialien.

Der Batch-Tarif (2,50 $/15 $) setzt GPT-5.5 auf das Niveau des Standardpreises von GPT-5.4 –

für Offline-Workloads ist dies der einfachste Weg, ohne Risiko von Mehrkosten zu testen.

Ist GPT-5.5 über die API verfügbar?

Ja, ab dem 24. April 2026 – über die Responses und Chat Completions API.

Zum Zeitpunkt des Starts am 23. April war die API geschlossen: OpenAI erklärte dies mit der Notwendigkeit

zusätzlicher Sicherheitsvorkehrungen für Cybersicherheit und Bio-Risiken, die einen anderen Ansatz erfordern

als bei ChatGPT. Jetzt ist das Modell standardmäßig verfügbar. Batch- und Flex-Pricing sind ebenfalls aktiv –

zum halben Preis des Standardtarifs.

Was ist GPT-5.5 Pro und wer braucht es?

GPT-5.5 Pro ist dasselbe Basismodell, aber mit mehr paralleler Rechenleistung zur Testzeit.

Es kostet 30 $/180 $ pro 1 Mio. Token – sechsmal teurer als das Basis-GPT-5.5.

Es wird für Research-Grade- und High-Stakes-Aufgaben positioniert: wissenschaftliche Berechnungen, medizinische Diagnostik,

komplexe juristische Analysen. Aber es gibt einen wichtigen Nuance: Auf BullshitBench zeigt GPT-5.5 Pro

eine Rückweisungsrate von ~35 % – schlechter als das Basis-GPT-5.5 (~45 %). Mehr Rechenleistung

bedeutet nicht weniger Halluzinationen. Wenn die Zuverlässigkeit der Antwort für Sie kritisch ist –

Pro löst dieses Problem nicht.

Unterstützt GPT-5.5 einen Kontext von 1 Million Token?

Ja – und es ist das erste Mal, dass „1 Million Token“ bei OpenAI eine tatsächlich funktionierende Möglichkeit bedeutet,

keine Marketingzahl. MRCR v2 @ 1M Token: GPT-5.5 – 74 %, GPT-5.4 – 36,6 %.

Das Ergebnis hat sich mehr als verdoppelt. Aber es gibt Einschränkungen: Bei Codex beträgt das Maximum 400K Token,

nicht 1M. Die volle Million ist nur über eine direkte API verfügbar. Für die meisten realen

Codebasen reichen 400K aus – aber wenn Sie einen großen Monolithen oder mehrere Repositories

gleichzeitig haben, rechnen Sie im Voraus.

Sollte man auf GPT-5.5 im kostenlosen ChatGPT-Tarif warten?

Zum Zeitpunkt der Veröffentlichung ist GPT-5.5 nur für zahlende Abonnenten verfügbar: Plus, Pro,

Business und Enterprise in ChatGPT; Plus und höher in Codex. Der kostenlose Tarif hat keinen Zugang erhalten.

OpenAI hat keine Fristen für die Ausweitung des Zugangs angekündigt – wenn dies für Sie kritisch ist,

orientieren Sie sich an der offiziellen Seite der OpenAI-Modelle, nicht an Gerüchten.

Ist GPT-5.5 besser als Claude Opus 4.7?

Abhängig von der Aufgabe – und das ist keine diplomatische Antwort, sondern eine Tatsache.

GPT-5.5 führt auf Terminal-Bench 2.0 (82,7 % gegenüber 69,4 %) und langem Kontext (MRCR v2).

Claude Opus 4.7 führt auf SWE-Bench Pro (64,3 % gegenüber 58,6 %), MCP Atlas (79,1 % gegenüber 75,3 %)

und BullshitBench (weniger Halluzinationen). Auf HLE ohne Werkzeuge – ebenfalls vorne (46,9 % gegenüber 41,4 %).

Wenn Sie einen CLI-Agenten bauen oder mit großem Kontext arbeiten – GPT-5.5.

Wenn die Zuverlässigkeit der Antwort oder die Orchestrierung von Werkzeugen kritisch ist – es lohnt sich, Claude daneben zu testen.

✅ Schlussfolgerungen

GPT-5.5 ist die erste Veröffentlichung von OpenAI seit langem, bei der ich einen realen technischen Grund

für eine Migration sehe. Nicht „es ist überall ein bisschen besser geworden“, sondern

ein konkreter Sprung in einer engen Nische.

Das ist eine ehrlichere Position als frühere Veröffentlichungen – und genau deshalb sollte man sie ernst nehmen,

nicht als weiteren Hype abtun.

Aber „ein realer Grund für eine Migration in einer engen Nische“ ist nicht dasselbe wie „alle sofort migrieren“.

Unten finden Sie, was ich aus dieser Analyse als praktische Schlussfolgerung mitgenommen habe.

-

🏆 Der größte Sieg – langer Kontext: MRCR v2 +37,4pp – das Ergebnis hat sich verdoppelt.

Wenn Sie regelmäßig mehr als 200K Token in eine Anfrage eingeben, ist dies der einzige Grund,

der für das Testen von GPT-5.5 ausreicht.

-

🤖 Agenten-Coding – real, nicht Marketing: Terminal-Bench 2.0 +7,6pp

unabhängig bestätigt. Persistenz bei Ausfällen, weniger Wiederholungsschleifen, höhere Aufgabenerfolgsrate

bei komplexen Pipelines. Wenn Ihr Agent 5+ Schritte autonom ausführt – testen Sie.

-

⚠️ Halluzinationen haben sich nicht verbessert – und das sollte man nicht verschweigen:

BullshitBench: GPT-5.5 ≈ GPT-5.4 (~45 % Rückweisung). Pro – schlechter (~35 %).

Claude-Modelle führen hier immer noch. Wenn die Zuverlässigkeit der Antwort kritisch ist – GPT-5.5

löst dieses Problem nicht.

-

💰 Reale Zuzahlung ~20 %, nicht 100 %: aber nur, wenn Ihre Aufgaben

strukturell von der Token-Effizienz von GPT-5.5 profitieren. Für Zusammenfassung und Klassifizierung –

gibt es keine Einsparungen, nur eine Zuzahlung. Der Batch-Tarif (2,50 $/15 $) nivelliert den Unterschied für Offline-Workloads vollständig.

-

❌ Wo man definitiv nicht migrieren sollte: Zusammenfassung, Klassifizierung, Basis-RAG,

Content-Generierung, Computer Use über UI. Hier ist GPT-5.4 günstiger und liefert identische Ergebnisse.

-

🔬 Regel Nr. 1 – unverändert: A/B mit Ihren eigenen realen Prompts und Tool Calls

vor jeder Entscheidung. Messen Sie Output-Token, Aufgabenerfolgsrate und Anzahl

der Wiederholungsiterationen – nicht den Preis pro Token und nicht die Benchmarks aus der OpenAI-Ankündigung.

KI-Modelle werden immer häufiger veröffentlicht. Sechs Wochen zwischen GPT-5.4 und GPT-5.5 –

das ist ein neues Tempo, und es wird sich nicht verlangsamen. Auf jede Veröffentlichung mit einer Migration zu reagieren –

ist keine Strategie, es ist operativer Chaos. Zu ignorieren – ist auch keine Strategie,

es ist der Verlust realer Vorteile dort, wo sie existieren.

Der einzige funktionierende Ansatz: Ihre Aufgaben besser kennen als die Marketingexperten ihr Modell.

Dann ist jede nächste Veröffentlichung keine Sorge und kein Hype, sondern nur eine Checkliste mit zwei

Spalten: „gewinne“ und „gewinne nicht“. GPT-5.5 habe ich überprüft. Sie – überprüfen Sie selbst.