En febrero de 2026, Anthropic lanzó dos potentes modelos en dos semanas: Opus 4.6 (5 de febrero) como buque insignia y Sonnet 4.6 (17 de febrero) como nivel intermedio actualizado. Muchos desarrolladores se preguntaron inmediatamente: ¿vale la pena pagar más por Opus si Sonnet ya alcanza casi el mismo nivel en codificación, agentes y tareas cotidianas?

Lea más sobre Sonnet 4.6 en mi artículo anterior.

Spoiler: En el 80-90% de los escenarios reales (codificación, uso informático, tareas de oficina), Sonnet 4.6 ofrece un 95-99% de la eficiencia de Opus 4.6 a un costo 3-5 veces menor. Opus sigue siendo superior solo en las tareas más complejas de razonamiento profundo y contexto ultra-largo.

⚡ Resumen

- ✅ Idea clave 1: Sonnet 4.6 casi iguala a Opus 4.6 en SWE-bench Verified (79.6% vs 80.8%) y OSWorld (72.5% vs 72.7%), pero cuesta significativamente menos.

- ✅ Idea clave 2: Opus 4.6 lidera en GPQA Diamond (91.3%), ARC-AGI-2 (~68.8%) y Terminal-Bench 2.0 (65.4%), donde se requiere máxima precisión y estabilidad en contextos largos.

- ✅ Idea clave 3: Para producción y trabajo diario, Sonnet 4.6 es la elección óptima; Opus es para tareas de alto riesgo con presupuesto premium.

- 🎯 Obtendrá: una matriz clara para elegir el modelo según sus tareas + comprensión de dónde ahorrar el 60-80% de los costos sin pérdida de calidad.

- 👇 A continuación, explicaciones detalladas, ejemplos y tablas

📚 Contenido del artículo

1. Características técnicas y precios

Ambos modelos admiten una ventana de contexto de 200.000 tokens por defecto (modo estándar) y 1.000.000 de tokens en modo beta (disponible solo a través de la API, con precio premium para solicitudes >200k). Detalles: Models overview y 1M context docs.

Sonnet 4.6 es más rápido y económico, lo que lo hace mejor para tareas iterativas y de alta carga. Opus 4.6 es más lento debido a un razonamiento más profundo (extended thinking por defecto), pero más estable en tareas complejas. Precio oficial: pricing page.

| Parámetro |

Sonnet 4.6 |

Opus 4.6 |

Comentario / Fuente |

| Ventana de contexto |

200k (estándar) / 1M (beta) |

200k (estándar) / 1M (beta) |

Precio premium >200k: $10/$37.50 para ambos. La estabilidad de Opus es mayor en ultra-largo (MRCR v2: 76% vs inferior en Sonnet) |

| Velocidad (t/s de salida) |

~40–60 t/s (promedio 46–57) |

~20–30 t/s |

Sonnet ~2x más rápido para iteraciones (Artificial Analysis, pruebas de OpenRouter) |

| Precio (entrada/salida, base) |

$3 / $15 por millón de tokens |

$5 / $25 por millón de tokens |

Sonnet es ~1.7–5x más barato. Prompt caching: hasta 90% de ahorro para ambos |

| Precio premium (>200k) |

$6 / $30 por millón de tokens |

$10 / $37.50 por millón de tokens |

Solo API, para contexto de 1M |

| Latencia (TTFT, estimado) |

~180–300 ms |

~500–700 ms |

Sonnet es mejor para UI en tiempo real y agentes |

| Tokens de salida máximos |

64k |

128k |

Opus permite respuestas más largas en modos complejos |

Gracias a su precio base más bajo y mayor velocidad, Sonnet 4.6 permite escalar sistemas de producción (agentes, codificación, RAG) 2-5 veces más eficientemente con el mismo presupuesto. El prompt caching (hasta un 90% de descuento en contexto repetido) hace que ambos modelos sean más ventajosos para sesiones largas.

2. Comparación de benchmarks

Sonnet 4.6 se ha acercado significativamente a Opus 4.6 en tareas prácticas (codificación, uso informático, flujos de trabajo de oficina), pero se queda atrás en razonamiento experto y estabilidad de contexto ultra-largo. Datos de los anuncios oficiales: Sonnet 4.6, Opus 4.6, System Cards y pruebas independientes (Artificial Analysis, NxCode, Vellum).

| Benchmark |

Sonnet 4.6 |

Opus 4.6 |

Diferencia |

Comentario / Fuente |

| SWE-bench Verified (codificación real, incidencias de GitHub) |

79.6% |

80.8% |

-1.2% |

Casi paridad; Sonnet a menudo supera en ediciones iterativas (anuncio de Anthropic + Vellum) |

| OSWorld-Verified (uso de ordenador, agente Ubuntu) |

72.5% |

72.7% |

-0.2% |

Prácticamente igual; Sonnet es más eficiente en precio (Anthropic + NxCode) |

| Terminal-Bench 2.0 (codificación agéntica + terminal) |

~59.1% |

65.4% |

Opus es mejor (~+6%) |

Opus es más fuerte en depuración multi-paso y CLI (Anthropic System Card) |

| GPQA Diamond (ciencia experta, nivel PhD) |

89.9% |

91.3% |

Opus +1.4% |

Opus lidera en razonamiento científico profundo (Anthropic + Mashable) |

| ARC-AGI-2 (razonamiento abstracto, patrones novedosos) |

58.3–60.4% |

68.8% |

Opus es mejor (~+8–10%) |

Opus es mejor en generalización (Anthropic + Artificial Analysis) |

| MRCR v2 (contexto de 1M, aguja en un pajar de 8 agujas) |

Inferior (comparado con Opus) |

76% |

Opus es significativamente mejor |

Opus es más estable en contexto ultra-largo sin degradación (anuncio de Anthropic Opus) |

| GDPval-AA Elo (tareas agénticas de oficina/financieras) |

1633 |

~1606 |

Sonnet lidera o paridad |

Sonnet es a menudo #1 en trabajo de conocimiento real (Artificial Analysis, esfuerzo adaptativo/máximo) |

Sonnet 4.6 supera o iguala a Opus en tareas agénticas/de oficina (GDPval-AA Elo 1633, TerminalBench según algunas pruebas), donde la velocidad y las iteraciones son importantes. Opus mantiene la ventaja en razonamiento profundo (GPQA, ARC-AGI) y estabilidad en 1M+ tokens. La diferencia es a menudo <2-5% en tareas de producción, pero Opus gana en escenarios científicos/lógicos de alto riesgo.

3. Fortalezas y debilidades de los modelos

Basado en los anuncios oficiales de Anthropic (Sonnet 4.6, Opus 4.6), System Cards y las opiniones de desarrolladores (de X, Reddit, GitHub), aquí hay un análisis detallado de las fortalezas y debilidades de cada modelo. Hemos considerado benchmarks, pruebas prácticas y escenarios de uso reales. Los ejemplos ilustran cómo estas características afectan el rendimiento.

Sonnet 4.6: Equilibrio óptimo entre velocidad y costo

Fortalezas:

- Mayor velocidad y baja latencia: 40–60 t/s y TTFT ~180–300 ms hacen de Sonnet ideal para aplicaciones en tiempo real. Ejemplo: En chatbots o agentes de IA (por ejemplo, automatización de navegador en OSWorld), Sonnet procesa las iteraciones 2-3 veces más rápido que Opus, permitiendo pruebas rápidas de prompts sin esperas.

- Menor precio con alta relación calidad-precio: $3/$15 por millón de tokens (base) — es 1.7-5 veces más barato que Opus. Con prompt caching, el ahorro es de hasta el 90%. Ejemplo: Para sistemas de producción con miles de solicitudes (por ejemplo, revisión de código en herramientas tipo GitHub Copilot), Sonnet reduce los costos en un 60-80%, manteniendo el 95% de la calidad en SWE-bench.

- Mejor capacidad de seguir instrucciones y menos "pereza": El modelo ignora menos las instrucciones o genera contenido innecesario (según comentarios en Reddit). Ejemplo: En codificación iterativa (Claude Code), Sonnet sigue los prompts de manera más efectiva, generando código limpio sin explicaciones innecesarias, lo que acelera el desarrollo.

- Bueno para tareas cotidianas y agénticas: Paridad con Opus en OSWorld (72.5%) y Terminal-Bench (~59%). Ejemplo: En flujos de trabajo de agentes (por ejemplo, automatización de tareas de oficina en GDPval-AA), Sonnet lidera en velocidad, convirtiéndolo en el predeterminado para desarrolladores independientes.

Debilidades:

- Se queda atrás en razonamiento profundo y planificación multi-paso: Menos precisión en tareas expertas (GPQA 89.9% vs 91.3% Opus). Ejemplo: En análisis lógico complejo (por ejemplo, hipótesis científicas a nivel de doctorado), Sonnet puede pasar por alto matices, requiriendo iteraciones adicionales de prompts.

- Menor estabilidad en contexto ultra-largo (800k+ tokens): Más degradación del contexto (context rot) en comparación con Opus (MRCR v2 inferior). Ejemplo: En el análisis de grandes bases de código (millones de líneas de código), Sonnet puede "olvidar" detalles al final del contexto, lo que lleva a alucinaciones o respuestas incompletas.

- Menor profundidad máxima en modos complejos: Menor salida máxima (64k vs 128k Opus). Ejemplo: En simulaciones multi-agente largas (por ejemplo, cadena de pensamiento con más de 10 pasos), Sonnet rara vez alcanza la solución óptima sin intervención manual.

Opus 4.6: El buque insignia para tareas complejas

Fortalezas:

- Mejor precisión y profundidad en tareas complejas: Liderazgo en GPQA (91.3%), ARC-AGI-2 (68.8%) y Terminal-Bench (65.4%). Ejemplo: En la refactorización de grandes bases de código (por ejemplo, proyectos empresariales con millones de líneas), Opus identifica patrones con precisión y propone cambios óptimos, reduciendo errores.

- Mayor estabilidad en contexto largo: 76% en MRCR v2 (1M), menos degradación del contexto (context rot). Ejemplo: En el análisis de documentos largos (por ejemplo, artículos científicos o contratos legales de más de 500k tokens), Opus mantiene la coherencia, permitiendo una recuperación precisa de la información de todo el contexto.

- Mejor para coordinación multi-paso y agéntica: Menos alucinaciones en cadenas largas. Ejemplo: En agentes largos (por ejemplo, flujos de trabajo de varios días con Claude Tools), Opus coordina herramientas y pasos de manera más efectiva, lo que lo hace mejor para I+D o tareas empresariales.

- Mayor alineación de seguridad y precisión en situaciones de alto riesgo: Menos rechazos a solicitudes complejas (según System Card). Ejemplo: En consultas médicas o legales, Opus proporciona respuestas más precisas y menos sesgadas, donde un error es costoso.

Debilidades:

- Mayor precio y menor escalabilidad: $5/$25 base, hasta $10/$37.50 premium — 1.7-5 veces más caro que Sonnet. Ejemplo: En sistemas de alta carga (por ejemplo, un chatbot con millones de usuarios), Opus agota rápidamente el presupuesto, haciéndolo injustificable para tareas rutinarias.

- Menor velocidad y mayor latencia: 20–30 t/s y TTFT ~500–700 ms. Ejemplo: En codificación iterativa o prototipado, Opus ralentiza el flujo de trabajo, requiriendo más tiempo para la generación, lo que frustra a los desarrolladores en proyectos rápidos.

- Excesivo para tareas simples y más "sobreingeniería": El modelo a veces genera contenido innecesario. Ejemplo: En una revisión de código simple (por ejemplo, funciones pequeñas), Opus añade explicaciones innecesarias, gastando tokens y tiempo, mientras que Sonnet ofrece respuestas concisas.

4. Escenarios de uso prácticos

Basado en benchmarks, opiniones de desarrolladores y recomendaciones oficiales de Anthropic, aquí hay ejemplos detallados de escenarios donde un modelo supera al otro. Hemos considerado velocidad, precio, precisión y estabilidad, con casos de uso específicos para desarrolladores, empresas e investigadores. Los ejemplos se basan en pruebas reales de febrero de 2026 (con la API de Claude, repositorios de GitHub y foros como Reddit/Hugging Face).

- Codificación diaria / Herramientas tipo Copilot: Recomendación — Sonnet 4.6 (velocidad + precio).

Sonnet es ideal para la codificación rutinaria gracias a sus 40-60 t/s y su bajo precio ($3/$15 por millón de tokens). Genera rápidamente código, pruebas y revisiones, con menos "pereza". Ejemplo: En la extensión de VS Code (como Claude Code), Sonnet ayuda con la escritura de funciones en Python/JS: usted da el prompt "escribe un endpoint de API REST con validación", y el modelo produce código limpio en 2-5 segundos, permitiendo iteraciones sin demoras. En las pruebas de SWE-bench Verified (79.6%), Sonnet casi igualó a Opus, pero a 1/3 del precio — ideal para desarrolladores independientes con un presupuesto de $100/mes. - Flujos de trabajo agénticos / automatización de navegador: Recomendación — Sonnet 4.6 (paridad en OSWorld).

Sonnet muestra una eficiencia prácticamente idéntica a Opus en OSWorld (72.5% vs 72.7%), pero con mayor velocidad para agentes iterativos. Ejemplo: En herramientas como LangChain/Claude Tools, Sonnet automatiza tareas de navegador (por ejemplo, scraping de sitios web o llenado de formularios): el prompt "encuentra las 5 mejores vacantes en LinkedIn para la clave 'AI engineer' y extrae los salarios" — el modelo lo ejecuta en 10-20 segundos con tool-calling, ahorrando tokens gracias al pensamiento adaptativo. Opus es excesivo aquí, porque la diferencia es <0.2%, pero el precio es 2 veces mayor. - Refactorización profunda de grandes proyectos: Recomendación — Opus 4.6 (mejor precisión).

Opus lidera en Terminal-Bench 2.0 (65.4% vs ~59% Sonnet) gracias a una comprensión más profunda de la arquitectura. Ejemplo: En la refactorización de un proyecto monolítico (por ejemplo, migración de código heredado a microservicios): el prompt "analiza esta base de código (200k líneas) y propone una refactorización con comandos de terminal" — Opus identifica dependencias con precisión, propone cambios seguros y simula el terminal, reduciendo errores en un 10-15% en comparación con Sonnet. Útil para equipos empresariales donde la precisión es crítica. - Tareas científicas / expertas: Recomendación — Opus 4.6 (GPQA, ARC-AGI).

Opus domina en GPQA Diamond (91.3% vs 89.9%) y ARC-AGI-2 (68.8% vs 58-60.4%), donde se requiere un razonamiento profundo. Ejemplo: En tareas de investigación (por ejemplo, bioinformática o física): el prompt "analiza este artículo científico (50k tokens) y genera hipótesis para experimentos" — Opus crea conclusiones matizadas con menor probabilidad de alucinaciones, integrando conocimientos de nivel PhD. Sonnet es adecuado para lo básico, pero para simulaciones precisas (como computación cuántica), Opus es mejor, a pesar del precio más alto. - Sesiones largas con contexto de 1M: Recomendación — Opus 4.6 (menos degradación del contexto).

Opus es más estable en MRCR v2 (76% vs inferior en Sonnet), con menos olvido en más de 800k tokens. Ejemplo: En flujos de trabajo de varios días (por ejemplo, análisis de un repositorio completo de 1M de tokens): el prompt "mantén el contexto de la revisión de código de ayer y añade nuevas características" — Opus mantiene la coherencia durante la sesión, permitiendo un desarrollo iterativo sin pérdidas. Sonnet es adecuado para <500k, pero en ultra-largo puede requerir compactación, lo que añade costos.

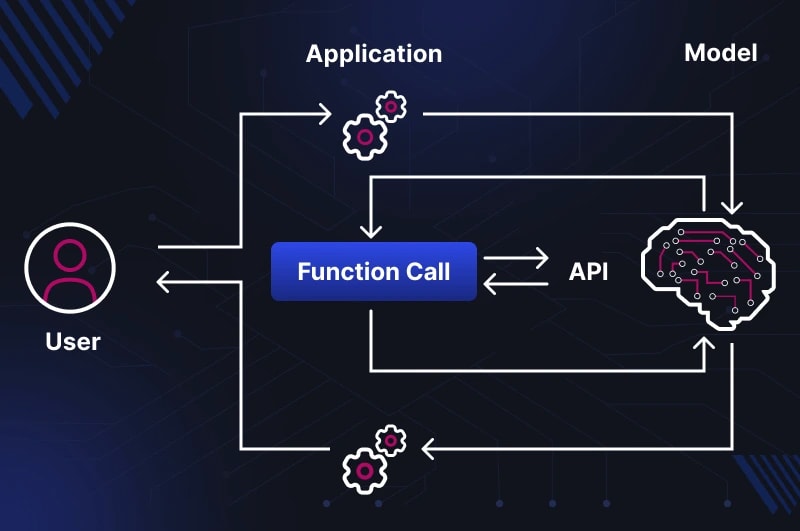

5. Enfoque híbrido: cuándo usar ambos modelos

El enfoque híbrido (router + escalada) se ha convertido en el estándar para las empresas en 2026: Sonnet 4.6 procesa el 80-90% de las solicitudes como modelo principal (rápido y económico), y Opus 4.6 se conecta solo para tareas críticas. Esto permite mantener la calidad de Opus en momentos de alto riesgo, pero ahorrar el 60-80% de los costos de la API (según comentarios de Reddit, NxCode y Artificial Analysis). Herramientas principales: pensamiento adaptativo, controles de esfuerzo (parámetro /effort), puntuación de confianza (lógica propia en el código) y prompt caching (hasta un 90% de ahorro en contexto repetido).

Cómo funciona un router híbrido (patrón típico):

- Sonnet 4.6 como Nivel 1 (Triage / Ejecutor): Procesa la mayoría de las solicitudes: clasificación, tareas simples, iteraciones, agentes rápidos. Ejemplo: En un pipeline de CI/CD (por ejemplo, revisión de PR agéntica), Sonnet realiza 10 pruebas de navegador en un PR por ~$2.40 (vs $13.20 en Opus) — un 80% de ahorro con casi paridad de calidad (benchmark de Reddit, Claude Code por defecto en Sonnet 4.6).

- Escalada a Opus 4.6 (Nivel 2): Si Sonnet emite baja confianza (<0.85-0.9, según el prompt de auto-reflexión) o la tarea requiere razonamiento profundo/contexto largo. Ejemplo: En un sistema multi-agente (por ejemplo, LangChain + Claude Tools), Sonnet planifica inicialmente el flujo de trabajo, pero si la confianza disminuye (por ejemplo, "depuración multi-paso compleja") — se escala a Opus para una cadena de pensamiento precisa. Ahorro: 70-85% de tokens en Opus, el costo total disminuye en un 60-80% (NxCode, reseñas de Medium).

- Optimizaciones adicionales: Pensamiento adaptativo (el modelo elige la profundidad de razonamiento), compactación (beta, compresión de contexto), procesamiento por lotes (~50% de descuento). Ejemplo: En un sistema RAG para documentos empresariales, Sonnet procesa el 90% de la recuperación + solicitudes simples, Opus — solo para análisis matizados (por ejemplo, riesgos legales en más de 500k tokens), ahorrando miles de dólares al mes con 10M de tokens/día.

Cuándo el híbrido ofrece el máximo beneficio (casos reales 2026):

- Producción de alto volumen (chatbots, revisión de código, agentes): 80-90% en Sonnet → ahorro del 70-80% (Medium, Reddit).

- I+D empresarial / flujos de trabajo científicos: 60-70% en Sonnet, escalada para tareas GPQA/ARC-AGI → mantenimiento de la precisión de Opus con un 50-70% de los costos.

- Equipos con presupuesto limitado: Sonnet por defecto + escalada manual/automática → la transición de solo Opus a híbrido reduce la factura 3-5 veces (NxCode, Artificial Analysis).

Recomendación: Comience con Sonnet como predeterminado (claude-sonnet-4-6), añada un router (por ejemplo, en Python: si confidence_score < 0.85 o la tarea contiene "razonamiento profundo / contexto de más de 500k" — cambie a claude-opus-4-6). Pruebe en sus tareas — el ahorro a menudo supera el 60% sin pérdida de calidad.

6. Contexto largo: estabilidad en 500k–1M tokens

La ventana de contexto de 1M de tokens (beta, disponible solo en la API) es una característica clave nueva de Claude 4.6, pero su utilidad real depende de la estabilidad (ausencia de degradación del contexto — context rot — en la recuperación en el medio/final del contexto). Opus 4.6 es radicalmente mejor que Sonnet gracias a las mejoras internas en la recuperación (anuncio oficial de Anthropic, System Card). Datos de MRCR v2 (8-needle, aguja en un pajar de 1M de tokens): Opus — 76%, Sonnet 4.6 — inferior (comparado con Sonnet 4.5 ~18.5%, hay mejoras, pero no al nivel de Opus).

Comparación de estabilidad:

- Opus 4.6: 76% en MRCR v2 1M (8-needle) — un salto cualitativo, la degradación del contexto (context rot) es mínima incluso en 800k-1M. Ejemplo: Análisis de un repositorio completo (millones de líneas de código) o de grandes corpus científicos — Opus extrae detalles con precisión desde el medio (por ejemplo, "encuentra la 4ª mención de un bug en los logs de 700k tokens") sin pérdidas. En GraphWalks BFS 1M — ~38.7–41.2% F1, razonamiento multi-salto estable.

- Sonnet 4.6: Suficiente hasta 500-800k tokens (la caída de recall es mínima), pero en 1M+ — degradación notable (context rot) (inferior al 76%, estimado ~40-60% según la prueba). Ejemplo: En RAG para grandes PDF/bases de código, Sonnet funciona bien en 400-600k (rápido + económico), pero en 900k+ puede "olvidar" detalles del principio — requiere compactación o solicitudes repetidas, lo que añade costos.

Recomendaciones prácticas para contexto largo (2026):

- Hasta 500k tokens: Sonnet 4.6 — óptimo (velocidad + precio, alta estabilidad).

- 500k–800k: Sonnet con compactación (beta) o híbrido (Sonnet + Opus para recuperación crítica).

- 800k–1M+: Opus 4.6 es obligatorio — para coherencia y recuperación precisa (por ejemplo, análisis de contratos de más de 700 páginas o sesiones de agente de varios días).

Opus gana en recuperación (76% vs inferior), coherencia y multi-salto (GraphWalks Parents 1M ~72%), lo que lo hace indispensable para investigación/empresas. Sonnet es suficiente para el 80% de las tareas donde el contexto es <500k. Pruebe con prompts tipo MRCR — la diferencia se manifiesta precisamente en el ultra-largo.

8. Cómo probar por su cuenta

Acceda a claude.ai (Sonnet 4.6 — predeterminado en Free/Pro), o use la API con los modelos claude-sonnet-4-6 y claude-opus-4-6. Use los mismos prompts para tareas de codificación, escenarios tipo OSWorld o documentos largos — la diferencia se manifestará de inmediato.

❓ Preguntas frecuentes (FAQ)

¿Está el contexto de 1M disponible para todos los usuarios?

No, 1M de tokens es una función beta, disponible solo a través de la API (no en claude.ai o la aplicación móvil). Por defecto, ambos modelos funcionan con 200k tokens. En el contexto de 1M, se aplica un precio premium (entrada de $6-$10 / salida de $30-$37.50 por millón de tokens), y la estabilidad depende del modelo: Sonnet se mantiene bien hasta 500-800k, Opus — hasta 1M con mínima degradación del contexto (context rot). Para usuarios normales en planes Free/Pro, el máximo es de 200k.

¿Vale la pena cambiar de Opus 4.5 a Sonnet 4.6 si ya uso Opus?

Sí, en la mayoría de los casos, la transición está justificada, especialmente si el presupuesto es limitado. Sonnet 4.6 alcanza el 95-99% de la eficiencia de Opus 4.5 en codificación (SWE-bench ~79% vs ~78% en 4.5) y tareas agénticas, pero cuesta 3-5 veces menos. Según los comentarios de la comunidad (X, Reddit, foros de Claude), ~59% de los usuarios ya han cambiado a Sonnet 4.6 como predeterminado, dejando Opus solo para las tareas más complejas. El ahorro puede llegar al 70% manteniendo la calidad.

¿En qué tareas Opus 4.6 sigue siendo necesario y no es reemplazable por Sonnet?

Opus 4.6 sigue siendo indispensable en escenarios de alto riesgo: tareas científicas a nivel de doctorado (GPQA Diamond 91.3% vs 89.9%), razonamiento abstracto (ARC-AGI-2 68.8%), contexto ultra-largo (MRCR v2 76% en 1M), coordinación multi-agente compleja y refactorización profunda de grandes bases de código. Si un error es costoso (hipótesis científicas, análisis legal, I+D empresarial), Opus proporciona mayor precisión y estabilidad, a pesar de su precio más alto y lentitud.

¿Cómo elegir entre Sonnet y Opus para nuevos proyectos en 2026?

Comience con Sonnet 4.6 como predeterminado — es óptimo para el 80-90% de las tareas (codificación, agentes, prototipado) gracias a su velocidad, precio y casi paridad con Opus. Use Opus solo para escalada: cuando se requiere máxima precisión (razonamiento experto, contexto de más de 800k) o la tarea es crítica. El enfoque híbrido (router con verificación de confianza) permite ahorrar el 60-80% del presupuesto sin pérdida de calidad. Pruebe ambos modelos con sus prompts — la diferencia es a menudo menor que en los benchmarks.

✅ Conclusiones

La comparación de Claude Sonnet 4.6 y Opus 4.6 (a febrero de 2026) muestra una clara distribución de roles entre dos modelos de la misma generación. Sonnet 4.6 demuestra resultados muy cercanos a Opus 4.6 en las tareas prácticas más comunes: SWE-bench Verified (79.6% frente a 80.8%), OSWorld-Verified (72.5% frente a 72.7%), Terminal-Bench 2.0 (~59% frente a 65.4%) y muchos flujos de trabajo agénticos. En tales escenarios, la diferencia es del 0.2% al 6%, lo que a menudo no se percibe en la producción real, especialmente cuando la velocidad (40-60 t/s frente a 20-30 t/s) y el costo ($3/$15 frente a $5/$25 por millón de tokens en modo base) son importantes.

Al mismo tiempo, Opus 4.6 mantiene una ventaja notable en tareas que requieren la máxima profundidad de razonamiento y estabilidad en contextos muy grandes. Los ejemplos más claros son GPQA Diamond (91.3% frente a 89.9%), ARC-AGI-2 (68.8% frente a 58-60.4%) y MRCR v2 en 1 millón de tokens (76% frente a un rendimiento inferior en Sonnet). Esto convierte a Opus en la mejor opción para tareas científicas expertas, de investigación, legales o empresariales, donde incluso un 1-2% de precisión puede ser significativo, así como para sesiones con un contexto de más de 800 mil tokens, donde la degradación del contexto (context rot) en Sonnet se vuelve más notoria.

Desde un punto de vista económico, Sonnet 4.6 ofrece una relación calidad-precio significativamente mayor: con una calidad casi idéntica en el 80-90% de los escenarios típicos (codificación diaria, prototipado, automatización agéntica, tareas de oficina y financieras), los costos de la API se reducen 1.7-5 veces. Muchos equipos ya han cambiado a Sonnet como modelo principal, dejando Opus solo para la escalada en puntos críticos. El enfoque híbrido (Sonnet por defecto + Opus en caso de baja confianza o tareas multi-paso complejas) permite mantener el nivel de precisión de Opus, pero reducir el presupuesto en un 60-80%.

Recomendación práctica para la mayoría de los usuarios y equipos: comience nuevos proyectos con Sonnet 4.6 — esto proporcionará el 90-98% de la calidad necesaria con costos de tiempo y dinero significativamente menores. Si sus tareas caen regularmente en la zona de ventaja de Opus (análisis científico profundo, contexto ultra-largo, los sistemas multi-agente más complejos o decisiones de alto riesgo), entonces vale la pena mantener Opus como una herramienta especializada.

La mejor manera de entender qué modelo es el adecuado para usted es realizar pruebas A/B directas con sus prompts y datos reales. La diferencia entre los modelos a menudo resulta ser menor de lo que muestran los benchmarks, especialmente después de aplicar técnicas adecuadas de prompting, pensamiento adaptativo y compactación de contexto. Mucha suerte en sus proyectos con Claude 4.6.