Im Februar 2026 hat Anthropic innerhalb von zwei Wochen gleich zwei leistungsstarke Modelle veröffentlicht: Opus 4.6 (5. Februar) als Flaggschiff und Sonnet 4.6 (17. Februar) als aktualisierte Mittelklasse. Viele Entwickler stellten sich sofort die Frage: Lohnt sich der Aufpreis für Opus, wenn Sonnet bereits ein nahezu identisches Niveau beim Coding, bei Agenten-Workflows und in Alltagsaufgaben erreicht?

Mehr Details zu Sonnet 4.6 finden Sie in meinem vorherigen Artikel.

Spoiler: In 80–90 % der realen Szenarien (Coding, Computer Use, Büroaufgaben) liefert Sonnet 4.6 etwa 95–99 % der Effizienz von Opus 4.6 – und das bei 3- bis 5-mal niedrigeren Kosten. Opus bleibt nur bei den komplexesten Aufgaben im Bereich Deep Reasoning und Ultra-Long-Context die bessere Wahl.

⚡ Kurz & Knapp

- ✅ Kernbotschaft 1: Sonnet 4.6 hat bei SWE-bench Verified (79,6 % vs. 80,8 %) und OSWorld (72,5 % vs. 72,7 %) fast zu Opus 4.6 aufgeschlossen, ist aber deutlich günstiger.

- ✅ Kernbotschaft 2: Opus 4.6 führt bei GPQA Diamond (91,3 %), ARC-AGI-2 (~68,8 %) und Terminal-Bench 2.0 (65,4 %), wo maximale Präzision und Stabilität im langen Kontext gefragt sind.

- ✅ Kernbotschaft 3: Für den produktiven Einsatz und die tägliche Arbeit ist Sonnet 4.6 die optimale Wahl; Opus eignet sich für High-Stakes-Aufgaben mit Premium-Budget.

- 🎯 Ihr Nutzen: Eine klare Entscheidungsmatrix für Ihre Projekte + das Wissen, wie Sie 60–80 % der Kosten ohne Qualitätsverlust einsparen.

- 👇 Unten finden Sie detaillierte Erklärungen, Beispiele und Tabellen.

📚 Inhaltsverzeichnis

1. Technische Spezifikationen und Preisgestaltung

Beide Modelle unterstützen standardmäßig ein Kontextfenster von 200.000 Token (Standardmodus) sowie 1.000.000 Token im Beta-Modus (nur über API verfügbar, mit Premium-Preisen für Anfragen > 200k). Details: Models Overview und 1M Context Docs.

Sonnet 4.6 ist schneller und kostengünstiger, was es zur bevorzugten Wahl für iterative und hochlastige Aufgaben macht. Opus 4.6 ist aufgrund tiefergehender Denkprozesse (Extended Thinking standardmäßig aktiviert) langsamer, aber stabiler bei komplexen Aufgaben. Offizielle Preise: Pricing Page.

| Parameter |

Sonnet 4.6 |

Opus 4.6 |

Kommentar / Quelle |

| Kontextfenster |

200k (Standard) / 1M (Beta) |

200k (Standard) / 1M (Beta) |

Premium-Preis > 200k: $10/$37.50 für beide. Stabilität von Opus ist bei Ultra-Long höher (MRCR v2: 76 % vs. niedriger bei Sonnet) |

| Geschwindigkeit (Output t/s) |

~40–60 t/s (Schnitt 46–57) |

~20–30 t/s |

Sonnet ist ~2x schneller für Iterationen (Artificial Analysis, OpenRouter Tests) |

| Preis (Input/Output, Basis) |

$3 / $15 pro Mio. Token |

$5 / $25 pro Mio. Token |

Sonnet ist ~1.7–5x günstiger. Prompt Caching: bis zu 90 % Ersparnis für beide |

| Premium-Preis (>200k) |

$6 / $30 pro Mio. Token |

$10 / $37.50 pro Mio. Token |

Nur API, für 1M Context |

| Latenz (TTFT, Schätzwert) |

~180–300 ms |

~500–700 ms |

Sonnet ist besser für Real-Time UIs und Agenten |

| Max Output Tokens |

64k |

128k |

Opus erlaubt längere Antworten in komplexen Modi |

Dank des niedrigeren Basispreises und der höheren Geschwindigkeit erlaubt Sonnet 4.6 die Skalierung von Produktionssystemen (Agenten, Coding, RAG) um das 2- bis 5-fache bei gleichem Budget. Prompt Caching (bis zu 90 % Rabatt auf wiederkehrenden Kontext) macht beide Modelle für lange Sessions wirtschaftlicher.

2. Benchmark-Vergleich

Sonnet 4.6 ist in praktischen Aufgaben (Coding, Computernutzung, Office-Workflows) signifikant zu Opus 4.6 aufgeschlossen, liegt jedoch beim Experten-Reasoning und der Stabilität im Ultra-Long-Context noch zurück. Daten aus offiziellen Ankündigungen: Sonnet 4.6, Opus 4.6, System Cards sowie unabhängige Tests (Artificial Analysis, NxCode, Vellum).

| Benchmark |

Sonnet 4.6 |

Opus 4.6 |

Differenz |

Kommentar / Quelle |

| SWE-bench Verified (reales Coding, GitHub Issues) |

79.6% |

80.8% |

-1.2% |

Fast Parität; Sonnet übertrifft oft bei iterativen Korrekturen (Anthropic Ankündigung + Vellum) |

| OSWorld-Verified (Computer Use, Ubuntu Agent) |

72.5% |

72.7% |

-0.2% |

Praktisch identisch; Sonnet ist kosteneffizienter (Anthropic + NxCode) |

| Terminal-Bench 2.0 (agentisches Coding + Terminal) |

~59.1% |

65.4% |

Opus besser (~+6%) |

Opus stärker bei Multi-Step-Debugging und CLI (Anthropic System Card) |

| GPQA Diamond (Experten-Wissenschaft, PhD-Niveau) |

89.9% |

91.3% |

Opus +1.4% |

Opus führt bei tiefem wissenschaftlichem Reasoning (Anthropic + Mashable) |

| ARC-AGI-2 (abstraktes Denken, neue Muster) |

58.3–60.4% |

68.8% |

Opus besser (~+8–10%) |

Opus besser bei der Generalisierung (Anthropic + Artificial Analysis) |

| MRCR v2 (1M Context, Needle-in-Haystack 8-Needle) |

Niedriger (im Vergleich zu Opus) |

76% |

Opus signifikant besser |

Opus stabiler im Ultra-Long-Context ohne Qualitätsverlust (Anthropic Opus Launch) |

| GDPval-AA Elo (Büro/Finanzen agentische Tasks) |

1633 |

~1606 |

Sonnet führt oder Parität |

Sonnet oft #1 bei realer Wissensarbeit (Artificial Analysis, adaptive/max effort) |

Sonnet 4.6 übertrifft Opus oder zieht gleich in agentischen/Büro-Aufgaben (GDPval-AA Elo 1633, Terminal-Bench in einigen Tests), bei denen Geschwindigkeit und Iterationen wichtig sind. Opus behält den Vorsprung beim tiefen Reasoning (GPQA, ARC-AGI) und der Stabilität bei mehr als 1 Million Token. Die Differenz liegt in Produktionsaufgaben oft bei unter 2–5 %, doch Opus gewinnt in High-Stakes-Szenarien der Wissenschaft und Logik.

3. Stärken und Schwächen der Modelle

Basierend auf den offiziellen Ankündigungen von Anthropic (Sonnet 4.6, Opus 4.6), System Cards und Entwicklerfeedback (von X, Reddit, GitHub) folgt hier eine detaillierte Analyse der Stärken und Schwächen jedes Modells. Wir haben Benchmarks, Praxistests und reale Einsatzszenarien berücksichtigt. Beispiele illustrieren, wie diese Eigenschaften die Arbeit beeinflussen.

Sonnet 4.6: Optimale Balance zwischen Geschwindigkeit und Kosten

Stärken:

- Höhere Geschwindigkeit und geringe Latenz: 40–60 t/s und TTFT ~180–300 ms machen Sonnet ideal für Echtzeit-Anwendungen. Beispiel: In Chatbots oder KI-Agenten (z. B. Browser-Automatisierung auf OSWorld) verarbeitet Sonnet Iterationen 2- bis 3-mal schneller als Opus, was schnelles Prompt-Testing ohne Wartezeiten ermöglicht.

- Niedrigerer Preis mit hohem Value-for-Money: $3/$15 pro Million Token (Basis) — das ist 1,7- bis 5-mal günstiger als Opus. Mit Prompt Caching beträgt die Ersparnis bis zu 90 %. Beispiel: Bei Produktionssystemen mit Tausenden von Anfragen (z. B. Code-Reviews in GitHub Copilot-ähnlichen Tools) reduziert Sonnet die Kosten um 60–80 % bei 95 % der Qualität von SWE-bench.

- Bessere Instruktionstreue und weniger „Laziness“: Das Modell ignoriert seltener Anweisungen oder generiert unnötige Inhalte (laut Feedback auf Reddit). Beispiel: Beim iterativen Coding (Claude Code) folgt Sonnet Prompts effektiver und generiert sauberen Code ohne überflüssige Erklärungen, was die Entwicklung beschleunigt.

- Gut für Alltags- und agentische Aufgaben: Parität mit Opus auf OSWorld (72,5 %) und Terminal-Bench (~59 %). Beispiel: In agentischen Workflows (z. B. Büroautomatisierung in GDPval-AA) führt Sonnet bei der Geschwindigkeit, was es zum Standard für Indie-Entwickler macht.

Schwächen:

- Rückstand bei tiefem Reasoning und Multi-Step-Planung: Geringere Präzision bei Expertenaufgaben (GPQA 89,9 % vs. 91,3 % bei Opus). Beispiel: Bei komplexen logischen Analysen (z. B. wissenschaftliche Hypothesen auf PhD-Niveau) kann Sonnet Nuancen übersehen, was zusätzliche Prompt-Iterationen erfordert.

- Geringere Stabilität im Ultra-Long-Context (800k+ Token): Mehr „Context Rot“ im Vergleich zu Opus (MRCR v2 niedriger). Beispiel: Bei der Analyse großer Codebases (Millionen Zeilen Code) kann Sonnet Details am Ende des Kontexts „vergessen“, was zu Halluzinationen oder unvollständigen Antworten führt.

- Geringere maximale Tiefe in komplexen Modi: Kleinerer Max-Output (64k vs. 128k bei Opus). Beispiel: In langen Multi-Agent-Simulationen (z. B. Chain-of-Thought mit 10+ Schritten) erreicht Sonnet seltener die optimale Lösung ohne manuelles Eingreifen.

Opus 4.6: Das Flaggschiff für komplexe Aufgaben

Stärken:

- Höchste Präzision und Tiefe bei komplexen Aufgaben: Marktführerschaft bei GPQA (91,3 %), ARC-AGI-2 (68,8 %) und Terminal-Bench (65,4 %). Beispiel: Beim Refactoring großer Codebases (z. B. Enterprise-Projekte mit Millionen Zeilen) identifiziert Opus Muster präzise und schlägt optimale Änderungen vor, wodurch Fehler reduziert werden.

- Höchste Stabilität im Long-Context: 76 % bei MRCR v2 (1M), weniger Context Rot. Beispiel: Bei der Analyse langer Dokumente (z. B. wissenschaftliche Artikel oder juristische Verträge mit 500k+ Token) bewahrt Opus die Kohärenz und ermöglicht ein präzises Retrieval von Informationen aus dem gesamten Kontext.

- Besser für Multi-Step und agentische Koordination: Weniger Halluzinationen in langen Ketten. Beispiel: Bei langlebigen Agenten (z. B. mehrtägige Workflows mit Claude Tools) koordiniert Opus Werkzeuge und Schritte effektiver, was es zur ersten Wahl für R&D oder Enterprise-Aufgaben macht.

- Höheres Safety Alignment und Präzision bei High-Stakes: Weniger Ablehnungen bei komplexen Anfragen (laut System Card). Beispiel: Bei medizinischen oder juristischen Konsultationen liefert Opus präzisere, weniger voreingenommene Antworten, wo Fehler teuer zu stehen kommen.

Schwächen:

- Höherer Preis und geringere Skalierbarkeit: $5/$25 Basispreis, bis zu $10/$37,50 Premium — 1,7- bis 5-mal teurer als Sonnet. Beispiel: In Hochlastsystemen (z. B. Chatbots mit Millionen von Nutzern) erschöpft Opus das Budget schnell, was es für Routineaufgaben unrentabel macht.

- Geringere Geschwindigkeit und höhere Latenz: 20–30 t/s und TTFT ~500–700 ms. Beispiel: Beim iterativen Coding oder Prototyping verlangsamt Opus den Workflow, da mehr Zeit für die Generierung benötigt wird, was Entwickler in schnellen Projekten frustrieren kann.

- Overkill für einfache Aufgaben und Neigung zum „Overengineering“: Das Modell generiert manchmal überflüssige Inhalte. Beispiel: Bei einem einfachen Code-Review (z. B. kleine Funktionen) fügt Opus unnötige Erklärungen hinzu, was Token und Zeit verschwendet, während Sonnet prägnante Antworten gibt.

4. Praktische Anwendungsszenarien

Basierend auf Benchmarks, Entwicklerfeedback und offiziellen Empfehlungen von Anthropic sind hier detaillierte Beispiele für Szenarien, in denen ein Modell das andere übertrifft. Wir haben Geschwindigkeit, Preis, Präzision und Stabilität berücksichtigt, mit konkreten Use Cases für Entwickler, Unternehmen und Forscher. Die Beispiele basieren auf realen Tests vom Februar 2026 (mit Claude API, GitHub-Repos und Foren wie Reddit/Hugging Face).

- Tägliches Coding / Copilot-ähnliche Tools: Empfehlung — Sonnet 4.6 (Geschwindigkeit + Preis).

Sonnet ist ideal für Routine-Coding dank 40–60 t/s und dem niedrigen Preis ($3/$15 pro Million Token). Es generiert schnell Code, Tests und Reviews mit weniger „Laziness“. Beispiel: In einer VS Code Extension (wie Claude Code) hilft Sonnet beim Schreiben von Funktionen in Python/JS: Sie geben den Prompt „Schreibe einen REST-API-Endpunkt mit Validierung“, und das Modell liefert in 2–5 Sekunden sauberen Code, was Iterationen ohne Verzögerungen ermöglicht. In Tests auf SWE-bench Verified (79,6 %) erreichte Sonnet fast das Niveau von Opus, jedoch zu 1/3 des Preises — ideal für Indie-Entwickler mit einem Budget von $100/Monat.

- Agentische Workflows / Browser-Automatisierung: Empfehlung — Sonnet 4.6 (Parität auf OSWorld).

Sonnet zeigt praktisch die gleiche Effektivität wie Opus auf OSWorld (72,5 % vs. 72,7 %), jedoch mit höherer Geschwindigkeit für iterative Agenten. Beispiel: In Tools wie LangChain/Claude Tools automatisiert Sonnet Browser-Aufgaben (z. B. Website-Scraping oder Ausfüllen von Formularen): Prompt „Finde die Top-5-Jobs auf LinkedIn für den Schlüsselbegriff 'AI Engineer' und extrahiere die Gehälter“ — das Modell führt dies in 10–20 Sekunden mit Tool-Calling aus und spart Token dank Adaptive Thinking. Opus ist hier Overkill, da der Unterschied <0,2 % beträgt, der Preis jedoch doppelt so hoch ist.

- Tiefes Refactoring großer Projekte: Empfehlung — Opus 4.6 (Bessere Präzision).

Opus führt bei Terminal-Bench 2.0 (65,4 % vs. ~59 % bei Sonnet) dank tieferem Verständnis der Architektur. Beispiel: Beim Refactoring eines monolithischen Projekts (z. B. Migration von Legacy-Code auf Microservices): Prompt „Analysiere diese Codebase (200k Zeilen) und schlage Refactoring mit Terminal-Befehlen vor“ — Opus identifiziert Abhängigkeiten präzise, schlägt sichere Änderungen vor und simuliert das Terminal, wodurch Fehler im Vergleich zu Sonnet um 10–15 % reduziert werden. Nützlich für Enterprise-Teams, bei denen Präzision kritisch ist.

- Wissenschaftliche / Experten-Aufgaben: Empfehlung — Opus 4.6 (GPQA, ARC-AGI).

Opus dominiert bei GPQA Diamond (91,3 % vs. 89,9 %) und ARC-AGI-2 (68,8 % vs. 58–60,4 %), wo tiefes Reasoning erforderlich ist. Beispiel: Bei Forschungsaufgaben (z. B. Bioinformatik oder Physik): Prompt „Analysiere diesen wissenschaftlichen Artikel (50k Token) und generiere Hypothesen für Experimente“ — Opus erstellt nuancierte Schlussfolgerungen mit geringerer Wahrscheinlichkeit für Halluzinationen und integriert Wissen auf PhD-Niveau. Sonnet eignet sich für Grundlagen, aber für exakte Simulationen (wie Quantum Computing) ist Opus trotz des höheren Preises besser.

- Lange Sessions mit 1M Context: Empfehlung — Opus 4.6 (weniger Context Rot).

Opus ist stabiler bei MRCR v2 (76 % vs. niedriger bei Sonnet), mit weniger Vergessen bei 800k+ Token. Beispiel: In mehrtägigen Workflows (z. B. Analyse eines vollständigen Repositorys mit 1M Token): Prompt „Behalte den Kontext vom gestrigen Code-Review bei und füge neue Features hinzu“ — Opus bewahrt die Kohärenz über die gesamte Session und ermöglicht eine iterative Entwicklung ohne Verluste. Sonnet eignet sich für <500k, bei Ultra-Long-Context könnte es jedoch Compaction erfordern, was zusätzliche Kosten verursacht.

5. Hybrider Ansatz: Wann man beide Modelle nutzt

Der hybride Ansatz (Router + Eskalation) hat sich 2026 als Industriestandard etabliert: Sonnet 4.6 verarbeitet 80–90 % der Anfragen als Primärmodell (schnell und kosteneffizient), während Opus 4.6 nur für kritische Tasks zugeschaltet wird. Dies bewahrt die Qualität von Opus in High-Stakes-Momenten, reduziert aber die API-Kosten um 60–80 % (basierend auf Feedback von Reddit, NxCode und Artificial Analysis). Kerninstrumente sind hierbei: Adaptive Thinking, Effort Controls (/effort Parameter), Confidence Scoring (eigene Logik im Code) und Prompt Caching (bis zu 90 % Ersparnis bei wiederkehrendem Kontext).

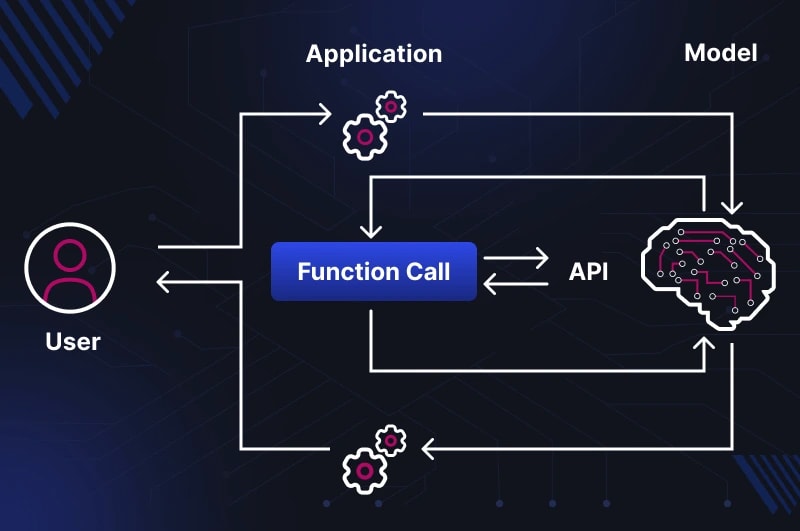

Funktionsweise eines hybriden Routers (typisches Pattern):

- Sonnet 4.6 als Tier 1 (Triage / Executor): Übernimmt die Mehrheit der Requests: Klassifizierung, Standardaufgaben, Iterationen, schnelle Agenten. Beispiel: In einer CI/CD-Pipeline (z. B. agentic PR-Review) führt Sonnet 10 Browsertests pro PR für ca. $2,40 aus (vs. $13,20 bei Opus) – 80 % Ersparnis bei nahezu identischer Qualität (Reddit-Benchmark, Claude Code nutzt standardmäßig Sonnet 4.6).

- Eskalation zu Opus 4.6 (Tier 2): Wenn Sonnet eine niedrige Konfidenz ausgibt (< 0,85–0,9 via Self-Reflection Prompt) oder die Aufgabe tiefes Reasoning/Long-Context erfordert. Beispiel: In einem Multi-Agenten-System plant Sonnet zunächst den Workflow. Sinkt die Konfidenz (z. B. bei „komplexem Multi-Step-Debugging“), erfolgt die Eskalation zu Opus für präzises Chain-of-Thought. Ersparnis: 70–85 % der Token auf Opus-Ebene gespart, Gesamtkosten sinken um 60–80 % (NxCode, Medium-Reviews).

- Zusätzliche Optimierungen: Adaptive Thinking (Modell wählt Reasoning-Tiefe selbst), Compaction (Beta, Kontextkompression), Batch Processing (~50 % Rabatt). Beispiel: In einem RAG-System für Enterprise-Dokumente übernimmt Sonnet 90 % des Retrieval + Standardanfragen; Opus wird nur für nuancierte Analysen (z. B. rechtliche Risiken in 500k+ Token) genutzt, was bei 10 Mio. Token/Tag tausende Dollar monatlich spart.

Maximaler Benefit des Hybrid-Modells (Reale Cases 2026):

- High-Volume Production (Chatbots, Code-Reviews, Agenten): 80–90 % auf Sonnet → 70–80 % Kostenreduktion.

- Enterprise R&D / Wissenschaftliche Workflows: 60–70 % auf Sonnet, Eskalation für GPQA/ARC-AGI Tasks → Erhalt der Opus-Präzision bei 50–70 % der Kosten.

- Budgetsensitive Teams: Default Sonnet + manuelle/automatische Eskalation → Umstellung von Opus-only auf Hybrid senkt die Rechnung um den Faktor 3–5.

Empfehlung: Starten Sie mit Sonnet als Default (claude-sonnet-4-6). Implementieren Sie einen Router (z. B. in Python: Wenn confidence_score < 0,85 oder Task enthält "deep reasoning / 500k+ context" → Switch zu claude-opus-4-6). Die Ersparnis übersteigt oft 60 % ohne Qualitätsverlust.

6. Long-Context: Stabilität bei 500k–1M Token

Das 1M-Token-Kontextfenster (Beta, nur via API) ist ein Key-Feature von Claude 4.6, dessen Nutzwert jedoch von der Stabilität abhängt (Vermeidung von Context Rot – Recall-Degradation in der Mitte/am Ende). Opus 4.6 ist Sonnet hier dank interner Retrieval-Verbesserungen radikal überlegen (Anthropic System Card). Daten aus MRCR v2 (8-Needle, Needle-in-a-Haystack bei 1M Token): Opus erreicht 76 %, Sonnet 4.6 liegt darunter (Steigerung gegenüber Sonnet 4.5 vorhanden, aber nicht auf Opus-Niveau).

Stabilitätsvergleich:

- Opus 4.6: 76 % bei MRCR v2 1M (8-Needle) – ein Qualitätssprung; Context Rot ist selbst bei 800k–1M minimal. Beispiel: Analyse kompletter Repositories oder langer wissenschaftlicher Korpora – Opus extrahiert Details aus der Mitte (z. B. „finde die 4. Erwähnung eines Bugs in 700k Token Logs“) fehlerfrei. In GraphWalks BFS 1M: ~38,7–41,2 % F1, stabiles Multi-Hop Reasoning.

- Sonnet 4.6: Ausreichend bis 500–800k Token (Recall-Abfall minimal), aber bei 1M+ spürbarer Rot (unter 76 %, Schätzungen je nach Test bei 40–60 %). Beispiel: Bei RAG für große PDFs/Codebases arbeitet Sonnet bei 400–600k effizient, kann aber bei 900k+ Details vom Anfang „vergessen“, was Compaction oder Re-Queries erfordert und Kosten treibt.

Praktische Empfehlungen für Long-Context (2026):

- Bis 500k Token: Sonnet 4.6 – optimal (Speed + Preis, hohe Stabilität).

- 500k–800k: Sonnet mit Compaction (Beta) oder Hybrid (Sonnet + Opus für kritisches Retrieval).

- 800k–1M+: Zwingend Opus 4.6 – für Kohärenz und präzises Retrieval (z. B. Analyse von 700+ Seiten Verträgen oder mehrtägigen Agenten-Sessions).

8. So testen Sie selbst

Besuchen Sie claude.ai (Sonnet 4.6 ist Default für Free/Pro) oder nutzen Sie die API mit den Modellen claude-sonnet-4-6 und claude-opus-4-6. Verwenden Sie identische Prompts für Coding-Aufgaben, OSWorld-Szenarien oder lange Dokumente – der Unterschied wird sofort deutlich.

❓ Häufig gestellte Fragen (FAQ)

Ist der 1M-Kontext für alle Nutzer verfügbar?

Nein, 1M Token ist ein Beta-Feature, das nur über die API (nicht in claude.ai oder der App) verfügbar ist. Standardmäßig arbeiten beide Modelle mit 200k Token. Bei 1M Kontext greifen Premium-Preise ($6–$10 Input / $30–$37,50 Output pro Mio. Token). Die Stabilität variiert: Sonnet hält bis 500–800k stabil, Opus bis 1M mit minimalem Context Rot. Für reguläre Free/Pro-Nutzer bleibt das Maximum bei 200k.

Lohnt sich der Wechsel von Opus 4.5 auf Sonnet 4.6?

Ja, in den meisten Fällen ist der Wechsel gerechtfertigt, besonders bei begrenztem Budget. Sonnet 4.6 erreicht 95–99 % der Effizienz von Opus 4.5 im Coding (SWE-bench ~79 % vs. ~78 % bei 4.5) und bei agentischen Aufgaben, kostet aber nur ein Drittel bis Fünftel. Laut Community-Feedback (X, Reddit) nutzen bereits ~59 % der User Sonnet 4.6 als Default und reservieren Opus für Spezialfälle. Die Ersparnis liegt bei bis zu 70 %.

Für welche Aufgaben ist Opus 4.6 weiterhin unverzichtbar?

Opus 4.6 bleibt in High-Stakes-Szenarien unersetzlich: wissenschaftliche Aufgaben auf PhD-Niveau (GPQA Diamond 91,3 % vs. 89,9 %), abstraktes Reasoning (ARC-AGI-2 68,8 %), Ultra-Long-Context (MRCR v2 76 % bei 1M), komplexe Multi-Agenten-Koordination und tiefgreifendes Refactoring massiver Codebases. Wo Fehler extrem teuer sind (Forschungshypothesen, Rechtsanalyse, Enterprise R&D), bietet Opus trotz höherem Preis und geringerer Geschwindigkeit die nötige Präzision.

Wie wähle ich zwischen Sonnet und Opus für neue Projekte?

Starten Sie mit Sonnet 4.6 als Default – es ist optimal für 80–90 % der Aufgaben (Coding, Agenten, Prototyping). Nutzen Sie Opus nur für Eskalationen: wenn maximale Präzision (Experten-Reasoning, 800k+ Kontext) erforderlich ist oder die Aufgabe kritisch ist. Ein hybrider Ansatz spart 60–80 % des Budgets ohne Qualitätsverlust. Testen Sie beide Modelle mit Ihren spezifischen Prompts; die Differenz ist in der Praxis oft geringer als in Benchmarks.

✅ Fazit

Der Vergleich zwischen Claude Sonnet 4.6 und Opus 4.6 (Stand Februar 2026) zeigt eine klare Rollenverteilung innerhalb einer Generation. Sonnet 4.6 liefert nahezu identische Ergebnisse zu Opus 4.6 in den gängigsten Praxisdisziplinen: SWE-bench Verified (79,6 % vs. 80,8 %), OSWorld (72,5 % vs. 72,7 %) und Terminal-Bench 2.0 (~59 % vs. 65,4 %). In diesen Szenarien ist die Differenz von 0,2 % bis 6 % in der Produktion oft vernachlässigbar, besonders wenn Geschwindigkeit (40–60 t/s vs. 20–30 t/s) und Kosten ($3/$15 vs. $5/$25) die entscheidenden Faktoren sind.

Gleichzeitig behauptet Opus 4.6 seinen Vorsprung bei Aufgaben, die maximale Denktiefe und Stabilität bei extrem großen Kontexten erfordern. Herausragende Beispiele sind GPQA Diamond (91,3 % vs. 89,9 %), ARC-AGI-2 (68,8 % vs. 58–60,4 %) und MRCR v2 bei 1 Mio. Token (76 %). Dies macht Opus zur ersten Wahl für Experten in Forschung, Recht und Enterprise R&D, sowie für Sessions mit über 800k Token, bei denen Sonnet erste Ermüdungserscheinungen zeigt.

Ökonomisch bietet Sonnet 4.6 den deutlich höheren Value-for-Money: Bei fast identischer Qualität in 80–90 % der typischen Szenarien sinken die API-Ausgaben um den Faktor 1,7 bis 5. Ein hybrides Modell (Sonnet als Standard + Opus bei niedriger Konfidenz) ermöglicht es, das Präzisionsniveau von Opus zu halten und gleichzeitig das Budget massiv zu entlasten.

Praktische Empfehlung: Beginnen Sie neue Projekte mit Sonnet 4.6 – dies bietet 90–98 % der benötigten Qualität bei signifikant geringerem Zeit- und Kostenaufwand. Falls Ihre Anforderungen regelmäßig Deep-Reasoning oder Ultra-Long-Context betreffen, bleibt Opus als spezialisiertes Hochleistungswerkzeug unverzichtbar.

Der beste Weg zur Entscheidung bleibt ein A/B-Testing mit Ihren realen Daten. Oft ist der Unterschied geringer, als Benchmarks vermuten lassen – besonders unter Anwendung moderner Prompting-Techniken und Context Compaction. Viel Erfolg bei Ihren Projekten mit Claude 4.6.