У 2026 році китайські LLM-платформи стрімко наближаються до західних frontier-моделей. Z.ai від Zhipu AI — один з лідерів цього руху завдяки GLM-5.

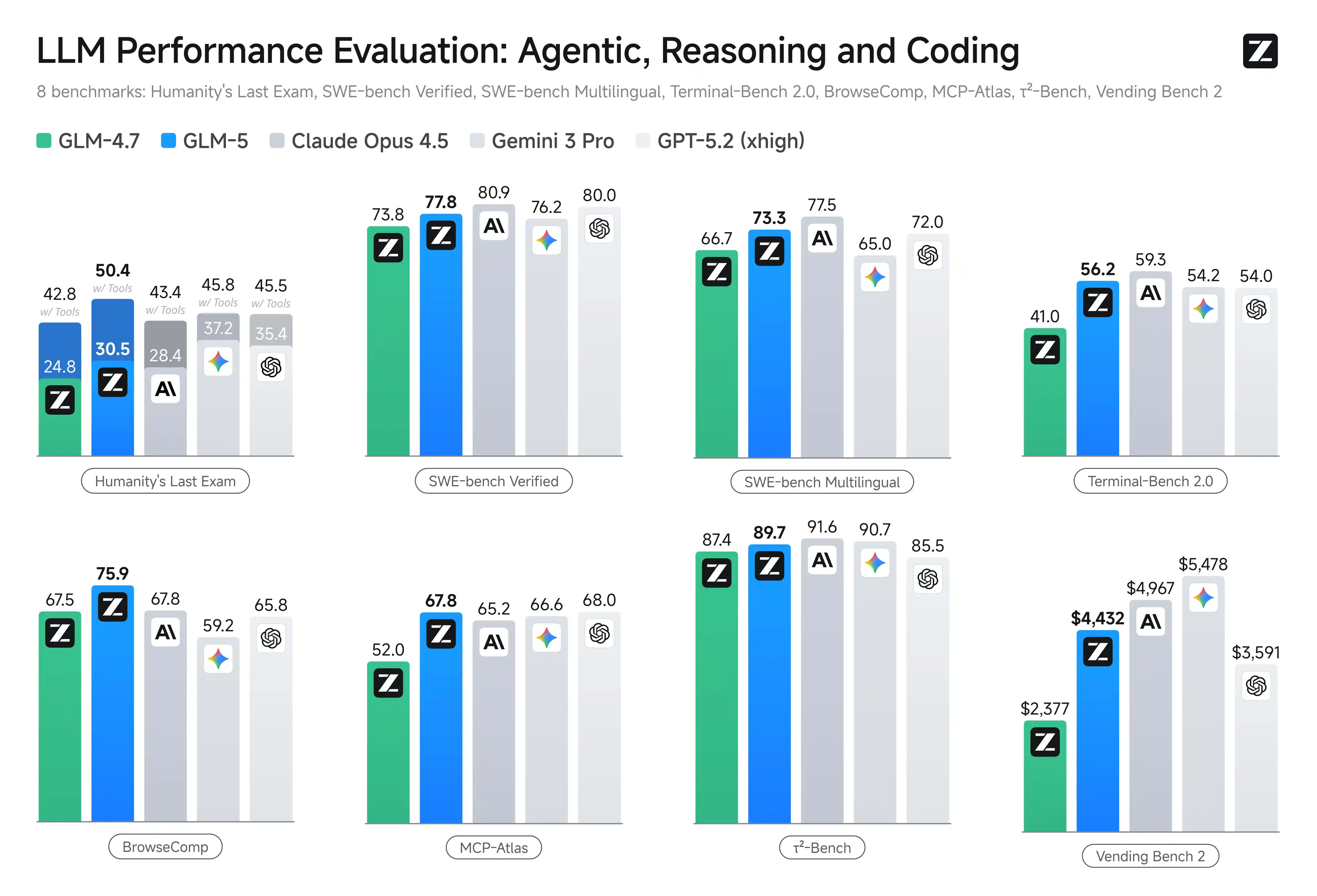

Спойлер: GLM-5 (744B MoE, 40B active) досягає рівня Claude Opus 4.5 у agentic coding та reasoning, при цьому є open-source (MIT) і значно дешевшим в API.

⚡ Коротко

- ✅ Z.ai: міжнародна платформа Zhipu AI з безкоштовним чатом і потужним API (OpenAI-сумісним).

- ✅ Chat mode: швидкий inference, ідеальний для RAG та простих діалогів.

- ✅ Agent mode: вбудовані інструменти, генерація документів (.docx, .pdf, .xlsx), multi-turn workflows.

- 🎯 Ви отримаєте: чітке розуміння архітектури, коли використовувати Chat vs Agent і чому GLM-5 виграє в ціні/можливостях.

📚 Зміст статті

Ця стаття зібрала головні матеріали для розуміння Z.ai (Zhipu AI) LLM

🎯 Що таке Z.ai та яке місце займає на ринку LLM 2026

Z.ai — це міжнародна платформа Zhipu AI (Knowledge Atlas Technology), що надає безкоштовний чат-агент (chat.z.ai), OpenAI-сумісний API (api.z.ai) та доступ до флагманської моделі GLM-5.

У 2026 році Z.ai — одна з топ-3 open-weight платформ (поряд з DeepSeek та Qwen), а GLM-5 є провідною open-source моделлю для agentic engineering та long-horizon задач, з результатами на рівні Claude Opus 4.5 / GPT-5.2 у coding та reasoning.

Zhipu AI тренувала GLM-5 повністю на Huawei Ascend (MindSpore), без залежності від NVIDIA-апаратного стеку — ключовий геополітичний та технічний фактор після потрапляння до US Entity List у 2025 році.

Z.ai — це споживчий інтерфейс (chat.z.ai) та developer-платформа (api.z.ai), повністю сумісна з OpenAI API spec (/v4/chat/completions). Zhipu AI провела IPO на Гонконгській біржі 8 січня 2026 (тікер 2513.HK), залучивши ~HK$4.35 млрд. Після релізу GLM-5 11 лютого 2026 акції компанії продемонстрували стрімке зростання.

Офіційний анонс GLM-5 |

Головний сайт Z.ai

Хто стоїть за платформою

Zhipu AI — один з найбільших незалежних AI-розробників Китаю, заснований професорами Tsinghua University. Серед інвесторів: Alibaba, Tencent, Meituan, Xiaomi та саудівський Prosperity7 Ventures. Після IPO компанія стала першою публічною foundation-model компанією у світі, що підкреслює її фінансову та технологічну зрілість.

Чому це важливо для розробників та enterprise 2026

GLM-5 пропонує SOTA результати: SWE-bench Verified 77.8%, Terminal-Bench 2.0 ~61.1%. При цьому ціна API (за 1 млн токенів) у 3–10 разів нижча за Claude Opus 4.5 або GPT-5.2. MIT-ліцензія забезпечує повний контроль над даними через self-hosting.

GLM-5 в дії: розробники використовують платформу для автономних пайплайнів: від архітектури до деплою, з вбудованою здатністю до self-correction та генерації складних артефактів (.docx/.pdf/.xlsx).

- ✔️ Open-weight MIT → повний контроль даних та моделі.

- ✔️ 200K контекст + DSA → ефективний RAG без втрати якості.

- ✔️ Agent mode → реальні deliverables (документи, код) замість тексту.

Висновок: Z.ai у 2026 — це інфраструктура для agentic AI: потужна, відкрита, економічна та незалежна від західного hardware-екосистеми.

📌 Архітектура платформи: API, моделі, tool-calling

Z.ai API Z.ai API — повністю сумісний з OpenAI специфікацією (/v4/chat/completions), підтримує GLM-5 та інші моделі, thinking mode (за замовчуванням у GLM-5), function/tool calling, streaming, context caching та structured output.

Єдина точка входу для загальних задач — https://api.z.ai/api/paas/v4; для coding/агентних сценаріїв — спеціалізований ендпоінт https://api.z.ai/api/coding/paas/v4.

Архітектура Z.ai побудована навколо єдиного OpenAI-компатибельного бекенду, що дозволяє мігрувати код з OpenAI/Anthropic за зміною base_url та api_key, без переписування логіки tool-calling чи reasoning.

Платформа складається з трьох основних шарів:

- Frontend / Consumer interface: chat.z.ai — безкоштовний веб-чат з Agent mode, вбудованими skills (генерація .docx/.pdf/.xlsx, landing pages, код тощо).

- Backend API: RESTful ендпоінти на https://api.z.ai/api/paas/v4 (загальний) та https://api.z.ai/api/coding/paas/v4 (для GLM Coding Plan / agentic coding). Повна сумісність з OpenAI SDK (Python, JS тощо) — достатньо замінити base_url та ключ.

- Моделі та inference: флагман GLM-5 (744B MoE, 40B active), GLM-4.7, GLM-4.6 тощо, розгорнуті на власному кластері (Huawei Ascend + MindSpore). Підтримка DeepSeek Sparse Attention (DSA) для ефективного long-context (200K токенів).

Офіційний Quick Start | API Reference (chat/completions)

Tool-calling та function execution

Tool-calling реалізований за стандартом OpenAI: параметри tools (масив функцій з JSON schema), tool_choice (none / auto / required / specific function). Модель повертає tool_calls у відповіді, підтримує multi-tool calls та interleaved thinking (роздуми між викликами інструментів). GLM-5 має покращену точність у tool-use завдяки спеціалізованому RL-етапу в тренуванні.

Офіційна документація Function Calling

Thinking mode та reasoning capabilities

GLM-5 має кілька режимів thinking: за замовчуванням — interleaved thinking (роздуми перед кожною відповіддю та tool call). Параметр thinking: {"type": "enabled"} або "disabled". На coding-ендпоінті — увімкнено за замовчуванням, на загальному — можна контролювати. Це дозволяє моделі виконувати складний step-by-step reasoning, self-correction та chaining tool calls з аналізом проміжних результатів.

Деталі Thinking Mode | Анонс GLM-5 з описом Agentic Engineering

Додаткові ключові можливості

- ✔️ Streaming — реальний час виведення (stream: true), з підтримкою tool streaming.

- ✔️ Context Caching — інтелектуальне кешування для довгих сесій, знижує витрати на повторний контекст.

- ✔️ Structured Output — примусовий JSON / schema output для системної інтеграції.

- ✔️ Макс. параметри: max_tokens до 128K, temperature, top_p тощо — все як в OpenAI.

Structured Output | Context Caching

Приклад базового API-запиту (cURL, OpenAI-сумісний)

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions" \-H "Authorization: Bearer YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "glm-5",

"messages": [{"role": "user", "content": "Привіт, що таке Agentic Engineering?"}],

"temperature": 0.7,

"max_tokens": 1024,

"thinking": {"type": "enabled"},

"stream": true

}'

Архітектура Z.ai — це максимально зручна для розробників інфраструктура: повна OpenAI-сумісність, потужні agentic можливості (tool-calling + interleaved thinking) та спеціалізовані ендпоінти роблять її ідеальною для швидкої міграції та production-використання агентів і складного reasoning.

Режим /chat — як працює

Режим /chat — це класичний completions-ендпоінт (/v4/chat/completions): швидкий, lightweight inference без вбудованого tool orchestration та agent loop. Ідеальний для інтерактивних діалогів, RAG, генерації тексту, код-рев'ю та простого reasoning.

У GLM-5 thinking mode увімкнено за замовчуванням (interleaved thinking), контекст зберігається в історії повідомлень (до 200K токенів), підтримується мультимодальність (текст + зображення/аудіо/відео/файли) та streaming. Latency значно нижчий, ніж в Agent mode.

Chat mode — це "швидкий мозок": модель відповідає миттєво, без додаткового overhead від планування, виклику інструментів чи генерації артефактів. Це робить його оптимальним для real-time застосунків.

У веб-інтерфейсі chat.z.ai режим Chat активується за замовчуванням (або перемикається вручну). В API — це стандартний виклик /api/paas/v4/chat/completions з параметрами OpenAI-сумісними. GLM-5 використовує MoE-архітектуру (744B total, 40B active) + DeepSeek Sparse Attention (DSA) для ефективного long-context inference без значного зростання витрат.

Офіційна документація Chat Completion | Анонс GLM-5 з описом Chat vs Agent

Внутрішня робота inference pipeline в Chat mode

- Запит → токенізація повідомлень (системний промпт + історія + user input).

- Контекст (до 200K токенів) проходить через MoE + DSA (спарсна увага економить ~50–70% compute порівняно з dense).

- GLM-5 генерує відповідь з interleaved thinking (роздуми між кроками decode, якщо thinking: {"type": "enabled"}).

- Без автоматичних tool calls — якщо потрібно tool, модель поверне текстовий опис, але не викличе його самостійно (на відміну від Agent).

- Streaming (stream: true) виводить токени в реальному часі, latency на першу відповідь — <1–2 с на простих запитах.

Ключові особливості та параметри

- ✔️ System prompt — повна підтримка, зберігається в історії.

- ✔️ Multi-turn контекст — автоматичне збереження попередніх повідомлень (до 200K токенів).

- ✔️ Multimodal input — текст + зображення/аудіо/відео/файли (GLM-5 підтримує native vision/audio processing).

- ✔️ Thinking mode — за замовчуванням enabled (interleaved), можна вимкнути для швидкості. Підтримує clear_thinking для очищення попередніх роздумів.

- ✔️ Streaming — реальний час виведення (stream: true).

- ✔️ Structured output — можливий через response_format (JSON schema тощо).

Деталі Thinking Mode | Streaming Messages

Приклад API-запиту в Chat mode (Python, OpenAI SDK сумісний)

from openai import OpenAIclient = OpenAI(

api_key="YOUR_ZAI_API_KEY",

base_url="https://api.z.ai/api/paas/v4"

)

response = client.chat.completions.create(

model="glm-5",

messages=[

{"role": "system", "content": "Ти — експерт з Python. Відповідай чітко та з прикладами коду."},

{"role": "user", "content": "Напиши функцію для парсингу CSV з 200K рядків ефективно."}

],

temperature=0.7,

max_tokens=2048,

thinking={"type": "enabled"},

stream=True

)

for chunk in response:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="", flush=True)

Приклади use-cases, де Chat mode перевершує

- ✔️ Інтерактивні чат-боти (customer support, техпідтримка).

- ✔️ RAG-пайплайни (пошук + генерація відповідей на великих документах).

- ✔️ Генерація тексту/коду/контенту без необхідності в deliverables (статті, поеми, рефакторинг).

- ✔️ Швидке прототипування ідей (brainstorming, пояснення концепцій).

- ✔️ Мультимодальні запити (опис зображення + питання, транскрипція аудіо + аналіз).

Висновок розділу: Режим /chat в Z.ai — це швидкий, економічний та надійний інструмент для будь-яких задач, де потрібна миттєва відповідь, довгий контекст чи мультимодальність, без складного agent-планування та overhead. Використовуйте його як основу для production-чатів та RAG, а Agent mode — для автономних завдань з deliverables.

Режим /agent — чим відрізняється від chat

Коротка відповідь: Agent mode — це повноцінний agentic інтерфейс з вбудованими skills, autonomous tool-calling, multi-turn плануванням та генерацією реальних deliverables (.docx, .pdf, .xlsx, сайти тощо). Модель сама планує, викликає інструменти, перевіряє результати та ітерує до завершення задачі.

На відміну від Chat mode (швидка одноразова генерація тексту/коду), Agent mode реалізує повний цикл agentic engineering: understanding → planning → tool execution → self-check → revise → deliverable.

Agent mode — це перехід від "vibe coding" (швидкий код на відчуттях) до справжньої agentic engineering: автономне виконання складних, довгострокових завдань з реальними результатами, а не просто відповідями.

У веб-інтерфейсі chat.z.ai Agent mode активується перемикачем (або автоматично для складних запитів). GLM-5 у цьому режимі використовує вбудовані skills для створення документів, аналізу даних, генерації сайтів/слайдів тощо. В API Agent-режим реалізується через стандартний /chat/completions з увімкненим tool-calling, thinking mode (preserved + interleaved) та tool_stream=true для реального часу отримання параметрів інструментів.

Офіційний блог GLM-5: From Vibe Coding to Agentic Engineering | GLM-5 Overview в docs

Ключові відмінності Agent mode від Chat mode

| Аспект | Chat mode | Agent mode |

|---|

| Мета | Швидка відповідь, діалог, генерація тексту/коду | Автономне виконання задачі → реальний deliverable |

| Inference pipeline | Одноразовий decode + interleaved thinking (якщо enabled) | Ітеративний цикл: plan → tool call → observe → revise → repeat |

| Tool-calling | Модель може описати інструмент, але не викликає автоматично | Автономне рішення про виклик, chaining кількох інструментів, streaming tool results |

| Thinking mode | Interleaved (за замовчуванням), без збереження між турами | Preserved thinking (зберігає reasoning між турами) + interleaved + self-check |

| Output | Текст, код, JSON (structured) | Готові файли (.docx, .pdf, .xlsx), сайти, слайди, повні проекти |

| Latency / Cost | Низький (instant) | Вищий (multi-turn, tool calls), але ефективний завдяки DSA |

| Найкращі use-cases | RAG, чат-боти, brainstorming, швидкий код | Complex agent tasks: full-stack dev, document generation, long-horizon simulation |

Вбудовані skills та artifacts в Agent mode (веб-інтерфейс)

GLM-5 у Agent mode має native skills для:

- Генерація документів: PRD, lesson plans, exams, financial reports, menus → .docx / .pdf / .xlsx

- Аналіз даних: створення таблиць, графіків, звітів з сирих даних

- Full-stack розробка: frontend + backend + deploy scripts

- Multi-turn collaboration: ітеративне уточнення з користувачем

Приклад: запит "Створи sponsorship proposal для шкільної футбольної команди" → модель генерує .docx з секціями, таблицями, placeholders для зображень, color palette (navy blue + gold + orange).

Приклади deliverables у блозі GLM-5

Як реалізувати Agent mode в API

Використовуйте стандартний endpoint з:

tools / tool_choice: "auto" або "required"thinking: {"type": "enabled"} (preserved thinking на coding endpoint)tool_stream: true для реального часу tool params- Модель сама вирішує: викликати інструмент, продовжити thinking чи завершити

Це дозволяє будувати автономних агентів (наприклад, через LangChain / OpenClaw integration).

Function Calling Guide | Preserved & Interleaved Thinking

Приклад workflow в Agent mode (Vending Bench 2 simulation)

- Запит: "Запусти бізнес вендингових автоматів на 1 рік"

- Модель планує: аналіз ринку → вибір локацій → закупівля → ціноутворення

- Ітеративно викликає інструменти (симуляція продажів, розрахунок витрат)

- Self-check: коригує стратегію на основі проміжних результатів

- Deliverable: фінальний баланс $4,432.12 + звіт у .xlsx

Це демонструє long-horizon agentic capabilities GLM-5 (SOTA серед open-source на Vending Bench 2).

Висновок: Agent mode в Z.ai / GLM-5 — це справжній стрибок до автономних систем: від простих відповідей (Chat) до повного виконання складних завдань з deliverables та self-correction. Використовуйте його для production-агентів, enterprise automation та long-range задач, де Chat mode виявляється недостатнім.

Основний движок: серія GLM, фокус на GLM-5

GLM-5 — це флагманська модель Zhipu AI 2026 року 744B total parameters (MoE, 40B active), контекст до 202 752 токенів (eval), max output 131 072 токенів, DeepSeek Sparse Attention (DSA), пре-тренінг на 28.5T токенів, MIT-ліцензія.

GLM-5 спеціалізується на agentic engineering та long-horizon задачах, досягаючи SOTA серед open-weight моделей: SWE-bench Verified 77.8%, Terminal-Bench 2.0 56.2–60.7%, Vending Bench 2 $4,432.12, наближаючись до Claude Opus 4.5 та GPT-5.2 у coding/reasoning/agent benchmarks.

GLM-5 — це перехід від "vibe coding" (швидкий код на відчуттях) до справжньої agentic engineering: автономне виконання складних системних задач з self-correction, tool chaining та реальними deliverables.

Серія GLM — це еволюція від GLM-4 (2024–2025) до GLM-5 (реліз 12 лютого 2026). GLM-5 масштабує параметри з 355B (32B active у GLM-4.5) до 744B (40B active), збільшує пре-тренінг з 23T до 28.5T токенів, інтегрує DeepSeek Sparse Attention (DSA) для ефективного long-context та slime (асинхронний RL-фреймворк) для тонкої post-training оптимізації.

Офіційний анонс GLM-5 | Модель на Hugging Face | ModelScope | Огляд GLM-5 в docs

Архітектура GLM-5: ключові технічні характеристики

- ✔️ Параметри: 744B total (MoE з 256 експертами, top-8 активація, ~40B active per token, sparsity ~5.9%)

- ✔️ Attention: DeepSeek Sparse Attention (DSA) — знижує витрати на inference при збереженні long-context (економія compute ~50–70% vs dense)

- ✔️ Контекстне вікно: до 202 752 токенів (eval HLE w/ Tools), 200K у SWE-bench, 128K у Terminal-Bench; max generation 131 072 токенів

- ✔️ Модальності: текст + native document generation (.docx, .pdf, .xlsx); мультимодальність в серії (vision/audio в окремих моделях)

- ✔️ Tool-calling та Agentic: нативна підтримка function calling, thinking mode (interleaved/preserved), OpenClaw framework для cross-app agents

- ✔️ Post-training: slime (асинхронний RL) для fine-grained ітерацій, зниження hallucination (рекордно низький на AA-Omniscience)

- ✔️ Ліцензія: MIT — повний open-weight, self-hosting, fine-tune дозволено

Основні benchmarks GLM-5 (Thinking Mode, 2026 eval)

| Benchmark | GLM-5 | GLM-4.7 | Claude Opus 4.5 | GPT-5.2 (xhigh) | Примітка |

|---|

| SWE-bench Verified | 77.8% | 73.8% | 80.9% | 80.0% | 200K context |

| SWE-bench Multilingual | 73.3% | 66.7% | 77.5% | 72.0% | — |

| Terminal-Bench 2.0 (Terminus 2) | 56.2% / 60.7%† | 41.0% | 59.3% | 54.0% | 128K context, verified |

| BrowseComp w/ Context Manage | 75.9% | 67.5% | 67.8% | 65.8% | discard-all strategy |

| HLE w/ Tools | 50.4% | 42.8% | 43.4%* | 45.5%* | 202K input / 131K output |

| Vending Bench 2 | $4,432.12 | $2,376.82 | $4,967.06 | $3,591.33 | long-horizon agent sim |

| τ²-Bench | 89.7% | 87.4% | 91.6% | 85.5% | tool invocation |

| Tool-Decathlon | 39.2% | 23.8% | 43.5% | 46.3% | multi-tool |

† Verified dataset | * full set | GLM-5 лідирує серед open-weight, закриває геп з frontier-моделями в agentic/coding.

Порівняння з попередніми GLM-моделями

GLM-5 — це ~2× scale від GLM-4.5 (355B → 744B total, 32B → 40B active), +24% пре-тренінг даних (23T → 28.5T), DSA замість стандартної attention, slime RL для post-training. Результат: +20% середній приріст на benchmarks, SOTA open-source в reasoning, coding, agentic (CC-Bench-V2 internal).

Доступність та deployment

- ✔️ Open-source: Hugging Face (zai-org/GLM-5), ModelScope (ZhipuAI/GLM-5), FP8-квантизована версія

- ✔️ Inference: vLLM, SGLang, Ascend NPU, KTransformers; сумісність з non-NVIDIA (Huawei Ascend, Moore Threads тощо)

- ✔️ API: api.z.ai (OpenAI-compatible), OpenRouter, Together AI тощо

- ✔️ Безкоштовно: chat.z.ai (Agent/Chat mode)

Висновок: GLM-5 у 2026 році є однією з найсильніших open-weight моделей для задач coding, agentic engineering та long-horizon планування. Вона демонструє високі результати в ключових бенчмарках (SWE-bench Verified 77.8%, Terminal-Bench 2.0 ~56–61%, Vending Bench 2 $4,432), поєднує ефективну архітектуру (MoE 744B/40B active + DeepSeek Sparse Attention), відкриту ліцензію MIT та низьку вартість API/self-hosting. Це робить її конкурентоспроможним вибором для розробників та компаній, які шукають frontier-рівень можливостей без залежності від закритих моделей та з повним контролем над інфраструктурою та даними..

Для яких задач підходить Z.ai

Z.ai (з фокусом на GLM-5): ідеально підходить для agentic engineering, складного coding, генерації документів/звітів, довгострокових автономних агентів та enterprise RAG на великих контекстах — за значно нижчою ціною, ніж Claude Opus 4.5 / GPT-5.2.

Платформа виграє в задачах, де потрібна автономність, self-correction, multi-turn планування, генерація реальних deliverables (.docx/.pdf/.xlsx) та ефективна робота з 200K контекстом.

Z.ai перетворює LLM з "розмовного інструменту" на "робочий інструмент": від генерації тексту до повного виконання завдань з кінцевими артефактами та довгостроковим плануванням.

GLM-5 та Agent mode на chat.z.ai / api.z.ai спеціально оптимізовані для складних системних задач. Завдяки DSA (DeepSeek Sparse Attention), MoE-архітектурі та slime RL, модель ефективно справляється з long-horizon workflows, де Claude / GPT часто дорожчі або менш автономні.

Офіційний блог GLM-5: use-cases та приклади

Найкращі сценарії використання (де Z.ai перевершує або економить)

- ✔️ Agentic coding та full-stack розробка: автономна генерація коду (frontend + backend + deploy), bug-fixing, refactoring legacy-коду, архітектурне планування. Приклад: завантаження репозиторію → аналіз coupling → план мікросервісів → cross-file рефакторинг.

- ✔️ Генерація enterprise-документів та офісних артефактів: PRD, lesson plans, financial reports, sponsorship proposals, equity research, spreadsheets з сирих даних → готові .docx/.pdf/.xlsx. Приклад: "Створи sponsorship proposal для шкільної футбольної команди" → повний документ з секціями, таблицями, color palette та image placeholders.

- ✔️ Довгострокові агенти з self-correction: симуляція бізнесу (Vending Bench 2: $4,432 баланс за рік), multi-tool chaining, планування на тисячі кроків. Ідеально для автономних пайплайнів (Devin-подібні агенти).

- ✔️ Enterprise RAG та long-context reasoning: аналіз великих кодових баз, документації, даних (200K+ токенів), BrowseComp-style веб-навігація з context manage (75.9%).

- ✔️ Multilingual coding та terminal workflows: сильні результати на SWE-bench Multilingual (73.3%), Terminal-Bench (56–61%).

- ✔️ Бюджетні production-агенти: API ~$1/M input / $3.2/M output — 5–10× дешевше Claude/GPT при близькій якості в agentic/coding.

Приклади реальних кейсів (з офіційних джерел та спільноти 2026)

- Автоматизація legacy refactoring: завантаження монолітного проєкту → GLM-5 аналізує модулі → пропонує та виконує розбиття на мікросервіси → генерує код + тести.

- Офісна автоматизація: сирі дані про продажі → автоматичний .xlsx-звіт з графіками + .docx executive summary + .pdf presentation slides.

- Симуляція бізнесу: "Запусти вендинговий бізнес на рік" → модель планує локації, закупівлі, ціни → ітерує на основі симуляцій → фінальний баланс $4,432 (Vending Bench 2 #1 open-source).

- Coding agent integration: через OpenClaw / Claude Code / OpenRouter — GLM-5 виконує Terminal-Bench завдання з 128K контекстом та resource limits.

Для яких задач Z.ai НЕ підходить (або поступається Claude / GPT-5.2)

- ✖️ Ultra-real-time чат-боти та high-throughput: Agent mode повільніший (17–19 токенів/с vs 25–30+ у Claude/GPT), interleaved thinking додає latency. Краще Chat mode або легші моделі.

- ✖️ Native multimodal (vision-heavy) задачі: GLM-5 — текст + document generation; повна мультимодальність (image/video reasoning) в окремих моделях серії (GLM-Image), але поступається GPT-5.2 / Gemini в MMMU чи фізичному розумінні.

- ✖️ Максимальна ситуаційна обізнаність та creative/nuanced промпти: Claude Opus 4.5/4.6 часто кращий у ambiguous, creative coding, UI mockups з описів, subtle bug detection. GLM-5 більш "engineering copilot" — структурований, але менш "інтуїтивний".

- ✖️ Self-hosting на обмеженому hardware без оптимізацій: 744B MoE вимагає значних ресурсів (пам'ять, GPU/Ascend); для local deployment потрібні vLLM/SGLang + quantization.

- ✖️ Short & lightweight tasks без deliverables: для простих чатів / brainstorming — overhead Agent mode не виправданий, краще Chat mode або дешевші моделі.

Висновок: Z.ai / GLM-5 — вибір для автономних, agentic та coding-задач з deliverables, де потрібна економія, відкритий код та long-horizon планування. Він поступається в швидкості, чистій мультимодальності та деяких creative сценаріях — там краще Claude / GPT. Використовуйте Z.ai там, де автономність + бюджет важливіші за максимальну швидкість чи інтуїтивність.

Обмеження та позиціонування

Основні обмеження Z.ai / GLM-5 у 2026 році — пікові throttling та низька concurrency (часто 1 паралельний запит навіть на платних планах), підвищена витрата квот на GLM-5, нижча швидкість інференсу (~17–19 токенів/с у thinking mode), слабша нативна мультимодальність (vision/audio/video reasoning), високі вимоги до ресурсів для self-hosting (1.5 TB BF16 weights, мінімум 8× H200/H20 GPUs).

Z.ai позиціонується як доступна альтернатива frontier-моделям для розробників та компаній, які віддають перевагу автономності, низькій вартості та відкритому коду, але готові враховувати обмеження в масштабуванні та швидкості.

Після релізу GLM-5 (лютий 2026) платформа зіткнулася з різким зростанням навантаження (трафік ×10), що призвело до суттєвих обмежень сервісу, публічних вибачень, компенсацій та тимчасового уповільнення rollout моделі. Акції Zhipu AI впали на ~23% через скарги на стабільність та брак обчислювальних потужностей (компанія шукала партнерів для inference).

Офіційний блог GLM-5 | Документація API

Технічні та операційні обмеження

- Throttling та concurrency: на пікових навантаженнях — обмеження до 1 паралельного запиту навіть на Pro/Max планах, помилки "Too much concurrency", повільний rollout GLM-5 (спочатку тільки Max, потім Pro з обмеженнями, Lite — з затримкою). Це суттєво знижує придатність для enterprise-використання з паралельними агентами.

- Витрата квот: GLM-5 споживає 2–3× більше квоти порівняно з GLM-4.7, що робить низькобюджетні плани ($7–15/міс) менш ефективними для інтенсивного використання.

- Швидкість інференсу: ~17–19 токенів/с у thinking mode, нижче за Claude Opus 4.5 / GPT-5.2 (25–30+ токенів/с). Latency вищий у Agent mode через ітеративне планування.

- Мультимодальність: сильна в генерації документів (.docx/.pdf/.xlsx), але native обробка зображень/аудіо/відео слабша за GPT-5.2 (MMMU ~84%) та Gemini. GLM-Image — окрема модель, інтеграція не безшовна.

- Self-hosting: 744B MoE (1.5 TB BF16 weights) вимагає enterprise-кластерів (мінімум 8× H200/H20 GPUs з high-bandwidth interconnect). Навіть з FP8-квантизацією доступно лише для великих команд.

- Інші аспекти: менша situational awareness у складних неоднозначних сценаріях, обмежена екосистема готових інтеграцій порівняно з OpenAI/Anthropic, геополітичні та регуляторні ризики (китайська компанія, data sovereignty).

Позиціонування на ринку 2026

Z.ai / GLM-5 орієнтований на розробників, стартапи та enterprise, які потребують автономних агентів, long-horizon задач, генерації документів та низької вартості API (~$0.80–$1 / млн input, $2.56–$3.2 / млн output — 3–10× нижче Claude Opus 4.5 / GPT-5.2 у подібних сценаріях). Фокус на автономності, document deliverables, незалежності від NVIDIA (тренування на Huawei Ascend) та можливості self-host / fine-tune (MIT-ліцензія).

Платформа менш підходить для задач з вимогами до ultra-low latency (real-time чат-боти), високої креативності / nuanced промптів, повної мультимодальності або максимальної стабільності сервісу під високим навантаженням.

Приклади, де обмеження найбільш помітні

- Запуск кількох паралельних агентів у production — зупинка через concurrency limit.

- Інтенсивне використання Agent mode на базових планах — швидке вичерпання квоти за години.

- Self-hosting для приватності / on-premise — недоступно без значних інвестицій у hardware.

- Аналіз відео + кодування / мультимодальні reasoning-задачі — нижча якість порівняно з GPT-5.2.

Висновок: Z.ai / GLM-5 пропонує конкурентні можливості в agentic engineering та coding за нижчою ціною та з відкритим кодом, але з помітними компромісами в швидкості, масштабуванні, мультимодальності та стабільності під піковим навантаженням. Платформа підходить для сценаріїв, де пріоритет — автономність, бюджет та контроль даних; для задач з жорсткими вимогами до latency, креативності чи повної мультимодальності перевагу мають Claude / GPT.

❓ Часті питання (FAQ)

Чим GLM-5 кращий за GLM-4.7?

GLM-5 має значно більший масштаб: 744B total parameters (MoE, ~40B active) проти 355B (~32B active) у GLM-4.7, пре-тренінг зріс з 23T до 28.5T токенів, інтегровано DeepSeek Sparse Attention (DSA) для ефективного long-context. Це дає ~20% середній приріст на benchmarks: SWE-bench Verified 77.8% (vs 73.8%), Terminal-Bench 2.0 ~56–61% (vs ~41%), BrowseComp 75.9% (vs 67.5%), Vending Bench 2 $4,432 (vs $2,377). Значно покращено agentic engineering, long-horizon планування, self-correction та знижено hallucination rate (заявлено ~56% зменшення). GLM-5 переходить від "vibe coding" до справжньої автономної системної інженерії, наближаючись до Claude Opus 4.5.

Чи є Z.ai безкоштовним?

Так, веб-чат на chat.z.ai безкоштовний (з квотами на кількість запитів/токенів, обмеженнями на Agent mode та поступовим rollout GLM-5). API (api.z.ai) — pay-as-you-go з free trial (обмежена квота на старті), але безкоштовний доступ до GLM-5 через OpenRouter або інші агрегатори з мінімальними лімітами. Для повноцінного використання (особливо GLM-5) потрібен GLM Coding Plan від $10/міс (Lite/Pro/Max), де GLM-5 споживає 2–3× більше квоти, ніж GLM-4.7.

Яка ціна API для GLM-5 і як економити?

Офіційна ціна (2026): $1 за млн input токенів, $3.2 за млн output (cached input — $0.2/млн, storage тимчасово безкоштовно). Це 3–10× дешевше Claude Opus 4.5 / GPT-5.2 при близькій якості в agentic/coding. GLM-5-Code (оптимізований для коду) — $1.2 input / $5 output. Економія: використовуйте context caching для довгих сесій, GLM-4.7 для рутинних задач (дешевше), off-peak години (менше множника квоти в планах). GLM-5 споживає більше ресурсів, тому в Coding Plan — 2–3× швидше витрата квоти.

✅ Висновки

- 🔹 Z.ai у 2026 році є однією з провідних платформ для реалізації agentic AI завдяки моделі GLM-5, яка демонструє результати, близькі до Claude Opus 4.5 та GPT-5.2 у ключових бенчмарках agentic та coding напрямків (SWE-bench Verified 77.8%, Terminal-Bench 2.0 56–61%, Vending Bench 2 $4,432).

- 🔹 Режим Chat забезпечує швидкий inference з низьким споживанням ресурсів, підходить для інтерактивних діалогів, RAG-пайплайнів, генерації тексту/коду та обробки мультимодальних запитів з мінімальною затримкою.

- 🔹 Режим Agent реалізує ітеративний цикл з плануванням, викликом інструментів, самоперевіркою та генерацією кінцевих артефактів (.docx, .pdf, .xlsx, звіти, сайти), дозволяючи виконувати складні завдання з високим ступенем автономності.

- 🔹 GLM-5 (744B MoE, 40B active, 200K контекст з DeepSeek Sparse Attention, пре-тренінг 28.5T токенів, MIT-ліцензія) показує високі результати серед open-weight моделей у задачах кодування, reasoning та long-horizon планування при значно нижчій вартості API порівняно з закритими аналогами.

- 🔹 Платформа підходить для розробників, стартапів та enterprise-команд, які потребують автономних агентів, економії на токенах, можливості self-hosting / fine-tuning та незалежності від екосистеми NVIDIA (тренування на Huawei Ascend).

Головна думка: Z.ai з моделлю GLM-5 у 2026 році є конкурентоспроможним рішенням для задач, що вимагають високої автономності, довгострокового планування, генерації документів та низької вартості інференсу, особливо в сценаріях, де пріоритет віддається відкритому коду та контролю над інфраструктурою.