Режим /agent у Z.ai — це автономний агентний інтерфейс на базі GLM-5, що переходить від простих відповідей до повноцінного виконання завдань з плануванням, викликом інструментів та генерацією кінцевих результатів.

Спойлер: Agent-режим реалізує ітеративний цикл (plan → tool → observe → revise → deliver), на відміну від одноразового chat-режиму.

⚡ Коротко

- ✅ Agent — автономний режим з tool-calling, thinking mode, multi-turn плануванням та генерацією файлів (.docx/.pdf/.xlsx).

- ✅ Ключові можливості: autonomous tool invocation, self-correction, chaining, long-horizon виконання.

- ✅ Відмінність від Chat: chat — швидка відповідь, agent — повний цикл виконання завдання.

- 🎯 Ви отримаєте: розуміння архітектури Agent-режиму, його внутрішньої логіки, прикладів workflow та реальних обмежень.

- 👇 Нижче — технічний розбір, схеми та порівняння

📚 Зміст статті

🎯 Що таке Agent в LLM-системах

Agent в LLM-системах: — це архітектура, яка розширює можливості базової моделі за рахунок автономного циклу: спостереження за станом → міркування → вибір дії (включаючи виклик зовнішніх інструментів) → виконання дії → аналіз результату → коригування плану. Замість одноразової генерації тексту модель виконує багатоступеневі завдання до досягнення кінцевої мети.

У Z.ai Agent-режим реалізує саме такий цикл на базі GLM-5, з використанням вбудованих skills, OpenAI-сумісного tool-calling та thinking mode (preserved + interleaved).

Agent-режим переводить LLM з ролі реактивного генератора відповідей у роль проактивного виконавця завдань з елементами автономного прийняття рішень та самокорекції.

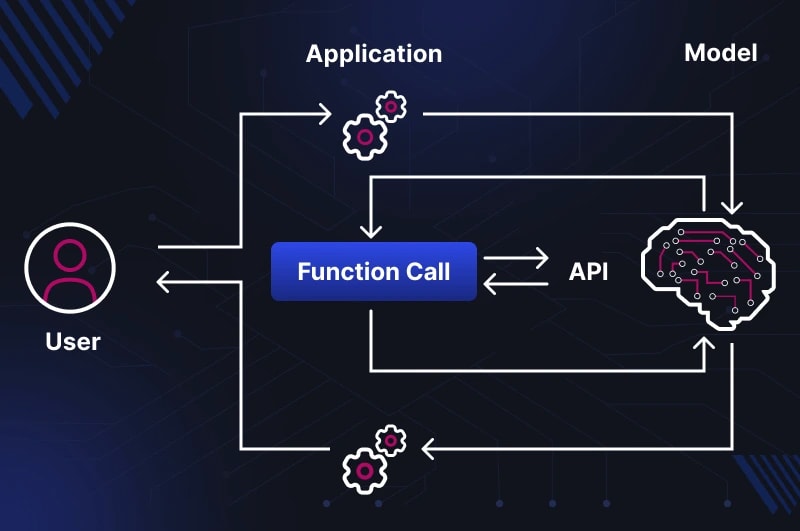

Загальна архітектура LLM-агента (стандартна схема 2025–2026 років, реалізована в Z.ai):

- Reasoning engine — основна LLM (у Z.ai — GLM-5), відповідає за планування, аналіз стану та прийняття рішень. Використовує thinking mode для розгорнутого chain-of-thought перед кожною дією.

- Tool interface / function calling — механізм виклику зовнішніх функцій. У Z.ai — OpenAI-сумісний формат: модель повертає tool_calls з JSON-аргументами, сервер/клієнт виконує функцію, результат повертається як нове повідомлення (observation).

- Memory / Context management — збереження історії дій, спостережень та проміжних результатів. У Z.ai це реалізовано через multi-turn messages + preserved thinking (роздуми зберігаються між ітераціями).

- Execution loop — основний цикл агента:

- Observe — отримання поточного стану (вхідний запит + попередні результати)

- Think — міркування (thinking mode)

- Act — вибір дії: або продовжити генерацію тексту, або викликати інструмент

- Execute — виконання дії (серверна сторона для вбудованих skills)

- Repeat — повернення результату в контекст і новий цикл

- Self-correction & termination condition — модель оцінює, чи досягнуто мети (наприклад, створено файл, отримано потрібний результат). Якщо ні — продовжує ітерацію; якщо так — завершує з deliverable.

У Z.ai Agent-режим доступний у двох формах:

- Веб-інтерфейс chat.z.ai — автоматично активується для складних запитів або через перемикач. Має вбудовані skills (створення документів, аналіз даних, генерація сайтів тощо), які викликаються без явного опису в промпті.

- API-реалізація — через стандартний /chat/completions з увімкненим tool-calling, thinking mode та tool_stream=true. Клієнт сам обробляє tool_calls, виконує функції та повертає результати в наступному запиті.

Офіційна документація tool-calling та agent-режиму |

Анонс GLM-5 з описом agentic engineering

Еволюція від chat до agent в Z.ai

Chat-режим — реактивний: користувач запитує → модель генерує відповідь → кінець.

Agent-режим — проактивний: користувач ставить мету → модель планує → виконує дії → перевіряє → коригує → видає кінцевий результат.

Цей перехід став ключовим у 2025–2026 роках, коли LLM перейшли від "генераторів тексту" до "виконавців завдань" (agentic shift).

Практичні наслідки

Agent-режим дозволяє вирішувати завдання, які неможливі в чистому chat-режимі:

- Автономний аналіз даних → створення звіту

- Повний цикл розробки: план → код → тест → рефакторинг

- Multi-tool workflows: пошук → розрахунок → візуалізація → документ

Водночас це збільшує складність, latency та витрату токенів.

Висновок: Agent в LLM-системах, зокрема в Z.ai, — це архітектура з автономним циклом observe-think-act, що дозволяє моделі виконувати багатоступеневі завдання з використанням інструментів та самокорекцією, на відміну від реактивного chat-режиму.

Детальний огляд режиму Chat: Режим /chat в Z.ai — як працює та коли використовувати

Повний аналіз платформи Z.ai (Chat vs Agent, архітектура GLM-5): Z.ai 2026: архітектура, режими Chat vs Agent та можливості GLM-5

Tool-calling та function execution

GLM-5 в Agent- режимі використовує OpenAI-сумісний механізм tool-calling: клієнт передає масив tools у форматі JSON Schema, модель повертає tool_calls з аргументами, виконання відбувається на стороні сервера (для вбудованих skills) або клієнта (для кастомних функцій). Підтримуються tool_choice, tool_stream, multi-tool calls, preserved thinking між викликами та structured output.

Це дозволяє моделі автономно формувати, виконувати та аналізувати результати викликів інструментів у рамках ітеративного циклу.

Tool-calling — це центральний механізм автономності в Agent-режимі: модель переходить від опису дії до структурованого виконання та обробки результату, що робить її здатною до реального виконання багатоступеневих завдань.

Технічна реалізація tool-calling в Z.ai (на базі GLM-5, API /v4/chat/completions, 2026):

- Передача інструментів: параметр tools — масив об’єктів у форматі OpenAI JSON Schema:

{"type": "function",

"function": {

"name": "search_web",

"description": "Пошук інформації в інтернеті",

"parameters": {

"type": "object",

"properties": {

"query": { "type": "string", "description": "Пошуковий запит" }

},

"required": ["query"]

}

}

}

- tool_choice: визначає стратегію виклику:

- "auto" — модель самостійно вирішує, чи потрібен виклик (найпоширеніший режим)

- "required" — примусовий виклик хоча б одного інструменту

- "none" — заборона виклику інструментів

- конкретний об’єкт { "type": "function", "function": { "name": "..." } } — примусовий виклик певної функції

- Повернення результату: модель у відповіді повертає tool_calls — масив з id, type: "function", function: { name, arguments (JSON-string) }. Клієнт виконує функцію та надсилає результат назад як нове повідомлення з role: "tool", tool_call_id та content.

- tool_stream=true: потокова передача параметрів інструменту в реальному часі (корисно для UI, де потрібно показувати прогрес виклику до завершення генерації).

- Multi-tool calls: модель може повернути кілька tool_calls в одній відповіді (паралельне або послідовне виконання).

- Preserved thinking: thinking mode зберігає роздуми між ітераціями викликів (особливо ефективно на coding-ендпоінті), що дозволяє моделі пам’ятати попередні міркування при аналізі результатів інструментів.

- Structured output: після виконання інструментів модель може бути примушена повернути результат у заданій JSON-схемі (response_format).

У веб-інтерфейсі chat.z.ai Agent-режим має вбудовані skills (наприклад, create_document, analyze_data, generate_landing), які викликаються автоматично без явного опису в промпті — модель розпізнає намір і використовує внутрішні інструменти.

Офіційна документація function/tool calling |

Preserved thinking у tool-calling

Виконання на стороні сервера vs клієнта

У Z.ai реалізовані обидва підходи:

- Сервер-сайд execution (веб-інтерфейс): вбудовані skills виконуються безпосередньо на серверах Zhipu (наприклад, генерація .docx або запуск sandbox-коду). Модель отримує результат автоматично як observation.

- Клієнт-сайд execution (API): клієнт отримує tool_calls → виконує функцію локально або на своєму сервері → надсилає результат назад у наступному запиті. Це дає повний контроль, але вимагає реалізації циклу на стороні розробника.

Trade-offs та ефективність

Переваги реалізації:

- Повна сумісність з OpenAI-екосистемою (LangChain, LlamaIndex тощо)

- Підтримка preserved thinking між викликами — покращує послідовність на довгих ланцюжках

- Висока точність вибору інструменту (завдяки RL-етапу Slime)

Обмеження:

- Модель іноді over-calls (викликає інструменти зайвий раз) — вимагає точних описів у tools

- На пікових навантаженнях можливі затримки через throttling

- Без tool_stream клієнт не бачить проміжного прогресу виклику

Висновок розділу: Tool-calling у Agent-режимі Z.ai — це повноцінний, OpenAI-сумісний механізм з підтримкою streaming, multi-tool, preserved thinking та сервер/клієнт execution, що забезпечує високу точність автономного виклику та обробки інструментів у складних багатоступеневих сценаріях.

Виконання коду та цепочки дій

Коротка відповідь: Agent-режим GLM-5 підтримує генерацію, виконання та ітеративне коригування коду в sandboxed середовищі, а також chaining кількох інструментів у послідовних або паралельних ланцюжках дій з self-correction на основі отриманих результатів.

Це дозволяє моделі переходити від простої генерації коду до повного циклу: написання → запуск → аналіз помилок → виправлення → повторний запуск → фінальний результат.

Виконання коду та chaining інструментів — це ключовий елемент переходу від "генератора коду" до "виконавця завдань", де модель отримує зворотний зв'язок від реального виконання та самостійно працює над помилками.

Технічна реалізація в Agent-режимі Z.ai (GLM-5, 2026):

- Генерація та виконання коду:

- Модель генерує Python-код (або інший підтримуваний скрипт) у вигляді tool-call (наприклад, функція "execute_python_code" з параметром code).

- Виконання відбувається в sandboxed interpreter на стороні сервера Z.ai (без доступу до файлової системи хоста, мережевих викликів поза дозволеними, обмеження на ресурси — CPU time, пам'ять).

- Результат виконання (stdout, stderr, return value) повертається моделі як observation у наступному кроці контексту.

- Якщо код містить помилку — модель бачить traceback і може автоматично запропонувати виправлення в наступній ітерації (self-correction).

- Chaining кількох інструментів (ланцюжки дій):

- Модель може в одному циклі повернути кілька tool_calls (multi-tool parallel execution, якщо інструменти незалежні).

- Послідовний chaining: результат одного інструменту стає входом для наступного (наприклад, пошук → парсинг → аналіз → візуалізація → генерація звіту).

- Підтримка складних ланцюжків через preserved thinking — модель пам’ятає попередні кроки та роздуми між викликами.

- Self-correction та ітеративне коригування:

- Після кожного виконання інструменту (включаючи код) результат додається в контекст як нове повідомлення role: "tool".

- Модель аналізує output/error та коригує план/код у наступному кроці (завдяки thinking mode та RL-етапу Slime).

- Цикл повторюється, доки модель не вирішить, що мета досягнута (termination condition — зазвичай на основі промпту або вбудованої логіки).

Документація tool-calling та виконання функцій |

Опис agentic engineering та code execution в GLM-5

Приклад повного циклу з виконанням коду

Запит користувача: "Проаналізуй цей CSV-файл з продажами і побудуй графік тренду, збережи в .xlsx з поясненнями."

- Модель планує: 1) прочитати CSV, 2) проаналізувати дані, 3) побудувати графік, 4) створити звіт, 5) зберегти файл.

- Виклик інструменту "read_file" або "execute_python" для завантаження та парсингу CSV.

- Отримання даних → генерація коду для pandas/matplotlib аналізу та графіка.

- Виконання коду в sandbox → отримання результату (графік як base64 або опис, якщо помилка — traceback).

- Якщо помилка (наприклад, неправильний формат дати) — модель бачить traceback і генерує виправлений код.

- Повторний запуск → успішне виконання → виклик інструменту "create_xlsx" з даними та графіком.

- Фінальний deliverable: посилання на згенерований .xlsx файл з аркушами аналізу, графіками та поясненнями.

Обмеження та особливості виконання коду

- Sandbox обмежує: немає доступу до мережі (крім дозволених API), файлової системи хоста, системних викликів. Максимальний час виконання — кілька секунд.

- Модель може генерувати небезпечний код — але sandbox блокує його виконання (наприклад, os.system, import requests поза дозволом).

- Chaining збільшує latency: кожен крок — окремий inference + виконання → загальний час може сягати 30–120+ секунд на складний workflow.

- Self-correction не завжди ідеальний — іноді модель зациклюється або робить неправильні припущення про помилку.

Висновок: Agent-режим Z.ai дозволяє не тільки генерувати код, але й виконувати його в sandbox, будувати цепочки дій з кількома інструментами та ітерувати з self-correction на основі реальних результатів виконання, що робить його суттєво потужнішим за звичайний chat-режим у задачах, що вимагають практичного результату.

Відмінність від звичайного chat-режиму

Chat-режим реалізує одноразовий inference без зовнішніх інструментів та ітерацій — модель генерує відповідь за один прохід. Agent-режим працює в ітеративному циклі з автономним плануванням, викликом інструментів, аналізом результатів, самокорекцією та генерацією кінцевих артефактів.

Основна відмінність — в наявності execution loop та можливості переходу від генерації тексту до реального виконання багатоступеневих завдань.

Chat-режим — реактивний інтерфейс для швидкої генерації, Agent-режим — проактивна система з автономним циклом observe-think-act, що дозволяє моделі виконувати завдання без постійного втручання користувача.

Детальне порівняння двох режимів (на базі GLM-5 у Z.ai, 2026 рік):

| Аспект | Chat-режим | Agent-режим | Коментар / Наслідки |

|---|

| Мета та тип задачі | Швидка генерація відповіді, пояснення, текст/код | Повне виконання завдання з кінцевим результатом | Chat — для консультацій та прототипування, Agent — для production-автоматизації |

| Tool-calling / функції | Відсутній (може тільки описати інструмент текстом) | Автономний: модель самостійно вирішує, коли та який інструмент викликати | Agent може використовувати пошук, калькулятор, код-виконання, генерацію файлів тощо |

| Цикл обробки | Один прохід: запит → decode → відповідь | Multi-turn ітеративний цикл: observe → think → act → execute → repeat | Agent може виконувати 5–50+ ітерацій без втручання користувача |

| Output / результат | Текст або код у полі content | Кінцеві артефакти: .docx/.pdf/.xlsx, сайти, звіти, виконані скрипти | Chat дає опис, Agent — готовий продукт |

| Self-correction / перевірка | Відсутня (коригування тільки новим запитом) | Так: модель аналізує помилки виконання та коригує план/код | Agent здатен виправляти власні помилки в коді чи логіці |

| Latency на типовий запит | 0.5–3 секунди (перша відповідь) | 5–60+ секунд на повний цикл (залежить від кількості ітерацій) | Chat — для real-time, Agent — для batch-задач |

| Витрата токенів | Низька (один запит = одна генерація) | Висока (thinking + multi-turn + tool results) | Agent може споживати 3–10× більше токенів на завдання |

| Управління контекстом | Повна історія в messages (клієнт керує) | Автоматичне збереження дій, спостережень та роздумів (preserved thinking) | Agent ефективніше зберігає агентний стан між кроками |

| Найкращі сценарії | RAG, чат-боти, швидкий код/текст, brainstorm | Автономна автоматизація, full-cycle розробка, enterprise-документи | Chat — швидкість + простота, Agent — автономність + deliverables |

Коли переходити від Chat до Agent-режиму

Перехід виправданий, коли задача:

- Вимагає кількох кроків (пошук → аналіз → звіт)

- Потрібен запуск коду або зовнішніх інструментів

- Необхідна самокорекція чи перевірка результатів

- Очікується кінцевий артефакт (.docx, .xlsx тощо)

Якщо достатньо одноразової відповіді або швидкого пояснення — chat-режим ефективніший за швидкістю, витратою токенів та простотою реалізації.

Agent-режим у Z.ai забезпечує якісно вищий рівень автономності порівняно з chat-режимом завдяки ітеративному циклу, автономному tool-calling, self-correction та генерації кінцевих артефактів, що робить його придатним для виконання складних багатоступеневих завдань.

Приклад workflow (пошук → аналіз → генерація)

Типовий workflow в Agent-режимі Z.ai — це ітеративний цикл: користувач ставить мету → модель створює план → виконує послідовні або паралельні дії (tool-calling) → аналізує результати → коригує план при необхідності → видає кінцевий артефакт (файл, звіт, сайт тощо).

Процес повністю автономний: модель сама вирішує, які інструменти викликати, як обробляти помилки та коли завершити виконання.

Agent-режим реалізує повний цикл від формулювання завдання до отримання готового результату, включаючи самокорекцію та генерацію кінцевих файлів, що відрізняє його від простої генерації тексту в chat-режимі.

Детальний приклад реального workflow в Agent-режимі Z.ai (на базі GLM-5, веб-інтерфейс або API):

- Вхідний запит користувача:

"Зроби аналіз ринку електромобілів у 2026 році: ключові гравці, обсяги продажів, тренди зростання, топ-5 моделей за популярністю. Збери дані з відкритих джерел, побудуй таблиці та графіки, збережи все в .xlsx + .pdf звіт з висновками."

- Модель генерує внутрішній план (thinking mode):

preserved thinking: "Завдання вимагає: 1) актуальних даних за 2026 рік → потрібно використовувати веб-пошук; 2) аналізу та агрегації → виклик інструменту для парсингу та розрахунків; 3) візуалізації → генерація графіків через код; 4) збереження результатів → створення документів. План: пошук → витяг даних → аналіз → код для таблиць/графіків → створення файлів."

- Перший крок — виклик інструменту пошуку:

Модель формує tool_call: search_web з query "electric vehicle market 2026 sales volume top manufacturers trends".

Сервер виконує пошук → повертає топ-результати (статті, звіти, таблиці) як observation.

- Аналіз отриманих даних:

Модель обробляє observation → витягує ключові цифри (Tesla 38%, BYD 22%, VW 12% тощо), агрегує дані. Якщо даних недостатньо — генерує додатковий пошук.

- Генерація та виконання коду для аналізу:

Модель створює Python-код (pandas для обробки, matplotlib для графіків) → викликає execute_python_code.

Виконання в sandbox → отримує результат (таблиця + base64 графіків або опис помилки).

- Self-correction при помилці:

Якщо код падає (наприклад, неправильний формат дати) — модель бачить traceback → генерує виправлений код → повторний виклик execute_python_code.

- Генерація кінцевих артефактів:

Після успішного виконання — виклик вбудованого інструменту create_xlsx з даними таблиць та графіками.

Додатково — create_pdf з текстовими висновками, таблицями та вбудованими зображеннями графіків.

- Завершення та deliverable:

Модель перевіряє: чи всі пункти завдання виконані? Якщо так — повертає посилання на згенеровані файли (.xlsx + .pdf) та короткий текстовий огляд. Якщо ні — продовжує ітерацію.

Варіації workflow в залежності від складності

Простий workflow (2–4 кроки): пошук → короткий аналіз → текстовий звіт

Середній workflow (5–10 кроків): пошук → парсинг → код-аналіз → графіки → документ

Складний workflow (15+ кроків): multi-source пошук → кілька ітерацій аналізу → код-генерація → тестування → рефакторинг → фінальний пакет файлів

У веб-інтерфейсі Z.ai Agent-режим автоматично показує прогрес: "Планую...", "Виконую пошук...", "Генерую код...", "Створюю звіт...", з можливістю перервати або уточнити на будь-якому кроці.

Висновок: Agent-режим Z.ai виконує повний автономний цикл від формулювання запиту до видачі готових файлів чи результатів, включаючи планування, пошук даних, виконання коду, self-correction та генерацію артефактів, що робить його придатним для реальних виробничих завдань автоматизації.

Обмеження та latency

Agent-режим : характеризується суттєво вищим latency через multi-turn ітерації та виклики інструментів, обмеженою concurrency (часто 1 паралельний запит навіть на платних планах під піковим навантаженням), підвищеною витратою токенів (thinking mode + tool results + ітерації), а також ризиком over-calling інструментів та зациклення в складних циклах.

Ці обмеження роблять режим менш придатним для real-time взаємодії та вимагають ретельного управління промптами та очікуваннями.

Agent-режим забезпечує автономність та виконання складних завдань, але ціна — значно вищі затримки, витрати токенів та операційні ризики порівняно з прямим chat-режимом.

Детальний розбір основних обмежень Agent-режиму в Z.ai (GLM-5, 2026):

- Latency та час виконання:

- Повний цикл (від запиту до фінального deliverable) — від 5–10 секунд на прості завдання до 30–120+ секунд на складні workflows з 5–15 ітераціями.

- Перший крок (планування + перший tool-call) — 2–6 секунд (thinking mode + генерація tool_calls).

- Кожен наступний крок — додаткові 2–10 секунд (виконання інструменту + новий inference + аналіз результату).

- Порівняння: chat-режим — перша відповідь за 0.5–3 секунди; Agent-режим — в середньому 5–10× повільніше через ітерації.

- Concurrency та пікові обмеження:

- На пікових навантаженнях (особливо після релізу GLM-5) — жорстке обмеження до 1 паралельного запиту навіть на Pro/Max планах GLM Coding Plan.

- Помилка "Too much concurrency" при спробі запустити кілька агентів одночасно.

- Повільний rollout моделі після релізу (спочатку тільки Max-план, потім Pro з обмеженнями, Lite — з затримкою).

- Наслідок: непридатно для високонавантажених production-систем з десятками паралельних агентів без власного self-hosting.

- Витрата токенів та вартість:

- Thinking mode + multi-turn ітерації + результати інструментів збільшують витрату в 2–5 разів порівняно з chat-режимом на аналогічне завдання.

- Приклад: простий аналіз даних → 3–5 ітерацій → 5–15K токенів замість 1–2K у chat-режимі.

- На API-ціні $1 input / $3.2 output це все ще дешевше конкурентів, але на довгих сесіях різниця стає суттєвою.

- GLM Coding Plan: вищі квоти, але GLM-5 споживає 2–3× більше квоти, ніж GLM-4.7 → низькі плани ($7–15/міс) швидко вичерпуються.

- Ризики та помилки поведінки:

- Over-calling інструментів — модель викликає інструменти зайвий раз (особливо при неточних описах функцій у tools).

- Зациклення — рідко, але трапляється: модель повторює неефективні дії без правильного termination condition.

- Неправильний аналіз помилок — модель іноді неправильно інтерпретує traceback або observation, що призводить до некоректних виправлень.

- Обмежена ситуаційна обізнаність — в неоднозначних завданнях може генерувати нереалістичні плани або ігнорувати обмеження sandbox.

Практичні наслідки та способи мінімізації обмежень

Наслідки:

- Непридатно для real-time чатів або інтерактивних застосунків з вимогою <5 с відповіді.

- Висока вартість на довгих або складних завданнях (особливо з великим thinking).

- Обмежена масштабованість під високим навантаженням без self-hosting або кількох API-ключів.

Мінімізація:

- Оптимізовані промпти з чіткими termination conditions ("заверши після створення файлу")

- Обмеження max_iterations у клієнтському циклі (для API-реалізації)

- Використання context caching для повторюваних префіксів

- Перехід на self-hosting GLM-5 для зняття обмежень concurrency (але вимагає enterprise-кластерів)

- Комбінований підхід: chat-режим для швидкого прототипування → Agent для фінального виконання

Висновок: Agent-режим у Z.ai потужний для автономного виконання складних завдань, але супроводжується суттєво вищим latency, витратою токенів, обмеженнями concurrency та ризиками поведінкових помилок. Це вимагає толерантності до затримок та ретельного управління промптами, особливо в production-сценаріях.

❓ Часті питання (FAQ)

Чи можна використовувати Agent-режим через API?

Так, Agent-режим повністю доступний через API Z.ai. Реалізується за допомогою стандартного ендпоінта /v4/chat/completions з увімкненими параметрами tool-calling (tools + tool_choice), thinking mode (thinking: {"type": "enabled"}), та tool_stream=true для потокової передачі параметрів інструментів. Клієнт самостійно обробляє tool_calls, виконує функції та повертає результати в наступному запиті. Веб-інтерфейс chat.z.ai має додаткові вбудовані skills (наприклад, створення документів), які викликаються автоматично, але в API їх потрібно описувати в tools або використовувати спеціалізовані ендпоінти (наприклад, /coding/paas/v4).

Яка швидкість роботи Agent-режиму?

Швидкість залежить від складності завдання та кількості ітерацій: повний цикл виконання (від запиту до фінального deliverable) займає від 5–10 секунд на прості завдання до 30–120+ секунд на складні workflows з 5–15+ кроками (multi-turn + tool calls + thinking). Перший крок (планування + перший виклик) — зазвичай 2–6 секунд. Кожна наступна ітерація додає 2–10 секунд (виконання інструменту + новий inference). Порівняно з chat-режимом (0.5–3 секунди на відповідь) Agent-режим суттєво повільніший через ітеративну природу.

Чи є обмеження на кількість tool calls?

Жорсткого фіксованого ліміту на кількість tool calls у рамках одного завдання немає — модель може виконувати десятки ітерацій та викликів, доки не досягне мети або не вичерпається контекст/квота. Однак на практиці обмеження виникають через:

- Throttling та concurrency: на пікових навантаженнях навіть платні плани обмежують до 1 паралельного запиту, що зупиняє кілька агентів одночасно.

- Витрату токенів: кожен виклик + thinking + observation збільшує споживання, що швидко вичерпує квоти на низьких планах.

- Ризик over-calling: модель іноді генерує зайві виклики — рекомендовано чіткі описи інструментів та termination conditions у промпті ("заверши після створення файлу").

Для контролю рекомендується реалізовувати max_iterations на клієнтській стороні.

Чи підтримує Agent-режим self-correction та як це працює?

Так, self-correction — одна з ключових можливостей Agent-режиму. Після кожного виконання інструменту (включаючи код) результат (output або помилка) повертається в контекст як нове повідомлення role: "tool". Модель аналізує його в наступному кроці (з preserved thinking) і може:

- Розпізнати помилку (наприклад, traceback у коді)

- Згенерувати виправлення або альтернативний план

- Повторити виклик з оновленими параметрами

Це реалізовано завдяки RL-етапу тренування (Slime framework) та thinking mode, але не завжди ідеально — іноді модель неправильно інтерпретує помилку або зациклюється. Ефективність залежить від якості промпту та описів інструментів.

Чи можна перервати або уточнити завдання під час виконання в Agent-режимі?

У веб-інтерфейсі chat.z.ai — так: користувач бачить прогрес ("Планую...", "Виконую пошук...", "Генерую код...") і може перервати виконання або надіслати уточнення в будь-який момент (модель інтегрує нове повідомлення в поточний цикл). В API-реалізації перерва можлива тільки на рівні клієнта — зупинити цикл або надіслати нове повідомлення в наступному запиті. Модель не має вбудованої паузи, але підтримує уточнення через додаткові user-повідомлення в multi-turn сесії.

✅ Висновки

- 🔹 Agent-режим Z.ai — це повноцінна реалізація агентної архітектури на базі GLM-5, що включає автономний цикл планування, tool-calling, виконання дій та обробку результатів без постійного втручання користувача.

- 🔹 Основні функціональні можливості: chaining кількох інструментів, self-correction на основі спостережень, ітеративне коригування плану, генерація кінцевих артефактів (.docx, .pdf, .xlsx, звіти, сайти) та підтримка long-horizon завдань з десятками кроків.

- 🔹 Технічні переваги: OpenAI-сумісний tool-calling з tool_stream та preserved thinking, вбудовані skills у веб-інтерфейсі, sandbox-виконання коду, ефективна робота з 200K контекстом завдяки DSA.

- 🔹 Обмеження режиму: суттєво вищий latency (5–120+ секунд на повний цикл через ітерації), підвищена витрата токенів (thinking + multi-turn + tool results), обмежена concurrency (часто 1 запит на піках), ризики over-calling інструментів, зациклення та неідеальної самокорекції в неоднозначних сценаріях.

- 🔹 Найкращі сценарії застосування: автономна автоматизація складних завдань (full-cycle code dev, аналіз даних → звіт, генерація документів з сирих даних, multi-tool workflows), де chat-режим виявляється недостатнім через відсутність ітеративності та deliverables.

Головна думка: Agent-режим Z.ai забезпечує перехід від реактивної генерації тексту до проактивного виконання багатоступеневих завдань з кінцевими результатами, але вимагає компромісів у швидкості, витратах та стабільності поведінки. Використовуйте його для сценаріїв, де автономність та deliverables важливіші за мінімальну затримку.

Детальний огляд режиму Chat: Режим /chat в Z.ai — як працює та коли використовувати

Повний аналіз платформи Z.ai (Chat vs Agent, архітектура GLM-5): Z.ai 2026: архітектура, режими Chat vs Agent та можливості GLM-5