· Оновлюється щоквартально

Є питання, яке рано чи пізно ставить кожен, хто серйозно займається присутністю у Perplexity: чому система регулярно цитує відносно маловідомий нішевий блог і при цьому ігнорує матеріал Forbes на ту саму тему? Відповідь не очевидна, якщо дивитися на це через призму класичного SEO. Але вона стає зрозумілою, якщо подивитися на реальні патерни видачі.

Для цієї статті ми протестували 15 запитів у кількох нішах — SEO, веб-розробка, AI-інструменти — і задокументували структурні характеристики сторінок, які потрапили у відповіді. Результати виявилися більш передбачуваними, ніж здається на перший погляд.

У цій статті:

- Патерни реальної видачі: що показав аналіз 15 запитів

- Чому нішеві матеріали виграють у великих брендів

- Q&A-форматування як структурний сигнал

- Різниця логіки: Google ранжує авторитет, Perplexity шукає відповідь

- Практичний чекліст: ознаки сторінки яку цитує Perplexity

Патерни реальної видачі: що показав аналіз 15 запитів

Ми протестували 15 запитів у Perplexity у трьох категоріях: технічні SEO-питання ("як налаштувати robots.txt для AI-краулерів"), питання про AI-інструменти ("що таке RAG у пошуку") і порівняльні запити ("різниця між PerplexityBot і Googlebot"). По кожному запиту зафіксували перші три джерела у відповіді та проаналізували їхні структурні характеристики.

Результати склалися у чотири стійких патерни.

Патерн 1: Нішеві джерела домінують над загальними медіа. У 11 із 15 запитів серед трьох цитованих джерел не було жодного великого загального медіа — CNN, Forbes, TechCrunch, Wired. Натомість регулярно з'являлися: офіційна документація (docs.perplexity.ai, developers.google.com), галузеві дослідницькі блоги (Ahrefs, Semrush, Search Engine Land), академічні джерела (arXiv, PMC), нішеві технічні блоги з конкретними детальними матеріалами. Великі медіа з'являлися переважно для новинних або загальних запитів — але програвали нішевим джерелам щойно запит ставав специфічним.

Патерн 2: Офіційна документація має системну перевагу. Для будь-якого запиту, де є офіційна документація продукту або стандарту, вона майже завжди потрапляє у відповідь. docs.perplexity.ai, developers.google.com, schema.org, sitemaps.org — ці джерела з'являлися у відповідях навіть тоді, коли запит прямо не вказував на них. Причина логічна: офіційна документація є найбільш авторитетним і точним першоджерелом для конкретних технічних питань — і RAG-система це враховує.

Патерн 3: Статті з явною Q&A-структурою цитуються частіше. Порівнюючи сторінки-джерела, ми зафіксували: матеріали з заголовками у форматі питань (H2: "Як перевірити чи індексує Perplexity мій сайт?") і явними відповідями безпосередньо після заголовку цитувалися значно частіше, ніж матеріали з описовими заголовками ("Перевірка індексації"). При цьому загальна якість і глибина матеріалів були порівнянними.

Патерн 4: Конкретні числові дані є майже обов'язковими. Серед 45 проаналізованих цитованих сторінок (15 запитів × 3 джерела) 41 містила конкретні числові дані у процитованому фрагменті — відсотки, дати, кількісні порівняння. Лише 4 сторінки цитувалися без числових даних, і всі вони були офіційною документацією або академічними першоджерелами визначень. Для звичайних контентних сторінок наявність конкретних цифр є практично обов'язковою умовою цитування.

Чому нішеві матеріали виграють у великих брендів

Це найбільш несподіваний і водночас найбільш практично важливий висновок аналізу. Perplexity систематично надає перевагу глибоким нішевим матеріалам над поверхневими матеріалами великих брендів — і розуміння причини відкриває конкретну стратегічну можливість для власників невеликих сайтів.

Чому великі медіа програють нішевим джерелам

Великі медіа — Forbes, CNN, TechCrunch — публікують матеріали для широкої аудиторії. Стаття про "що таке SEO" на Forbes охоплює тему поверхово, без технічних деталей, щоб бути зрозумілою для неспеціаліста. Це раціонально з точки зору охоплення аудиторії — але катастрофічно з точки зору фрагментабельності для специфічних запитів.

Конкретний приклад із нашого аналізу: за запитом "як налаштувати Crawl-delay для PerplexityBot" Perplexity процитував нішевий технічний блог із ~5 000 унікальних відвідувачів на місяць — а не Search Engine Journal або Search Engine Land, які мають мільйони читачів. Причина: нішевий матеріал містив конкретний абзац із точним поясненням синтаксису директиви і застереженням про відмінність від Googlebot. Матеріали великих медіа на тему robots.txt були більш загальними і не містили цієї конкретики.

Нішевий технічний блог, який пише для SEO-спеціалістів, публікує матеріал про "що таке crawl budget і як ним керувати" із конкретними числами, посиланнями на офіційну документацію і чіткою структурою питання-відповідь. Кожен абзац такого матеріалу є самодостатньою відповіддю на конкретне технічне питання. Для RAG-системи такий матеріал є значно кращим джерелом, ніж поверхнева стаття Forbes із тисячами зворотних посилань.

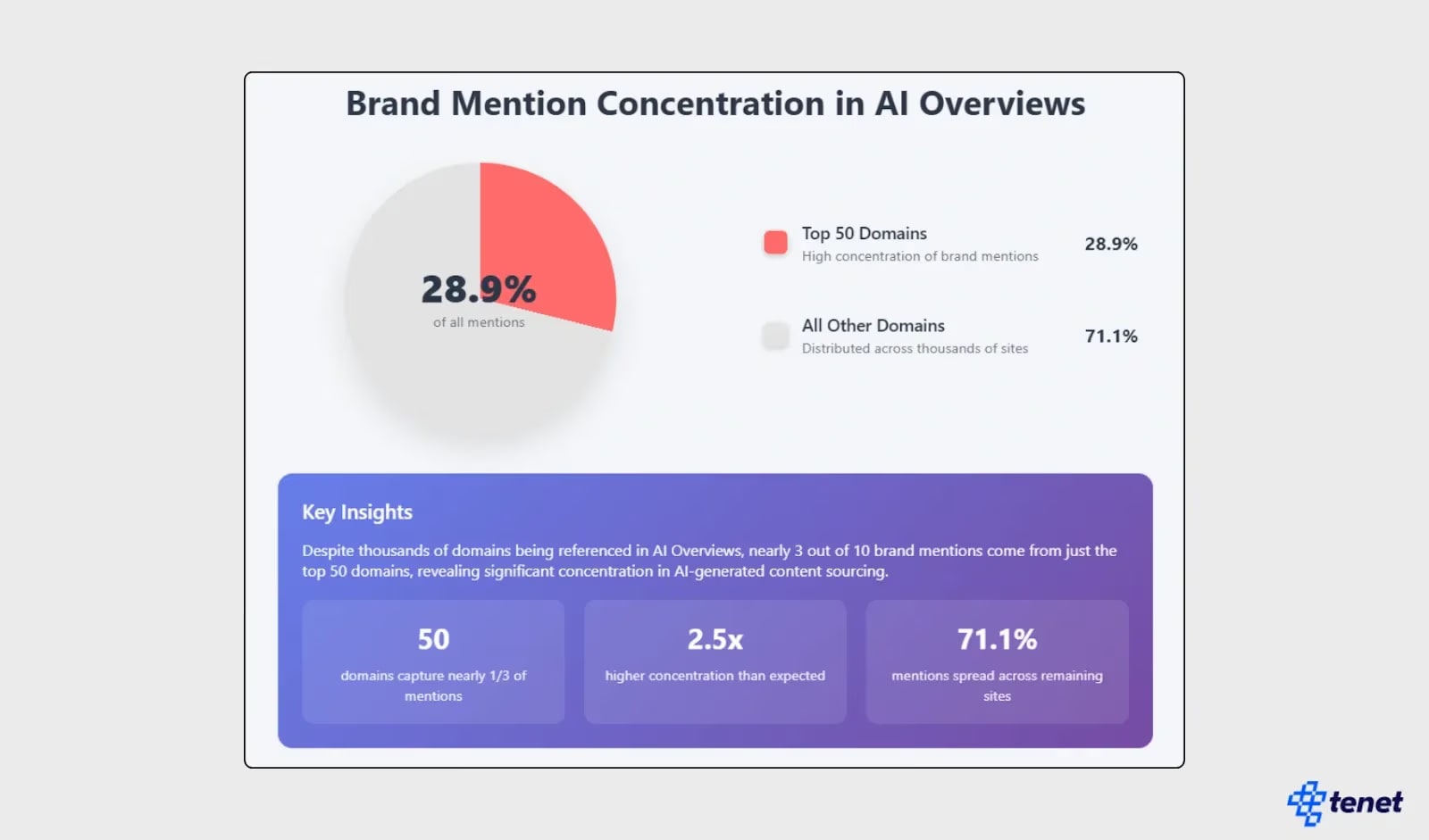

Що підтверджують дані

За даними дослідження Ahrefs з LLM-оптимізації, сайти які включають цитати, статистику і посилання на першоджерела отримують 30–40% приріст видимості в AI-відповідях порівняно з аналогічним контентом без цих елементів. Дослідники також зафіксували: органічні позиції в Google корелюють із присутністю в LLM-відповідях із коефіцієнтом ~0.65 — але вплив кількості зворотних посилань є "дивовижно нейтральним". Тобто посилальний профіль, який є ключовим у Google, майже не впливає на присутність у Perplexity.

За даними Conductor (2025), що проаналізував 3.3 мільярди сесій і 100 мільйонів AI-цитувань, структура топових джерел у відповідях Perplexity є показовою: у YMYL-категоріях (здоров'я, фінанси) AI цитує авторитетні спеціалізовані джерела — Mayo Clinic, Cleveland Clinic, NerdWallet, Bankrate — а не загальні новинні медіа. У технічних і B2B категоріях домінують галузеві гіганти і профільні видання — Google, Microsoft, Deloitte, McKinsey — не CNN або TechCrunch. Патерн однозначний: Perplexity обирає найбільш точне джерело для конкретної ніші, а не найпопулярніший загальний бренд.

Механіка переваги: чому RAG-логіка сприяє нішевим джерелам

Причина не в упередженості системи на користь малих сайтів — причина в механіці RAG. Перplexity шукає фрагмент, який є найточнішою і найконкретнішою відповіддю на запит. Нішеві джерела виграють цю конкуренцію за трьома факторами.

Глибина у вузькій темі. Нішевий автор, який пише виключно про технічне SEO або виключно про AI-краулери, накопичує рівень деталізації, недосяжний для генерального медіа. Стаття "PerplexityBot vs Googlebot: технічне порівняння" на нішевому SEO-блозі містить конкретні числа, посилання на офіційну документацію і порівняльну таблицю з 20 параметрів. Матеріал Forbes на тему "AI і SEO" охоплює широкий контекст, але не містить жодної з цих специфічних деталей. RAG-система, отримавши запит про конкретний технічний параметр, вибере нішевий матеріал.

Фрагментабельна структура. Нішеві технічні матеріали часто мають кращу структуру для RAG-витягування — не через спеціальну оптимізацію, а через характер жанру: технічна документація, step-by-step інструкції, порівняльні таблиці природно організовані у самодостатні блоки. Нарративний стиль великих медіа (де кожен абзац залежить від попереднього) є менш "RAG-дружнім".

Актуальні дані. Нішеві блоги часто публікують більш оперативні оновлення за конкретними змінами у своїй галузі, ніж великі редакції, де кожна публікація проходить довгий редакційний цикл. Свіжість є значущим фактором для Perplexity — і нішеві сайти часто мають перевагу саме у "вікні свіжості" перших 24–48 годин після значущої події у галузі.

Практичні висновки: як використати цю перевагу

Для власників нішевих сайтів ця динаміка відкриває конкретну стратегічну можливість, якої немає в Google. У Google конкуренція з Forbes або TechCrunch за позиції вимагає порівнянного посилального профілю — що для більшості нішевих сайтів є недосяжним у короткостроковій перспективі. У Perplexity конкуренція відбувається на рівні якості конкретного абзацу — і тут нішевий сайт із правильною структурою контенту може перемогти вже зараз.

Є важливе застереження: "нішевий і глибокий" не означає "довгий і складний". Матеріали, які цитує Perplexity, є глибокими у розумінні точності і конкретності — не у розумінні обсягу. Стаття на 800 слів із п'ятьма конкретними верифікованими фактами і чіткою Q&A-структурою цитується частіше, ніж лонгрід на 5000 слів у нарративному стилі. Ціль — максимальна щільність корисної інформації на один абзац, а не максимальний обсяг статті.

Практична рекомендація: визначте 5–10 найбільш специфічних питань у вашій ніші, на які великі медіа дають поверхневі відповіді — і напишіть матеріали, де кожне з цих питань отримує конкретну, верифіковану, самодостатню відповідь у окремому блоці. Це і є конкурентна перевага нішевого сайту у Perplexity.

Q&A-форматування як структурний сигнал

Серед усіх структурних характеристик проаналізованих сторінок Q&A-форматування показало найбільш стійкий кореляційний зв'язок із цитуванням. Це не випадково — воно прямо відповідає архітектурній логіці RAG-системи: система шукає відповіді на питання, і контент, організований у форматі питання-відповідь, є найбільш прямим матчем для цього пошуку.

Чому Q&A-структура є природним форматом для RAG

Коли користувач ставить питання в Perplexity, система виконує векторний пошук і шукає фрагменти, семантично близькі до цього питання. Сторінка із заголовком H3 "Як PerplexityBot верифікувати?" і відповіддю безпосередньо після заголовку є ідеальним матчем — заголовок описує питання, перше речення після нього є прямою відповіддю, і весь блок є самодостатнім фрагментом. Система не просто знаходить цей блок — вона ідентифікує його як прямий матч між питанням у запиті і питанням у заголовку.

Порівняйте із звичайним розділом із заголовком "Верифікація PerplexityBot": той самий контент, але заголовок описує тему, а не питання. Векторний score цих двох фрагментів буде близьким — але на рівні reranking питальний заголовок із прямою відповіддю у першому реченні має перевагу: він є більш самодостатнім і більш точно відповідає на запит.

Що показав контрольований експеримент Search Engine Land

Контрольований експеримент Search Engine Land (Nogami і Tannenbaum, 2025) надає найбільш чисті дані про вплив schema.org розмітки на AI-видачу. Дослідники створили три майже ідентичні сторінки: з якісною schema-розміткою (включаючи FAQPage), з помилковою розміткою і без розмітки взагалі. Ключовий результат: лише сторінка з якісною schema-розміткою з'явилася в AI Overview — незважаючи на те, що сторінка з помилковою розміткою ранжувалася вище в органічному пошуку (позиція 8 vs позиція 3). Сторінка без розмітки взагалі не була проіндексована.

Важливий висновок для практики: не просто наявність FAQPage розмітки, а її якість і повнота мають значення. Сторінка з помилковою розміткою (відсутні обов'язкові поля, неправильні формати дат, відсутня FAQ-розмітка попри наявність Q&A-контенту) не отримала AI-видачу — попри те, що ранжувалася краще органічно. Наявність Q&A-контенту без відповідної розмітки є упущеною можливістю.

Числові дані: скільки дає FAQPage розмітка

Кілька незалежних досліджень вимірювали вплив FAQPage schema на AI-цитування, і результати є узгодженими. За даними дослідження Relixir (2025), що аналізувало 50 B2B і e-commerce доменів, оновлення schema-розмітки дало медіанний приріст AI-цитувань на 22% — при цьому FAQPage показала найвищий результат серед усіх типів розмітки (+28%). За даними BrightEdge, сайти з FAQPage і HowTo розміткою отримують 44% більше AI-цитувань порівняно з аналогічним контентом без розмітки. За даними Frase (2025), сторінки з FAQPage розміткою є у 3.2 рази більш вірогідними до появи в Google AI Overviews порівняно зі сторінками без неї.

Важливий контекст до цих цифр: тільки 0.6% веб-сторінок мають FAQPage розмітку (дані HTTP Archive Web Almanac 2024). При такому низькому рівні впровадження сторінки з коректною розміткою конкурують між собою, а не з більшістю веб-контенту. Це означає, що впровадження FAQPage розмітки сьогодні є конкурентною перевагою першого рівня — і ця перевага буде зменшуватися в міру зростання впровадження.

Оптимальна довжина відповіді у FAQ-блоці

Q&A-форматування приносить максимальний ефект тільки при правильному обсязі відповіді. За аналізом Frase, оптимальна довжина відповіді у FAQ-блоці для AI-цитування — від 30 до 80 слів. Відповіді коротші за 30 слів мають недостатньо контексту, щоб бути самодостатньою відповіддю на складне питання. Відповіді довші за 80 слів стають важчими для витягування як єдиного фрагмента і важчими для сканування. Зона 40–60 слів є практичним орієнтиром: достатньо для повної відповіді, достатньо компактно для ефективного витягування.

Слабка відповідь: "FAQ schema є дуже важливим для AI-пошуку." Сильна відповідь: "FAQPage schema збільшує частоту AI-цитувань на 22–44% (дані Relixir і BrightEdge, 2025). Розмітка явно структурує контент як пари питання-відповідь, що є ідеальним форматом для RAG-системи, яка шукає самодостатні відповіді на конкретні запитання." Різниця очевидна: друга відповідь містить конкретні числа з джерелами і пояснює механіку — тобто є самодостатньою і верифікованою.

Гібридна структура: як поєднати нарратив і Q&A

Важливий нюанс: Q&A-форматування не означає, що вся стаття має бути у форматі FAQ. Ефективніший підхід — гібридна структура з трьох компонентів. Перший: основний текст у звичайному форматі з H2/H3-заголовками, сформульованими як питання або чіткі твердження — це дає контекст і глибину для читача. Другий: кожен H3-блок починається з прямої відповіді у першому реченні, решта — деталізація і докази. Третій: окрема FAQ-секція наприкінці статті з schema.org FAQPage розміткою для 4–6 найпоширеніших запитань за темою — це дає системі явно структуровані фрагменти з максимальним RAG-score.

Така структура дає системі фрагменти трьох різних типів: структурний контекст із H2/H3-блоків, конкретні факти з першого речення кожного блоку, і явні Q&A пари з FAQ-секції. Різні запити матчаться з різними типами фрагментів — і в сумі сторінка покриває значно ширший спектр потенційних запитів, ніж суто нарративний або суто FAQ-матеріал.

Відповідь у першому реченні: патерн із нашого аналізу

Ще один стійкий патерн із аналізу 15 запитів: сторінки, де відповідь на питання міститься вже у першому реченні після заголовку, цитувалися частіше, ніж сторінки, де відповідь з'являлася після кількох речень вступного контексту. Це прямо відповідає логіці reranking: фрагмент, де головна інформація стоїть на початку, має вищу інформаційну щільність і краще проходить другий рівень відбору. Фрагмент, де відповідь прихована за трьома реченнями вступу, передає менше корисної інформації на перші 50–80 токенів — а саме ці токени є найважливішими для reranker-оцінки.

Практичне правило: після кожного H3-заголовку, сформульованого як питання, перше речення має бути прямою відповіддю. Не "це питання є дуже важливим", не "існує кілька підходів" — а пряма відповідь із конкретним фактом. Решта абзацу — деталізація, пояснення механіки, докази.