У 2026 році RAG — це вже не «пошук по документах для LLM», а Knowledge Runtime: середовище виконання знань з чіткими шарами інженерії даних, retrieval, оцінки та governance. Наївні реалізації (фіксовані чанки + cosine top-k) не проходять перевірку навантаженням і якістю — production вимагає системного підходу.

Спойлер: У більшості enterprise-сценаріїв advanced RAG (semantic chunking + hybrid search + reranking + observability) перевершує чисті long-context моделі за recall, latency та TCO, але вимагає серйозної роботи з даними та оцінкою — інакше система дасть гірший результат, ніж просто промпт без ретривалу.

Коротко

- Ключова думка 1: 60–70% проблем якості RAG сидять у ingestion та retrieval, а не в LLM. Почніть із фундаменту даних.

- Ключова думка 2: Hybrid search + reranking — найшвидший спосіб підняти точність на 15–40% без зміни моделі.

- Ключова думка 3: Без системної оцінки (RAGAS/DeepEval + LLM-as-a-Judge) ви не знаєте, чи покращується система, чи деградує.

- Ключова думка 4: Long-context (1M+ токенів) не вбиває RAG — він стає верхнім шаром у гібридній архітектурі.

- Ви отримаєте: карту компонентів production RAG, матрицю зрілості проекту, навігацію по кластерах глибокого занурення та чіткі trade-off'и кожного архітектурного рішення.

Зміст

Розділ 1. Еволюція RAG: чому наївний підхід більше не працює

Наївний RAG (фіксовані чанки 512–1024 токенів, cosine top-k без reranking) систематично втрачає релевантну інформацію через семантичні розриви, шум у контексті та відсутність query-aware refinement. На реальних enterprise-корпусах це дає recall нижче 60–70% та зростання галлюцинацій — навіть на моделях із контекстом 1M+ токенів.

У 2023–2024 роках наївний RAG був прийнятним для PoC: розбити текст на фрагменти фіксованого розміру, обчислити embeddings, знайти top-k за cosine similarity, вставити в промпт. Це працювало на маленьких чистих корпусах. На enterprise-масштабі (сотні тисяч документів, PDF з таблицями, юридичні та фінансові тексти, дані, що оновлюються) підхід ламається системно. Нижче — чотири конкретні причини, підкріплені бенчмарками.

Чотири причини деградації наївного RAG

1. Семантичні розриви на межах чанків. Фіксований split рве речення, таблиці, логічні блоки. Частина інформації опиняється в одному чанку, частина — в іншому, і жодний з них не є self-contained. Як саме це виглядає: рядок таблиці з фінансовими даними розрізається на два чанки — в першому заголовки колонок, у другому — цифри без контексту. Або юридичний пункт починається в одному чанку, а його винятки та уточнення — в наступному.

Клінічне дослідження PMC Bioengineering (2025) чітко показує масштаб проблеми: дослідники побудували чотири ідентичних RAG-пайплайни на базі Gemini 1.0 Pro, які відрізнялися тільки стратегією chunking (fixed-size baseline, proposition, semantic, adaptive). На 30 постопераційних запитах adaptive chunking дав 87% accuracy (Likert 2.37 ± 0.72) проти 50% у baseline (1.63 ± 0.72, p = 0.001). Retrieval-метрики: adaptive — precision 0.50, recall 0.88, F1 0.64; baseline — precision 0.17, recall 0.40, F1 0.24. Різниця в 74 абсолютних відсотки accuracy — при тій самій моделі, тих самих даних, тому самому промпті. Єдина змінна — як розбиті документи.

Дослідники також виявили, що оптимальні параметри adaptive chunking (cosine similarity ≥ 0.8, ліміт 500 слів, micro-headers для кожного чанка) вимагають ітеративного підбору: порогові значення нижче 0.75 призводили до «topic bleed» (змішування тем), а вище 0.85 — надмірно фрагментували інструкції.

2. Шум у top-k. Cosine similarity без reranking повертає фрагменти, що «виглядають схоже» за embedding-простором, але не відповідають на запит. Нерелевантні чанки витісняють критичну інформацію з контекстного вікна.

ZeroEntropy (2025–2026) наводить конкретний приклад: запит «Apple security issues» при pure BM25 або dense retrieval повертає суміш статей про зберігання фруктів і кібербезпеку Apple — 34% релевантності. Після cross-encoder reranking — 89% релевантності. За даними цього ж дослідження, компанії з hybrid retrieval + reranking повідомляють про зниження використання токенів на 25% (менше шуму в контексті = менше токенів для LLM).

Трьохетапний пайплайн (BM25 → dense → reranker) показує найкращі результати: BM25 повертає ~200 кандидатів за exact match, dense retrieval додає ~100 семантично схожих, reranker обирає фінальні 5–10. Pinecone/Superlinked фіксують 48% покращення якості retrieval при такій архітектурі порівняно з single-method підходом.

3. Відсутність query transformation. Dense retrieval ігнорує точні терміни — ID документів, номери статей, абревіатури, синоніми. Запит «стаття 42 ЗУ про захист персональних даних» може не знайти релевантний чанк, хоча він є в індексі, бо embedding «стаття 42» і embedding тексту самої статті мають недостатню cosine similarity. BM25 знаходить exact match «стаття 42» миттєво — але пропускає семантично пов'язані чанки, де згадується «захист персональних даних» без прямого цитування номера статті.

Hybrid search (dense + BM25 з Reciprocal Rank Fusion) компенсує обидві слабкості. Elasticsearch реалізує це нативно через RRF або linear combination fusion — обидва запити (keyword + vector) виконуються в одному виклику, результати зливаються з нормалізацією скорів. Weaviate Search Mode benchmarks (2025) показують, що hybrid search з query expansion і reranking перевершує best-performing dense-only або BM25-only моделі на 2.6–13.4 пункти nDCG@10 на бенчмарках BEIR, LoTTe та BRIGHT.

4. Позиційний bias у LLM (Lost in the Middle). Відомий ефект: LLM краще використовують інформацію з початку та кінця контексту, ігноруючи середину. При фіксованому top-k без сортування за релевантністю критична інформація може потрапити в «мертву зону». Це не гіпотеза — Stanford TACL (2024) продемонстрував деградацію recall на 25–45% для інформації, розміщеної в середині контекстного вікна, навіть для frontier-моделей.

Reranking з strategic ordering (найрелевантніше — на початок контексту, друге за релевантністю — в кінець) мінімізує цей ефект. Cross-encoder rerank не просто покращує precision — він дозволяє контролювати порядок чанків у контекстному вікні, що критично для faithfulness відповіді.

Що показують бенчмарки 2025–2026

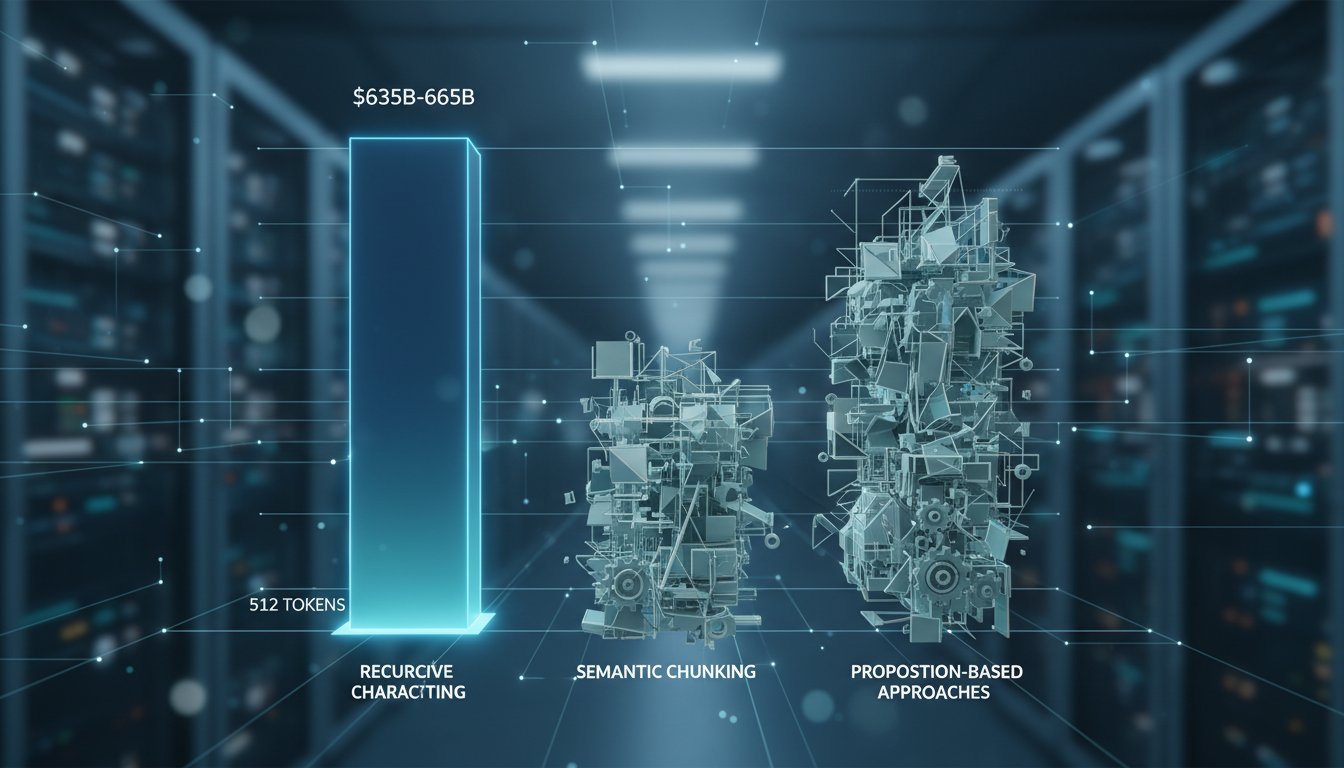

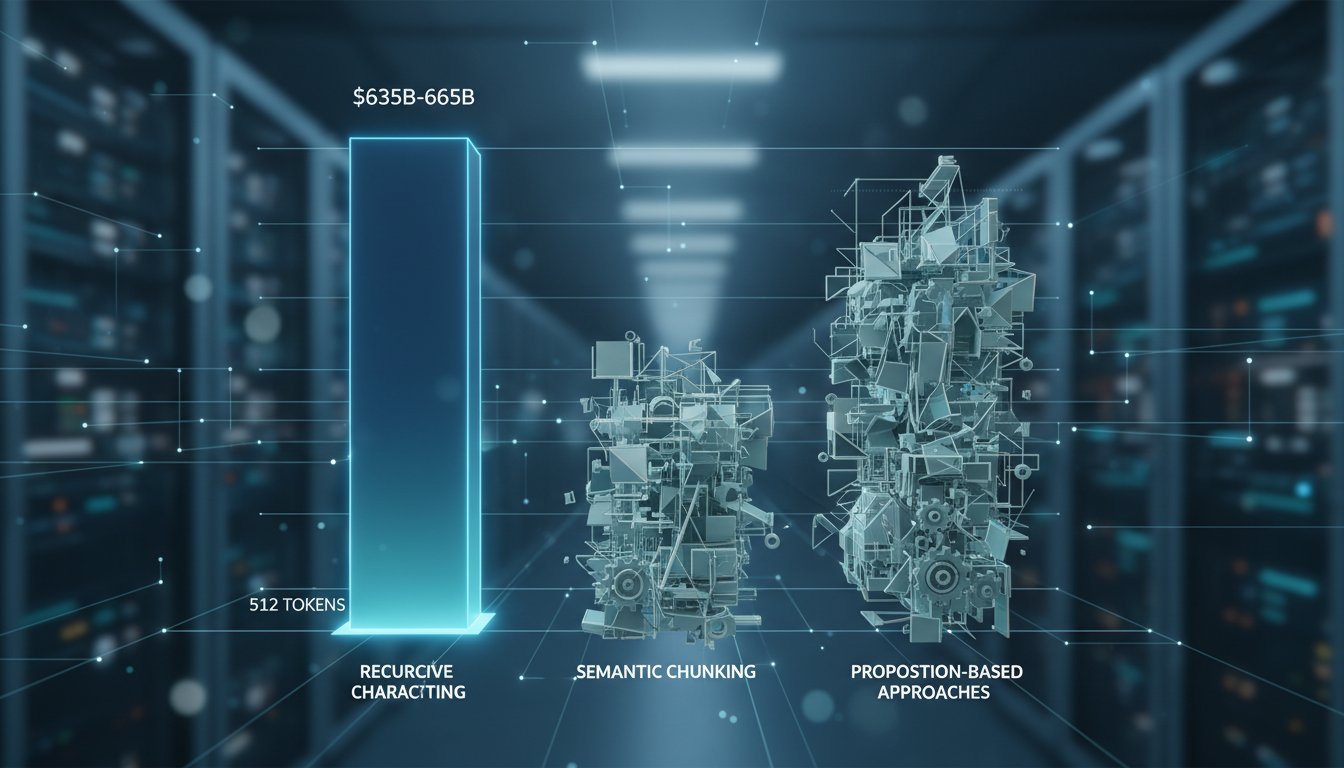

Chroma Research (2024) провів систематичне порівняння стратегій chunking на власному evaluation framework з 474 запитами, згенерованими GPT-4-Turbo, на корпусах різного типу (Wikipedia, фінансові тексти, чатлоги). Ключові результати:

LLM-based semantic chunking (LLMSemanticChunker) досяг найвищого recall — 91.9%. ClusterSemanticChunker (embedding-based) — 89.7% recall. RecursiveCharacterTextSplitter (400–512 токенів) — 85–90% recall, найкращий баланс якість/вартість для більшості команд. Fixed-size chunking без overlap — найнижчий recall серед усіх методів. Різниця між найкращим і найгіршим методом — до 9 абсолютних відсотків recall. Chroma також зазначає, що semantic chunking вимагає обчислення embeddings для кожного речення під час ingestion, що значно дорожче — trade-off, який має сенс тільки для high-value документів.

Але навіть semantic chunking без hybrid retrieval та reranking не дотягує до production-рівня. Комбінація semantic chunking + hybrid (BM25 + dense + RRF) + cross-encoder reranking підіймає recall до 82–92% на enterprise-корпусах. ZeroEntropy (2025–2026) рекомендує rerank 50 документів для LLM-чатів (де важлива швидкість) і 100–200 для comprehensive search. Weaviate підтверджує: hybrid + reranking дає абсолютний приріст до 13.4 пунктів nDCG@10 порівняно з best-performing single-method на BRIGHT reasoning-intensive benchmark.

Приклад з практики

У FinTech-корпусі з 500 тис. фінансових звітів наївний RAG давав recall ~55–60% на factoid-запитах (конкретні цифри, ID транзакцій, дати). Типова помилка: запит про «комісію за переказ у доларах за Q3 2025» повертав чанки з правильного документа, але без рядка таблиці з конкретною сумою — бо fixed-size split розірвав таблицю. Після впровадження semantic chunking (з preservation таблиць як цілих блоків) + hybrid retrieval (BM25 ловив exact ID, dense — семантичний контекст) + bge-reranker-v2 recall зріс до 82–87%, а faithfulness за RAGAS покращився у 2–3 рази. Час впровадження — 2–3 тижні для команди з 2 інженерів.

Що це означає практично

Наївний RAG — це рівень PoC. Він підходить для демонстрації концепції на маленькому чистому датасеті. Production починається з визнання простого факту: 60–70% якості кінцевої відповіді визначається тим, як підготовлені дані (ingestion) і як працює пошук (retrieval), а не тим, яку LLM ви використовуєте.

Три кроки з найвищим ROI для переходу від наївного до advanced RAG:

Крок 1: Замініть fixed-size chunking на semantic або recursive (з overlap 10–20%). Якщо у вас structured documents (таблиці, PDF) — використовуйте LlamaParse або Docling для ETL з preservation структури. Очікуваний приріст: +9–74% recall залежно від типу даних (Chroma, PMC 2025).

Крок 2: Додайте hybrid search (dense + BM25 + RRF). Більшість сучасних VectorDB (Weaviate, Qdrant, Elasticsearch) підтримують це нативно. Очікуваний приріст: +2.6–13.4 пунктів nDCG@10 (Weaviate benchmarks).

Крок 3: Додайте cross-encoder reranking. bge-reranker-v2 (open-source) або Cohere Rerank (enterprise) — rerank top-50 у top-5–10. Очікуваний приріст: до +48% якості retrieval (Pinecone/Superlinked), зниження token usage на 25% (ZeroEntropy).

Перехід до advanced RAG — це не про потужнішу модель, а про усунення системних обмежень у шарах, які передують генерації. У наступних розділах — як саме побудована production-система, яка усуває ці обмеження.

Розділ 2. Анатомія сучасної production RAG-системи

Production RAG у 2026 році — це не лінійний пайплайн «запит → пошук → відповідь», а модульна система з двома розділеними потоками (offline indexing + online querying), observability на кожному шарі та fallback-механізмами. Типовий стек: LlamaParse або Docling для ETL, hybrid VectorDB (Qdrant/Weaviate), cross-encoder reranking, LangGraph для agentic routing, vLLM для inference, LangSmith/Phoenix для tracing, Redis для semantic cache та agent memory.

Різниця між PoC і production RAG — не в потужності моделі, а в архітектурі. PoC — це один скрипт: завантажив документи, розбив, заембеддив, шукаєш, генеруєш. Production — це розподілена система, де кожен компонент можна оптимізувати, моніторити та замінити незалежно. Нижче — детальний розбір кожного шару з конкретними інструментами, бенчмарками та trade-off'ами.

Offline Indexing Pipeline: від «сирих» даних до оптимізованого індексу

Offline pipeline працює асинхронно, поза запитами користувачів. Його завдання — перетворити «сирі» дані (PDF, HTML, таблиці, зображення) у оптимізований індекс, готовий для sub-second retrieval.

Крок 1: Advanced ETL (Document Parsing). Якість парсингу PDF визначає upper bound якості всієї системи — якщо парсер зруйнував структуру таблиці або пропустив секцію, жодний retrieval це не виправить. Applied AI (2025–2026) провів масштабний бенчмарк 17 парсерів на 800+ документах. Ключові висновки: точність парсерів варіюється на 55+ відсоткових пунктів залежно від типу документа — юридичні контракти дають 95% accuracy, академічні статті — 40–60%. Різниця між типами документів перевищує різницю між парсерами.

LlamaParse (LlamaIndex) — оптимальний баланс якість/ціна для більшості RAG-сценаріїв: 78% edit similarity при $0.003 за сторінку, що відповідає якості premium LLM-парсерів (Gemini 3 Pro — 88%, але у 3–10 разів дорожче) і значно перевершує бюджетні рішення. LlamaParse лідирує за robustness (ChrF++ 81% — вище за GPT-5.1 з 79%). Сильні сторони: preservation структури таблиць, natural language інструкції для кастомізації парсингу, швидкість (~6 секунд незалежно від розміру документа).

Docling (IBM) — найкраща open-source альтернатива. У бенчмарку Procycons (2025) на sustainability-звітах Docling показав 97.9% accuracy на складних таблицях, перевершивши і LlamaParse, і Unstructured. Trade-off: повільніший і вимагає self-hosting.

Важливий нюанс: GPT-4o-mini — найгірший вибір для RAG-парсингу, незважаючи на прийнятний text extraction (75%). За даними Applied AI, його tree similarity — лише 13%, що означає катастрофічне руйнування структури документа. Жоден з парсерів не є ідеальним для всіх типів документів — практики рекомендують ensemble-підхід (Docling для таблиць + LlamaParse для загального тексту) для максимальної якості.

Для multimodal документів (графіки, діаграми, фото) ColPali перетворює сторінки на зображення і створює patch-level embeddings через late-interaction механізм, обходячи OCR-помилки. На ViDoRe benchmark ColPali перевершує text-only системи на 20–40% у візуально-багатих задачах.

Крок 2: Chunking та Metadata Enrichment. Після парсингу — semantic або proposition chunking замість фіксованого розміру (детально розібрано в Розділі 1 та Кластері 1). Чанки збагачуються метаданими: entity extraction (імена, дати, ID), keywords (TF-IDF або LLM-based), source інформація (документ, сторінка, секція), hierarchy (chapter → section → paragraph). Ці метадані дозволяють: pre-filtering до vector search (зменшення search space), self-querying (LLM автоматично генерує фільтри з запиту), traceability (citation з точністю до сторінки/секції).

Крок 3: Embedding та Indexing. Готові чанки перетворюються на embeddings (dense + sparse або late-interaction) і потрапляють у hybrid індекс VectorDB. Qdrant підтримує prefetch multi-stage (byte-quantized vectors → full precision rerank), що дозволяє зберігати мільйони векторів з мінімальним RAM. Weaviate — native hybrid (BM25 + vector + GraphQL) з коробки. Обидва підтримують zero-downtime updates через delta indexing та snapshots.

Online Query Pipeline: від запиту до відповіді за <2 секунди

Online pipeline обробляє кожен запит у реальному часі. Production target: p90 Time-to-First-Token (TTFT) менше 2 секунд. Потік складається з 6 кроків:

1. Semantic Cache Check. Перед будь-якою обробкою запит перевіряється у semantic cache (Redis). Запит конвертується у embedding, виконується vector search по кешу — якщо similarity перевищує threshold (типово 0.85–0.95), повертається кешована відповідь за sub-100ms замість multi-second LLM-виклику. За даними Redis (2026), semantic caching знижує вартість LLM API до 68.8% у типових production workloads і робить відповіді до 65 разів швидшими на cache hits. Redis дослідження показує, що ~31% запитів до LLM є контекстуально повторюваними і можуть бути кешовані.

Redis LangCache — managed рішення для semantic caching з нативною інтеграцією в LangChain/LlamaIndex/LangGraph. Заявлена економія — до 90% на API costs. Для складніших сценаріїв Redis пропонує Context-Enabled Semantic Caching (CESC): на cache hit кешована відповідь + user context + RAG context подаються в lightweight LLM (gpt-4o-mini) для персоналізації — дешевше за повний LLM call, але з урахуванням контексту користувача.

2. Query Transformation. Якщо cache miss — запит проходить transformation: HyDE (генерація гіпотетичного документа для кращого embedding match), multi-query (розширення одного запиту на 3–5 варіацій для покращення recall), query2doc (збагачення запиту контекстом). Ці кроки можуть виконуватися SLM (Phi-4-mini, Qwen3-0.6B) замість frontier-моделі для зниження TCO (детально — Розділ 3, секція SLM).

3. Hybrid Retrieval. Dense vector search + BM25 keyword search з Reciprocal Rank Fusion (RRF) або linear combination. Більшість сучасних VectorDB (Weaviate, Qdrant, Elasticsearch) підтримують це нативно в одному API-виклику.

4. Cross-Encoder Reranking. Top-20–50 результатів від hybrid retrieval → cross-encoder (bge-reranker-v2 або Cohere Rerank) → top-5–10 за релевантністю. Це крок з найвищим ROI у всьому пайплайні (детально — Кластер 2).

5. Augmentation та Generation. Відфільтровані чанки формують контекст для LLM. Strategic ordering: найрелевантніше — на початок (мінімізація lost-in-the-middle). Generation: vLLM для low-latency self-hosted inference (Llama-3.3, Qwen-2.5) або Claude/GPT API з automatic fallback. vLLM знижує latency на 2–5× порівняно з стандартними API за рахунок continuous batching та PagedAttention.

6. Post-processing. Citation check (кожне твердження прив'язується до конкретного чанка), self-correction (якщо відповідь суперечить retrieved контексту — перегенерація), safety filters.

Observability як окремий шар

Третій потік працює паралельно з online pipeline і є обов'язковим для production. Без нього ви не знаєте, чи система покращується, чи деградує — ви просто витрачаєте ресурси на неконтрольовану систему.

Що моніторити: latency кожного кроку пайплайну (embedding, retrieval, rerank, generation — де bottleneck?), кількість токенів (input/output — де перевитрата?), retrieval scores (cosine similarity, rerank scores — деградація якості індексу?), faithfulness та answer relevancy (RAGAS/DeepEval — деградація якості відповідей?), cache hit rate (семантичний кеш працює чи ні?).

Інструменти:

LangSmith — лідер для LangChain/LangGraph стеку. Tracing chains з prompt versioning, built-in eval scoring, A/B comparison configs. Найнижчий overhead серед комерційних рішень. Ідеальний для agentic RAG з LangGraph.

Arize Phoenix — найкращий open-source варіант. RAG-специфічна візуалізація: embedding drift detection (коли нові дані змінюють розподіл embeddings), retrieval quality per query (які запити систематично дають поганий retrieval), trace waterfall (візуалізація latency кожного кроку). Unified ML + LLM monitoring для команд з mixed workloads.

Langfuse — open-source/self-hosted з максимальним контролем над даними. Tracing + prompt management + evals. Найкращий вибір для data sovereignty (GDPR, HIPAA), мінімальний vendor lock-in.

Observability дозволяє: виявити деградацію faithfulness раніше, ніж її помітять користувачі (alert на faithfulness < 0.85), знайти bottleneck у latency (retrieval 800ms з 1200ms — проблема в індексі, не в LLM), запустити A/B-тест (embedding model A vs B, chunk size 400 vs 800 — що дає кращий recall на реальному трафіку). За оцінками 2025–2026 років, 40–60% RAG-імплементацій не доходять до production саме через відсутність observability.

Agentic routing: коли RAG стає інтелектуальнішим

У 2026 році production RAG дедалі частіше включає agentic шар (LangGraph, CrewAI). Замість фіксованого пайплайну «шукай → генеруй» система сама вирішує: чи достатньо знайденого контексту? Чи потрібен другий ітераційний цикл пошуку з переформульованим запитом? Чи варто звернутися до зовнішнього інструменту (SQL-запит, API, калькулятор)?

Self-RAG (conditional retrieval + reflection tokens) знижує галлюцинації на 25–40% за бенчмарками 2024–2025: модель генерує special tokens, які вказують, чи потрібен retrieval, чи retrieved контекст релевантний, чи відповідь підтримується контекстом. CRAG (Corrective RAG) додає retrieval evaluator: якщо retrieved контекст недостатньо релевантний, система автоматично переформулює запит або звертається до альтернативного джерела (web search, structured DB). Це не опція — для enterprise-задач з multi-hop запитами (юридичний аналіз, due diligence, технічна підтримка з ескалацією) agentic routing стає стандартом.

Типовий production-стек 2026: зведена таблиця

| Шар |

Компонент |

Інструменти |

Ключова метрика |

| ETL / Parsing |

Document extraction |

LlamaParse, Docling, ColPali (multimodal) |

Edit similarity >78%, table accuracy >90% |

| Chunking |

Semantic splitting + metadata |

LLMSemanticChunker, ClusterSemanticChunker, proposition chunking |

Recall >85% (Chroma benchmark) |

| Vector DB |

Hybrid index (dense + BM25) |

Qdrant, Weaviate, Milvus |

P95 latency <50ms, recall ≥0.98 |

| Reranking |

Cross-encoder |

bge-reranker-v2, Cohere Rerank |

+15–48% retrieval quality |

| Cache |

Semantic cache + agent memory |

Redis LangCache, RedisVL |

Cache hit rate >30%, cost reduction до 68.8% |

| Orchestration |

Agentic routing, self-correction |

LangGraph, CrewAI |

Hallucination reduction 25–40% |

| Generation |

LLM inference |

vLLM (Llama-3.3, Qwen-2.5), Claude/GPT API |

p90 TTFT <2с |

| Observability |

Tracing, eval, A/B |

LangSmith, Arize Phoenix, Langfuse |

Faithfulness >0.90, continuous monitoring |

Redis (2026) зазначає типову проблему production RAG: через три місяці після запуску команда управляє чотирма окремими data storage шарами — вектори в одній системі, semantic cache в іншій, application state у третій, operational data у четвертій. Кожна інтеграційна точка додає latency і створює нові failure modes. Тому тренд 2026 року — уніфіковані платформи (Redis як unified data layer для vectors + cache + agent memory, Weaviate з вбудованим hybrid + rerank + agent query mode).

Production RAG — це розподілена система з observability та оптимізаціями на кожному шарі. Без цього навіть найкраща модель не забезпечить надійність та ефективність на реальному трафіку. У наступному розділі — коли RAG є правильним вибором, а коли краще fine-tuning, long-context або гібрид.

Розділ 3. Вибір стратегії: RAG, Fine-tuning, Long Context чи RAFT?

RAG — стандарт для динамічних, великих, чутливих або оновлюваних даних (80–90% enterprise-кейсів). Fine-tuning — для вузької доменної адаптації стилю при статичних знаннях. Long-context (1M+ токенів) — для маленьких статичних корпусів, де весь контекст поміщається. RAFT — гібрид fine-tuning + RAG, коли модель має навчитися ігнорувати шум у retrieved контексті. SLM (Small Language Models) — «робочі конячки» всередині RAG-пайплайну для локальних задач (query rewriting, relevance check, compression), що знижують TCO на 30–40%. У 2026 році гібридні підходи (RAG як основа + long-context fallback + SLM для внутрішніх операцій) домінують.

Вибір між RAG, fine-tuning, long-context та RAFT залежить від п'яти факторів: розмір корпусу, частота оновлень, вимоги до конфіденційності, бюджет і тип запитів. У 2025–2026 роках емпіричні дослідження та enterprise-звіти дають достатньо даних для обґрунтованого вибору без гадання.

Коли RAG — правильний вибір

RAG перемагає за TCO, recall та гнучкістю у сценаріях з: динамічними або оновлюваними даними (документація, бази знань, звіти, що змінюються); великими корпусами (більше 100–200 тис. документів, де long-context фізично не вміщує весь контекст); вимогами до traceability (citations, аудит — хто сказав що і звідки); конфіденційністю (local embeddings + ACL фільтри, дані не потрапляють у модель); обмеженим бюджетом (вартість запиту ~$0.00008–0.01 з semantic cache проти $0.10–10+ для long-context на 1M токенів — різниця до 1250 разів за даними Elasticsearch Labs 2026).

Latency: RAG з hybrid retrieval + rerank дає p90 0.2–2 секунди. Long-context на великих inputs — 2–45+ секунд (Databricks/ByteIota 2025–2026). Для інтерактивних застосунків (чат-бот, support) це критична різниця.

Коли long-context виграє

Long-context моделі (Gemini 2.5/3 Pro до 2M+, Claude 4 Opus ~1M, Llama 4 Maverick) виграють у вузькому сценарії: маленький статичний корпус (менше 50–200 документів), де весь контекст поміщається без retrieval, і запит вимагає глобального розуміння (summarization, порівняння всіх документів одночасно). Needle-in-a-Haystack тести дають ~99% recall на краях контексту, але lost in the middle деградація досягає 25–45% для інформації в середині (Stanford TACL 2024, Chroma 2025). На 1M токенів Gemini 3 Pro показує ~77% recall на MRCR, Claude 4 Opus — ~76%.

Це означає: long-context не замінює retrieval, а доповнює його. Паттерн 2026 року — гібрид: RAG знаходить 20–50 релевантних документів, вони подаються в long-context LLM для глибокого аналізу. Self-Route (arXiv 2024–2025) автоматично вирішує, чи запит потребує RAG чи long-context, досягаючи ~LC performance за 50–80% менших витрат.

Коли fine-tuning

Fine-tuning виправданий, коли потрібно адаптувати стиль, термінологію або формат відповідей під вузький домен (медична термінологія, юридичний стиль, корпоративний tone of voice) при відносно статичних знаннях. Вартість: висока на етапі тренування (GPU-години), але низька на етапі inference. Обмеження: знання «заморожені» в момент тренування, оновлення вимагає ретренування. Не підходить для динамічних даних.

Коли RAFT

RAFT (Retrieval-Augmented Fine-Tuning, Microsoft, arXiv 2024) — це гібрид, де модель fine-tuning-ом навчається ефективно працювати з retrieved контекстом, ігноруючи distractor-документи (шум). Перевершує стандартний RAG на 5–20% у domain-specific QA з noisy retrieval (legal, fintech, де серед retrieved чанків багато нерелевантних). Trade-off: вимагає тренування з парами (запит, релевантні + distractor документи), що додає складність. Виправданий для вузьких доменів, де стандартний RAG + rerank не дає достатньої точності.

SLM у RAG-пайплайні: прагматична економія

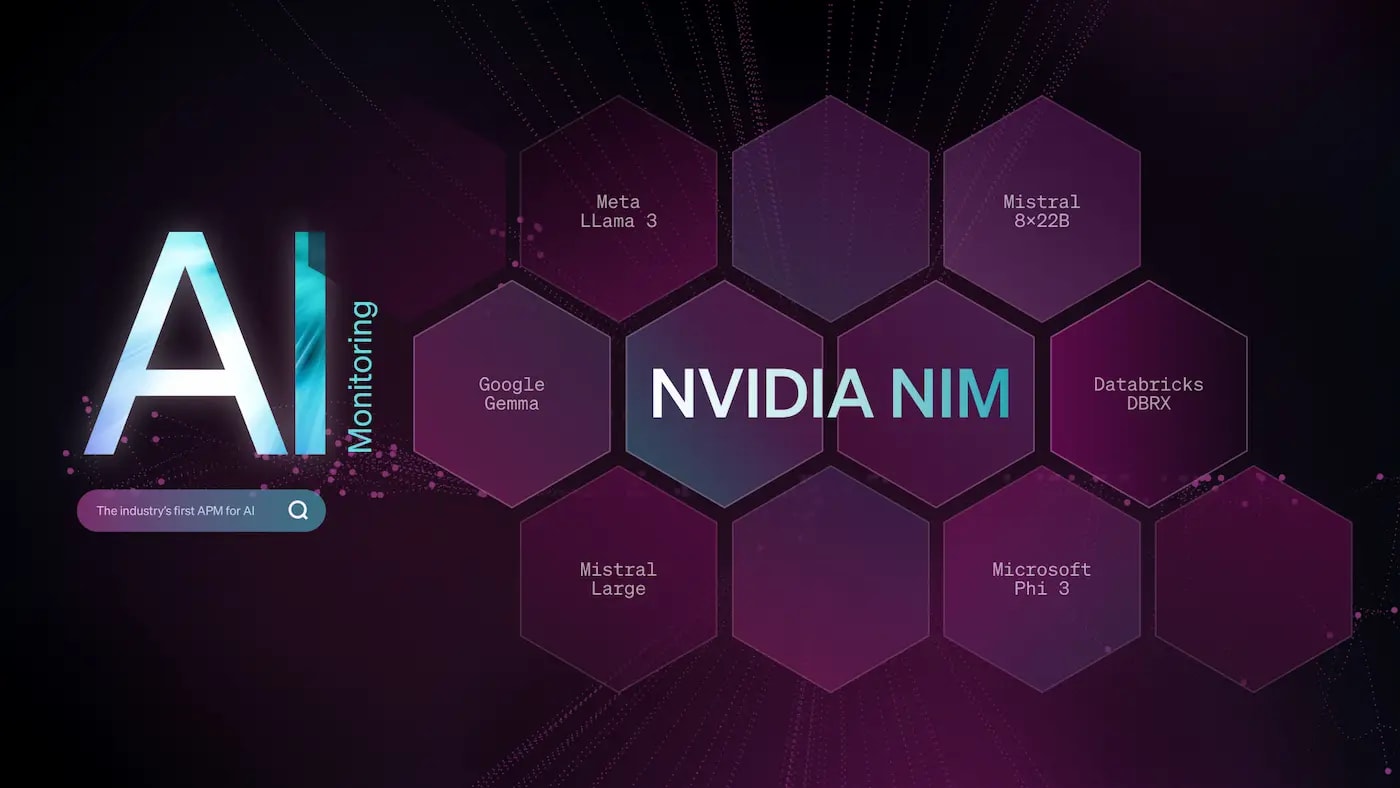

У 2026 році Small Language Models (SLM) — моделі з 1–14B параметрів (Phi-4, Phi-4-mini, Qwen3-0.6B, Gemma 3n, Llama 3.2 7B) — стали стандартним компонентом всередині production RAG-пайплайнів. Ключова ідея: використовувати frontier-модель (Claude 4, GPT-4o, Gemini 2.5 Pro) тільки для фінальної генерації, а всі проміжні операції делегувати дешевим SLM.

Де SLM ефективні всередині RAG:

Query rewriting та transformation. Переформулювання запиту, генерація HyDE-документа, multi-query expansion — задачі, де достатньо моделі на 3–7B параметрів. Azure AI Search використовує fine-tuned SLM (1B+ параметрів) для генерації до 10 варіантів переформулювань запиту, що дає +4 пункти NDCG@3 з мінімальним latency overhead. Використовувати Claude 4 Opus для простого переписування запиту — марнотратство, яке збільшує TCO у 10–50 разів без пропорційного приросту якості.

Relevance check та filtering. Перевірка релевантності retrieved чанків до генерації: SLM оцінює кожен чанк як «релевантний / частково релевантний / нерелевантний» і фільтрує шум до того, як контекст потрапить у frontier-модель. Zilliz (розробники Milvus) випустили semantic highlighting модель на базі MiniCPM-2B, яка фільтрує на рівні речень і скорочує token usage на 70–80% без деградації accuracy.

Context compression. Стиснення retrieved контексту перед подачею в LLM: SLM переписує 5–10 чанків у компактний summary, зберігаючи ключові факти. Це знижує кількість токенів для frontier-моделі на 50–70% і зменшує latency.

Agentic routing та decision-making. SLM як «класифікатор» у першому шарі agentic RAG: визначає тип запиту (simple lookup / multi-hop / out-of-scope), вирішує, чи потрібен retrieval, і маршрутизує до відповідного пайплайну. SmartRAG (ICLR 2025) демонструє цей підхід: policy network (SLM) вирішує, коли шукати, що переформулювати і як генерувати, оптимізуючи всю систему через reinforcement learning.

Економічний ефект. За даними Iterathon (2025), обслуговування SLM на 7B параметрів обходиться у 10–30 разів дешевше, ніж моделі на 70–175B. У реальних enterprise-деплоях e-commerce ритейлер (200 тис. розмов/міс) використовує гібрид: класифікатор маршрутизує 95% запитів на SLM (Mistral 7B), лише 5% потрапляють до frontier-моделі. У RAG-контексті це означає: якщо 3–4 проміжних кроки пайплайну (query rewrite, relevance check, compression, routing) виконує SLM замість frontier-моделі, TCO на ці операції знижується на 30–40% і більше, а сумарний TCO системи — на 20–30%.

Trade-off'и SLM у RAG. SLM мають обмежені factual знання — Phi-4-mini (3.8B) прямо зазначає в документації, що модель не має достатньої ємності для зберігання фактів і рекомендує використовувати RAG для компенсації. Multilingual performance нерівномірний: для неанглійських мов (включно з українською) потрібне окреме бенчмаркування. ACM SIGCSE (2025) описує «неможливий трикутник» SLM + RAG — неможливо одночасно досягти високої accuracy, короткого context length та низького latency; потрібно обирати два з трьох. 4-bit quantization знижує VRAM з 14GB до 3.5GB з деградацією accuracy менше 2% — прийнятний trade-off для проміжних задач пайплайну.

Рекомендація: не використовуйте frontier-модель там, де достатньо SLM. Query rewriting, relevance filtering, context compression, routing — це задачі для Phi-4-mini, Qwen3-0.6B або Gemma 3n. Frontier-модель — тільки для фінальної генерації, де якість відповіді критична.

Trade-off матриця

Порівняння на основі benchmarks 2025–2026 (arXiv LaRA, Elastic, Chroma, Redis, Microsoft RAFT, Iterathon SLM report):

- Динамічні дані: RAG — відмінно (zero retrain); fine-tuning — погано (ретренування); long-context — прийнятно (re-prompt, але без retrieval); RAFT — помірно (ретренування + retrieval); SLM у RAG — відмінно (не потребує ретренування для проміжних задач).

- Великий корпус (>100k docs): RAG — recall 82–92%; long-context — recall 65–88% (lost in the middle); fine-tuning — не застосовний; RAFT — 87–95% (на trained domain); SLM + RAG — recall визначається retrieval, SLM покращує precision через filtering.

- TCO на 1M запитів/місяць: RAG з cache — $500–2000; long-context (1M токенів) — $5000–50000+; fine-tuning — $1000–3000 (після тренування); RAFT — $1500–4000; RAG з SLM для проміжних кроків — $350–1400 (додаткова економія 20–30%).

- Latency (p90): RAG — 0.2–2 с; long-context — 2–45+ с; fine-tuning — ~0.8 с; RAFT — 0.5–2 с; SLM-кроки — додають 50–200 мс на крок (прийнятно для production).

- Traceability (citations): RAG — так (chunk-level); long-context — обмежено; fine-tuning — ні; RAFT — так; SLM у RAG — так (зберігає chunk provenance).

Рекомендація: починайте з advanced RAG із SLM для проміжних операцій (query rewrite + relevance check) — це найбезпечніший і найефективніший шлях для більшості enterprise-сценаріїв. Frontier-модель тільки для фінальної генерації. Додавайте long-context як верхній шар для специфічних задач (summarization маленьких корпусів, multi-document analysis). RAFT — для вузьких доменів з noisy retrieval, де стандартний rerank не дає достатньої якості.

Розділ 4. Матриця зрілості RAG-проекту: від прототипу до високого навантаження

П'ять рівнів зрілості: від Naive PoC (рівень 0) до Agentic Knowledge Runtime (рівень 4). Більшість організацій у 2026 році (~70–80%) все ще на рівнях 0–1, де RAG — це PoC без системної оцінки. Перехід на рівень 2+ (observability + evaluation) — обов'язковий для production.

Матриця зрілості RAG (RAG Maturity Model) — це структурований фреймворк для оцінки, де ви зараз і що потрібно для переходу на наступний рівень. Вона базується на enterprise-звітах 2025–2026 (NStarX roadmap 2026–2030, Vectara Enterprise RAG Predictions, Redis production lessons) і дає чіткі критерії переходу замість абстрактних рекомендацій.

Контекст: McKinsey State of AI (2025) фіксує системний розрив між adoption і value capture: 71% організацій регулярно використовують GenAI, але лише 39% бачать хоча б мінімальний вплив на EBIT, і тільки ~6% кваліфікуються як «AI high performers» з 5%+ EBIT-впливом. Причина — більшість компаній залишаються на рівні пілотів: менше третини масштабують AI по всій організації. RAG-проекти відображають цю ж динаміку: PoC запускається за дні, але production-рівень вимагає системної роботи з evaluation, governance та observability.

Рівні зрілості

| Рівень | Назва | Характеристики | Ключові метрики | Критерій переходу |

|---|

| 0 | Naive PoC | Fixed chunk + cosine top-k + LLM call. LangChain/LlamaIndex default. Ручні тести. Немає evaluation pipeline. | Recall ~50–65%. Ручна перевірка (spot-checking). | З'явились production-запити: latency, scale, accuracy issues. |

| 1 | Advanced Retrieval | Hybrid search (dense + BM25 + RRF). Rerank (bge-reranker-v2/Cohere Rerank). Semantic chunking. Query transform (HyDE/multi-query). Перші автоматизовані тести. | Recall 75–85%. Faithfulness >80% (RAGAS). | Потрібно observability та real traffic. Стабільність на 10–100k docs. |

| 2 | Production-Aware | Повний tracing (LangSmith/Arize Phoenix). LLM-as-a-Judge eval (RAGAS/DeepEval). A/B на живому трафіку. Semantic cache (Redis LangCache). CI/CD gates на evaluation метрики. | p90 latency <2 с. Faithfulness >90%. Continuous monitoring. | Enterprise-вимоги: ACL, governance, scale >1M docs. |

| 3 | Enterprise-Scale | Zero-downtime ingestion. ACL/row-level security. TCO-оптимізація (cache + quantized LLM + SLM для проміжних задач). Data versioning. GDPR/HIPAA compliance. Multi-tenant isolation. | Throughput >1000 QPS. 99.9% uptime. Compliance audit trail. | Agentic складність: multi-hop, self-correction, tool-use. |

| 4 | Agentic / Knowledge Runtime | Agentic RAG (LangGraph/multi-agent). Self-RAG/CRAG (self-correction/reflection). GraphRAG. Multi-hop reasoning. Autonomous knowledge updates. | End-to-end accuracy >92%. Autonomous handling 80%+ запитів. | Безперервна еволюція: governance-first, knowledge runtime. |

Чому більшість компаній застрягли на рівнях 0–1

NStarX (2026) прямо формулює проблему: «Поточні RAG-імплементації провалюються на enterprise-масштабі, тому що розглядають knowledge infrastructure як щось окреме від security, governance та observability». Їхні дані: 70% RAG-систем не мають систематичних evaluation frameworks, що унеможливлює виявлення деградації якості. За оцінками NStarX, у 2026 році 60% нових RAG-деплоїв включають systematic evaluation з першого дня — зростання з менш ніж 30% у 2025 році, але це все ще означає, що 40% запускаються без будь-якої оцінки.

Бар'єр 1: Відсутність системної оцінки (evaluation blind spot). Команди не знають, який recall/faithfulness має їхня система, і оптимізують наосліп — змінюють embedding model, chunk size, top-k без вимірювання впливу. Langfuse описує типовий сценарій: інженери сперечаються, чи TOP_K має бути 3 або 5, спираючись на інтуїцію замість даних, тоді як систематичне тестування може показати, що TOP_K=1 працює для простих запитів, але провалюється на складних multi-source запитах. Stanford AI Lab фіксує, що навіть при доступі до правильної інформації погано оцінені RAG-системи генерують галлюцинації до 40% відповідей.

Бар'єр 2: Недооцінка retrieval bottlenecks. Фокус на виборі «кращої LLM» замість оптимізації ingestion та пошуку — класична помилка. Vectara у прогнозах на 2025–2026 рік зазначає: при масштабуванні від PoC до production стає очевидним, що retrieval — один із найбільших bottleneck-ів. Великі enterprise-датасети вимагають зрілих технік пошуку — hybrid search та reranking — щоб знаходити найкориснішу інформацію для генерації. Це підтверджує висновок Розділу 1: 60–70% якості кінцевої відповіді визначається тим, як підготовлені дані та як працює retrieval, а не тим, яку LLM ви використовуєте.

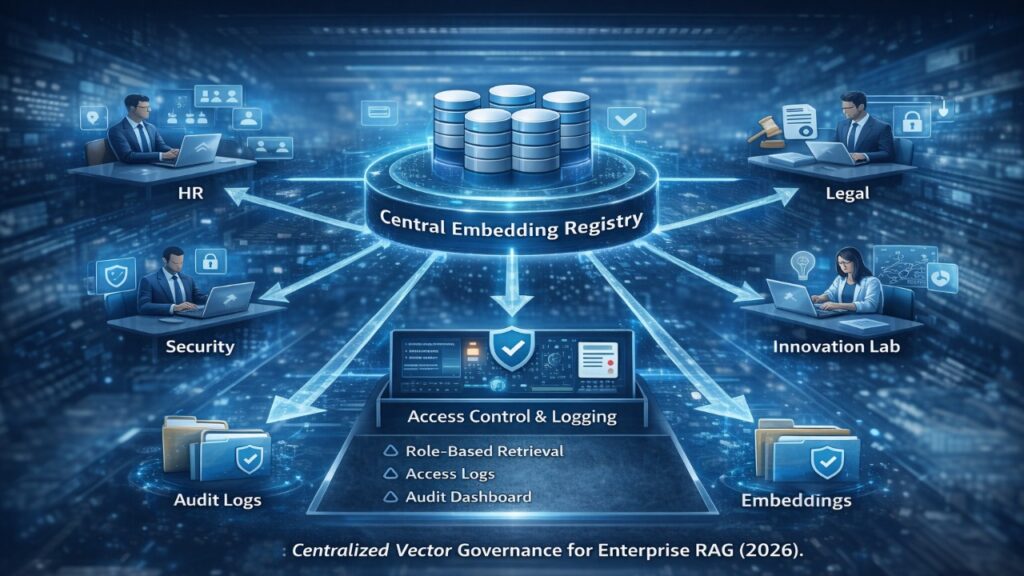

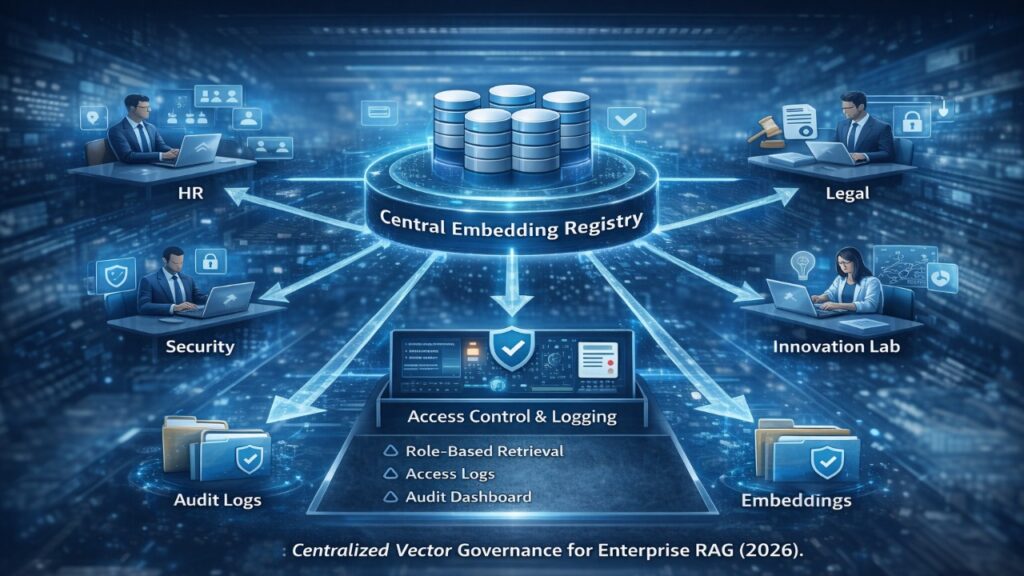

Бар'єр 3: Ігнорування governance та compliance. Без ACL-фільтрів, data versioning та audit trail система не проходить enterprise security review. Data Nucleus (2025) наголошує: GDPR-принципи застосовуються до будь-яких персональних даних у RAG-сховищах — потрібен Data Protection Impact Analysis (DPIA) для high-risk обробки (HR, health). EU AI Act, що набув чинності у 2024 році, передбачає поетапні зобов'язання до 2026–2027 років. Без document-level ACL (наприклад, Elastic DLS, Qdrant access control, Weaviate multi-tenancy) користувачі бачать контент, до якого не повинні мати доступу — критичний ризик для фінансових, юридичних та медичних даних.

Роль Evaluation та Observability: чому це не опція

NStarX формулює це як «Core Belief»: evaluation та observability — не опція, а обов'язкова умова для production. Production-деплої вимагають continuous evaluation за чотирма вимірами: Context Precision (чи релевантні retrieved документи?), Context Recall (чи знайдено всю релевантну інформацію?), Faithfulness (чи відповідь залишається в межах джерел?), Answer Relevancy (чи відповідає вона на запитання?).

Два ключові фреймворки:

RAGAS (Retrieval-Augmented Generation Assessment) — open-source фреймворк, який використовує LLM-as-a-Judge для автоматичної оцінки RAG-пайплайнів. Метрики: Faithfulness (чи відповідь підтримується retrieved контекстом), Answer Relevancy (чи відповідь адресує запит), Context Precision та Context Recall. Інтегрується з LangChain, LlamaIndex, Haystack. Переваги: reference-free оцінка (не потрібно вручну розмічати кожну відповідь), масштабується на тисячі запитів. Обмеження: метрики не завжди self-explaining, що ускладнює debugging.

DeepEval (Confident AI) — open-source фреймворк з 14+ метриками, який тракує evaluation як unit tests (інтеграція з Pytest). Переваги порівняно з RAGAS: self-explaining метрики (кожна оцінка супроводжується поясненням, чому скор такий, а не вищий), verbose debugging, підтримка не тільки RAG, а й agentic workflows та chatbot conversations, red teaming (bias, toxicity, prompt injection). Синтетична генерація тестових датасетів без прив'язки до LangChain/LlamaIndex. DeepEval рекомендований для команд, які хочуть CI/CD-інтеграцію evaluation в pipeline розробки.

Observability стек: LangSmith (лідер для LangChain/LangGraph стеку: tracing chains, prompt versioning, A/B comparison), Arize Phoenix (найкращий open-source: embedding drift detection, retrieval quality per query, trace waterfall), Langfuse (open-source/self-hosted з максимальним контролем над даними — оптимальний для GDPR/HIPAA). Усі три підтримують span-level метрики за стандартами OpenTelemetry: які документи retrieved, які scores у reranker, яка latency на кожному кроці.

Практичний патерн 2026 року — production-to-evaluation feedback loop: production failures автоматично стають test cases, кожен деплой показує, що покращилось або деградувало. За даними NStarX, систематична evaluation знижує post-deployment issues на 50–70%, але вимагає виділених evaluation engineering ресурсів.

Типовий шлях переходу з конкретними кроками та часовими рамками

Рівень 0 → 1: Advanced Retrieval (1–2 тижні, 1–2 інженери).

Що робити: замінити fixed-size chunking на semantic або recursive (з overlap 10–20%). Додати hybrid search (dense + BM25 + RRF) — більшість сучасних VectorDB (Weaviate, Qdrant, Elasticsearch) підтримують це нативно. Додати cross-encoder reranking (bge-reranker-v2 або Cohere Rerank). Очікуваний результат: +15–40% recall, зниження шуму в контексті. Це крок із найвищим ROI у всьому шляху зрілості — мінімальні витрати, максимальний вплив на якість.

Рівень 1 → 2: Production-Aware (2–4 тижні).

Що робити: підключити tracing — LangSmith (якщо LangChain/LangGraph стек) або Arize Phoenix (open-source, framework-agnostic). Налаштувати автоматичну evaluation: DeepEval для CI/CD-інтеграції (Pytest-стиль: тест провалюється, якщо faithfulness нижче порогу) або RAGAS для lightweight моніторингу. Запустити перший A/B-тест на живому трафіку (embedding model A vs B, або chunk size 400 vs 800). Додати Redis LangCache для semantic caching (~31% запитів повторюються і можуть бути кешовані). Налаштувати alerts: faithfulness < 0.85 → автоматичне сповіщення. Очікуваний результат: перехід від «здається, працює нормально» до «ми знаємо, що система працює з faithfulness 0.91 і p90 latency 1.4 секунди».

Рівень 2 → 3: Enterprise-Scale (1–3 місяці).

Що робити: впровадити ACL-фільтри в VectorDB (document-level security). Налаштувати zero-downtime ingestion через delta indexing. Додати SLM (Phi-4-mini, Qwen3-0.6B) для проміжних операцій пайплайну (query rewrite, relevance check, compression) — зниження TCO на 20–30%. Data versioning для rollback при деградації якості. GDPR/HIPAA compliance: data residency, audit logs, DPIA. Очікуваний результат: система витримує >1000 QPS з 99.9% uptime та проходить enterprise security review.

Рівень 3 → 4: Agentic / Knowledge Runtime (3–6 місяців).

Що робити: впровадити agentic routing через LangGraph — система сама вирішує, чи достатньо retrieved контексту, чи потрібен ітераційний пошук, чи варто звернутися до зовнішнього інструменту. Self-RAG/CRAG для self-correction: reflection tokens вказують, чи потрібен retrieval, чи retrieved контекст релевантний, чи відповідь підтримується. GraphRAG (Microsoft) для multi-hop reasoning та складних зв'язків між сутностями. Autonomous knowledge updates: система автоматично індексує нові документи та оновлює граф знань. Очікуваний результат: end-to-end accuracy >92%, зниження галлюцинацій на 25–40%, autonomous handling >80% запитів. NStarX прогнозує: у 2026–2027 роках agentic RAG переходить від експериментів до production, але вимагає ретельнішого підходу через каскадний ефект помилок в agentic chain.

Антипатерни: що гарантовано провалить RAG-проект

1. «Оптимізація наосліп» (tuning without measuring). Зміна embedding model, chunk size, top-k, reranker без evaluation pipeline — це cargo cult engineering. Без базової метрики (baseline faithfulness/recall) ви не знаєте, чи зміна покращила систему чи погіршила. Рішення: перед будь-якою оптимізацією — встановіть baseline через RAGAS або DeepEval на мінімум 100–200 тестових запитах.

2. «Кілька змін одночасно» (multi-variable changes). Покращили chunking, змінили embedding model і оновили prompt в одному деплої — метрики покращились, але ви не знаєте, який саме фактор допоміг. Рішення: одна зміна за раз, evaluation після кожної.

3. «Production без feedback loop». Користувач повідомляє про галлюцинацію, ви виправляєте — але нічого не запобігає повторенню того самого failure pattern. Рішення: production failures → автоматично стають test cases в evaluation pipeline.

4. «Ігнорування вартості evaluation». Запуск повної RAGAS-оцінки з LLM-as-a-Judge на кожному production-запиті може бути неприйнятно дорогим. Рішення: sampling (оцінювати 5–10% трафіку), lightweight approximation для CI/CD (перевірка precision та recall без повного LLM judge), повна оцінка — тільки у staging перед деплоєм.

5. «Фокус на моделі замість даних». Зміна LLM з GPT-4o на Claude 4 Opus без оптимізації retrieval дасть мінімальний ефект, якщо пайплайн повертає нерелевантні чанки. Як зазначає Vectara: кращий парсинг, pre-processing та query intelligence дають більший приріст якості, ніж зміна генеративної моделі.

Як оцінити свій поточний рівень: чеклист

Рівень 0 (Naive PoC): Використовуєте fixed-size chunking? Немає reranking? Оцінюєте якість вручну (spot-checking)? Немає tracing? → Ви тут.

Рівень 1 (Advanced Retrieval): Є hybrid search і reranking? Semantic chunking? Але немає автоматичної evaluation? Немає observability на production? → Ви тут.

Рівень 2 (Production-Aware): Є continuous evaluation (RAGAS/DeepEval)? Tracing (LangSmith/Phoenix/Langfuse)? Semantic cache? A/B тести? Але немає ACL, data versioning, compliance? → Ви тут.

Рівень 3 (Enterprise-Scale): Є ACL-фільтри, zero-downtime ingestion, compliance audit trail? Throughput >1000 QPS? Але немає agentic routing, multi-hop reasoning? → Ви тут.

Рівень 4 (Agentic/Knowledge Runtime): Self-RAG/CRAG? GraphRAG? Multi-agent orchestration? Autonomous knowledge updates? Continuous governance? → Ви тут (менше 5% організацій у 2026 році).

Починайте з чесної оцінки поточного рівня. Якщо ви на рівні 0 — ваш перший крок не «вибрати кращу модель», а додати hybrid search + rerank і підключити evaluation. Якщо на рівні 1 — підключіть tracing та automated eval. Це дасть вимірюваний roadmap на 6–12 місяців, де кожен крок підкріплений конкретними метриками прогресу.

Розділ 5. Навігація по кластерах:

| Кластер | Ключові теми | Коли потрібен |

|---|

| 1. Data Engineering & Ingestion | Advanced ETL (LlamaParse, Docling), semantic/adaptive chunking, multimodal ingestion (ColPali), metadata enrichment, data versioning | Завжди першим — 60–70% якості RAG визначається тут |

| 2. Архітектура Retrieval | VectorDB (Qdrant, Weaviate, Milvus), hybrid search (BM25 + dense + RRF), cross-encoder reranking, query transformation (HyDE, multi-query) | Рівень 0→1: найшвидший ROI (+15–40% precision) |

| 3. Evaluation & Observability | RAGAS, DeepEval, LLM-as-a-Judge у CI/CD, tracing (LangSmith, Phoenix, Langfuse), A/B-тестування, боротьба з галлюцинаціями | Рівень 1→2: без цього — оптимізація наосліп |

| 4. Advanced Patterns | Agentic RAG (LangGraph), multi-hop reasoning, GraphRAG, Self-RAG/CRAG, RAFT | Рівень 3→4: складні запити, multi-hop, self-correction |

| 5. Security & Deployment | ACL/row-level security, local LLMs (vLLM/Ollama), semantic caching, prompt injection у RAG, TCO optimization | Рівень 2→3: enterprise compliance, cost control |

| 6. RAG vs Long Context | Lost in the Middle, latency vs recall, гібридний сценарій (Self-Route), коли long-context замінює VectorDB | Архітектурне рішення: RAG, long-context чи гібрид |

| 7. Галузеві кейси | LegalTech, FinTech, Support automation, E-commerce — архітектурні паттерни, bottlenecks, реальні метрики | Впровадження RAG у конкретній індустрії |

Кожен кластер публікується як окрема стаття з детальними бенчмарками, code examples та trade-off аналізом. Починайте з кластера, що відповідає вашому поточному bottleneck.

Часті питання (FAQ)

Чи замінить long-context RAG у 2026–2027 роках?

Ні. Long-context моделі (1–2M токенів) страждають від lost in the middle — recall для інформації в середині контексту падає на 25–45%. Latency на великих контекстах сягає 5–60 секунд, вартість запиту в 100–1250 разів вища, ніж у RAG з кешем. На корпусах більше 100–200 тис. токенів advanced RAG стабільно показує 85–92% recall при 0.3–2 секундах. Гібрид (RAG як основа + long-context для глибокого аналізу) — це паттерн 2026 року, а не заміна одного іншим.

З чого почати оптимізацію RAG-проекту?

З двох речей одночасно: ingestion (semantic chunking замість fixed-size) та evaluation (RAGAS/DeepEval + LLM-as-a-Judge). Semantic chunking + LlamaParse дають +20–70% до recall за мінімальні гроші. Без оцінки ви не знаєте, чи зміни покращують або погіршують систему. Більшість команд, що застрягли на рівні 1, витрачають місяці на марні експерименти з моделями саме через ігнорування цих двох шарів.

Яка VectorDB найкраща для enterprise у 2026 році?

Для більшості enterprise-кейсів — Qdrant або Weaviate. Qdrant лідирує за latency (P95 30–40 мс) і throughput, сильний prefetch для multi-stage retrieval. Weaviate — найкращий native hybrid search (BM25 + vector + GraphQL), зручне metadata filtering. Milvus — тільки якщо реально мільярди векторів і потрібен distributed/GPU. Pinecone — зручний managed, але дорожчий. Для типового hybrid-heavy workload Qdrant або Weaviate перемагають у 80–90% випадків.

Скільки коштує production RAG на 1 млн запитів/місяць?

$500–5000 залежно від оптимізації. Без оптимізації (API-based LLM, без кешу): $3000–8000. З semantic cache (Redis) — економія 50–80% токенів → $500–2000. Self-hosted vLLM + quantized модель + on-prem Qdrant — $300–1000 (інфраструктура + електрика). Топові команди тримають TCO нижче $0.001 за запит при 1–2 млн запитів/міс завдяки cache, batching та local inference.

Коли варто переходити на agentic RAG?

Коли 40–60% запитів вимагають multi-hop reasoning або self-correction (support з ескалацією, legal research, due diligence). Якщо поточний RAG на простих задачах дає більше 85% satisfaction — agentic підхід часто overkill. Впроваджуйте поетапно: agentic routing на 20–30% найскладніших запитів, A/B-тест покаже ROI. Типовий trade-off: +10–30% accuracy, але +0.5–2 с latency та +20–80% вартості токенів.

Висновки

RAG у 2026 році — це Knowledge Runtime: повноцінна production-система з чіткими шарами, trade-off'ами та операційними вимогами. Вона вимагає такого ж рівня уваги, як будь-яка критична інфраструктура: надійність, observability, governance, TCO-контроль та безперервне покращення.

П'ять ключових принципів для переходу від PoC до enterprise:

Фундамент визначає результат. Ingestion (semantic chunking, multimodal ETL, metadata enrichment) та evaluation (RAGAS/DeepEval + LLM-as-a-Judge) дають 60–70% кінцевої якості. Без сильних даних і метрик решта оптимізацій — косметика.

Retrieval — серце системи. Hybrid search + rerank + late-interaction (ColPali для multimodal) — мінімум для production-рівня recall/precision вище 85–90%. Rerank дає найвищий ROI: +15–40% precision за мінімальні витрати.

Observability — не опція, а паралельний шар. Tracing, A/B, alerting на деградацію faithfulness — це те, що відокремлює робочу систему від дорогого PoC. Без цього ви не знаєте, чи покращується система, чи деградує.

Long-context — доповнення, не заміна. Моделі з 1M+ токенами корисні для маленьких статичних корпусів або як верхній шар (fallback, summarization). Для великих, динамічних даних, низької latency та TCO — RAG або гібрид перемагає за всіма ключовими параметрами.

Матриця зрілості — ваш roadmap. Визначте поточний рівень, зрозумійте критерії переходу, рухайтесь послідовно. Стрибок з рівня 0 одразу на рівень 4 — це провал. Рівень 2 (observability + evaluation) — мінімум для production.

RAG — це інженерія, а не магія. Інвестуйте в дані, метрики та observability першими — і система стане надійним, масштабованим інструментом, який приносить бізнес-цінність, а не просто генерує текст з контекстом.