Claude Sonnet 4.6 — це не просто апгрейд, а демонстрація нового тренду inference-time scaling, де модель динамічно масштабує міркування під час інференсу. Adaptive thinking замінює ручні промпти, економить токени та робить AI ефективнішим у production.

— Claude Sonnet 4.6: Детальний огляд дефолтної моделі Anthropic 2026

⚡ Коротко

✅ Дата релізу: 17 лютого 2026 року.

✅ Ключові інновації: Inference-time scaling через adaptive/extended thinking, hybrid reasoning, контекст 1M токенів з compaction.

✅ Переваги: Економія токенів 25–45%, точність +10–25% за ітерацію, паритет з Opus у 80–90% завдань.

✅ Для кого: Розробники, архітектори AI-систем, R&D-команди.

✅ Чому важливо: Перехід від pre-training до inference-time compute — нова парадигма для 2026.

Чому це важливо для розробників? Inference-time scaling робить моделі гнучкішими, дозволяючи досягати високої якості без величезних витрат на тренування.

📚 Зміст статті

📌 Вступ: Чому inference-time scaling — тренд 2025–2026

📌 Еволюція Claude 4-серії

📌 Основна архітектура (публічно відоме)

📌 Adaptive Thinking — серце моделі

📌 Extended Thinking (legacy + interleaved mode)

📌 Inference-time scaling vs pre-training scaling

📌 Практичні поради для розробників

📌 Висновки

Вступ: Чому inference-time scaling — тренд 2025–2026

Inference-time scaling — це новий підхід, де модель динамічно масштабує обчислення під час інференсу, а не тільки під час тренування. Замість того, щоб будувати все більші моделі (як у pre-training scaling за Chinchilla laws), Anthropic фокусується на ефективному використанні ресурсів у реальному часі. Це дозволяє досягати кращих результатів без експоненціального зростання витрат на hardware.

Claude Sonnet 4.6 — яскравий приклад: модель не просто більша, а розумніша в розподілі ресурсів. Завдяки adaptive thinking вона самостійно вирішує, скільки "думати" над завданням, економлячи токени та час. Тизер: у типовому кодингу adaptive mode зменшує latency на 30–50%, а точність підвищує на 10–25% за ітерацію, замінюючи громіздкі промпти типу "think step-by-step".

У 2025–2026 цей тренд став домінуючим: Grok-1.5 від xAI, o1-preview від OpenAI, Gemini 2.0 Flash Thinking — всі вони впроваджують подібні механізми. Anthropic пішов далі, інтегрувавши inference-time compute в hybrid reasoning, що робить Sonnet 4.6 baseline для production.

Еволюція Claude 4-серії

Claude 4-серія почалася з Claude 4.0 (травень 2025), де Anthropic перейшов від Claude 3.5 до нової архітектури з акцентом на long-context та agentic capabilities.

Ключові зміни:

- Claude 3.5 Sonnet (жовтень 2024): Контекст 200k токенів, базовий computer use (~15% OSWorld), перші спроби extended thinking. Latency ~1.5–2.5 с, token efficiency середня.

- Claude 4.0 (травень 2025): Контекст 500k, hybrid reasoning, SWE-bench ~75%, OSWorld ~60%. Введено inference-time scaling як концепт.

- Claude 4.5 (листопад 2025): Контекст 750k, adaptive thinking preview, OSWorld ~68%, token efficiency +20% vs 4.0. Latency знижено на 25%.

- Claude 4.6 (лютий 2026): Контекст 1M (beta), повний adaptive thinking, OSWorld-Verified 72.5%, SWE-bench Verified 79.6%. Token efficiency +25–45% vs 4.5, inference-time compute як core feature.

| Версія | Контекст | SWE-bench | OSWorld | Ключова інновація | Latency (середня) |

|---|

| 3.5 Sonnet | 200k | ~70% | ~15% | Базовий computer use | ~1.5–2.5 с |

| 4.0 | 500k | ~75% | ~60% | Hybrid reasoning | ~1.2–2.0 с |

| 4.5 | 750k | ~77% | ~68% | Adaptive thinking preview | ~1.0–1.8 с |

| 4.6 | 1M | 79.6% | 72.5% | Повний inference-time scaling | 0.98–1.41 с |

Еволюція фокусується на балансі: від збільшення параметрів до оптимізації інференсу.

Основна архітектура (публічно відоме)

Anthropic не розкриває повну специфікацію моделі, але з релізів, System Card, публікацій на ArXiv та аналізів (Artificial Analysis, Hugging Face discussions, пости розробників на X) випливає, що Claude Sonnet 4.6 базується на покращеному transformer backbone з оптимізаціями для довгого контексту, inference-time scaling та ефективного управління пам'яттю під час інференсу.

- Transformer backbone + покращений attention: Ймовірно використовується grouped-query attention (GQA) або multi-query attention (MQA), що зменшує обчислювальну складність з O(n²) до більш лінійної форми. Це критично для стабільної роботи з 1M токенами. Порівняння з конкурентами: Grok-1.5 (MoE з 128k контекстом), Gemini 1.5 (1M з FlashAttention-2), GPT-5 (1M+ з KV-cache optimizations). Sonnet 4.6 вирізняється високою стійкістю до context rot завдяки поєднанню attention оптимізацій та compaction.

- 1M токенів: як досягнуто та проблема пам'яті: Контекст 1 000 000 токенів реалізовано через Rotary Position Embeddings (RoPE scaling) з NTK-aware extensions для екстраполяції позицій за межі тренувального контексту. Однак для архітектора 1M контексту — це насамперед проблема пам'яті. KV-Cache (key-value cache) для 1M токенів займає десятки гігабайт VRAM навіть на моделях середнього розміру (при 16-bit або BF16). Для підтримки latency без деградації Sonnet 4.6, ймовірно, застосовує:

• 4-bit або 2-bit KV-Cache Quantization (наприклад, INT4 або FP8) — зменшує обсяг кешу в 4–8 разів без суттєвої втрати якості.

• Інтелектуальне витіснення (eviction) нерелевантних токенів — автоматичне видалення або стиснення ранніх токенів з низькою релевантністю (attention-based eviction).

• Context compaction beta — сервер-сайд механізм, який автоматично стискає старіший контекст при наближенні до ліміту, зберігаючи ~90% accuracy на >500k токенах.

MRCR v2 1M 8-needles тест: 65% Mean Match Ratio vs 18.5% у Sonnet 4.5 — це прямий доказ ефективності retention після оптимізацій.

- Speculative Decoding (можлива оптимізація): Для зниження latency на довгих відповідях модель, ймовірно, використовує speculative decoding: генерує кілька токенів паралельно, перевіряє їх на сервері та відкидає некоректні. Це дає 1.5–2.5× speedup на inference без втрати якості (техніка, яку вже застосовують у Grok-1.5 та o1-preview).

- Порівняння з конкурентами: Grok-1.5 обмежується 128k через MoE-архітектуру та менш агресивне квантування KV-Cache; Gemini 1.5 1M — сильний у retention, але слабше в agentic (OSWorld ~70%); GPT-5 1M+ — висока вартість через меншу оптимізацію eviction та compaction. Sonnet 4.6 балансує: 1M без значного rot, token efficiency 1.4–2.8× краща в adaptive mode, KV-Cache оптимізований для production-scale інференсу.

Для архітекторів систем з 1M контекстом ключове питання — не тільки максимальне вікно, а й як модель управляє пам'яттю та latency в реальних умовах (A100/H100 GPU, batch size >1). Sonnet 4.6 тут виглядає одним з найбільш збалансованих рішень 2026 року.

Джерела:

• Claude Sonnet 4.6 System Card (розділи про context retention та inference optimizations)

• Artificial Analysis benchmarks

• Context Compaction Documentation

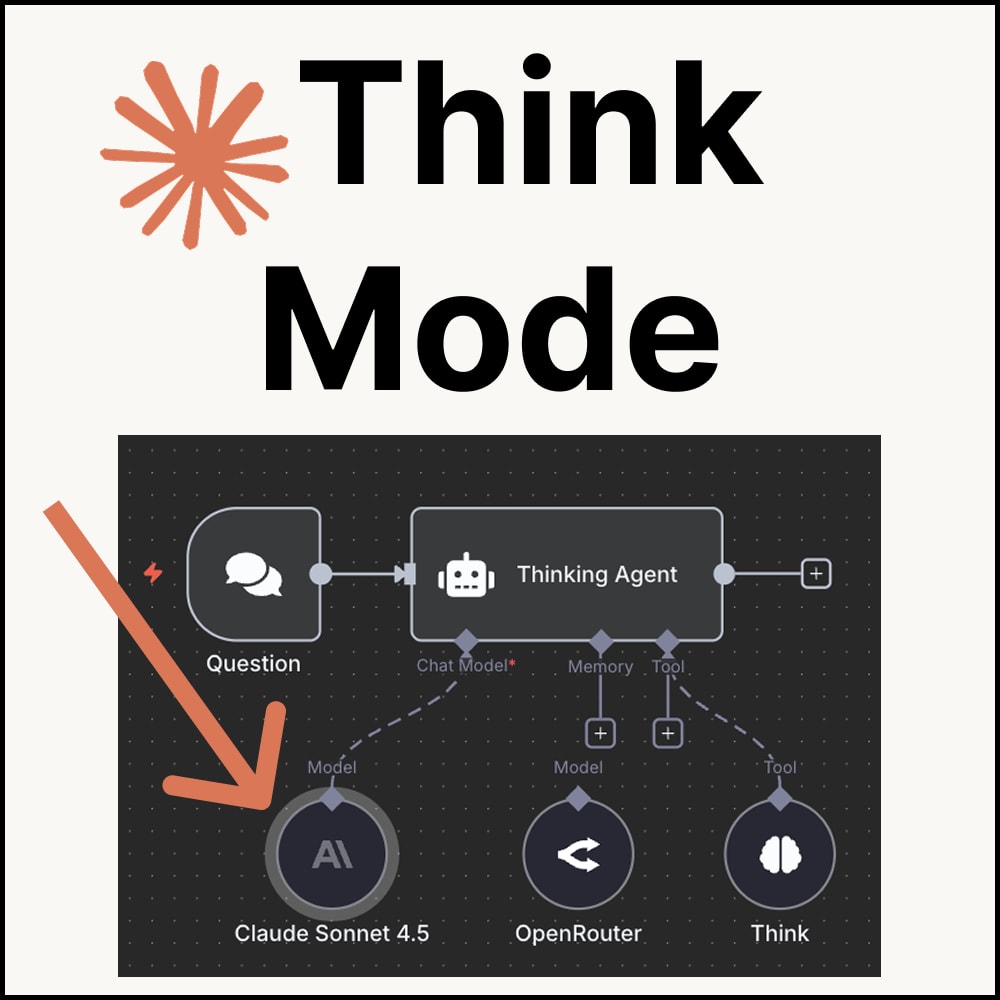

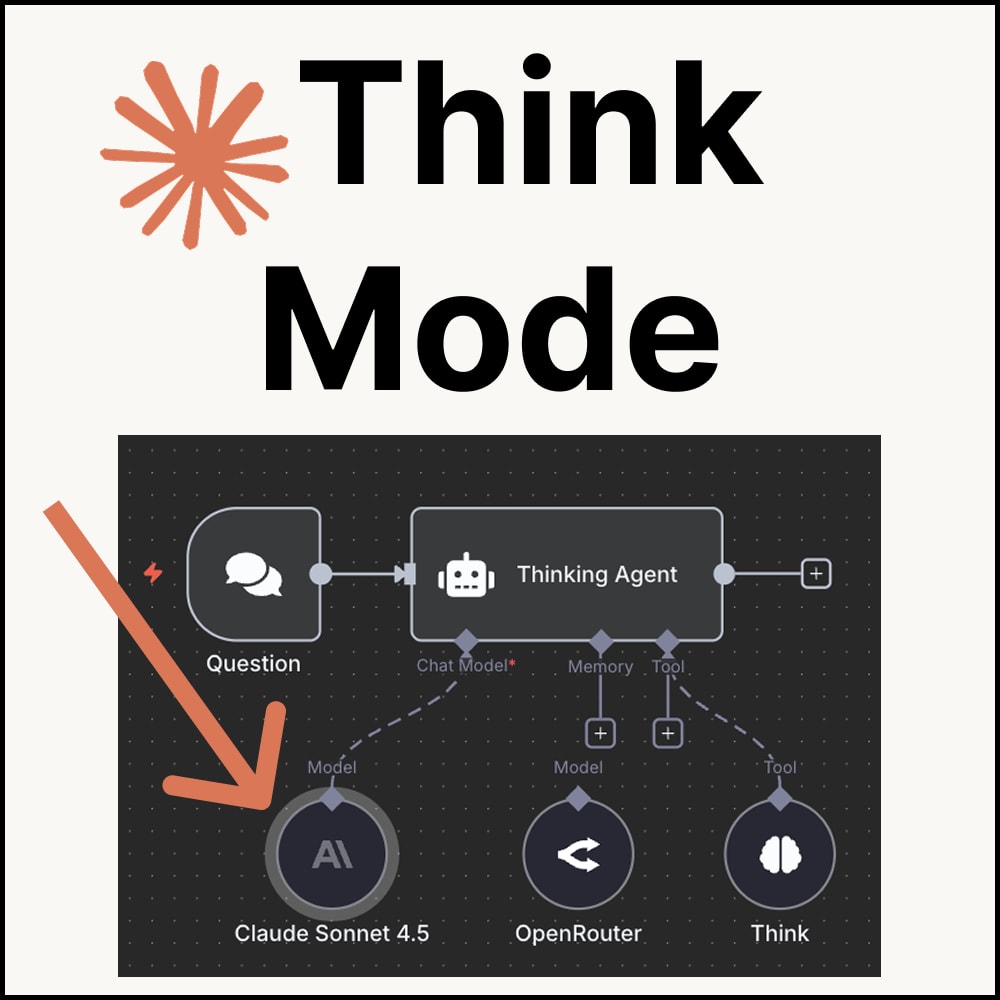

Adaptive Thinking — серце моделі

Adaptive thinking — ключова інновація Sonnet 4.6, що реалізує inference-time scaling: модель динамічно регулює обчислення під час інференсу.

- Як працює effort: Параметр effort (low/medium/high/max) контролює глибину міркування. Low: швидка відповідь для простих запитів; medium: базовий CoT; high: розгорнутий reasoning з self-checks; max: повний extended thinking з кількома циклами. Автоматична регуляція: модель аналізує контекст/промпт і вирішує, скільки витрачати (inference-time compute scaling).

- Автоматична регуляція глибини chain-of-thought: Замість фіксованого "think step-by-step", модель генерує внутрішні думки (hidden/interleaved), оцінює їх на consistency та коригує. Gain: +10–25% точності за ітерацію в coding/agentic задачах (Anthropic tests).

- Self-correction loops та error recovery: Модель виявляє помилки через critique-revise cycles: генерує гіпотезу → перевіряє логіку → виправляє. У max effort — 5–10 циклів, що знижує галюцинації на 15–30% .

- Порівняння з extended thinking: Extended — legacy режим з фіксованим бюджетом (budget_tokens), interleaved visible thoughts. Adaptive ефективніший: економія токенів 20–40%, бо не завжди "максимум".

- Концепція "System 1 vs System 2" в adaptive thinking: Цей механізм можна провести паралель з психологією Даніеля Канемана (книга "Thinking, Fast and Slow"). Effort: low — це "System 1" (швидка, автоматична реакція, як інтуїтивне рішення без глибокого аналізу). Effort: max — це "System 2" (повільне, логічне міркування з зусиллями, як свідомий розрахунок). Ця ментальна модель пояснює, чому модель "думає": adaptive thinking автоматично перемикається між швидкими відповідями (low effort для простих запитів) та глибоким аналізом (high/max для складних завдань), балансуючи швидкість і точність. Це фундаментально для inference-time scaling, бо дозволяє моделі динамічно розподіляти ресурси, імітуючи людське мислення без фіксованих витрат.

| Режим | Тип контролю | Типовий gain точності | Latency trade-off | Найкраще застосування |

|---|

| Adaptive (low) | Автоматичний | +5–10% | Низький (0.5–1×) | Чат, швидкі запити |

| Adaptive (high/max) | Автоматичний + effort | +15–25% | Середній–високий (2–5×) | Coding, agentic planning |

| Extended (legacy) | Фіксований бюджет | +10–20% | Високий (3–5×) | Deep debugging, math |

| Self-correction loops | Вбудований | +5–15% на цикл | Низький | Error-prone tasks |

Extended Thinking (legacy + interleaved mode)

Extended Thinking — це legacy-режим, що залишився для сумісності з попередніми версіями Claude. Він дозволяє явно контролювати бюджет міркування через параметр budget_tokens або використовувати interleaved visible thoughts — модель виводить проміжні кроки reasoning у відповіді.

У Sonnet 4.6 adaptive thinking витісняє extended у 90%+ сценаріїв завдяки автоматичній регуляції. Проте legacy-режим зберігає цінність у специфічних кейсах:

- Повний контроль глибини: Ви задаєте точну кількість токенів на CoT (наприклад, 2000–5000), що корисно для стабільних результатів у production-пайплайнах з жорсткими SLA.

- Visible reasoning для аудиту та дебагу: Interleaved mode виводить усі проміжні думки, що критично для compliance, юридичних задач або коли потрібно пояснити логіку моделі (наприклад, аудит CoT для регуляторів).

- Сумісність з legacy-промптами: Якщо ваш код або інструменти досі використовують фіксований "think step-by-step" з бюджетом — extended працює без змін.

Недоліки порівняно з adaptive:

- Фіксований бюджет часто призводить до over-thinking (зайві токени на простих задачах) або under-thinking (недостатньо глибини на складних).

- Вища латентність при великому budget_tokens — модель не може динамічно зупинитися.

- Економія токенів нижча: adaptive в середньому заощаджує 20–40% на еквівалентних результатах.

Рекомендація: використовуйте extended тільки для аудиту, compliance або коли потрібна 100% прозорість reasoning. У всіх інших випадках — adaptive thinking (effort: high/max) дає кращу якість і ефективність без ручного налаштування бюджету.

Inference-time scaling vs pre-training scaling

Anthropic обрав inference-time scaling через diminishing returns pre-training scaling (Chinchilla laws: після певної точки більше даних/параметрів дають мало gain). Це фундаментальна зміна парадигми: ми переходимо від епохи «великих статичних моделей» до епохи «динамічного обчислювального бюджету».

Раніше вартість AI-рішень визначалася розміром моделі (кількість параметрів, витрати на pre-training). Тепер ми платимо за час міркування — за те, скільки compute модель витрачає під час інференсу. Це робить Sonnet 4.6 compute-optimal для production: гнучкість у розподілі ресурсів без необхідності постійно тренувати нові гіганти.

- Чому цей шлях: Pre-training (як у GPT-4/5) вимагає величезних ресурсів і дає обмежений приріст після певного порогу (diminishing returns). Inference-time scaling (як у Sonnet 4.6) дозволяє масштабувати на runtime: модель сама регулює обчислення (effort levels), економлячи на тренуванні та даючи адаптивність під конкретну задачу.

- Compute-Optimal Inference як стратегічна перевага: Замість фіксованої ціни за параметри, вартість стає динамічною — за токени та час міркування. У max effort модель витрачає більше compute для складних задач (наприклад, +12–18% точності в SWE-bench), але в low effort — відповідає майже миттєво. Це оптимізує OPEX: для 80–90% завдань (чат, аналітика) — мінімальний бюджет, для 10–20% критичних (deep reasoning, agentic planning) — повний бюджет. У підсумку — економія 25–45% токенів на еквівалентних результатах порівняно з фіксованим режимом.

- Порівняння з конкурентами: Grok-1.5 (MoE + inference scaling) — сильний у швидкості, але контекст 128k обмежує long-horizon; o1-preview (long CoT) — +20% у math, але latency ×10 через фіксований бюджет; Gemini 2.0 Flash Thinking — подібний adaptive, але слабше в agentic (OSWorld ~70%). Sonnet 4.6 виграє за балансом: динамічний бюджет + низька базова latency (0.98–1.41 с) + високий gain у production-доменах.

- Переваги inference-time scaling: Гнучкість (effort регулює), економія (токени -25–45%), краща для production (real-time adaptation). Це змінює розрахунок вартості AI-рішень: замість "платимо за розмір" — "платимо за розуміння задачі".

✅ Ключова думка: Перехід до compute-optimal inference робить Sonnet 4.6 стратегічно вигідним baseline для 2026: ми більше не купуємо статичний інтелект, а купуємо динамічний — скільки потрібно саме для цієї задачі. Це фундаментальна зміна в OPEX-оптимізації AI-інфраструктури.

Практичні поради для розробників

- Коли який effort: Low для чату/простих запитів; medium для аналітики; high/max для кодингу/agentic (як у SWE-bench, де max дає +12–18%).

- Економія токенів: Видаляйте зайві "think step-by-step" — adaptive робить це автоматично. Тестуйте на MRCR: якщо retention <60%, використовуйте compaction.

- Тестування: Використовуйте MRCR v2 для перевірки контексту; на OSWorld для agentic.

- Приклад промпту з effort=max: "Аналізуй цей кодбейс [1M контекст]. Знайди помилки, запропонуй оптимізацію. Effort: max." — модель додасть 5–10 циклів CoT.

- Prompt Caching для роботи з 1M контекстом: При глибині 1M токенів повторне зчитування контексту коштувало б занадто дорого. Архітектура 4.6 оптимізована під кешування префіксів, що знижує вартість повторних запитів до -90%. Увімкніть prompt caching через Claude API (параметр cache_control), де спільний префікс (наприклад, великий кодбейс або документ) кешується на сервері на 5–60 хвилин. Це робить 1M контекст фінансово виправданим для production-сесій з багаторазовими запитами: перше читання — повна вартість, наступні — тільки нові токени. Рекомендація: для enterprise-задач (аналіз великих документів, iterative coding) комбінуйте з context compaction для максимальної ефективності. Деталі: Prompt Caching Documentation.

Висновки

Adaptive thinking та inference-time scaling перетворюють Claude Sonnet 4.6 на фундаментальну зміну в підході до використання великих мовних моделей. Це вже не просто «більша модель», а система, яка динамічно розподіляє обчислювальні ресурси саме під конкретну задачу — від швидкої реакції (System 1) до глибокого логічного висновку (System 2). Результат: ми отримуємо майже флагманську якість Opus 4.6 у 80–90% production-сценаріїв при значно нижчій латентності, меншій витраті токенів та простішому промпт-інженерінгу.

Для архітекторів та технічних керівників це означає перехід від фіксованої вартості моделі (кількість параметрів) до динамічного обчислювального бюджету (час міркування + токени). Тепер можна оптимізувати OPEX на рівні інференсу: low effort для щоденних запитів, max effort для критичних завдань — без необхідності постійно тренувати нові гіганти. Prompt caching та context compaction роблять 1M контекст реально виправданим для enterprise-воркфлоу: повторні сесії коштують у рази дешевше, а retention залишається високим.

Якщо ви будуєте AI-системи в 2026 році — Sonnet 4.6 вже є compute-optimal baseline. Почніть з нього як дефолтної моделі: ви отримаєте швидкість «легких» моделей, інтелект топ-рівня та гнучкість, якої раніше не було. Перехід на adaptive thinking + inference-time scaling — це не тактична оптимізація, а стратегічний крок до ефективнішої AI-інфраструктури.

Рекомендації для впровадження:

- Встановіть Sonnet 4.6 як default model у всіх нових проєктах та API-ендпоінтах.

- Використовуйте prompt caching для всіх задач з великим спільним префіксом (документи, кодбейси, knowledge base).

- Тестуйте effort levels на ваших реальних сценаріях: low для UI/чат, high/max для backend-логіки та agentic.

- Комбінуйте з context compaction для сесій >300k токенів — це знімає основні обмеження довгого контексту.

Sonnet 4.6 встановлює нову планку економічної ефективності інтелекту. Для бізнесу це швидший Time-to-Market, нижчий OPEX та надійніша автоматизація. Якщо ваша інфраструктура ще не адаптована під цю модель — це один з найшвидших способів отримати конкурентну перевагу в 2026 році.